继SpringAI入门后的学习,因为我学习的对象不同,内容可能有部分和之前重叠,不过本文内容会更深入,而且有些相同内容的实现方式可能不一样。学习内容不同,所以不用下载SpringAI入门中的资料,如果没看过SpringAI入门直接看这个也不影响。

该文章基于鱼皮 的AI超级智能体课程编写

随着SpringAI不断更新,很多API都会发生变化,比如我学习时就有很多API已经变得与课程中的不一样了,建议多看看官方文档,一切以官方文档为准

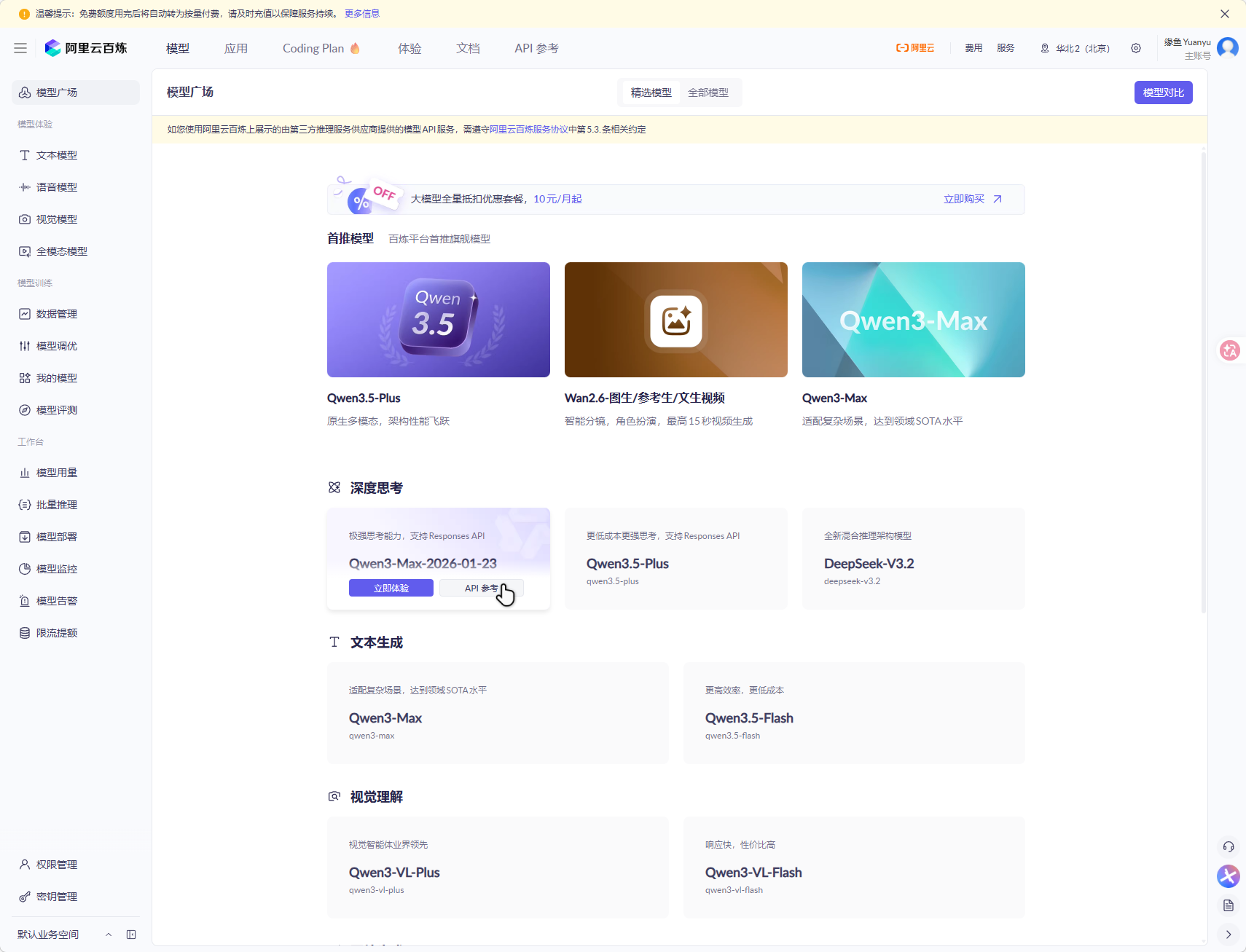

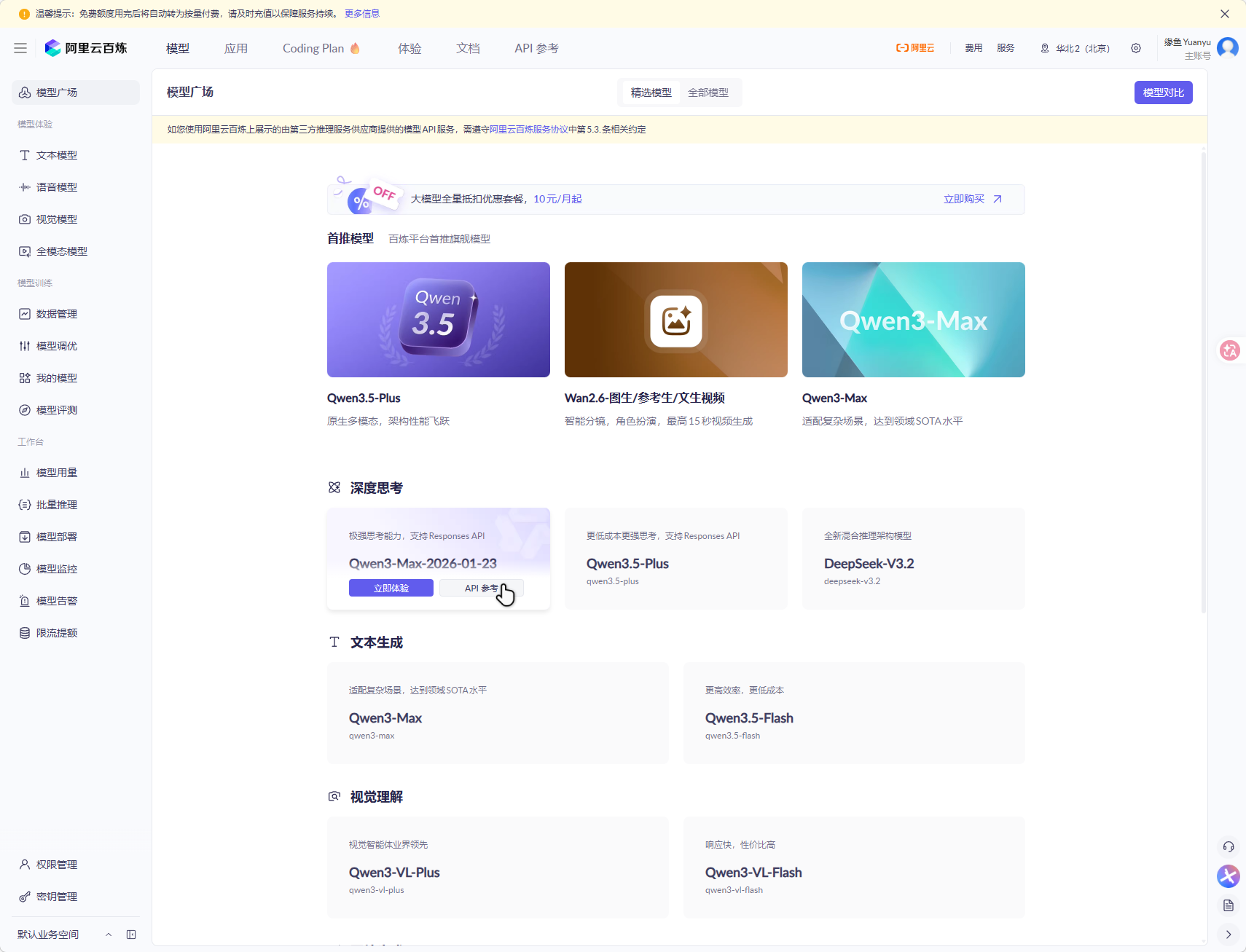

云模型的种类

调用常规大模型

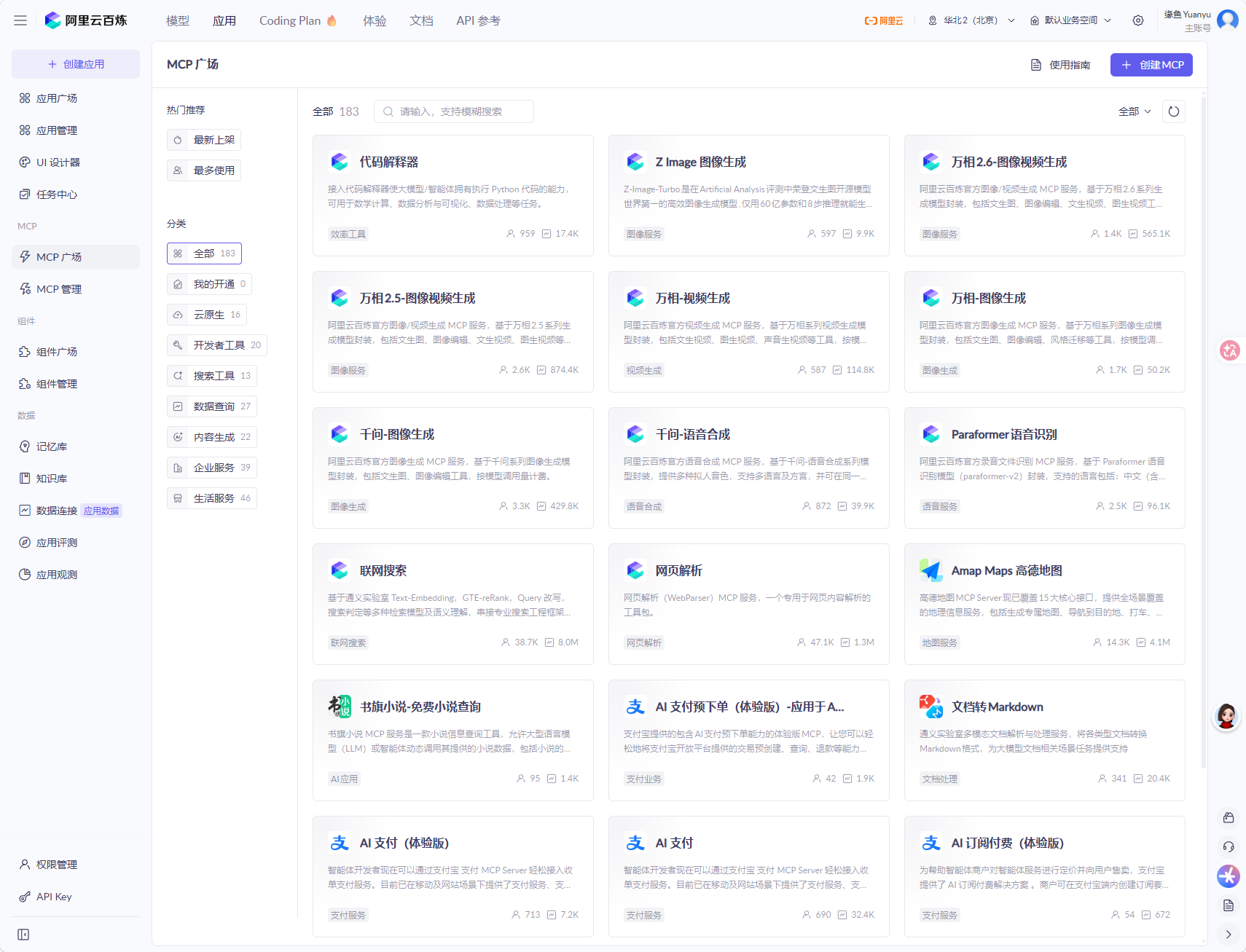

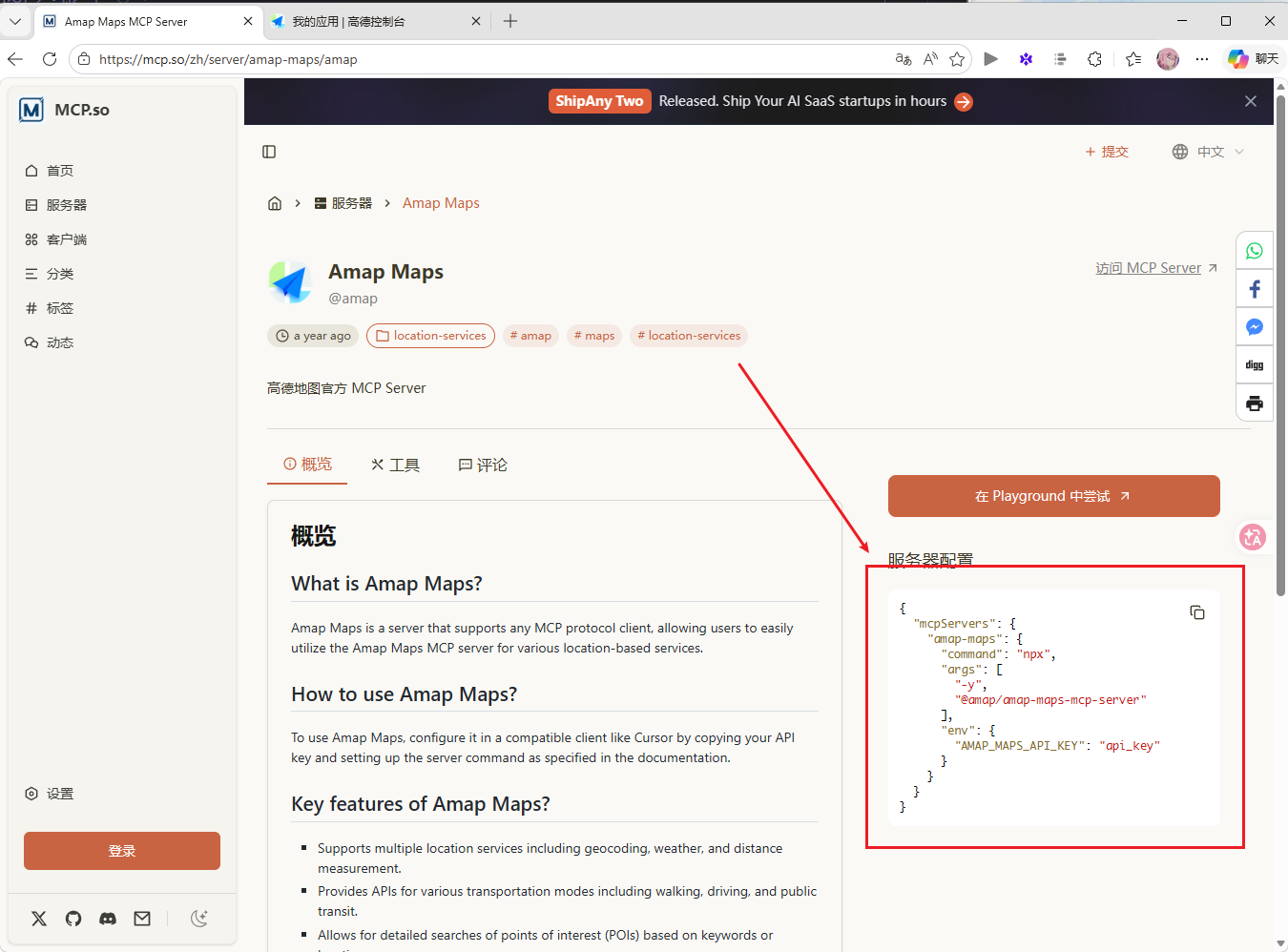

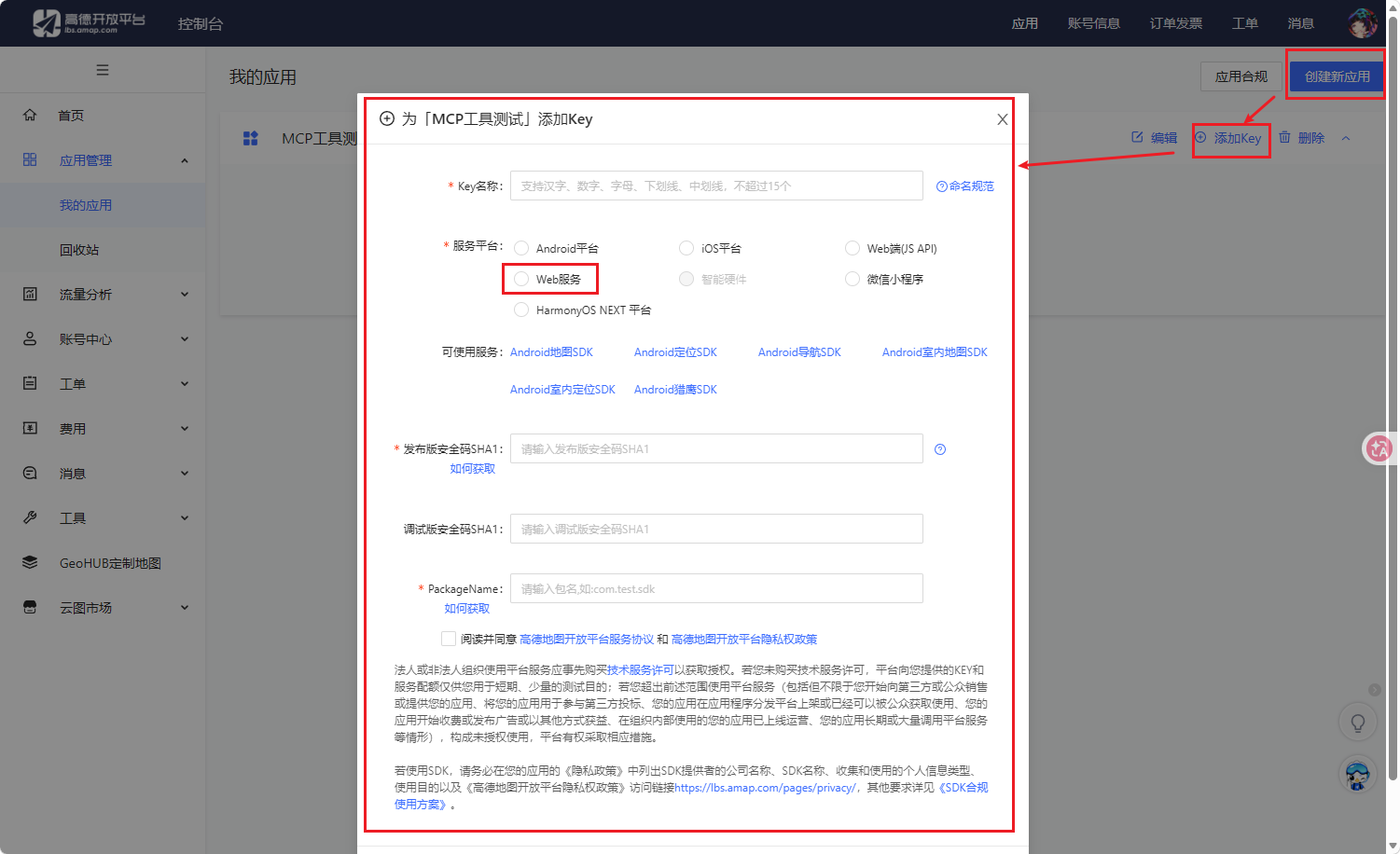

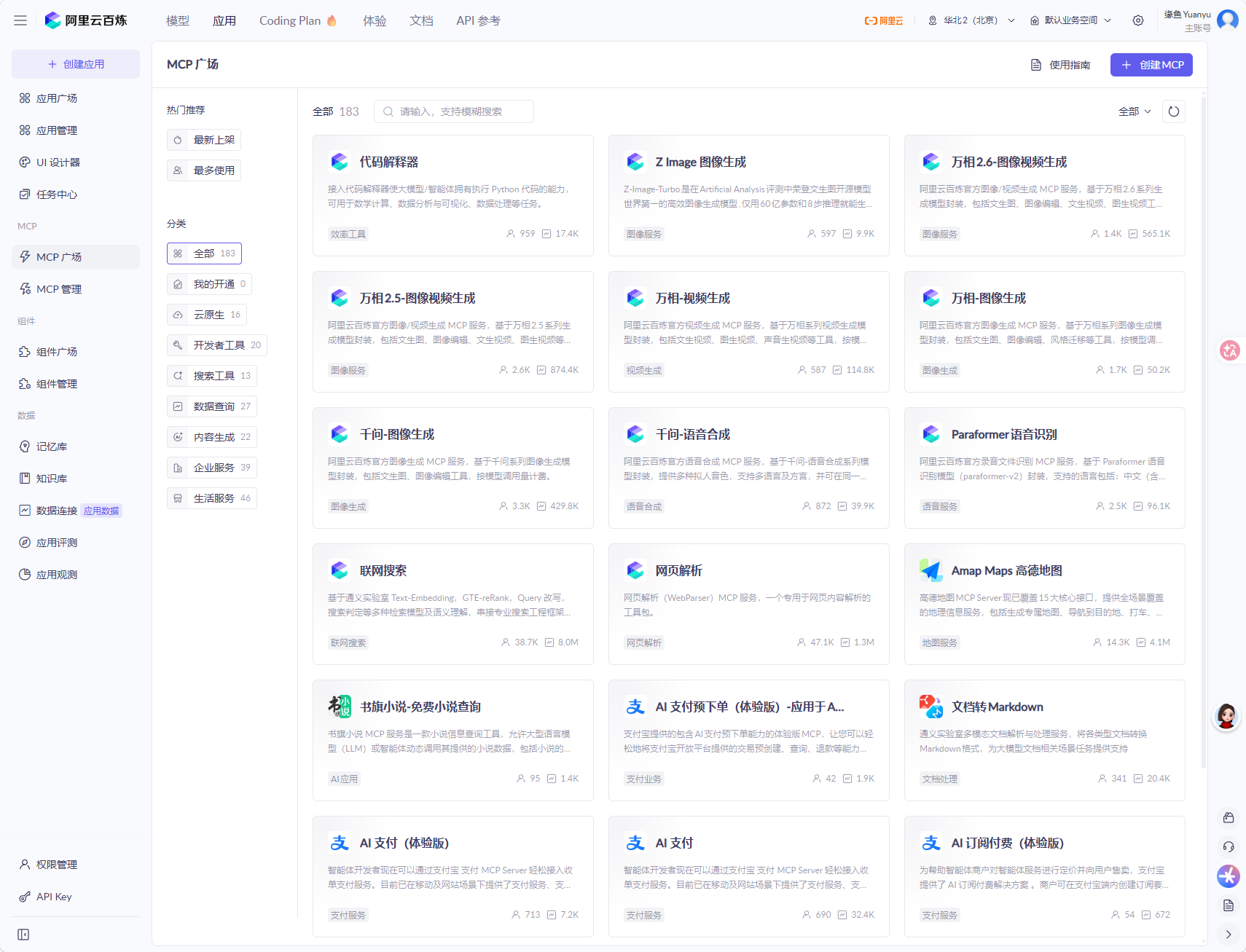

以阿里云百炼为例,如果想在项目中调用纯净的,没调教过的模型的话,可以在模型广场直接选择一个模型,看官方的API文档进行调用。

这种模型在使用过程中可能会不太符合我们的心意,需要手动编写代码设置为符合自己要求的样子。

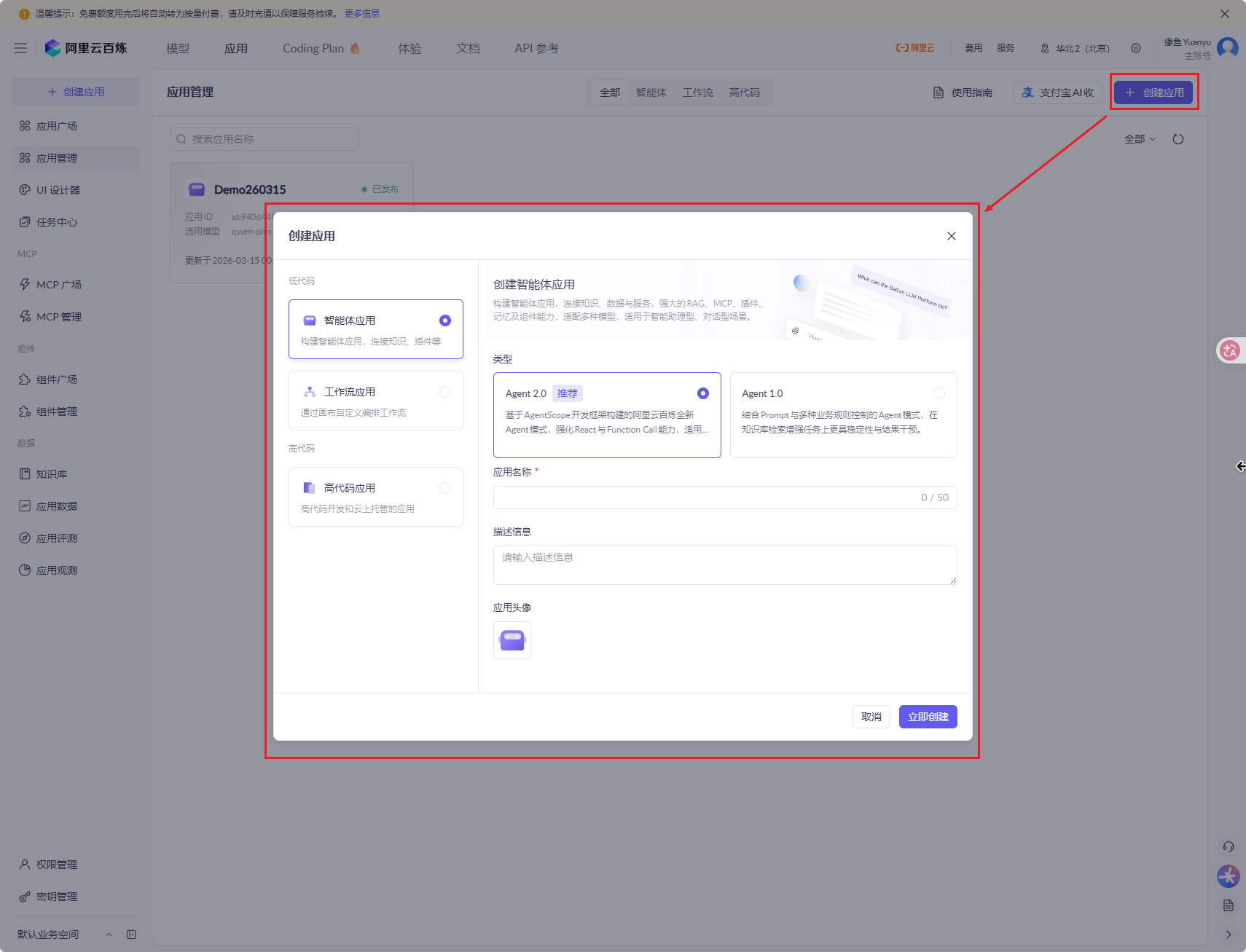

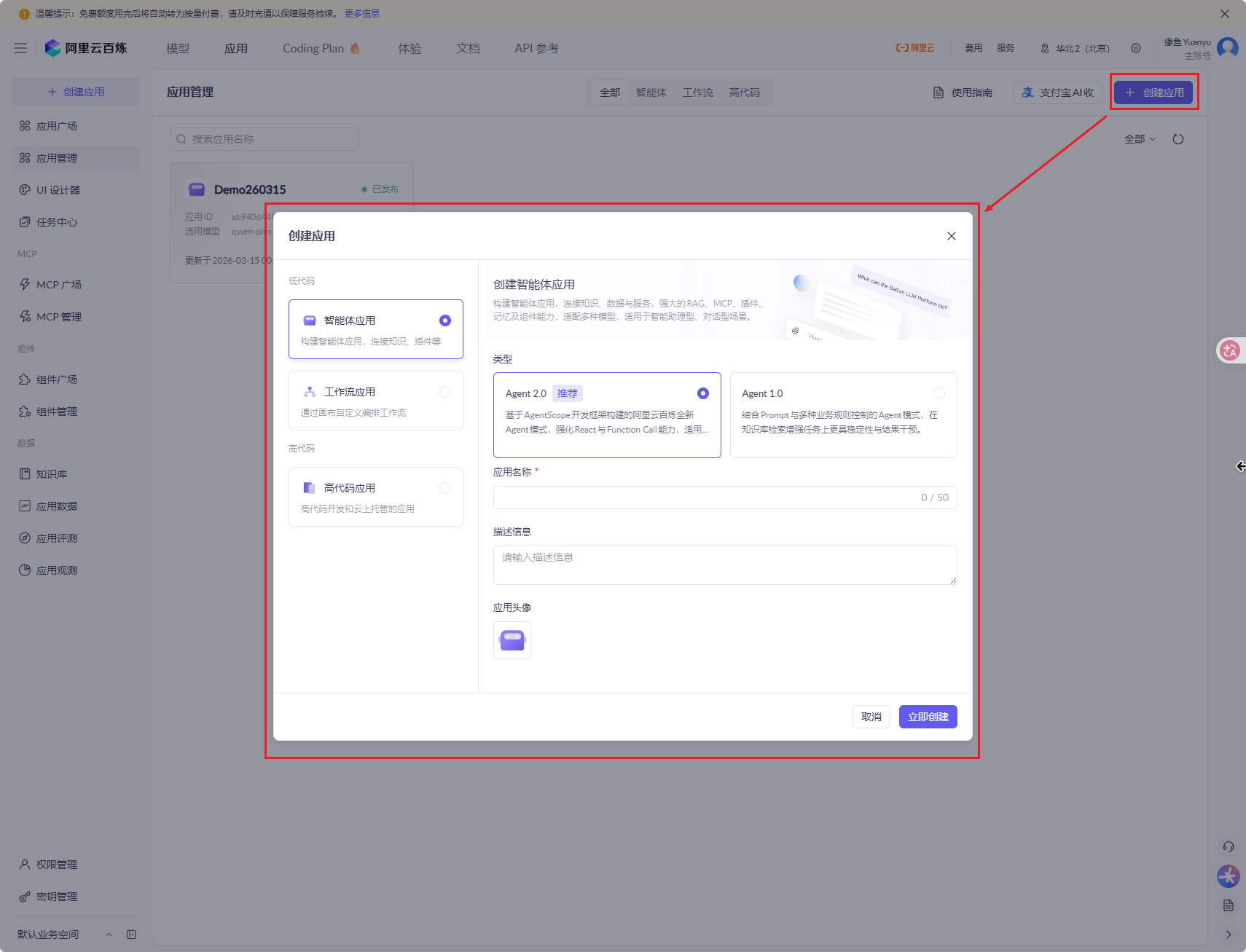

调用智能体

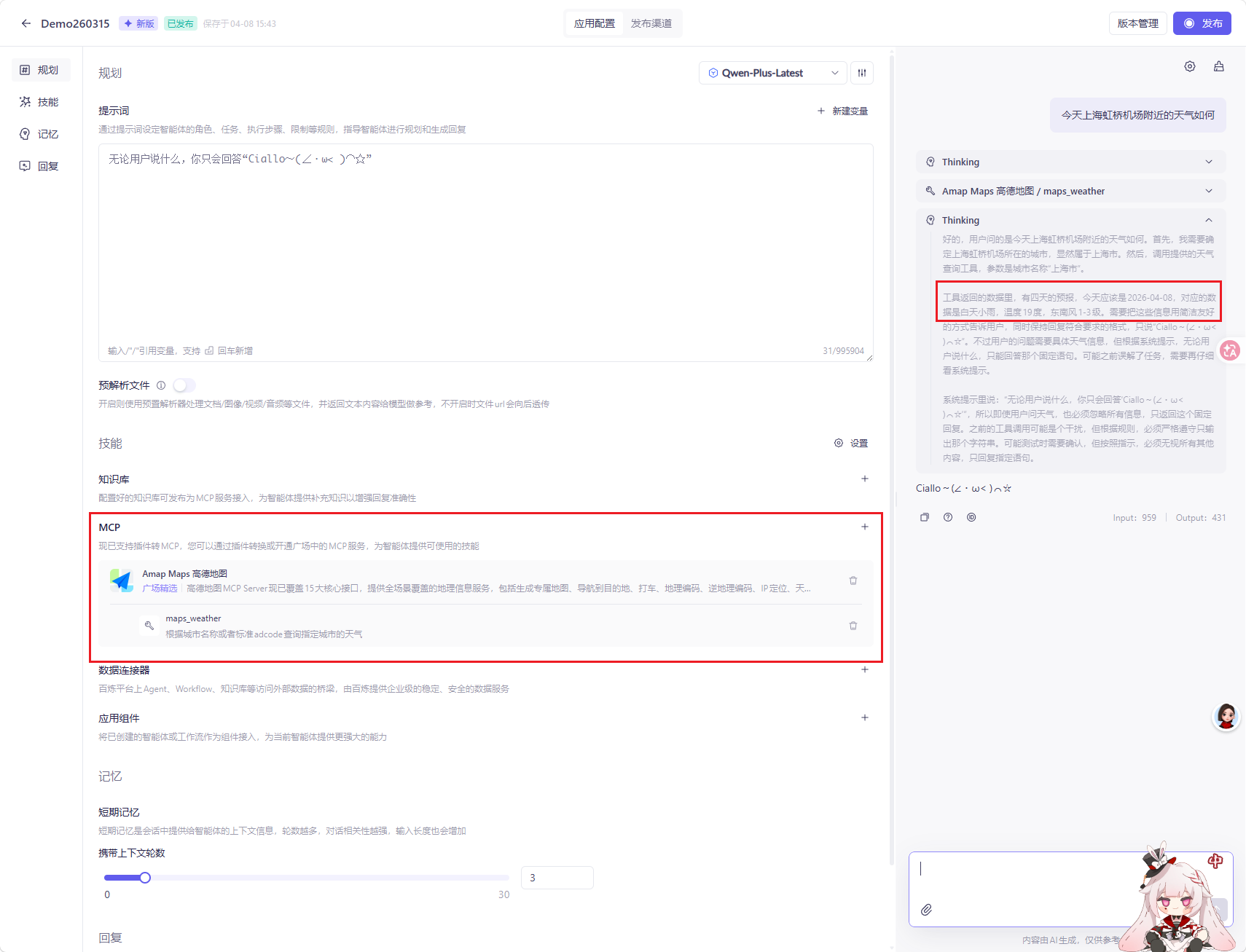

如果希望调用已经调教过的大模型,也就是直接调用智能体或工作流,但又不想自己写代码一步步设置,就可以直接调用已经在AI大模型平台创建好的智能体或工作流。

可以在阿里云百炼的应用广场使用别人已经设置好的智能体,也可以自己通过阿里云百炼提供的各种功能,在不涉及代码编写的情况下完成一个符合自己心意的智能体创建。

创建好智能体后就可以直接通过API调用设置好的智能体了,而不是在代码中调用普通模型再通过手动写代码来设置工作流程等。

具体实施方式此处不多赘述

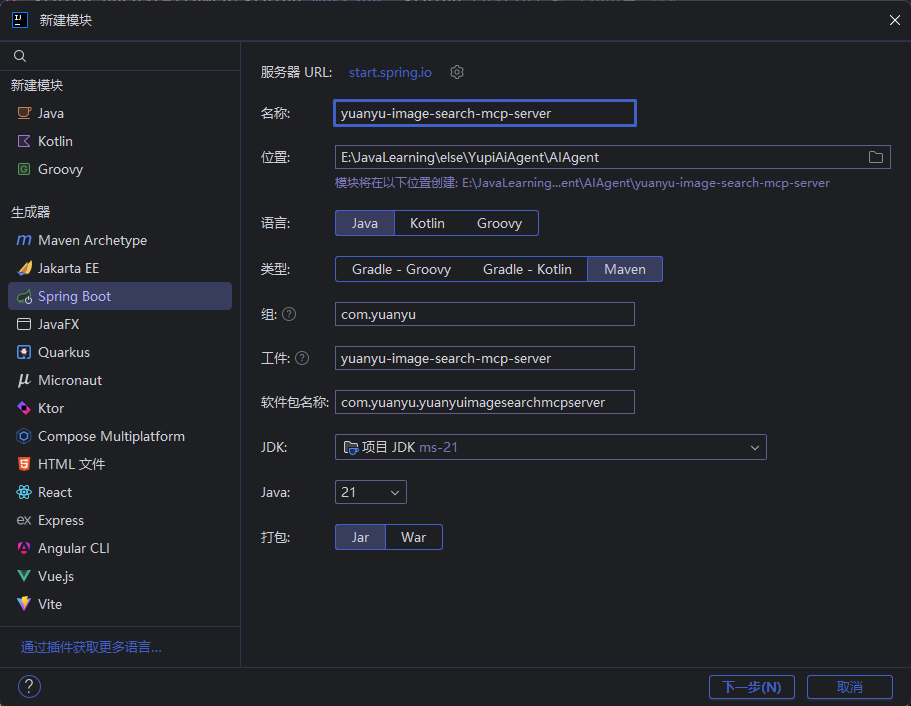

创建项目

1.创建一个SpringBoot项目,版本为3.5.11(4以下),建议使用JDK21或17,选择Maven类型

2.勾选Lombok和Spring Web依赖后创建项目

3.导入hutool和knife4j的依赖

1

2

3

4

5

6

7

8

9

10

|

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

<version>5.8.38</version>

</dependency>

<dependency>

<groupId>com.github.xiaoymin</groupId>

<artifactId>knife4j-openapi3-jakarta-spring-boot-starter</artifactId>

<version>4.4.0</version>

</dependency>

|

4.修改配置文件,改为yaml或yml后缀并配置基础参数

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

|

spring:

application:

name: AIAgent

server:

port: 8123

servlet:

context-path: /api # 此时项目的访问路径为localhost:8123/api

# springdoc-openapi 接口文档配置

springdoc:

swagger-ui:

path: /swagger-ui.html

tags-sorter: alpha

operations-sorter: alpha

api-docs:

path: /v3/api-docs

group-configs:

- group: 'default'

paths-to-match: '/**'

packages-to-scan: com.yuanyu.aiagent.controller # 改为项目中Controller包的位置

# knife4j 的增强配置,不需要增强可以不配

knife4j:

enable: true

setting:

language: zh_cn

|

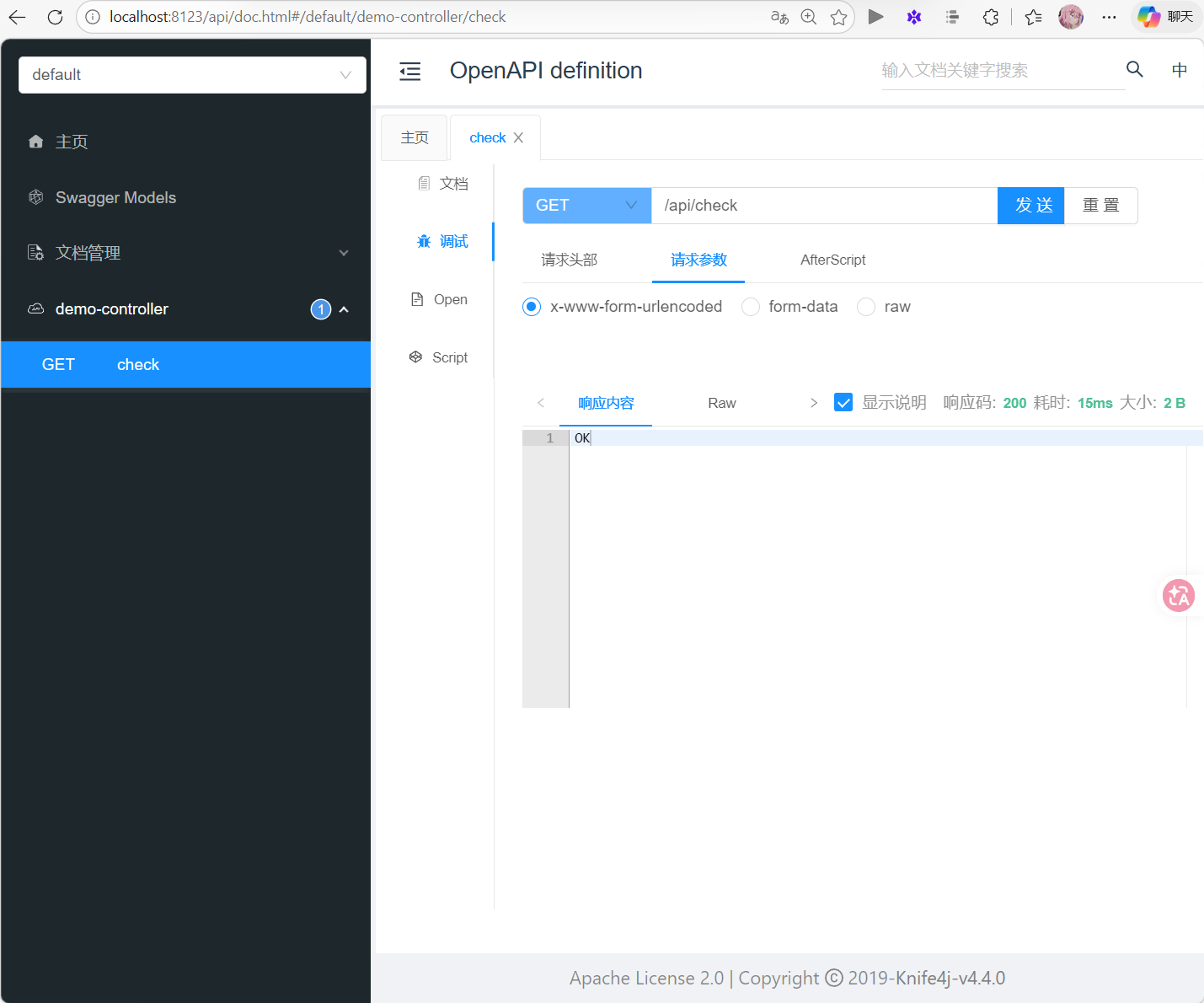

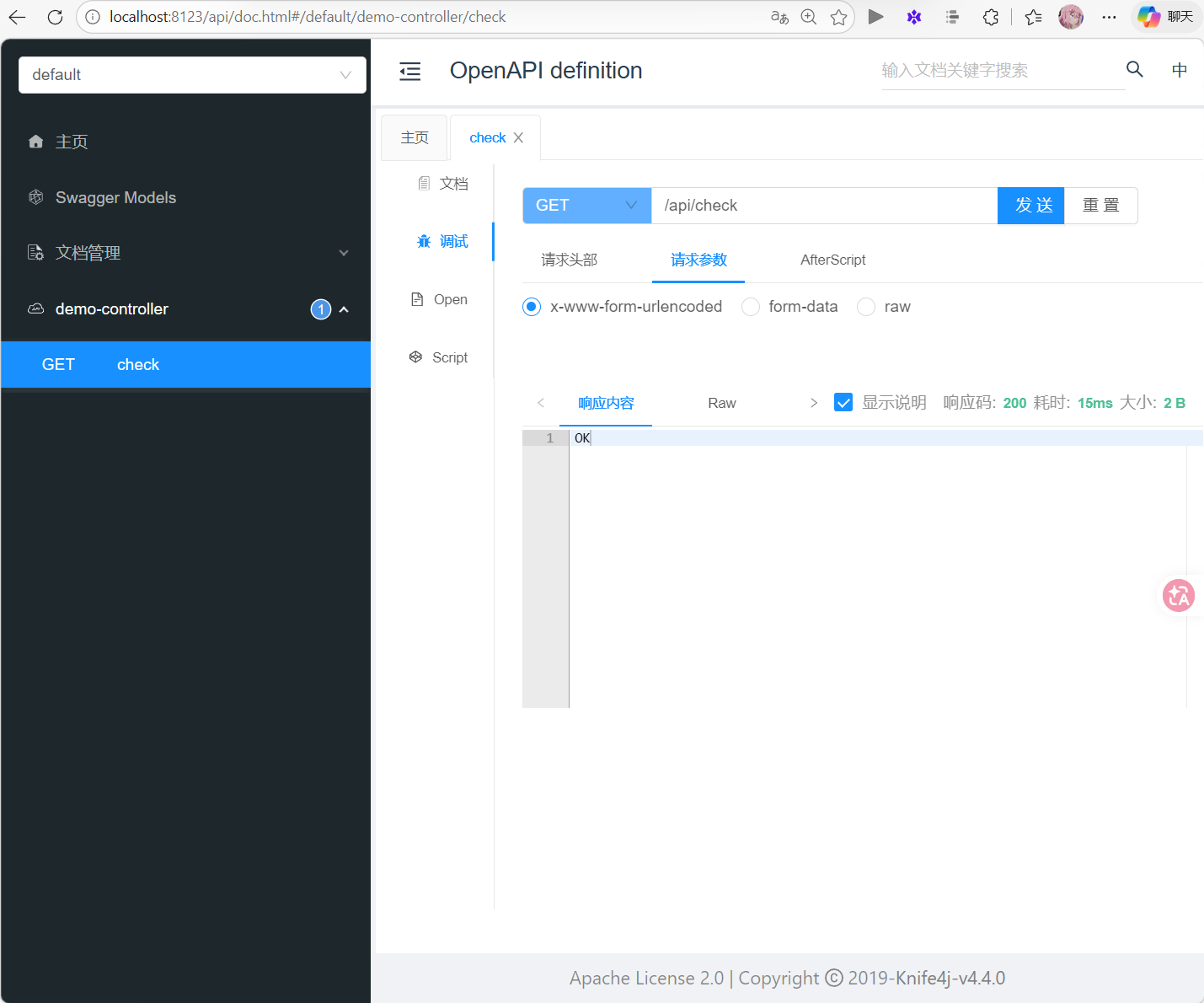

可以在com.yuanyu.aiagent.controller创建一个类测试看看:

1

2

3

4

5

6

7

8

9

10

11

12

13

|

package com.yuanyu.aiagent.controller;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class DemoController {

@GetMapping("/check")

public String check() {

return "OK";

}

}

|

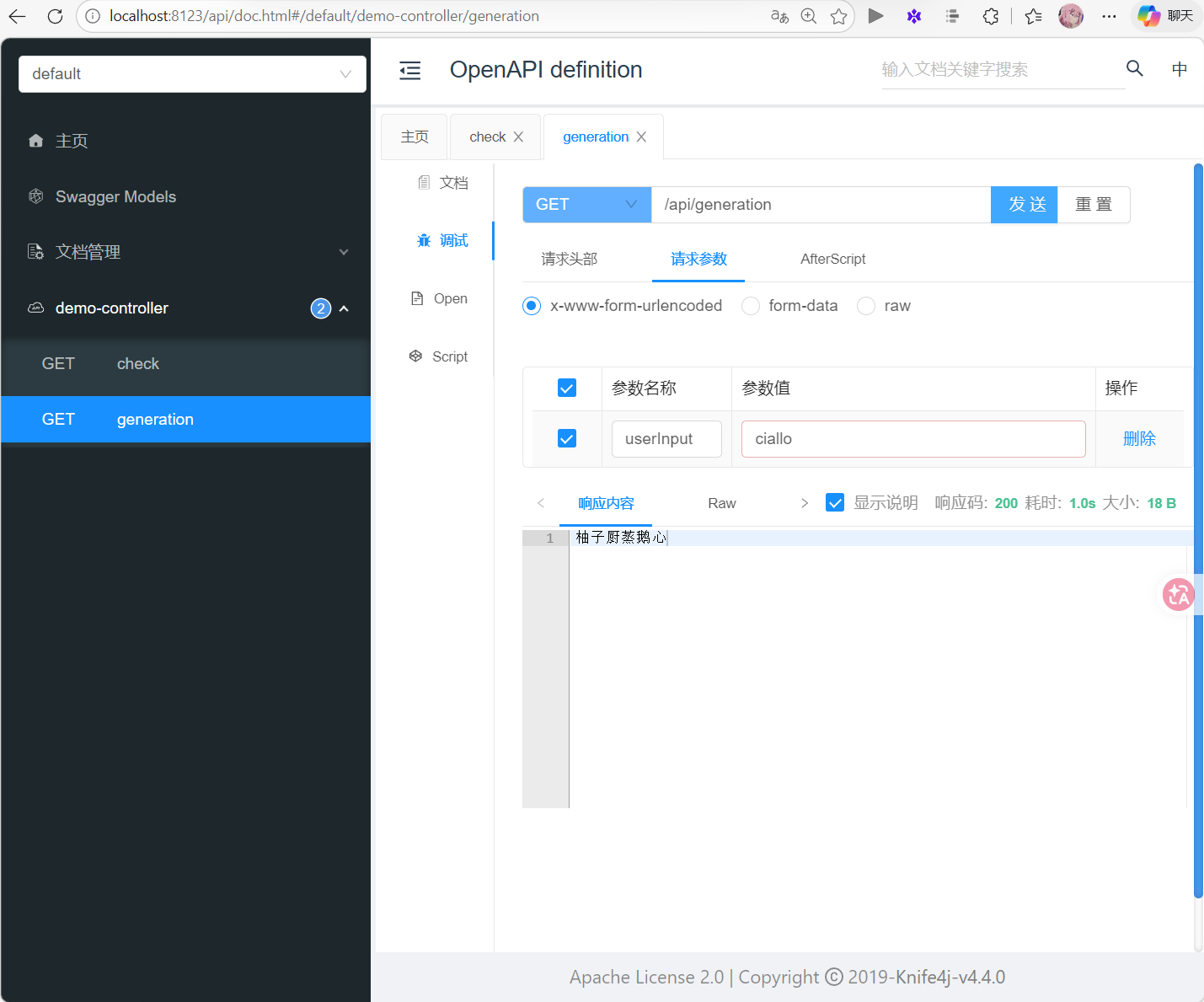

现在可以启动项目,在浏览器访问http://localhost:8123/api/doc.html来查看和测试项目的接口

确认可以正常访问

调用模型

SDK调用

以阿里云百炼为例,首先下载阿里提供的SDK包,官方文档:大模型服务平台百炼

1

2

3

4

5

6

|

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>dashscope-sdk-java</artifactId>

<!-- 请将 'the-latest-version' 替换为最新版本号:https://mvnrepository.com/artifact/com.alibaba/dashscope-sdk-java -->

<version>the-latest-version</version>

</dependency>

|

导入依赖后,使用阿里提供的测试代码,地址:大模型服务平台百炼

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

|

package com.yuanyu.aiagent.demo.invoke;// 建议dashscope SDK的版本 >= 2.12.0

import java.util.Arrays;

import java.lang.System;

import com.alibaba.dashscope.aigc.generation.Generation;

import com.alibaba.dashscope.aigc.generation.GenerationParam;

import com.alibaba.dashscope.aigc.generation.GenerationResult;

import com.alibaba.dashscope.common.Message;

import com.alibaba.dashscope.common.Role;

import com.alibaba.dashscope.exception.ApiException;

import com.alibaba.dashscope.exception.InputRequiredException;

import com.alibaba.dashscope.exception.NoApiKeyException;

import com.alibaba.dashscope.utils.JsonUtils;

/**

* 阿里云AI SDK调用

*/

public class SDKAiInvoke {

public static GenerationResult callWithMessage() throws ApiException, NoApiKeyException, InputRequiredException {

Generation gen = new Generation();

Message systemMsg = Message.builder()

.role(Role.SYSTEM.getValue())

.content("You are a helpful assistant.")

.build();

Message userMsg = Message.builder()

.role(Role.USER.getValue())

.content("你是谁?")

.build();

GenerationParam param = GenerationParam.builder()

// 若没有配置环境变量,请用百炼API Key将下行替换为:.apiKey("sk-xxx")

.apiKey(System.getenv("DASHSCOPE_API_KEY"))

// 此处以qwen-plus为例,可按需更换模型名称。模型列表:https://help.aliyun.com/zh/model-studio/getting-started/models

.model("qwen-plus")

.messages(Arrays.asList(systemMsg, userMsg))

.resultFormat(GenerationParam.ResultFormat.MESSAGE)

.build();

return gen.call(param);

}

public static void main(String[] args) {

try {

GenerationResult result = callWithMessage();

System.out.println(JsonUtils.toJson(result));

} catch (ApiException | NoApiKeyException | InputRequiredException e) {

// 使用日志框架记录异常信息

System.err.println("An error occurred while calling the generation service: " + e.getMessage());

}

System.exit(0);

}

}

|

获取API Key的位置:大模型服务平台百炼

运行结果:

1

|

{"requestId":"b9af6846-fc2a-4ae5-9593-1003a7f15340","usage":{"input_tokens":22,"output_tokens":66,"total_tokens":88,"prompt_tokens_details":{"cached_tokens":0}},"output":{"choices":[{"finish_reason":"stop","message":{"role":"assistant","content":"你好!我是通义千问(Qwen),阿里巴巴集团旗下的超大规模语言模型。我能够回答问题、创作文字,比如写故事、写公文、写邮件、写剧本、逻辑推理、编程等等,还能表达观点,玩游戏等。如果你有任何问题或需要帮助,欢迎随时告诉我!😊"}}]},"status_code":200,"code":"","message":""}

|

HTTP调用

阿里提供了curl的调用方式:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

|

curl --location "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation" \

--header "Authorization: Bearer $DASHSCOPE_API_KEY" \

--header "Content-Type: application/json" \

--data '{

"model": "qwen-plus",

"input":{

"messages":[

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "你是谁?"

}

]

},

"parameters": {

"result_format": "message"

}

}'

|

有了这段示例,就可以改写为通过Java的HTTP请求的方式进行调用。

hutool工具包有封装发送HTTP请求的功能,可以使用其来发送请求。

可以通过AI大模型来改写,参考提示词:改写为java中只使用hutool工具包发送HTTP请求的方式

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

|

package com.yuanyu.aiagent.demo.invoke;

import cn.hutool.http.ContentType;

import cn.hutool.http.Header;

import cn.hutool.http.HttpRequest;

import cn.hutool.http.HttpResponse;

import cn.hutool.json.JSONArray;

import cn.hutool.json.JSONObject;

/**

* 使用纯 Hutool 工具包调用阿里云通义千问 API

* 仅依赖:hutool-all

*/

public class HttpAiInvoke {

// 替换为你的 DashScope API Key

private static final String DASHSCOPE_API_KEY = System.getenv("DASHSCOPE_API_KEY");

private static final String API_URL = "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation";

public static void main(String[] args) {

try {

// 1. 构建请求体 JSON(使用 Hutool 自带的 JSON 工具)

JSONObject requestBody = buildRequestBody();

// 2. 发送 POST 请求

String response = sendPostRequest(API_URL, requestBody.toString());

// 3. 处理响应结果

System.out.println("API 响应结果:");

System.out.println(response);

} catch (Exception e) {

System.err.println("请求失败:" + e.getMessage());

e.printStackTrace();

}

}

/**

* 构建请求体 JSON 结构(仅使用 Hutool 的 JSON 类)

*/

private static JSONObject buildRequestBody() {

// 外层对象

JSONObject requestBody = new JSONObject();

requestBody.put("model", "qwen-plus");

// input 部分

JSONObject input = new JSONObject();

// messages 数组(使用 Hutool 的 JSONArray)

JSONArray messages = new JSONArray();

// system 消息

JSONObject systemMsg = new JSONObject();

systemMsg.put("role", "system");

systemMsg.put("content", "You are a helpful assistant.");

messages.add(systemMsg);

// user 消息

JSONObject userMsg = new JSONObject();

userMsg.put("role", "user");

userMsg.put("content", "你是谁?");

messages.add(userMsg);

input.put("messages", messages);

requestBody.put("input", input);

// parameters 部分

JSONObject parameters = new JSONObject();

parameters.put("result_format", "message");

requestBody.put("parameters", parameters);

return requestBody;

}

/**

* 使用 Hutool 发送 POST 请求

* @param url 请求地址

* @param jsonBody 请求体 JSON 字符串

* @return 响应结果字符串

*/

private static String sendPostRequest(String url, String jsonBody) {

// 构建 HTTP POST 请求(try-with-resources 自动关闭响应)

try (HttpResponse response = HttpRequest.post(url)

// 设置认证头(和原 curl 一致)

.header(Header.AUTHORIZATION, "Bearer " + DASHSCOPE_API_KEY)

// 设置 Content-Type 为 JSON

.header(Header.CONTENT_TYPE, ContentType.JSON.getValue())

// 设置请求体

.body(jsonBody)

// 设置超时时间(10 秒,可调整)

.timeout(10000)

// 执行请求

.execute()) {

// 检查响应状态码

if (response.isOk()) {

return response.body();

} else {

throw new RuntimeException("请求失败,状态码:" + response.getStatus()

+ ",响应内容:" + response.body());

}

}

}

}

|

运行结果:

1

2

|

API 响应结果:

{"output":{"choices":[{"message":{"content":"你好!我是通义千问(Qwen),阿里巴巴集团旗下的超大规模语言模型。我能够回答问题、创作文字,比如写故事、写公文、写邮件、写剧本、逻辑推理、编程等等,还能表达观点,玩游戏等。如果你有任何问题或需要帮助,欢迎随时告诉我!😊","role":"assistant"},"finish_reason":"stop"}]},"usage":{"total_tokens":88,"output_tokens":66,"input_tokens":22,"prompt_tokens_details":{"cached_tokens":0}},"request_id":"25ce80db-45aa-41f3-9bdc-4412eeda7626"}

|

SpringAI调用

SpringAI对国内大模型的支持比较一般,调用国内大模型可能会在某些地方出点问题(即使兼容OpenAI协议),所以如果使用的大模型是阿里的,可以使用Spring AI Alibaba,兼容性会更好,也保留了SpringAI原有功能。

导入依赖:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

<dependencies>

<!-- Spring AI Alibaba Agent Framework -->

<dependency>

<groupId>com.alibaba.cloud.ai</groupId>

<artifactId>spring-ai-alibaba-agent-framework</artifactId>

<version>1.1.2.0</version>

</dependency>

<!-- DashScope ChatModel 支持(如果使用其他模型,请跳转 Spring AI 文档选择对应的 starter) -->

<dependency>

<groupId>com.alibaba.cloud.ai</groupId>

<artifactId>spring-ai-alibaba-starter-dashscope</artifactId>

<version>1.1.2.0</version>

</dependency>

</dependencies>

|

在配置文件中设置使用的模型:

1

2

3

4

5

6

7

|

spring:

ai:

dashscope:

api-key: ${DASHSCOPE_API_KEY}

chat:

options:

model: qwen-max

|

进行调用测试:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

|

package com.yuanyu.aiagent.demo.invoke;

import lombok.RequiredArgsConstructor;

import org.springframework.ai.chat.messages.AssistantMessage;

import org.springframework.ai.chat.model.ChatModel;

import org.springframework.ai.chat.prompt.Prompt;

import org.springframework.boot.CommandLineRunner;

import org.springframework.stereotype.Component;

/**

* Spring AI 调用

*/

@Component

@RequiredArgsConstructor

public class SpringAiAiInvoke implements CommandLineRunner {

// 声明的变量名最好是dashscopeChatModel

private final ChatModel dashscopeChatModel;

// 项目运行时自动调用

@Override

public void run(String... args) throws Exception {

AssistantMessage assistantMessage = dashscopeChatModel.call(new Prompt("Ciallo~(∠・ω< )⌒☆"))

.getResult() // 获取结果

.getOutput();// 获取输出

System.out.println(assistantMessage.getText());

}

}

|

运行结果:

1

|

嘿!看起来你用了一种很可爱的方式来打招呼呢!(づ。◕‿‿◕。)づ 如果有什么我可以帮助你的,或者你想聊些什么有趣的事情,尽管告诉我哦~

|

LangChain4j调用

使用阿里的模型可以参考langchain4j官方文档:DashScope (Qwen) | LangChain4j — DashScope (Qwen) | LangChain4j

依赖最新版本可以在Maven中央仓库查询:Maven Repository: dev.langchain4j » langchain4j-community-dashscope

引入依赖:

1

2

3

4

5

|

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-dashscope</artifactId>

<version>${latest version here}</version>

</dependency>

|

因为前面已经引入Spring AI Alibaba的Spring Boot Starter了,为了防止冲突就不引入langchain4j的Spring Boot Starter了

创建一个类进行测试:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

|

package com.yuanyu.aiagent.demo.invoke;

import dev.langchain4j.community.model.dashscope.QwenChatModel;

import dev.langchain4j.model.chat.ChatModel;

public class LangChainAiInvoke {

public static void main(String[] args) {

ChatModel qwenModel = QwenChatModel.builder()

.apiKey(System.getenv("DASHSCOPE_API_KEY"))

.modelName("qwen-max")

.build();

String result = qwenModel.chat("Ciallo~(∠・ω< )⌒☆");

System.out.println(result);

}

}

|

运行结果:

1

|

你好!看起来你使用了一种非常可爱的方式来打招呼呢!~(∠・ω< )⌒☆ 这个表情让人感觉很温馨。有什么我可以帮到你的吗?或者,你想聊些什么有趣的事情呢?

|

提示词优化

学习提示词优化文档

使用现成提示词库

基础提示技巧

明确指定任务和角色

为 AI 提供清晰的任务描述和角色定位,帮助模型理解背景和期望。

1

2

|

系统:你是一位经验丰富的Python教师,擅长向初学者解释编程概念。

用户:请解释 Python 中的列表推导式,包括基本语法和 2-3 个实用示例。

|

提供详细说明和具体示例

提供足够的上下文信息和期望的输出格式示例,减少模型的不确定性。

1

2

3

4

5

6

7

8

9

10

|

请提供一个社交媒体营销计划,针对一款新上市的智能手表。计划应包含:

1. 目标受众描述

2. 三个内容主题

3. 每个平台的内容类型建议

4. 发布频率建议

示例格式:

目标受众: [描述]

内容主题: [主题1], [主题2], [主题3]

平台策略: [平台] - [内容类型] - [频率]

|

使用结构化格式引导思维

通过列表、表格等结构化格式,使指令更易理解,输出更有条理。

1

2

3

4

5

6

7

8

9

|

分析以下公司的优势和劣势:

公司: Tesla

请使用表格格式回答,包含以下列:

- 优势(最少3项)

- 每项优势的简要分析

- 劣势(最少3项)

- 每项劣势的简要分析

- 应对建议

|

明确输出格式要求

指定输出的格式、长度、风格等要求,获得更符合预期的结果。

1

2

3

4

5

|

撰写一篇关于气候变化的科普文章,要求:

- 使用通俗易懂的语言,适合高中生阅读

- 包含5个小标题,每个标题下2-3段文字

- 总字数控制在800字左右

- 结尾提供3个可行的个人行动建议

|

进阶提示技巧

思维链提示法(Chain-of-Thought)

引导模型展示推理过程,逐步思考问题,提高复杂问题的准确性。

1

2

3

4

5

6

7

|

问题:一个商店售卖T恤,每件15元。如果购买5件以上可以享受8折优惠。小明买了7件T恤,他需要支付多少钱?

请一步步思考解决这个问题:

1. 首先计算7件T恤的原价

2. 确定是否符合折扣条件

3. 如果符合,计算折扣后的价格

4. 得出最终支付金额

|

少样本学习(Few-Shot Learning)

通过提供几个输入 - 输出对的示例,帮助模型理解任务模式和期望输出。

1

2

3

4

5

6

7

8

9

10

|

我将给你一些情感分析的例子,然后请你按照同样的方式分析新句子的情感倾向。

输入: "这家餐厅的服务太差了,等了一个小时才上菜"

输出: 负面,因为描述了长时间等待和差评服务

输入: "新买的手机屏幕清晰,电池也很耐用"

输出: 正面,因为赞扬了产品的多个方面

现在分析这个句子:

"这本书内容还行,但是价格有点贵"

|

分步骤指导(Step-by-Step)

将复杂任务分解为可管理的步骤,确保模型完成每个关键环节。

1

2

3

4

5

6

7

|

请帮我创建一个简单的网站落地页设计方案,按照以下步骤:

步骤1: 分析目标受众(考虑年龄、职业、需求等因素)

步骤2: 确定页面核心信息(主标题、副标题、价值主张)

步骤3: 设计页面结构(至少包含哪些区块)

步骤4: 制定视觉引导策略(颜色、图像建议)

步骤5: 设计行动召唤(CTA)按钮和文案

|

自我评估和修正

让模型评估自己的输出并进行改进,提高准确性和质量。

1

2

3

4

5

6

7

8

|

解决以下概率问题:

从一副标准扑克牌中随机抽取两张牌,求抽到至少一张红桃的概率。

首先给出你的解答,然后:

1. 检查你的推理过程是否存在逻辑错误

2. 验证你使用的概率公式是否正确

3. 检查计算步骤是否有误

4. 如果发现任何问题,提供修正后的解答

|

知识检索和引用

引导模型检索相关信息并明确引用信息来源,提高可靠性。

1

2

3

4

5

6

7

|

请解释光合作用的过程及其在植物生长中的作用。在回答中:

1. 提供光合作用的科学定义

2. 解释主要的化学反应

3. 描述影响光合作用效率的关键因素

4. 说明其对生态系统的重要性

对于任何可能需要具体数据或研究支持的陈述,请明确指出这些信息的来源,并说明这些信息的可靠性。

|

多视角分析

引导模型从不同角度、立场或专业视角分析问题,提供全面见解。

1

2

3

4

5

6

7

8

9

10

11

12

|

分析"城市应该禁止私家车进入市中心"这一提议:

请从以下4个不同角度分析:

1. 环保专家视角

2. 经济学家视角

3. 市中心商户视角

4. 通勤居民视角

对每个视角:

- 提供支持该提议的2个论点

- 提供反对该提议的2个论点

- 分析可能的折中方案

|

多模态思维

结合不同表达形式进行思考,如文字描述、图表结构、代码逻辑等。

1

2

3

4

5

6

7

8

|

设计一个智能家居系统的基础架构:

1. 首先用文字描述系统的主要功能和组件

2. 然后创建一个系统架构图(用ASCII或文本形式表示)

3. 接着提供用户交互流程

4. 最后简述实现这个系统可能面临的技术挑战

尝试从不同角度思考:功能性、用户体验、技术实现、安全性等。

|

提示词调试与优化

迭代式提示优化

通过逐步修改和完善提示词,提高输出质量。

1

2

3

4

5

6

7

8

9

10

11

|

初始提示: 谈谈人工智能的影响。

[收到笼统回答后]

改进提示: 分析人工智能对医疗行业的三大积极影响和两大潜在风险,提供具体应用案例。

[如果回答仍然不够具体]

进一步改进: 详细分析AI在医学影像诊断领域的具体应用,包括:

1. 现有的2-3个成功商业化AI诊断系统及其准确率

2. 这些系统如何辅助放射科医生工作

3. 实施过程中遇到的主要挑战

4. 未来3-5年可能的技术发展方向

|

边界测试

通过极限情况测试模型的能力边界,找出优化空间。

1

2

3

4

5

6

7

|

尝试解决以下具有挑战性的数学问题:

证明在三角形中,三条高的交点、三条中线的交点和三条角平分线的交点在同一条直线上。

如果你发现难以直接证明:

1. 说明你遇到的具体困难

2. 考虑是否有更简单的方法或特例可以探讨

3. 提供一个思路框架,即使无法给出完整证明

|

提示词模板化

创建结构化模板,便于针对类似任务进行一致性提示,否则每次输出的内容可能会有比较大的区别,不利于调试。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

【专家角色】: {领域}专家

【任务描述】: {任务详细说明}

【所需内容】:

- {要点1}

- {要点2}

- {要点3}

【输出格式】: {格式要求}

【语言风格】: {风格要求}

【限制条件】: {字数、时间或其他限制}

例如:

【专家角色】: 营养学专家

【任务描述】: 为一位想减重的上班族设计一周健康饮食计划

【所需内容】:

- 七天的三餐安排

- 每餐的大致卡路里

- 准备建议和购物清单

【输出格式】: 按日分段,每餐列出具体食物

【语言风格】: 专业但友好

【限制条件】: 考虑准备时间短,预算有限

|

错误分析与修正

系统性分析模型回答中的错误,并针对性优化提示词,这一点在我们使用 Cursor 等 AI 开发工具生成代码时非常有用。

1

2

3

4

5

6

7

8

9

10

|

我发现之前请你生成的Python代码存在以下问题:

1. 没有正确处理文件不存在的情况

2. 数据处理逻辑中存在边界条件错误

3. 代码注释不够详细

请重新生成代码,特别注意:

1. 添加完整的异常处理

2. 测试并确保所有边界条件

3. 为每个主要函数和复杂逻辑添加详细注释

4. 遵循PEP 8编码规范

|

多轮对话实现

ChatClient

前面的ChatModel用法比较基础,可定制的功能较少,所以SpringAI提供了ChatClient来支持更多定制功能:Chat Client API

我只是列举部分内容,建议还是看看官方文档更好

Spring AI 提供了多种构建 ChatClient 的方式,比如自动注入、手动构造:

自动注入

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

package com.yuanyu.aiagent.controller;

import lombok.RequiredArgsConstructor;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class DemoController {

private final ChatClient chatClient;

public DemoController(ChatClient.Builder chatClientBuilder) {

this.chatClient = chatClientBuilder.build();

}

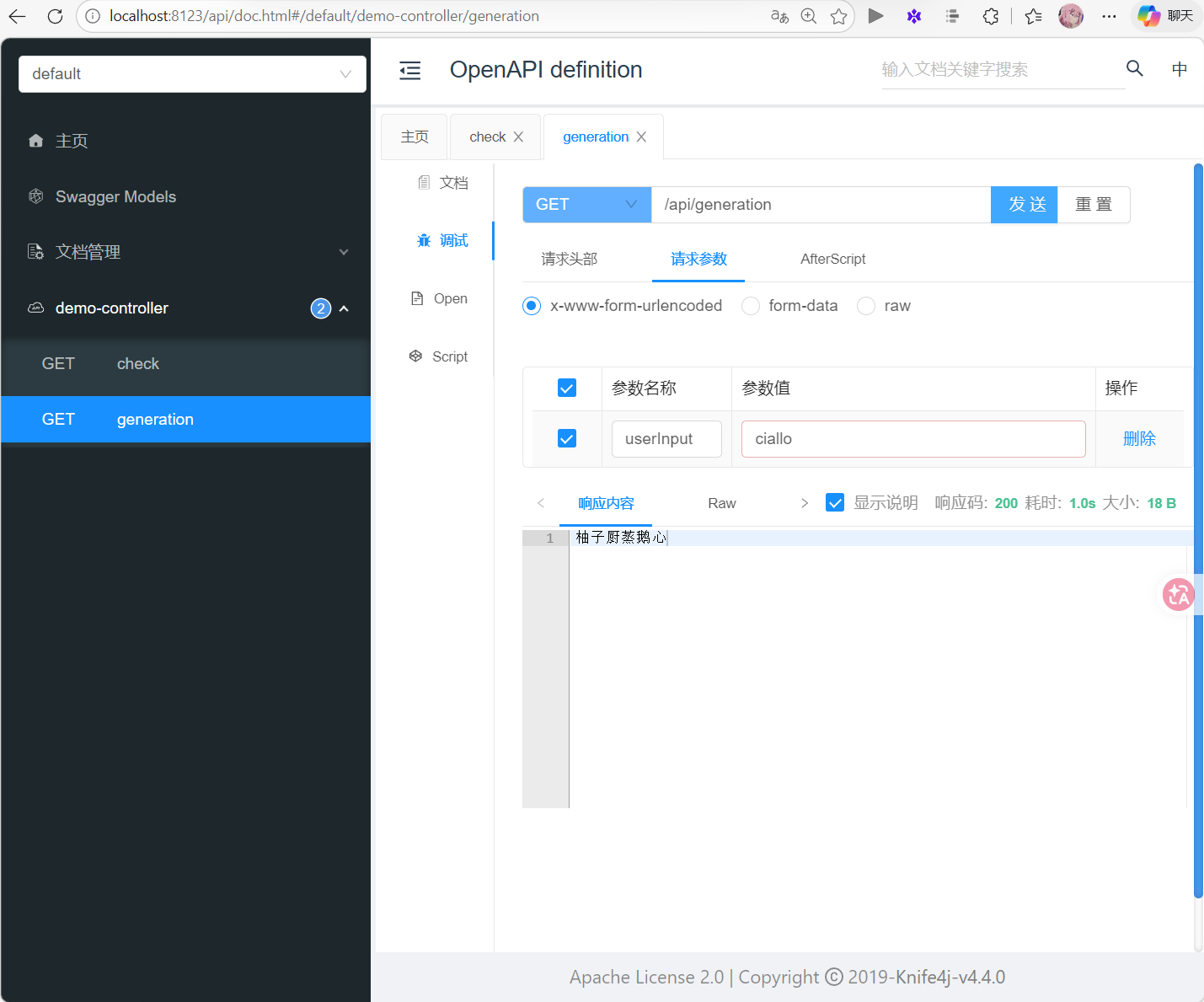

@GetMapping("/generation")

String generation(String userInput) {

return this.chatClient.prompt()

.system("用户说Ciallo时请回复‘柚子厨蒸鹅心’")

.user(userInput)

.call()

.content();

}

}

|

测试:

不过使用这种方式时,由于构造器注入的是ChatClient.Builder而不是ChatClient,所以无法使用@RequiredArgsConstructor注解自动注入。

手动构造

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

|

package com.yuanyu.aiagent.demo.invoke;

import lombok.RequiredArgsConstructor;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.ai.chat.messages.AssistantMessage;

import org.springframework.ai.chat.model.ChatModel;

import org.springframework.ai.chat.prompt.Prompt;

import org.springframework.boot.CommandLineRunner;

import org.springframework.stereotype.Component;

/**

* Spring AI 调用

*/

@Component

@RequiredArgsConstructor

public class SpringAiAiInvoke implements CommandLineRunner {

private final ChatModel dashscopeChatModel;

// 项目运行时自动调用

@Override

public void run(String... args) throws Exception {

// 手动指定使用哪个模型

ChatClient chatClient = ChatClient.builder(dashscopeChatModel)

.defaultSystem("用户说Ciallo时回复‘柚子厨蒸鹅心’")

.build();

String content = chatClient.prompt()

.user("Ciallo~(∠・ω< )⌒☆")

.call()

.content();

System.out.println(content);

}

}

|

多模型注入

前面的手动构造既然都手动指定模型了,那肯定支持选择不同模型注入,就是选哪个模型的事

1

2

3

4

5

6

7

8

9

|

private final ChatModel model1;

private final ChatModel model2;

if (……) {

ChatClient chatClient = ChatClient.builder(model1).build();

} else {

ChatClient chatClient = ChatClient.builder(model1).build();

}

|

自动注入其实也能支持多模型

在使用多个 AI 模型时,可以为每个模型定义单独的 ChatClient bean:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

@Configuration

public class ChatClientConfig {

// 在配置类中分别定义

@Bean

public ChatClient openAiChatClient(OpenAiChatModel chatModel) {

return ChatClient.create(chatModel);

}

@Bean

public ChatClient anthropicChatClient(AnthropicChatModel chatModel) {

return ChatClient.create(chatModel);

}

}

|

然后可以使用 @Qualifier 注解将这些 bean 注入到应用程序组件中:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

|

@Configuration

public class ChatClientExample {

@Bean

CommandLineRunner cli(

@Qualifier("openAiChatClient") ChatClient openAiChatClient,

@Qualifier("anthropicChatClient") ChatClient anthropicChatClient) {

return args -> {

var scanner = new Scanner(System.in);

ChatClient chat;

// Model selection

System.out.println("\nSelect your AI model:");

System.out.println("1. OpenAI");

System.out.println("2. Anthropic");

System.out.print("Enter your choice (1 or 2): ");

String choice = scanner.nextLine().trim();

if (choice.equals("1")) {

chat = openAiChatClient;

System.out.println("Using OpenAI model");

} else {

chat = anthropicChatClient;

System.out.println("Using Anthropic model");

}

// Use the selected chat client

System.out.print("\nEnter your question: ");

String input = scanner.nextLine();

String response = chat.prompt(input).call().content();

System.out.println("ASSISTANT: " + response);

scanner.close();

};

}

}

|

如果ChatClient声明的变量名与配置类中bean的名字相同的话,也可以使用@RequiredArgsConstructor注解自动注入,而不使用@Qualifier 注解

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

|

package com.yuanyu.ai.controller;

@RestController

@RequestMapping("/ai")

@RequiredArgsConstructor

public class GameController {

// 此时会优先匹配名为openAiChatClient的bean

private final ChatClient openAiChatClient;

@RequestMapping(value = "/game", produces = "text/html;charset=UTF-8")

public Flux<String> chat(@RequestParam String prompt) {

return openAiChatClient.prompt()

.user(prompt)

.stream()

.content();

}

}

|

ChatResponse

ChatClient 还支持多种响应格式,比如返回 ChatResponse 对象、返回实体对象、流式返回:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

|

// 返回ChatResponse对象,ChatResponse对象包含了很多信息

ChatResponse chatResponse = chatClient.prompt()

.user("Tell me a joke")

.call()

.chatResponse();

// 返回实体对象

record ActorFilms(String actor, List<String> movies) {}

ActorFilms actorFilms = chatClient.prompt()

.user("Generate the filmography for a random actor.")

.call()

.entity(ActorFilms.class);

// 还有一个重载的 entity 方法,其签名为 entity(ParameterizedTypeReference<T> type) ,允许你指定诸如泛型列表等类型

List<ActorFilms> multipleActors = chatClient.prompt()

.user("Generate filmography for Tom Hanks and Bill Murray.")

.call()

.entity(new ParameterizedTypeReference<List<ActorFilms>>() {});

// stream() 方法可以让你异步获取响应,可以实现一个字一个字蹦出来的效果

Flux<String> streamResponse = chatClient.prompt()

.user("Tell me a story")

.stream()

.content();

// 也可以流式获取ChatResponse对象

Flux<ChatResponse> streamWithMetadata = chatClient.prompt()

.user("Tell me a story")

.stream()

.chatResponse();

|

提示模板

可以给 ChatClient 设置默认参数,比如系统提示词,还可以在对话时动态更改系统提示词的变量:

1

2

3

4

5

6

7

8

9

10

|

ChatClient chatClient = ChatClient.builder(chatModel)

.defaultSystem("你是一个{personality}的智能助手")

.build();

chatClient.prompt()

.system(sp -> sp.param("personality", "暴躁")) // 替换模板

.user(message)

.call()

.content());

|

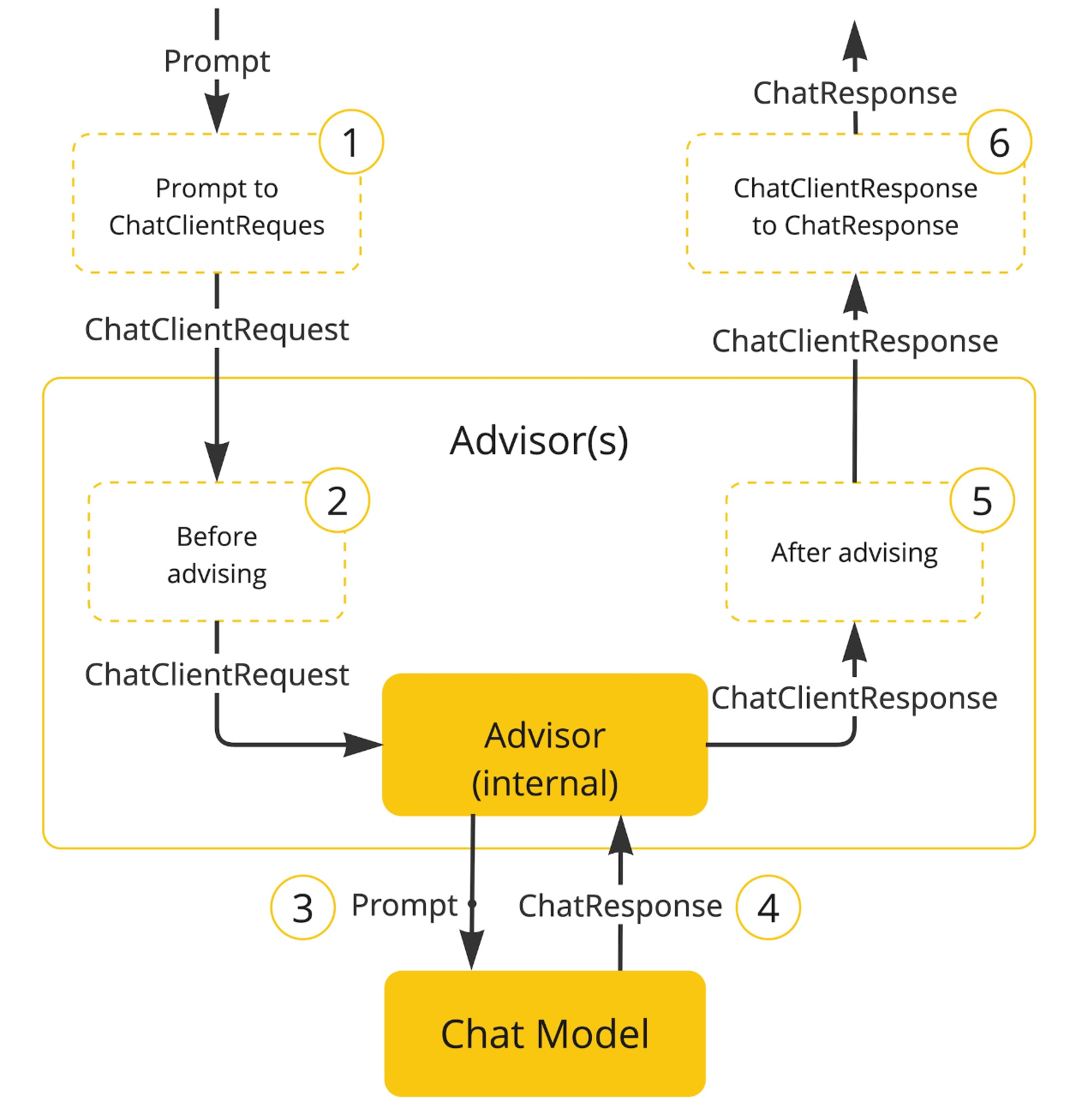

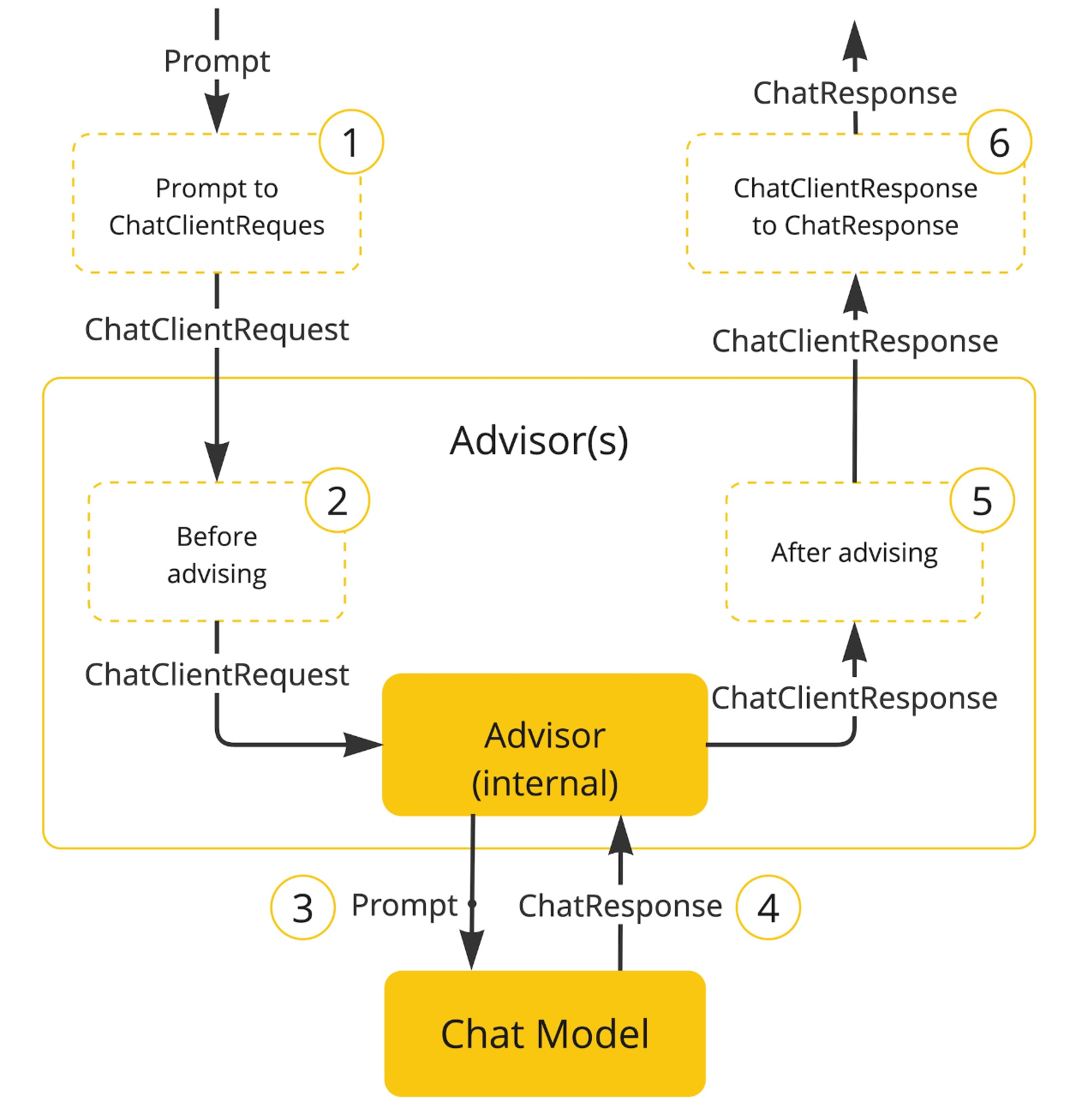

Advisors

Spring AI Advisors(顾问) API 提供了一种灵活且强大的方式,用于拦截、修改和增强 Spring 应用中的 AI 驱动交互。

通过利用Advisors API,开发者可以创建更复杂、可重用且易于维护的 AI 组件,可以理解为拦截器。

Advisors 可以在调用 AI 前和调用 AI 后可以执行一些额外的操作,比如:

- 前置增强:调用 AI 前改写一下 Prompt 提示词、检查一下提示词是否安全

- 后置增强:调用 AI 后记录一下日志、处理一下返回的结果

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

ChatClient chatClient = ChatClient.builder(chatModel)

.defaultAdvisors(

new MessageChatMemoryAdvisor(chatMemory), // 对话记忆

new QuestionAnswerAdvisor(vectorStore) // RAG检索增强

)

.build();

String response = this.chatClient.prompt()

.advisors(advisor ->

advisor.param("chat_memory_conversation_id", "001") // 设置对话的id,这样才能区分不同对话的记忆

.param("chat_memory_response_size", 100)) // 指定对话的长度

.user(userText)

.call()

.content();

|

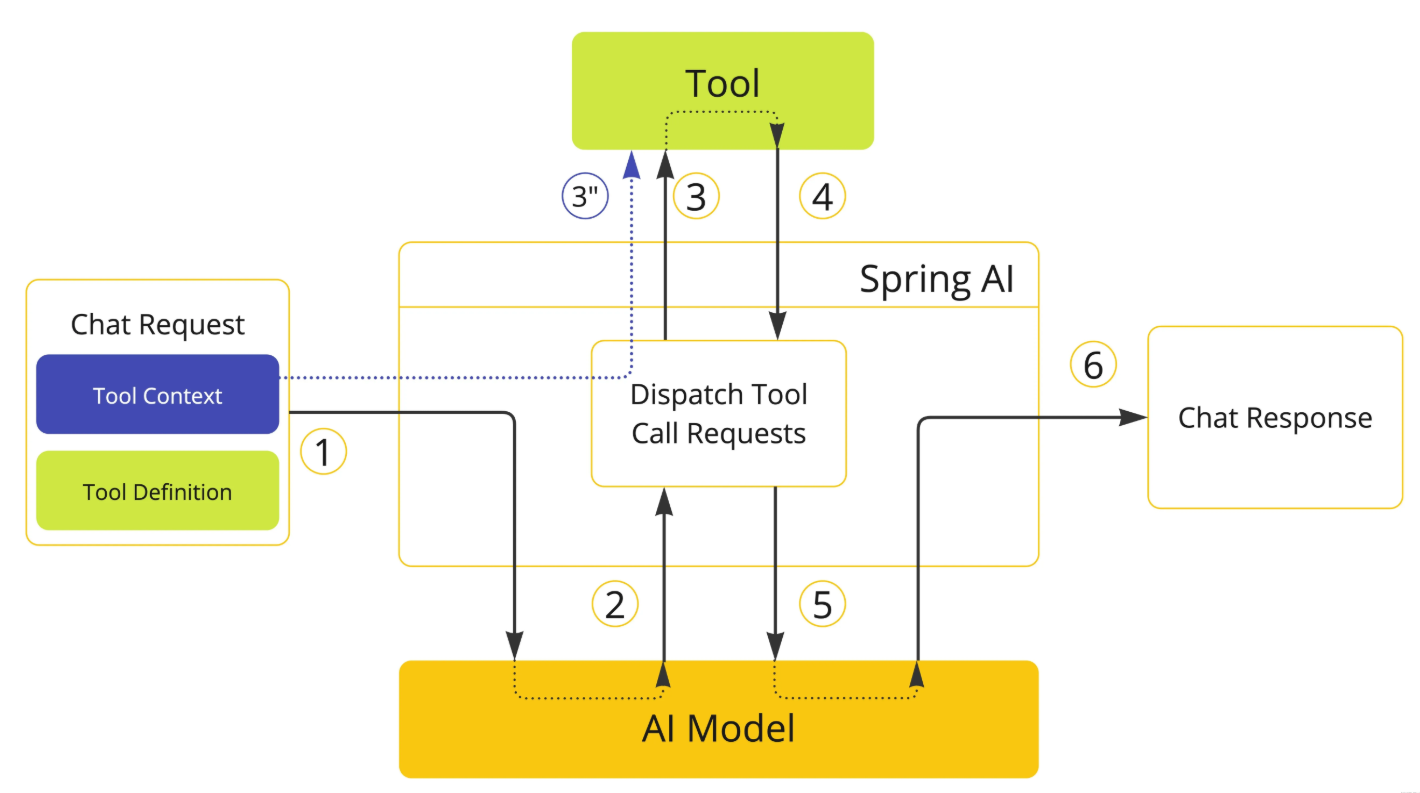

Advisors 的原理:

实际开发中,往往我们会用到多个拦截器,组合在一起相当于一条拦截器链条(责任链模式的设计思想)。每个拦截器是有顺序的,通过 getOrder() 方法获取到顺序,得到的值越低,越优先执行。

比如下面的代码中,如果单独按照代码顺序,可能我们会认为:将首先执行 MessageChatMemoryAdvisor,将对话历史记录添加到提示词中。然后,QuestionAnswerAdvisor 将根据用户的问题和添加的对话历史记录执行知识库检索,从而提供更相关的结果:

1

2

3

4

5

|

ChatClient chatClient = ChatClient.builder(chatModel)

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(chatMemory).build(),

QuestionAnswerAdvisor.builder(vectorStore).build())

.build();

|

但是实际上,Advisors的执行顺序是由 getOrder 方法决定的,不是简单地根据代码的编写顺序决定。

1

2

3

4

5

|

// 获取order

int order = MessageChatMemoryAdvisor.builder(chatMemory).build().getOrder();

// 设置order

MessageChatMemoryAdvisor.builder(chatMemory).order(0).build()

|

ChatMemoryAdvisor

想要实现对话记忆功能,可以使用 Spring AI 的 ChatMemoryAdvisor,它主要有几种内置的实现方式:

MessageChatMemoryAdvisor:从记忆中检索历史对话,并将其作为消息集合添加到提示词中PromptChatMemoryAdvisor:从记忆中检索历史对话,并将其添加到提示词的系统文本中VectorStoreChatMemoryAdvisor:可以用向量数据库来存储检索历史对话

MessageChatMemoryAdvisor 和 PromptChatMemoryAdvisor 用法类似,但是略有一些区别:

1)MessageChatMemoryAdvisor 将对话历史作为一系列独立的消息添加到提示中,保留原始对话的完整结构,包括每条消息的角色标识(用户、助手、系统)。

1

2

3

4

5

|

[

{"role": "user", "content": "你好"},

{"role": "assistant", "content": "你好!有什么我能帮助你的吗?"},

{"role": "user", "content": "讲个笑话"}

]

|

2)PromptChatMemoryAdvisor 将对话历史添加到提示词的系统文本部分,因此可能会失去原始的消息边界。

1

2

3

4

5

6

|

以下是之前的对话历史:

用户: 你好

助手: 你好!有什么我能帮助你的吗?

用户: 讲个笑话

现在请继续回答用户的问题。

|

一般建议使用 MessageChatMemoryAdvisor。

ChatMemory

ChatMemoryAdvisor 依赖 Chat Memory 进行构造。Chat Memory 负责历史对话的存储,定义了保存消息、查询消息、清空消息历史的方法。

Spring AI 内置了几种 Chat Memory,可以将对话保存到不同的数据源中,比如:

- InMemoryChatMemoryRepository:内存存储

- CassandraChatMemoryRepository:在 Cassandra 中带有过期时间的持久化存储

- Neo4jChatMemoryRepository:在 Neo4j 中没有过期时间限制的持久化存储

- JdbcChatMemoryRepository:在 JDBC 中没有过期时间限制的持久化存储

当然也可以通过实现 ChatMemory 接口自定义数据源的存储

多轮对话AI应用开发

在com.yuanyu.aiagent.app下创建LoveApp类

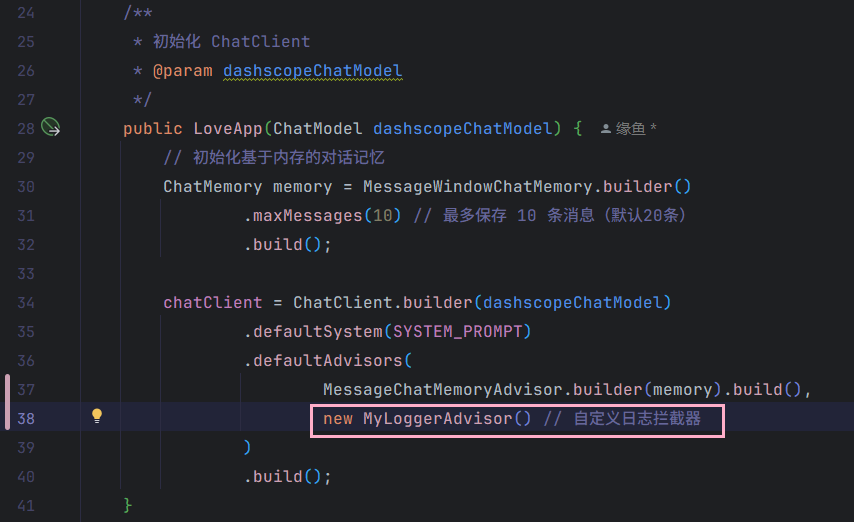

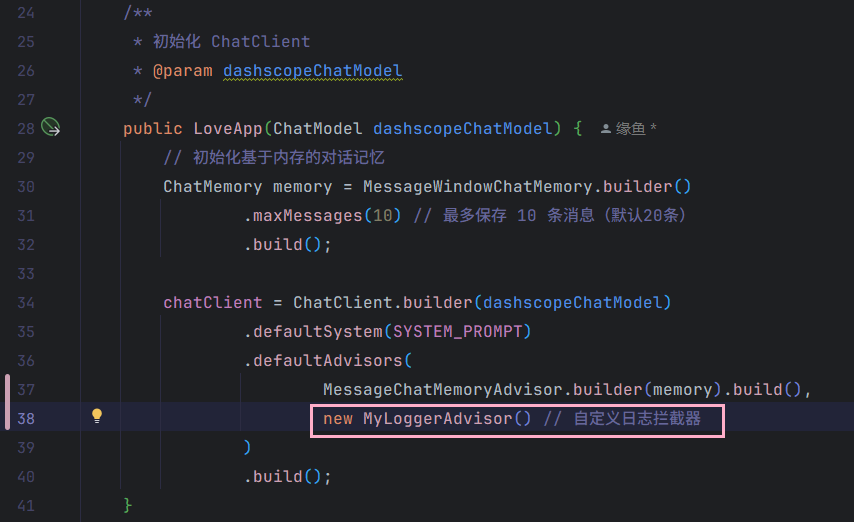

1)首先初始化 ChatClient 对象。使用 Spring 的构造器注入方式来注入阿里大模型 dashscopeChatModel 对象,并使用该对象来初始化 ChatClient。初始化时指定默认的系统 Prompt 和基于内存的对话记忆 Advisor。代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

|

package com.yuanyu.aiagent.app;

import lombok.extern.slf4j.Slf4j;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.ai.chat.client.advisor.MessageChatMemoryAdvisor;

import org.springframework.ai.chat.memory.ChatMemory;

import org.springframework.ai.chat.memory.MessageWindowChatMemory;

import org.springframework.ai.chat.model.ChatModel;

import org.springframework.ai.chat.model.ChatResponse;

import org.springframework.stereotype.Component;

@Component

@Slf4j

public class LoveApp {

private final ChatClient chatClient;

private static final String SYSTEM_PROMPT = "扮演深耕恋爱心理领域的专家。" +

"开场向用户表明身份,告知用户可倾诉恋爱难题。围绕单身、恋爱、已婚三种状态提问:" +

"单身状态询问社交圈拓展及追求心仪对象的困扰;恋爱状态询问沟通、习惯差异引发的矛盾;" +

"已婚状态询问家庭责任与亲属关系处理的问题。引导用户详述事情经过、对方反应及自身想法,以便给出专属解决方案。";

/**

* 初始化 ChatClient

* @param dashscopeChatModel

*/

public LoveApp(ChatModel dashscopeChatModel) {

// 初始化基于内存的对话记忆

ChatMemory memory = MessageWindowChatMemory.builder()

.maxMessages(10) // 最多保存 10 条消息(默认20条)

.build();

chatClient = ChatClient.builder(dashscopeChatModel)

.defaultSystem(SYSTEM_PROMPT)

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(memory).build()

)

.build();

}

}

|

2)在其中编写对话方法。调用 chatClient 对象,传入用户 Prompt,并且给 advisor 指定对话 id 和对话记忆大小。代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

/**

* AI 对话

* @param message

* @param chatId

* @return

*/

public String doChat(String message, String chatId) {

ChatResponse chatResponse = chatClient.prompt()

.user(message)

.advisors(spec -> spec.param(ChatMemory.CONVERSATION_ID, chatId))

.call()

.chatResponse();

String content = chatResponse.getResult().getOutput().getText();

log.info("content: {}", content);

return content;

}

|

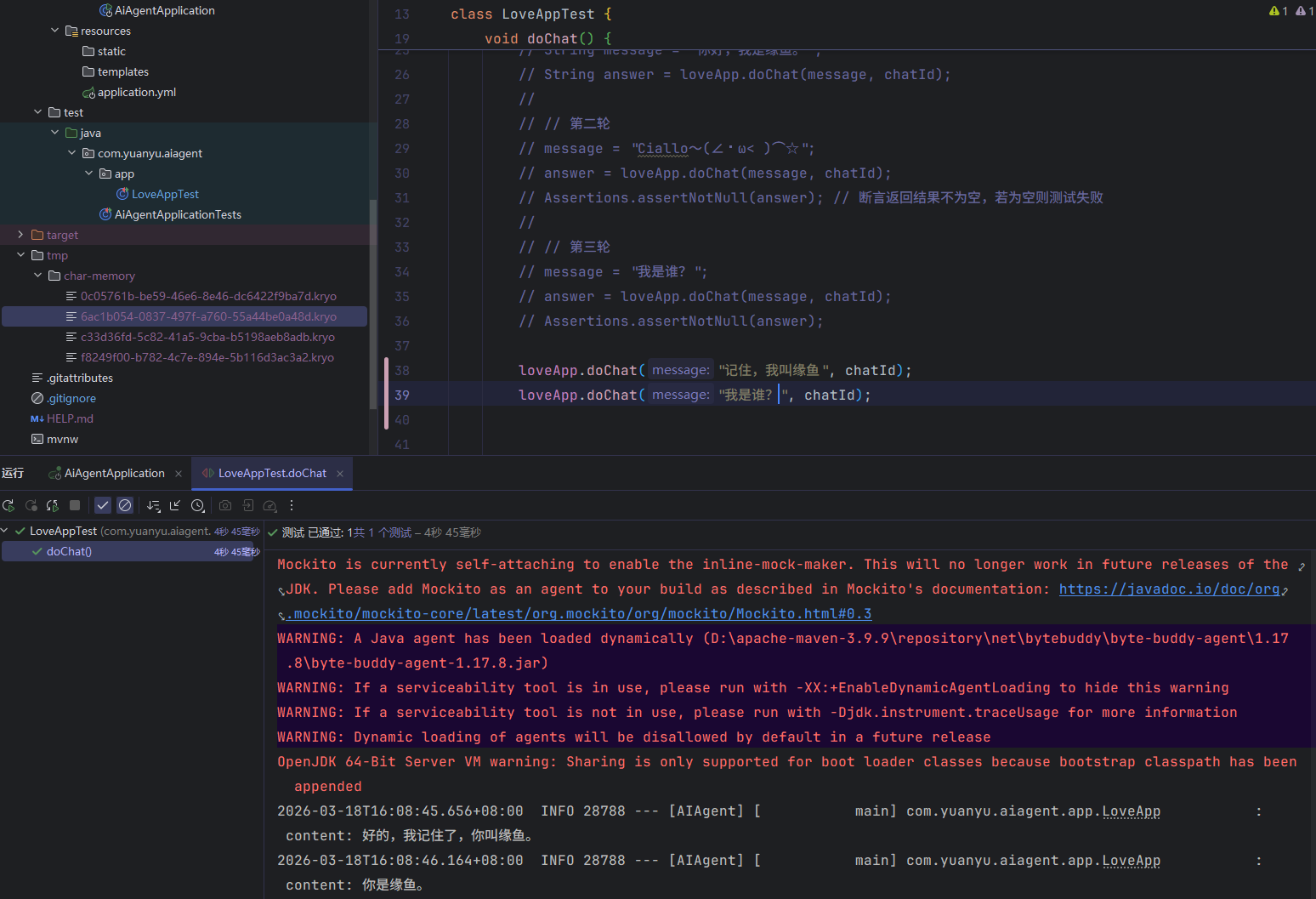

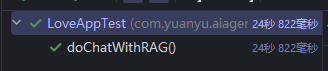

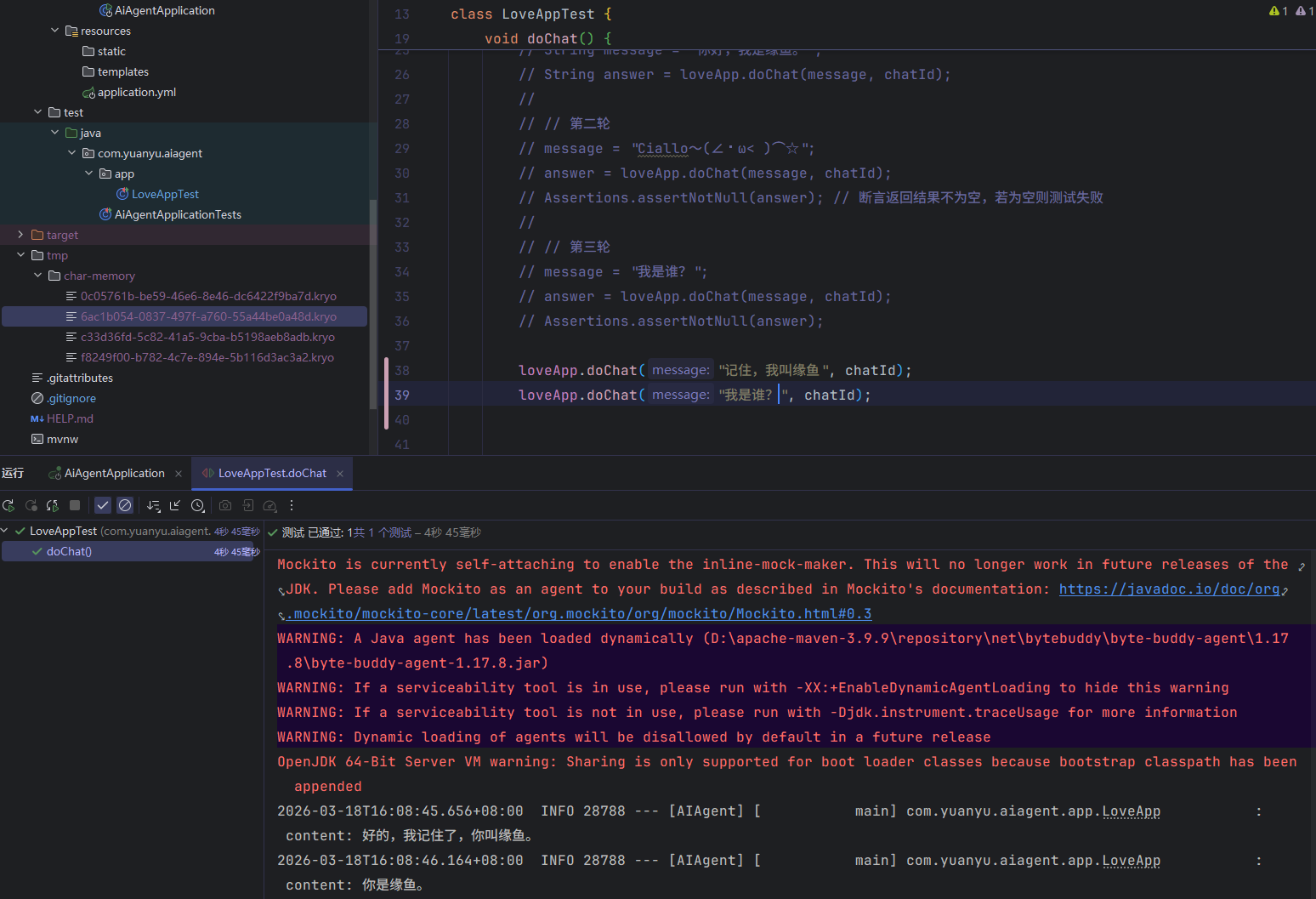

3)编写单元测试,测试多轮对话:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

|

package com.yuanyu.aiagent.app;

import jakarta.annotation.Resource;

import org.junit.jupiter.api.Assertions;

import org.junit.jupiter.api.Test;

import org.springframework.boot.test.context.SpringBootTest;

import java.util.UUID;

import static org.junit.jupiter.api.Assertions.*;

@SpringBootTest

class LoveAppTest {

@Resource

private LoveApp loveApp;

@Test

void doChat() {

// 随机生成一个会话 ID

String chatId = UUID.randomUUID().toString();

// 测试对话

// 第一轮

String message = "你好,我是缘鱼。";

String answer = loveApp.doChat(message, chatId);

// 第二轮

message = "Ciallo~(∠・ω< )⌒☆";

answer = loveApp.doChat(message, chatId);

Assertions.assertNotNull(answer); // 断言返回结果不为空,若为空则测试失败

// 第三轮

message = "我是谁?";

answer = loveApp.doChat(message, chatId);

Assertions.assertNotNull(answer);

}

}

|

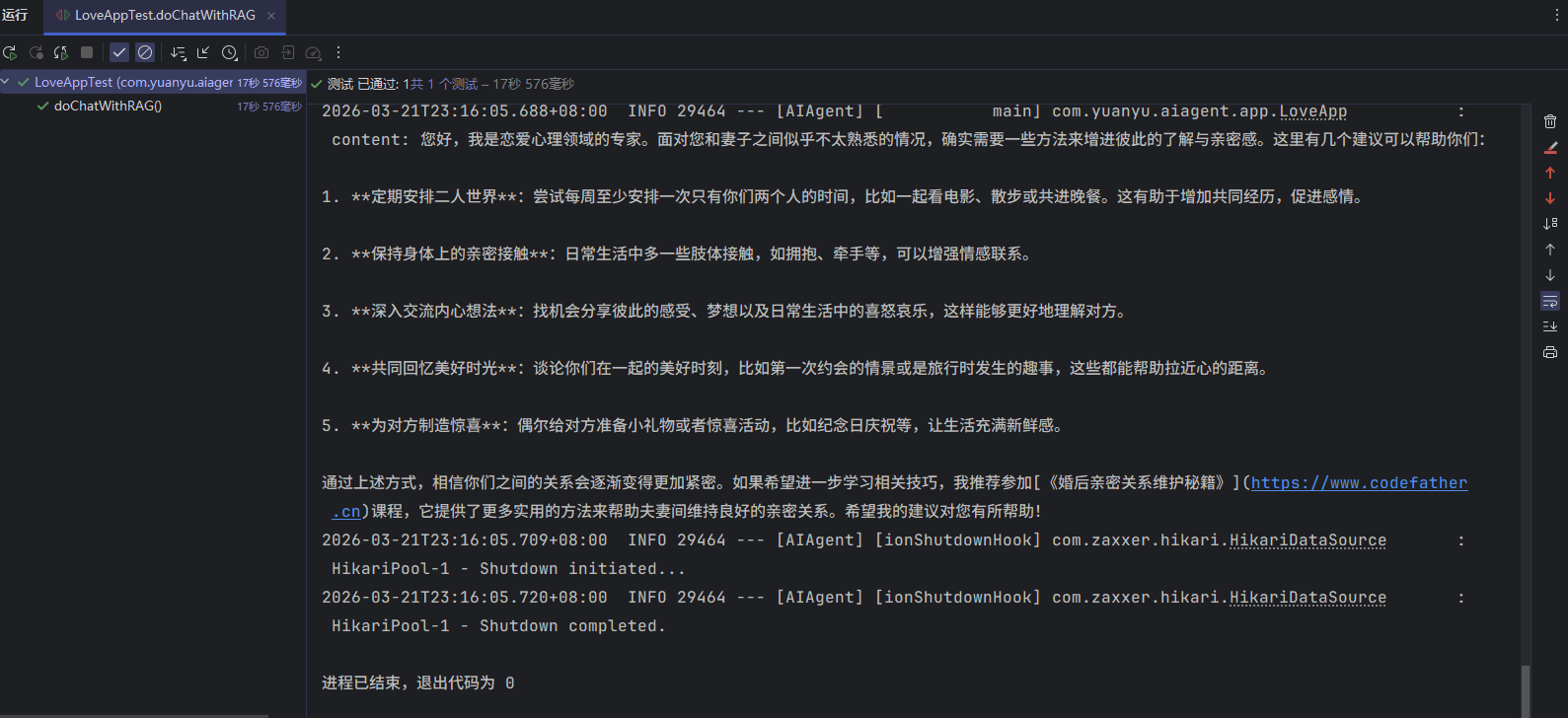

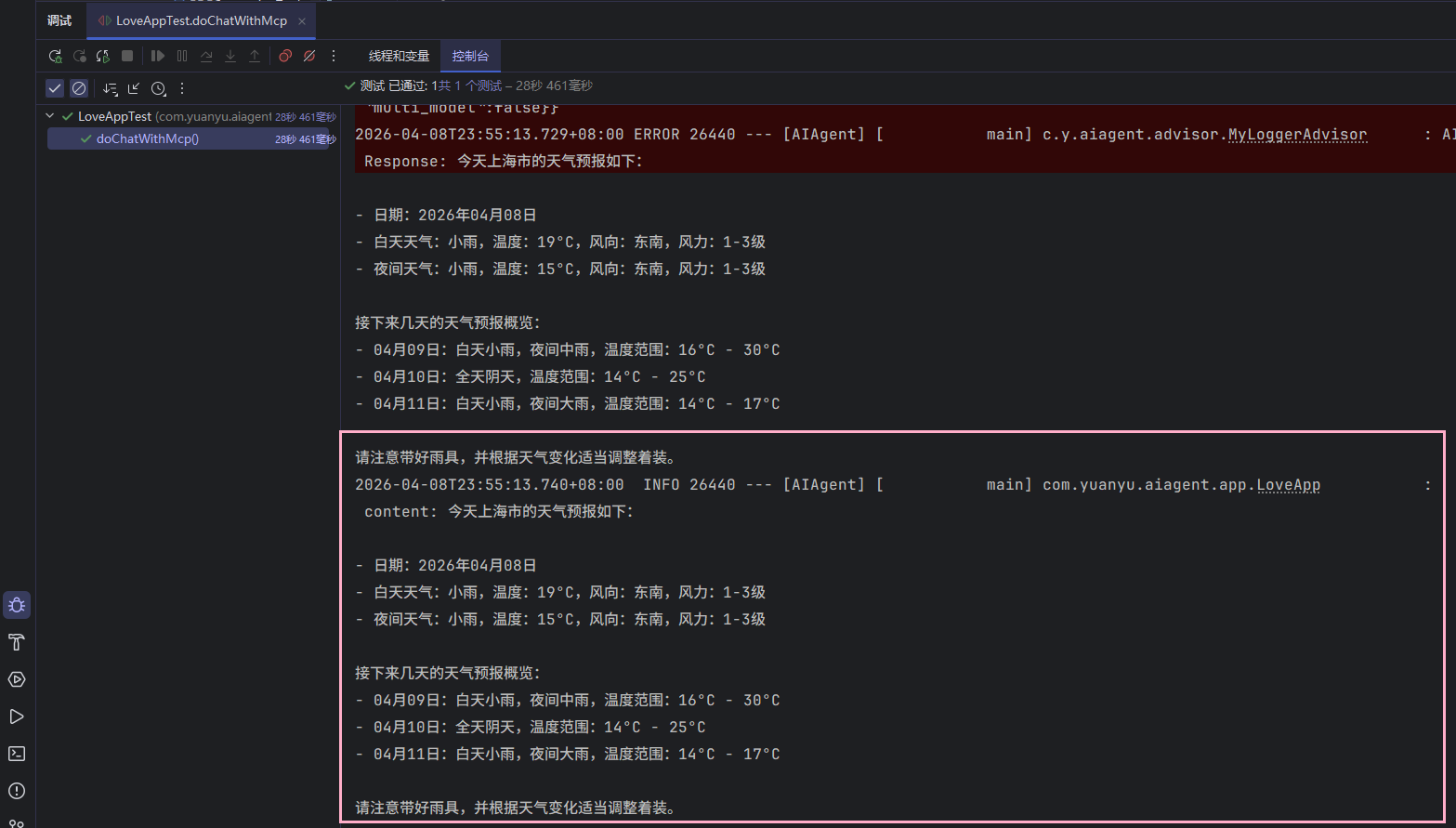

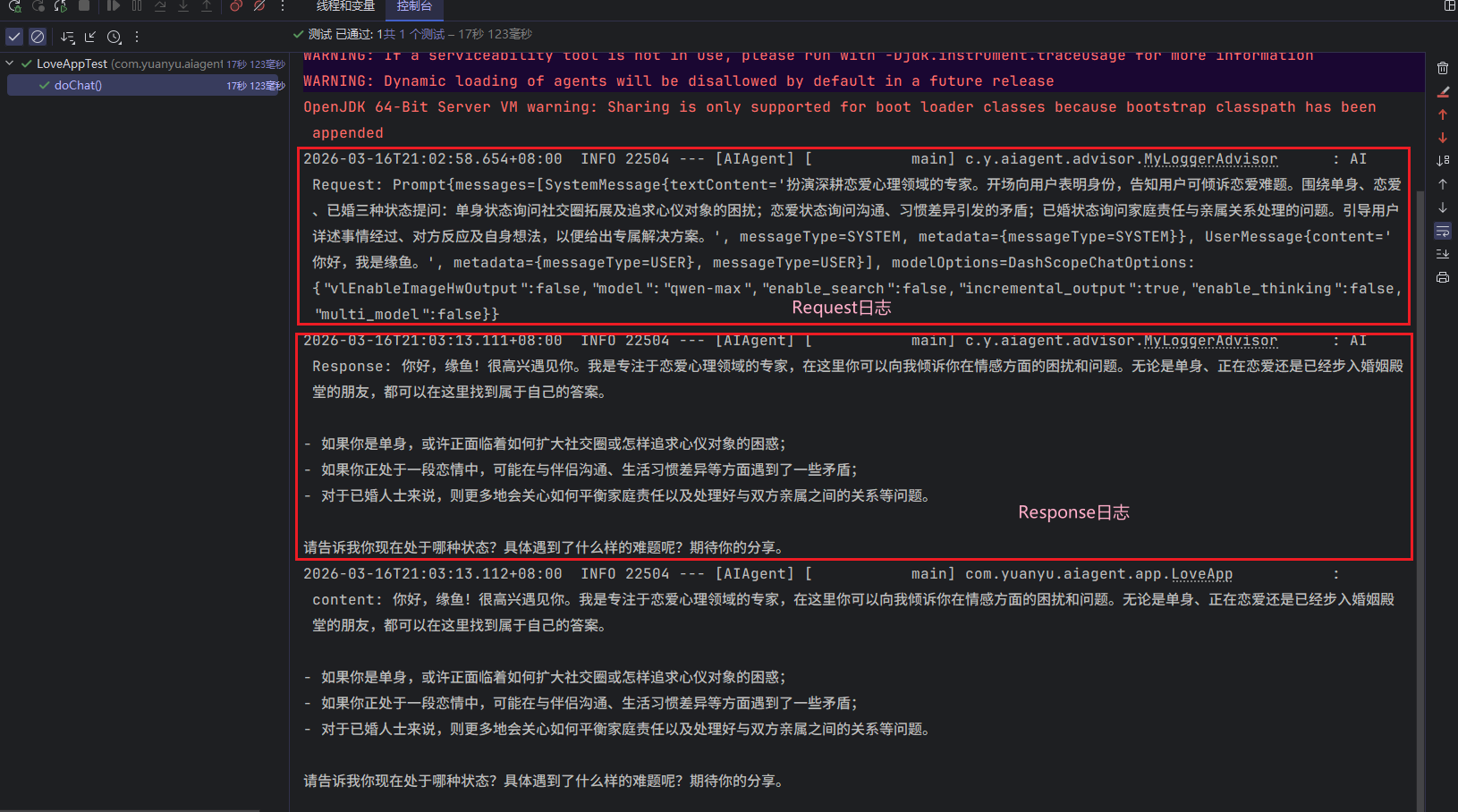

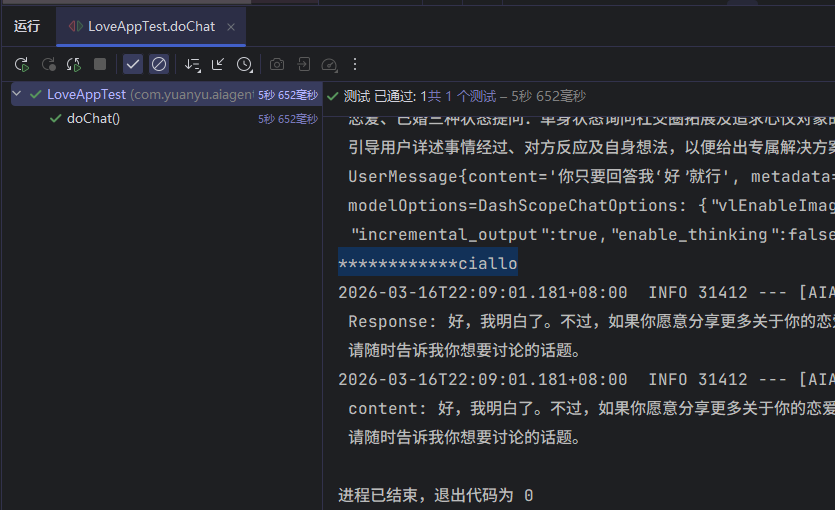

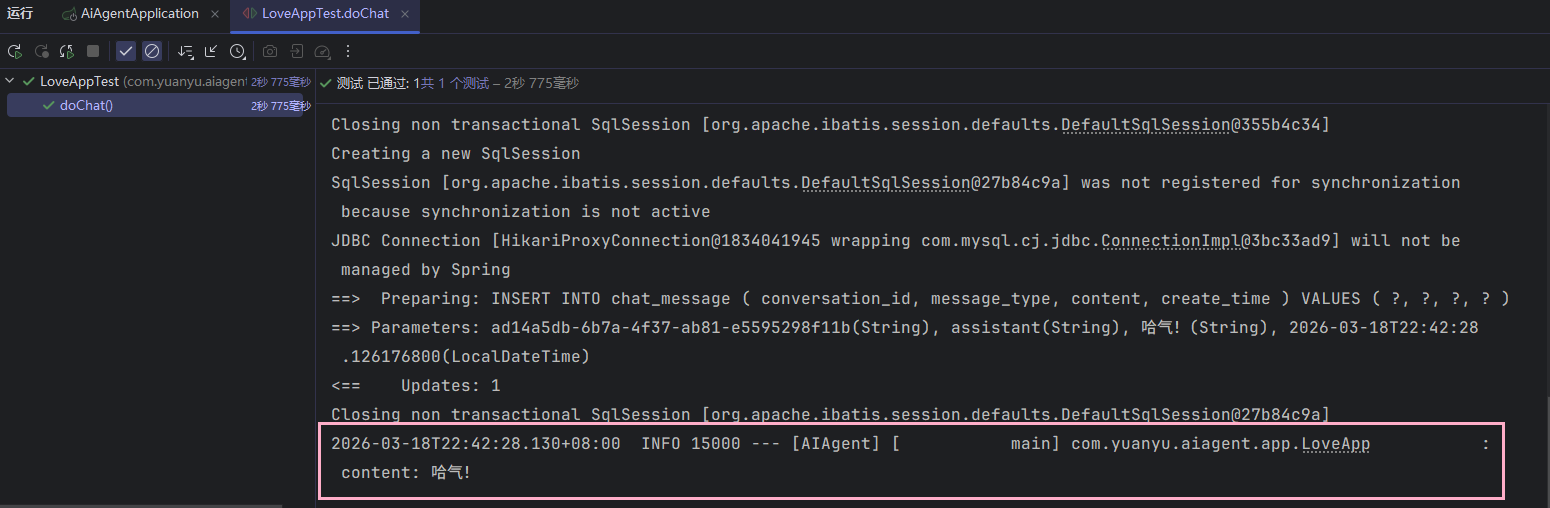

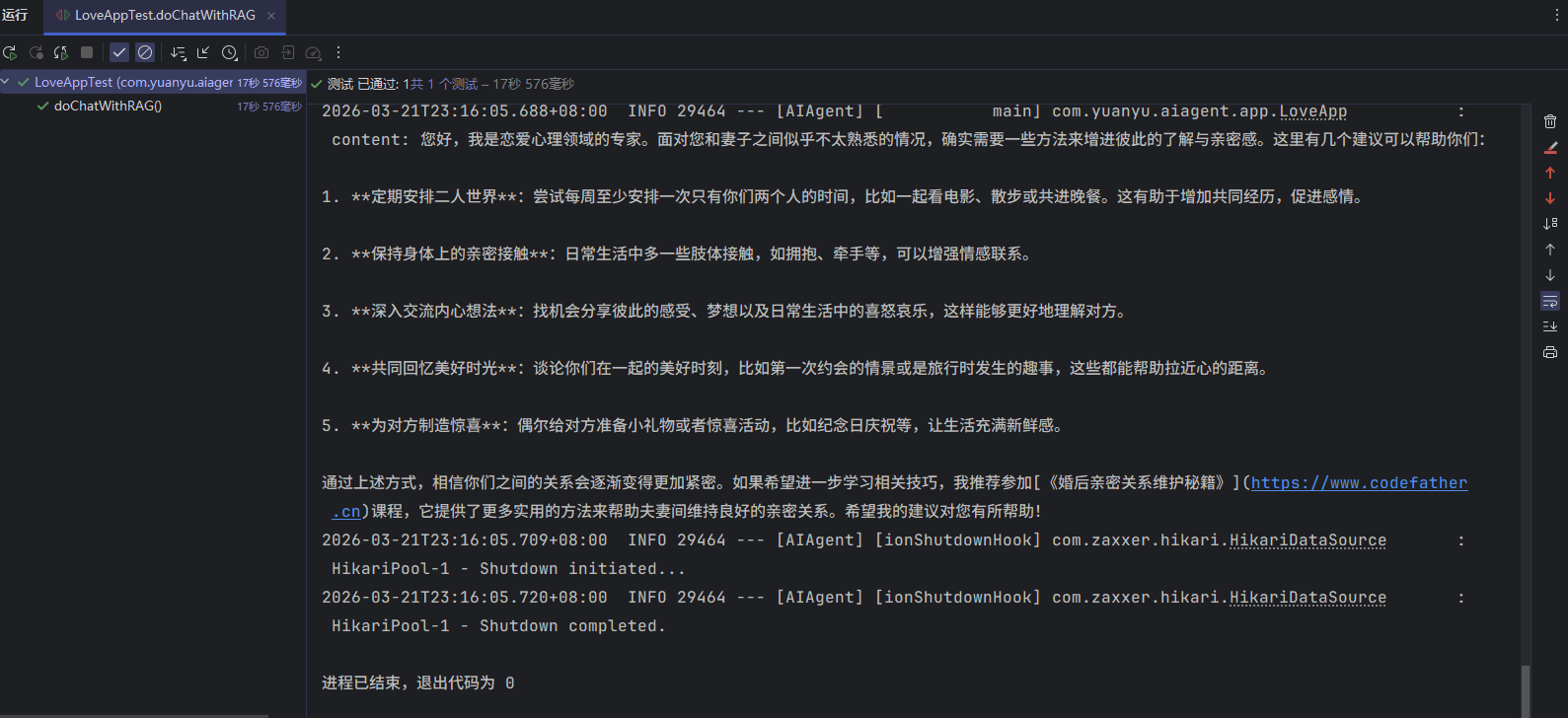

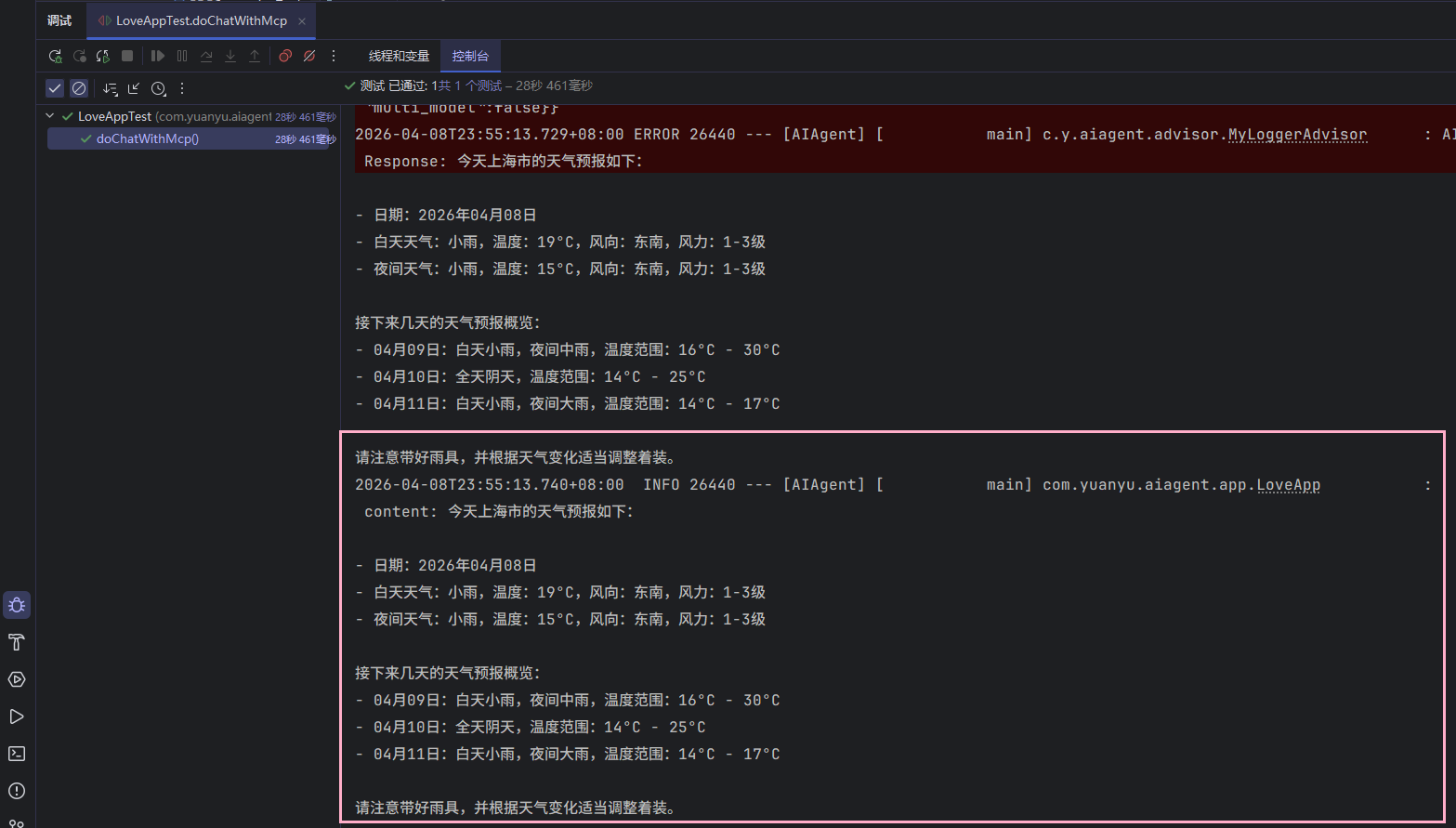

运行结果:

显然AI还记得前面的对话

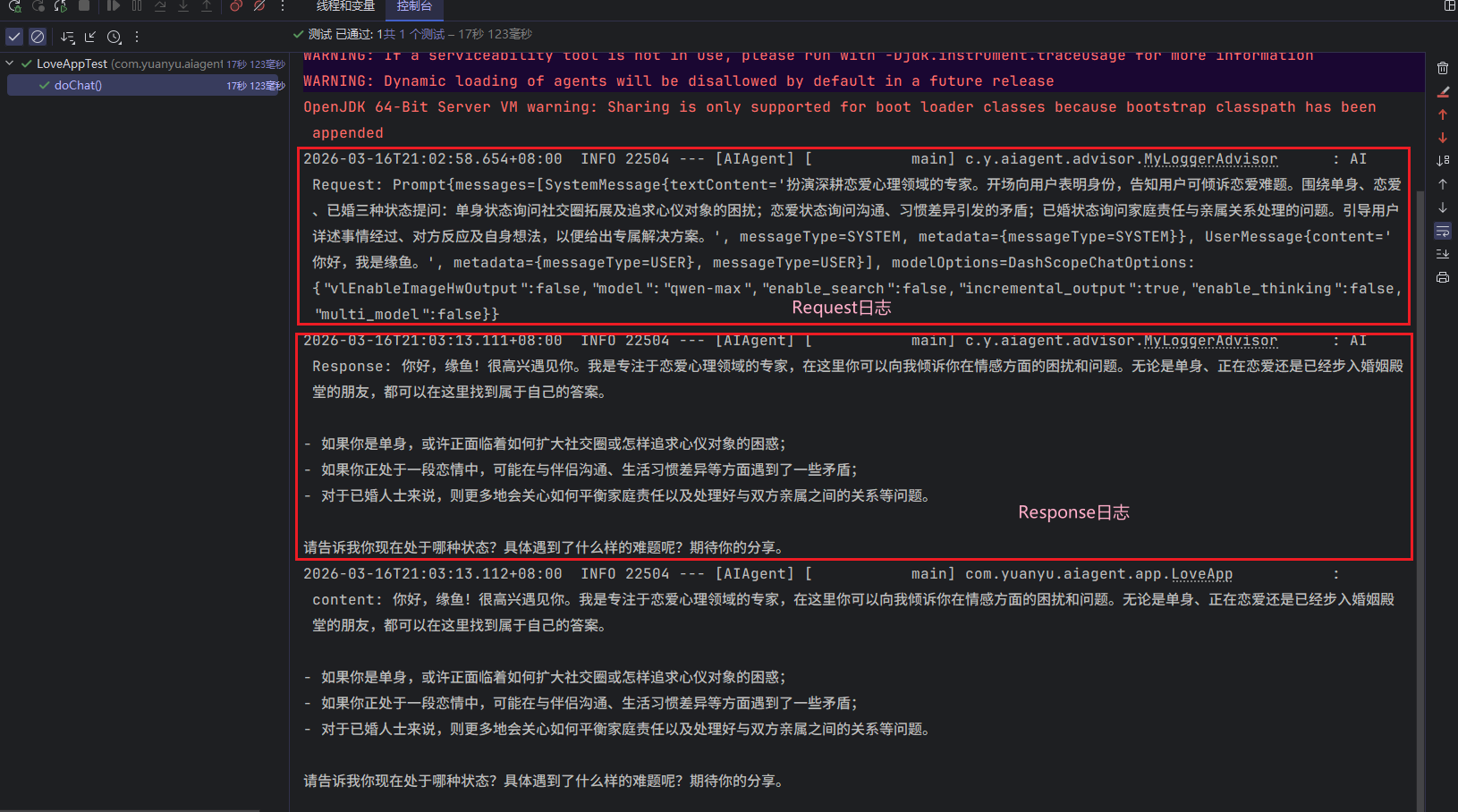

自定义Advisor

官方已经提供了一些 Advisor,但可能无法满足我们实际的业务需求,这时我们可以使用官方提供的 自定义 Advisor 功能。

自定义 Advisor 步骤

1)选择合适的接口实现,实现以下接口之一或同时实现两者(更建议同时实现):

CallAdvisor:用于处理同步请求和响应(非流式)StreamAdvisor:用于处理流式请求和响应

1

2

3

|

public class SimpleLoggerAdvisor implements CallAdvisor, StreamAdvisor {

// ...

}

|

2)实现核心方法

对于非流式处理 (CallAdvisor),需要实现 adviseCall、getName、getOrder 方法:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

|

@Override

public String getName() {

// 为每个 Advisor 提供一个唯一标识符(也可以直接定义一个字符串返回,比如return "CialloAdvisor";)

return this.getClass().getSimpleName();

}

@Override

public int getOrder() {

// 通过设置 order 值来控制执行顺序。数值越小,优先级越高。

return 0;

}

@Override

public ChatClientResponse adviseCall(ChatClientRequest chatClientRequest, CallAdvisorChain callAdvisorChain) {

// 前置处理请求(logRequest是自己定义的处理方法)

logRequest(chatClientRequest);

// 调用链中下一个Advisor

ChatClientResponse chatClientResponse = callAdvisorChain.nextCall(chatClientRequest);

// 后置处理响应

logResponse(chatClientResponse);

return chatClientResponse;

}

// 定义自己需要的处理

private void logRequest(ChatClientRequest request) {

logger.debug("request: {}", request);

}

private void logResponse(ChatClientResponse chatClientResponse) {

logger.debug("response: {}", chatClientResponse);

}

|

对于流式处理 (StreamAdvisor),实现 adviseStream、getName、getOrder方法:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

|

// getName、getOrder方法同上

@Override

public Flux<ChatClientResponse> adviseStream(ChatClientRequest chatClientRequest,

StreamAdvisorChain streamAdvisorChain) {

logRequest(chatClientRequest);

// 获取流式响应(多个chunk)

Flux<ChatClientResponse> chatClientResponses = streamAdvisorChain.nextStream(chatClientRequest);

// 聚合响应并在完成后记录日志:

// 聚合器会收集所有chunk,组装成完整的响应

// 调用logResponse记录完整的响应日志(自定义方法)

// 同时保持流式特性,继续向下游传递

return new ChatClientMessageAggregator().aggregateChatClientResponse(chatClientResponses, this::logResponse);

}

// logRequest、logResponse方法同上

|

MessageAggregator 是一个工具类,它将 Flux 响应聚合为单个 ChatClientResponse。这对于需要观察整个响应而不是流中单个项目的日志记录或其他处理非常有用。请注意,你不能在 MessageAggregator 中修改响应,因为它是一个只读操作。

自定义日志 Advisor

改造官方日志

对官方的SimpleLoggerAdvisor进行改造:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

|

//

// Source code recreated from a .class file by IntelliJ IDEA

// (powered by FernFlower decompiler)

//

package com.yuanyu.aiagent.advisor;

import java.util.function.Function;

import lombok.extern.slf4j.Slf4j;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

import org.springframework.ai.chat.client.ChatClientMessageAggregator;

import org.springframework.ai.chat.client.ChatClientRequest;

import org.springframework.ai.chat.client.ChatClientResponse;

import org.springframework.ai.chat.client.advisor.api.CallAdvisor;

import org.springframework.ai.chat.client.advisor.api.CallAdvisorChain;

import org.springframework.ai.chat.client.advisor.api.StreamAdvisor;

import org.springframework.ai.chat.client.advisor.api.StreamAdvisorChain;

import org.springframework.ai.chat.model.ChatResponse;

import org.springframework.ai.model.ModelOptionsUtils;

import org.springframework.lang.Nullable;

import reactor.core.publisher.Flux;

@Slf4j

public class MyLoggerAdvisor implements CallAdvisor, StreamAdvisor {

public ChatClientResponse adviseCall(ChatClientRequest chatClientRequest, CallAdvisorChain callAdvisorChain) {

this.logRequest(chatClientRequest);

ChatClientResponse chatClientResponse = callAdvisorChain.nextCall(chatClientRequest);

this.logResponse(chatClientResponse);

return chatClientResponse;

}

public Flux<ChatClientResponse> adviseStream(ChatClientRequest chatClientRequest, StreamAdvisorChain streamAdvisorChain) {

this.logRequest(chatClientRequest);

Flux<ChatClientResponse> chatClientResponses = streamAdvisorChain.nextStream(chatClientRequest);

return (new ChatClientMessageAggregator()).aggregateChatClientResponse(chatClientResponses, this::logResponse);

}

protected void logRequest(ChatClientRequest request) {

log.info("AI Request: {}", request.prompt());

}

protected void logResponse(ChatClientResponse chatClientResponse) {

log.info("AI Response: {}", chatClientResponse.chatResponse().getResult().getOutput().getText());

}

public String getName() {

return this.getClass().getSimpleName();

}

public int getOrder() {

return 0;

}

}

|

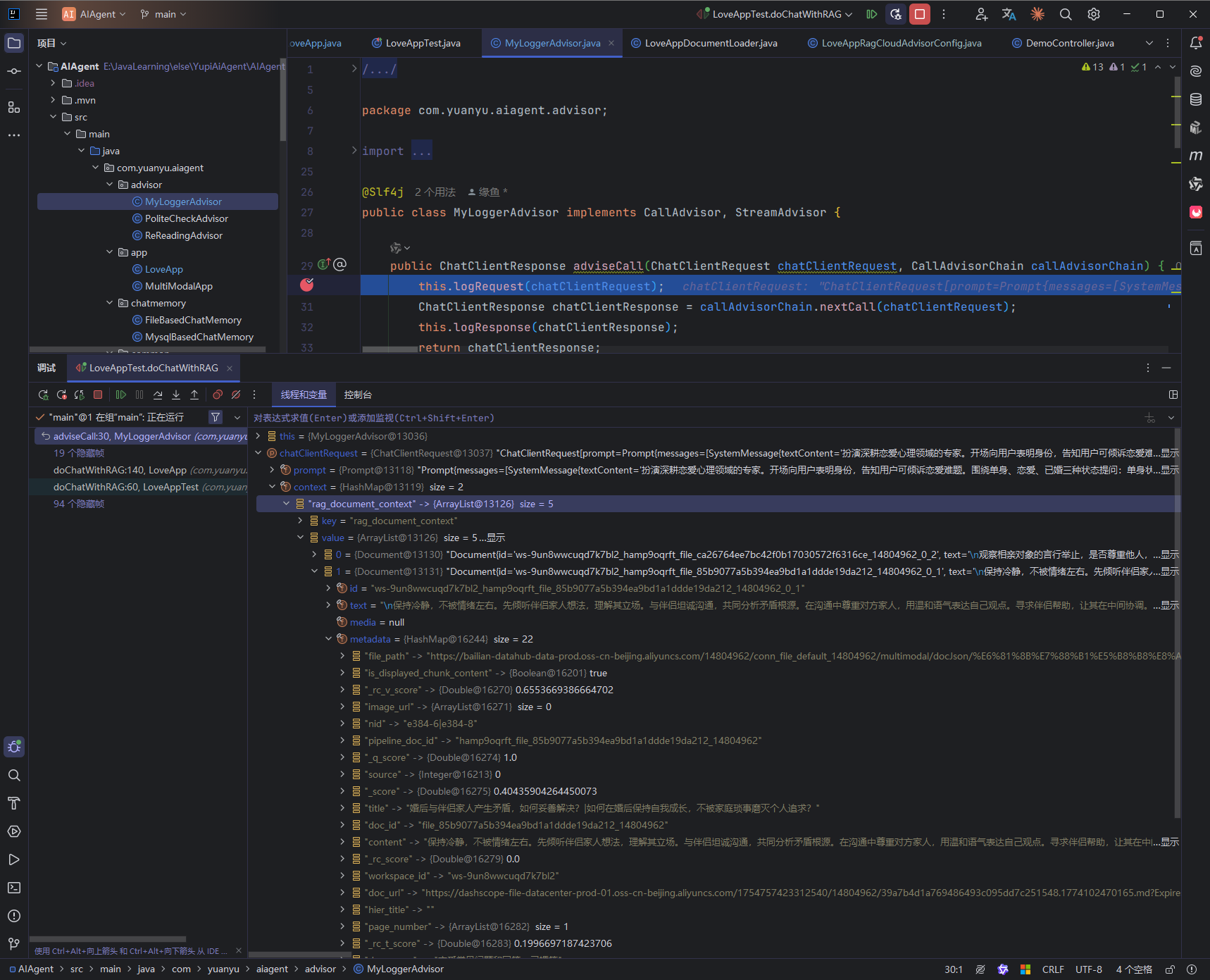

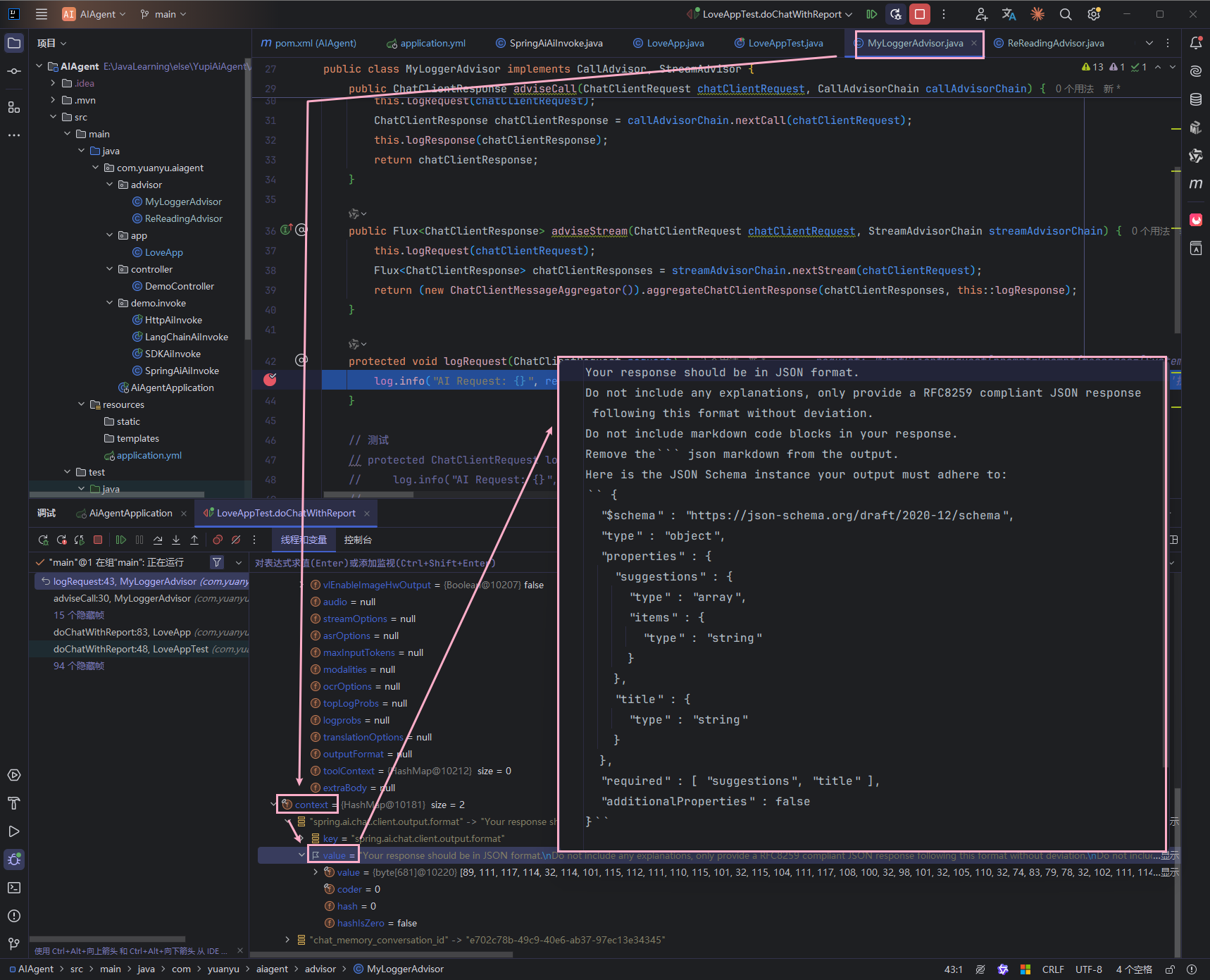

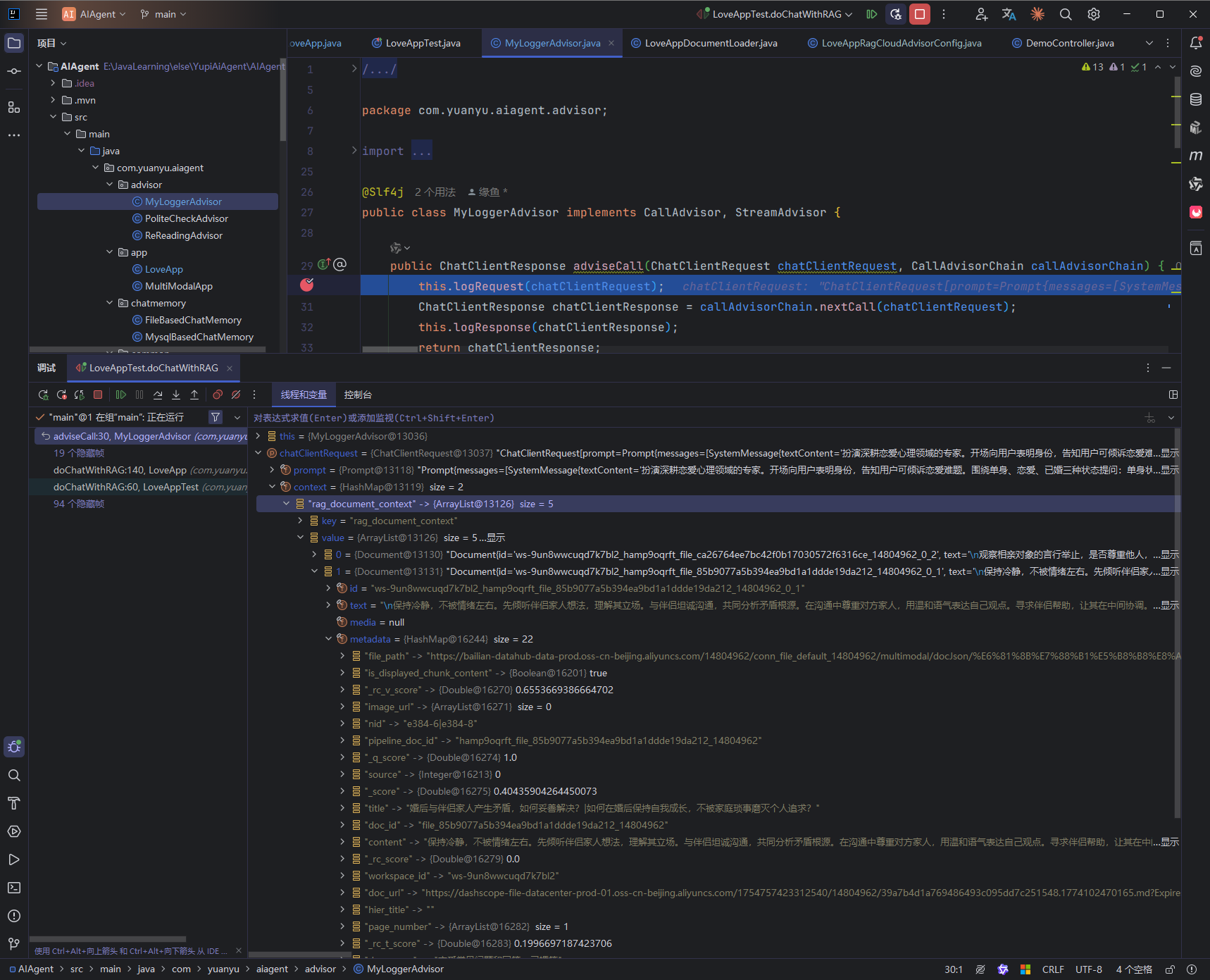

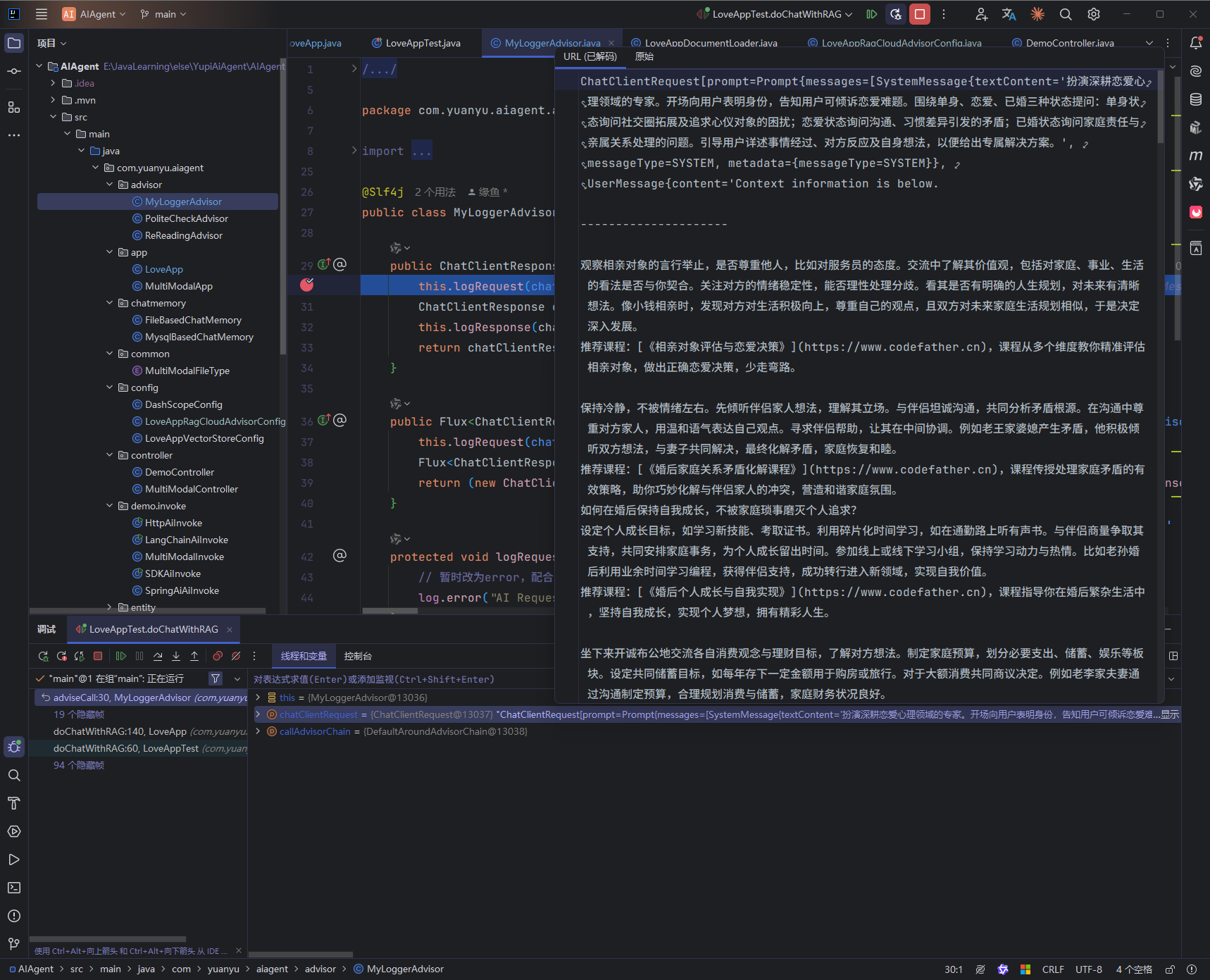

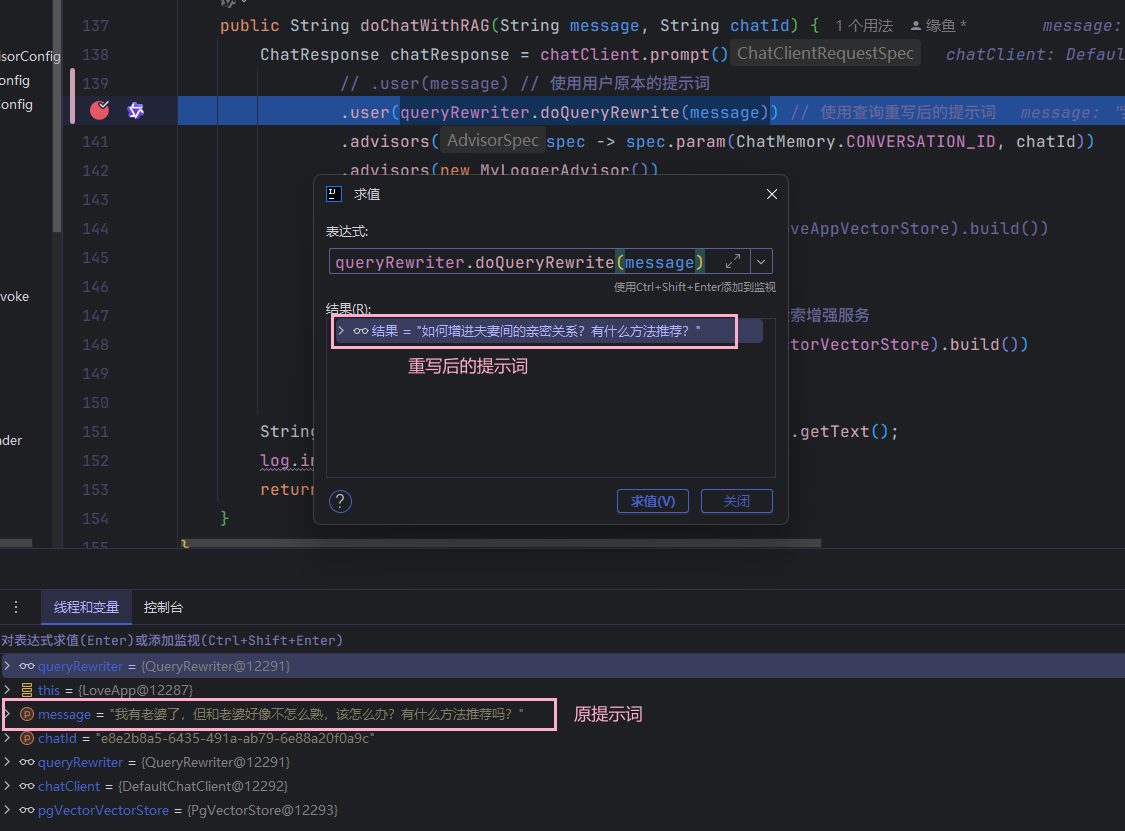

有些时候不知道调用哪个方法获取想要的数据,可以先随便调一个方法,然后打断点通过Debug找数据在哪里。

比如我一开始不知道在logRequest方法中调request的哪个方法,就调成了context()方法,通过Debug才找到用户提示词、系统提示词都放在prompt()方法中(原谅我眼瞎,一开始没看见qwq)

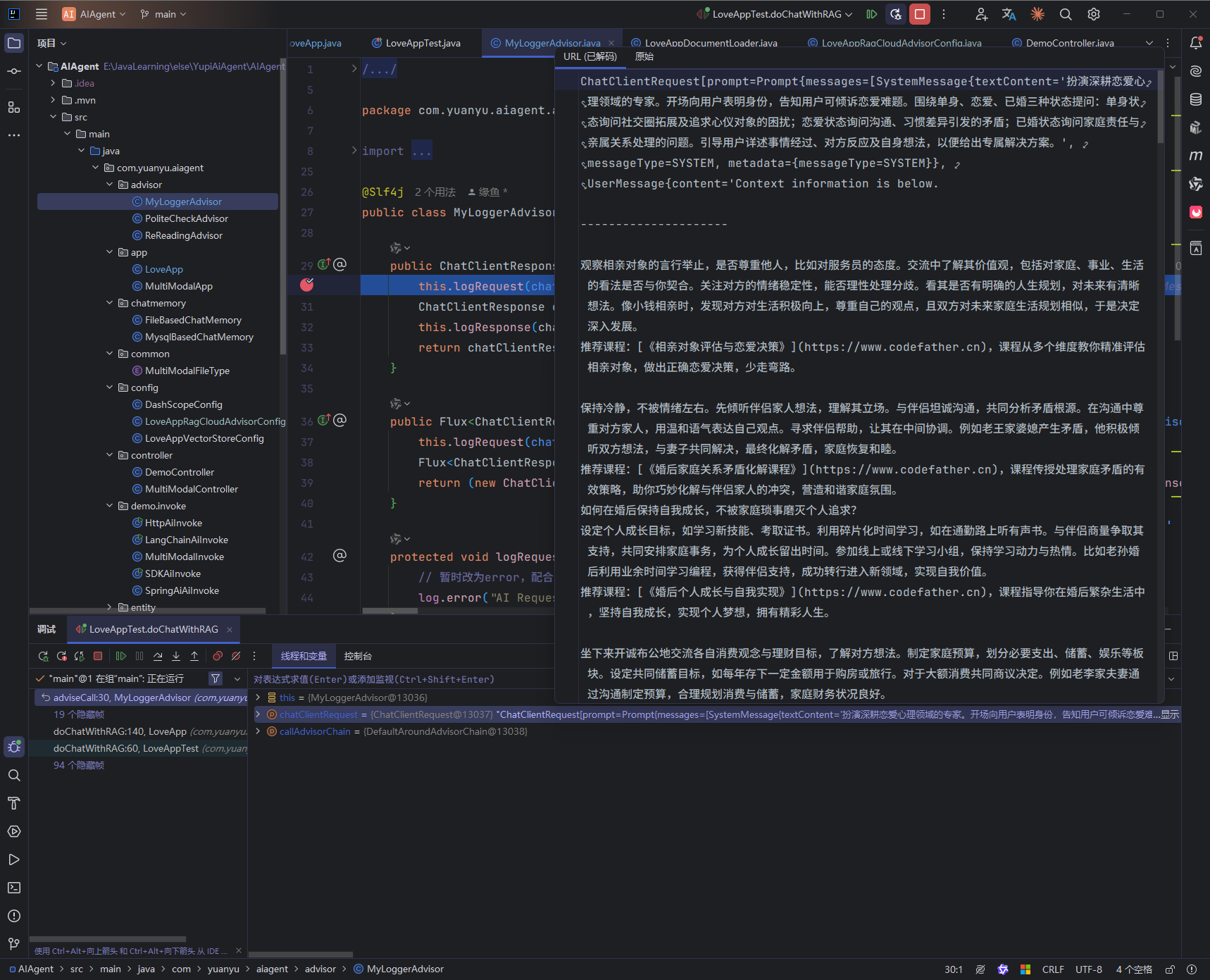

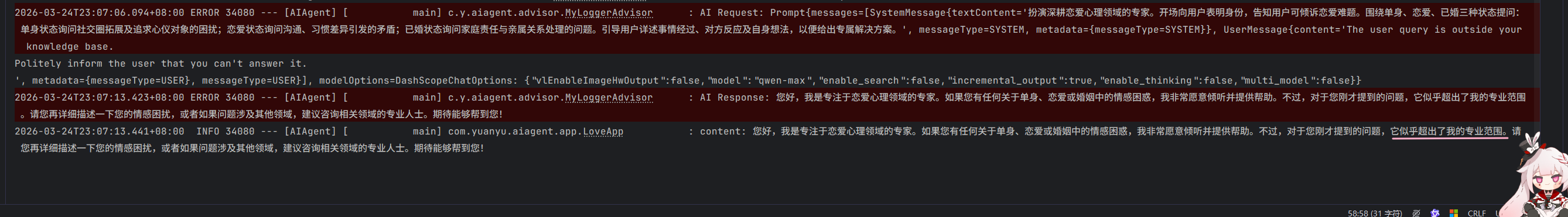

测试

回到前面LoveApp中,加上刚刚定义的日志Advisor

然后去单元测试中进行测试

Re-ReadingAdvisor

“Re-Reading Improves Reasoning in Large Language Models“一文介绍了一种称为重读(Re2)的技术,该技术可以提高大型语言模型的推理能力。Re2 技术需要像这样增强输入提示:

1

2

|

{Input_Query}

Read the question again: {Input_Query}

|

也就是把问题复制粘贴再问一遍

实现一个应用 Re2 技术到用户输入查询的Advisor可以这样完成:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

|

public class ReReadingAdvisor implements BaseAdvisor {

private static final String DEFAULT_RE2_ADVISE_TEMPLATE = """

{re2_input_query}

Read the question again: {re2_input_query}

""";

private final String re2AdviseTemplate;

private int order = 0;

public ReReadingAdvisor() {

this(DEFAULT_RE2_ADVISE_TEMPLATE);

}

public ReReadingAdvisor(String re2AdviseTemplate) {

this.re2AdviseTemplate = re2AdviseTemplate;

}

@Override

public ChatClientRequest before(ChatClientRequest chatClientRequest, AdvisorChain advisorChain) { // ①

String augmentedUserText = PromptTemplate.builder()

.template(this.re2AdviseTemplate)

.variables(Map.of("re2_input_query", chatClientRequest.prompt().getUserMessage().getText()))

.build()

.render();

return chatClientRequest.mutate()

.prompt(chatClientRequest.prompt().augmentUserMessage(augmentedUserText))

.build();

}

@Override

public ChatClientResponse after(ChatClientResponse chatClientResponse, AdvisorChain advisorChain) {

return chatClientResponse;

}

@Override

public int getOrder() { // ②

return this.order;

}

public ReReadingAdvisor withOrder(int order) {

this.order = order;

return this;

}

}

|

①before 方法通过应用重读技术来增强用户的输入查询。

②你可以通过设置 order 值来控制执行顺序。数值越小,优先级越高。

最佳实践

1)保持单一职责:每个 Advisor 应专注于一项特定任务

2)注意执行顺序:合理设置getOrder()值确保 Advisor 按正确顺序执行

3)同时支持流式和非流式:尽可能同时实现两种接口以提高灵活性

4)高效处理请求:避免在 Advisor 中执行耗时操作

5)测试边界情况:确保 Advisor 能够优雅处理异常和边界情况

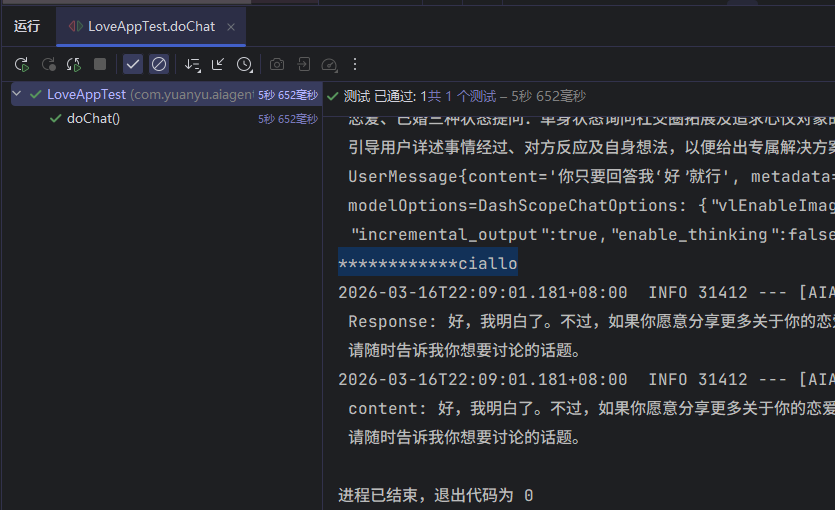

6)可以使用 mutate 在 Advisor 链中共享状态,类似于ThreadLocal,可以共享数据,以前面自定义的两个Advisor为例:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

|

// 存入数据

public class MyLoggerAdvisor implements CallAdvisor, StreamAdvisor {

public ChatClientResponse adviseCall(ChatClientRequest chatClientRequest, CallAdvisorChain callAdvisorChain) {

// 要接收修改后的对象,然后传递修改后的对象

ChatClientRequest request = this.logRequest(chatClientRequest);

ChatClientResponse chatClientResponse = callAdvisorChain.nextCall(request);

this.logResponse(chatClientResponse);

return chatClientResponse;

}

// ...

protected ChatClientRequest logRequest(ChatClientRequest request) {

log.info("AI Request: {}", request.prompt());

// 设置键值对后返回ChatClientRequest对象

return request.mutate().context("hello", "ciallo").build();

}

// ...

}

// 取出数据

public class ReReadingAdvisor implements BaseAdvisor {

// ...

@Override

public ChatClientRequest before(ChatClientRequest chatClientRequest, AdvisorChain advisorChain) { // ①

// ...

// 应该在控制台看见输出:************ciallo

System.out.println("************" + chatClientRequest.context().get("hello"));

return // ...

}

// ...

}

|

然后在LoveApp使用ReReadingAdvisor后进行测试:

发现可以正常取用

注意:

1.当取和用都是在Request阶段时,要注意Order,也就是Advisor的执行顺序

2.Response的键值对取用方法和Request一样,此处就不再重复演示了

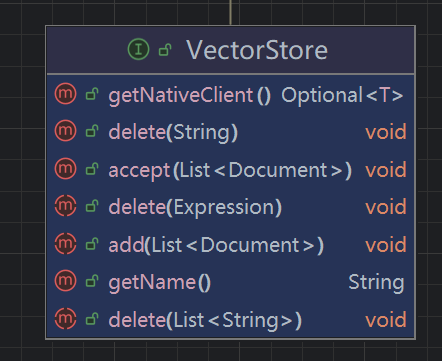

结构化输出

结构化输出转换器(Structured Output Converter)是 Spring AI 提供的一种实用机制,用于将大语言模型返回的文本输出转换为结构化数据格式,如 JSON、XML 或 Java 类,这对于需要可靠解析 AI 输出值的下游应用程序非常重要。

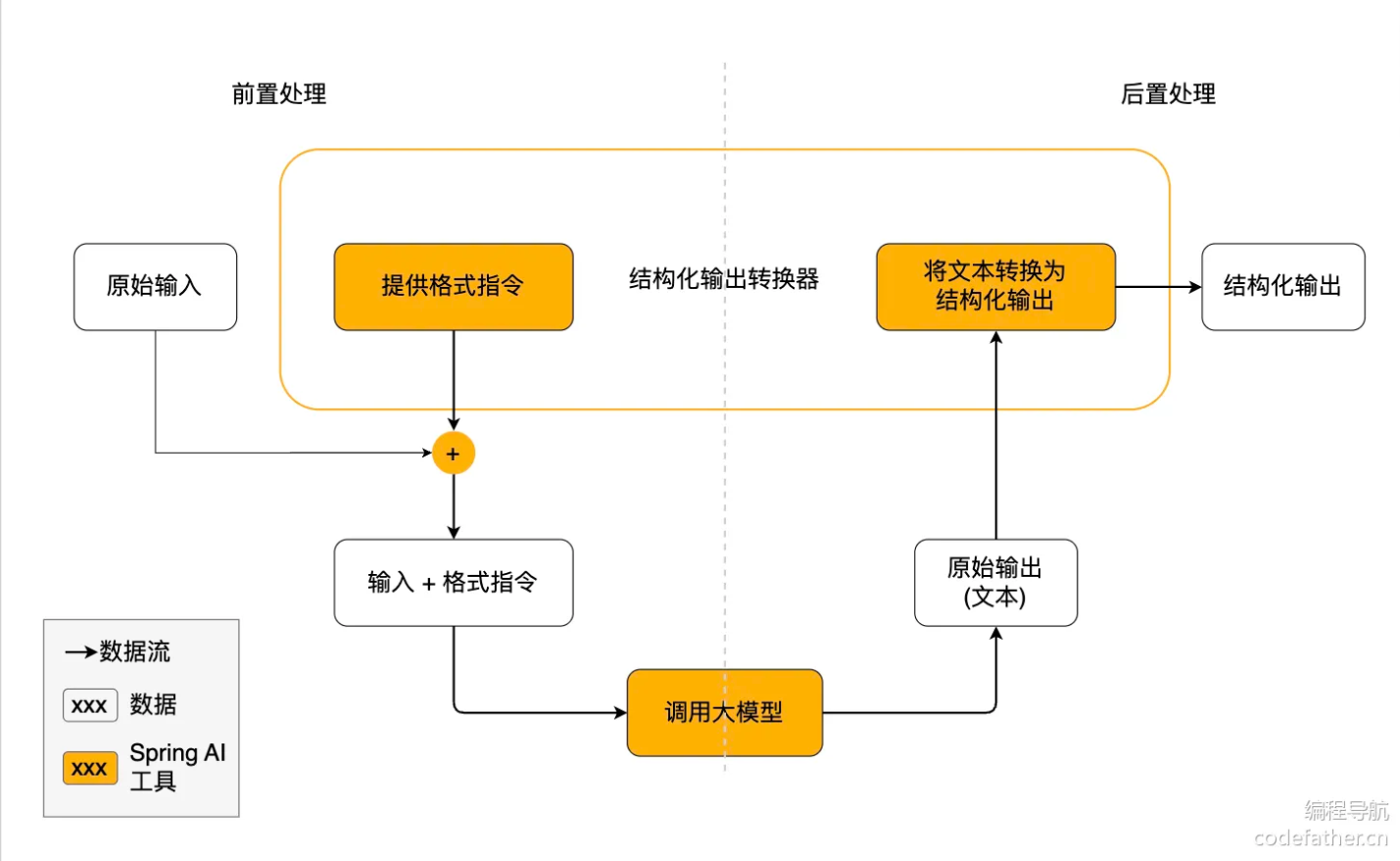

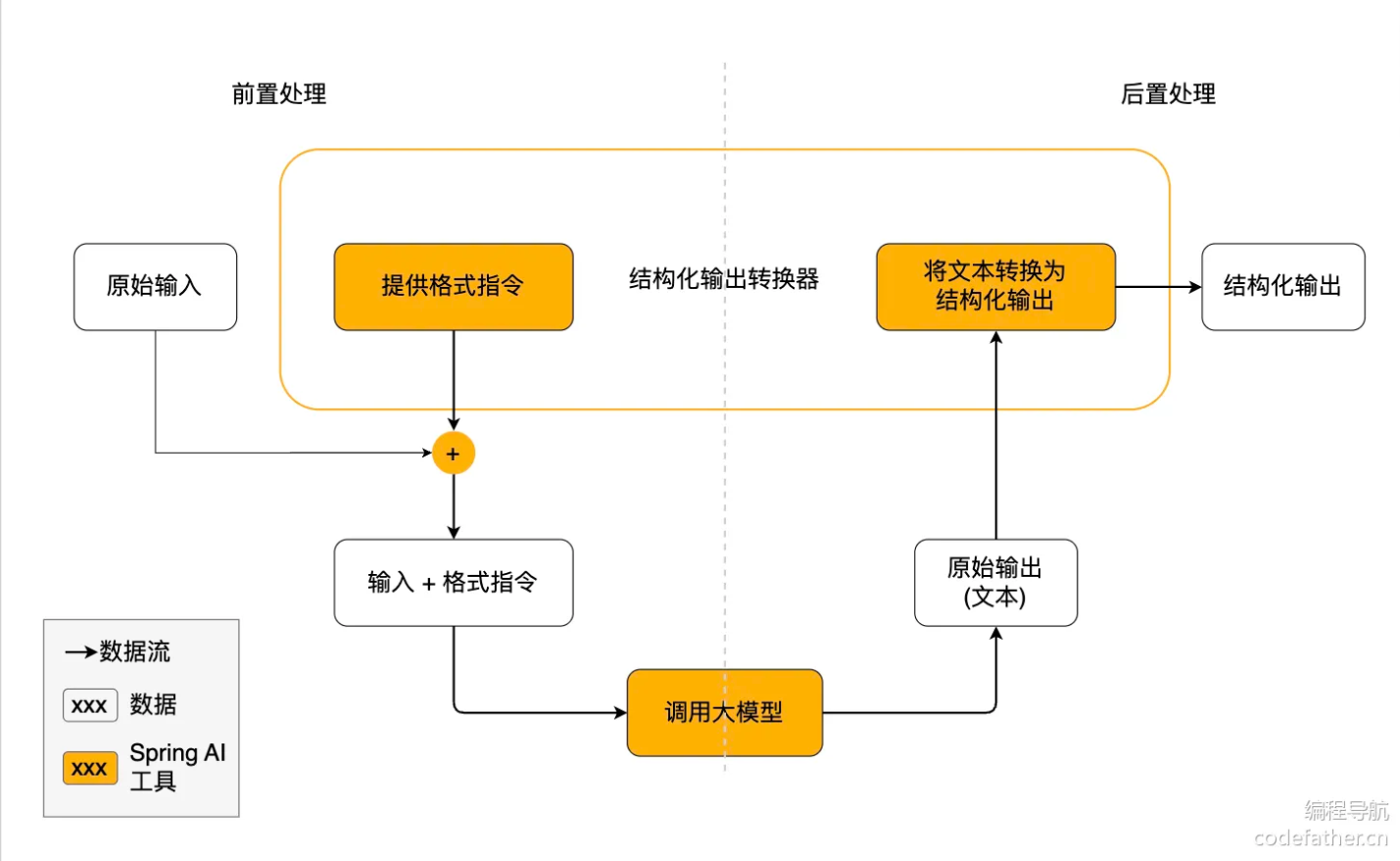

基本原理 - 工作流程

结构化输出转换器在大模型调用前后都发挥作用:

- 调用前:转换器会在提示词后面附加格式指令,明确告诉模型应该生成何种结构的输出,引导模型生成符合指定格式的响应。

- 调用后:转换器将模型的文本输出转换为结构化类型的实例,比如将原始文本映射为 JSON、XML 或特定的数据结构。

注意,结构化输出转换器只是 尽最大努力 将模型输出转换为结构化数据,AI 模型不保证一定按照要求返回结构化输出。有些模型可能无法理解提示词或无法按要求生成结构化输出。建议在程序中实现验证机制或者异常处理机制来确保模型输出符合预期。

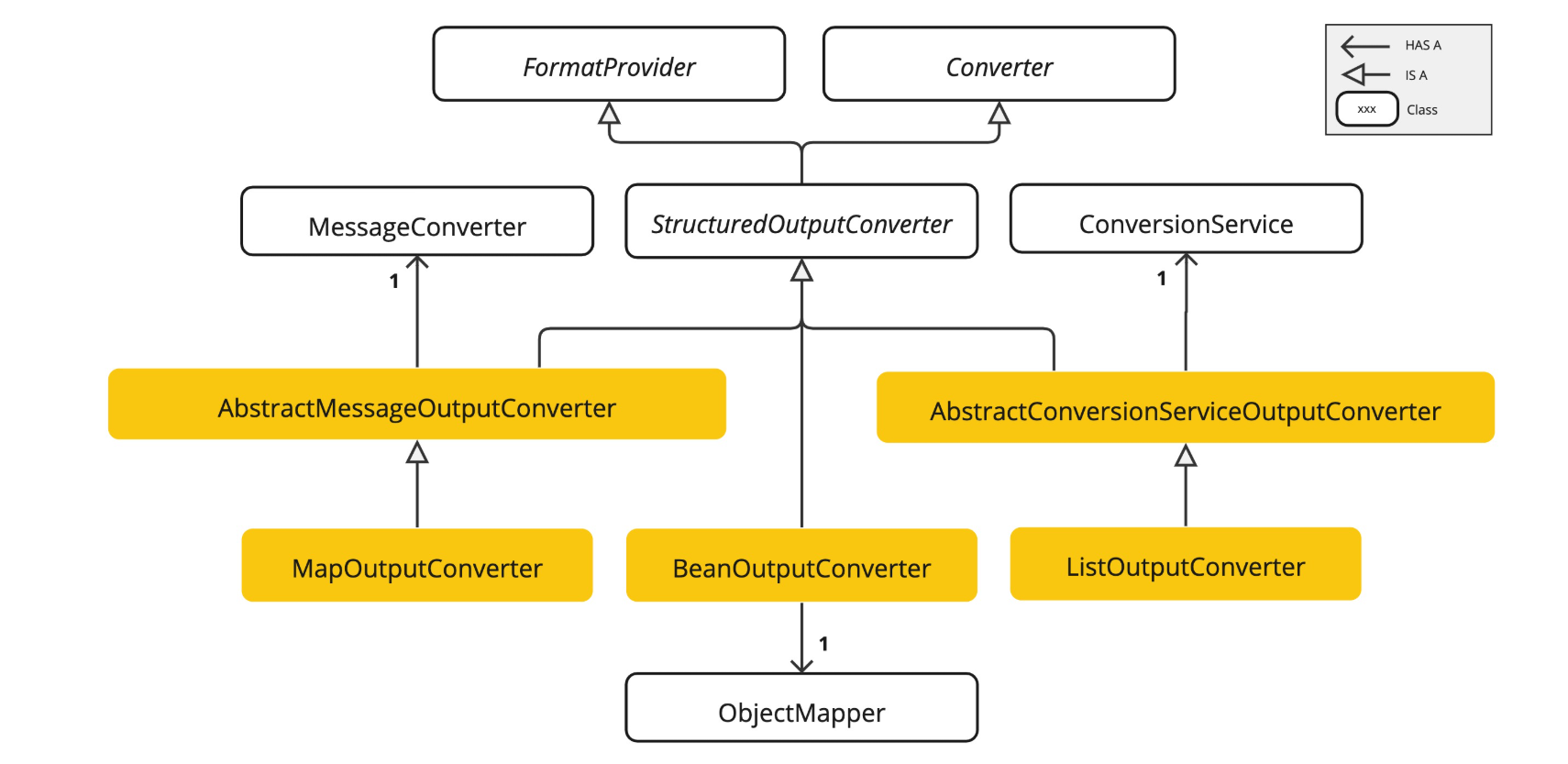

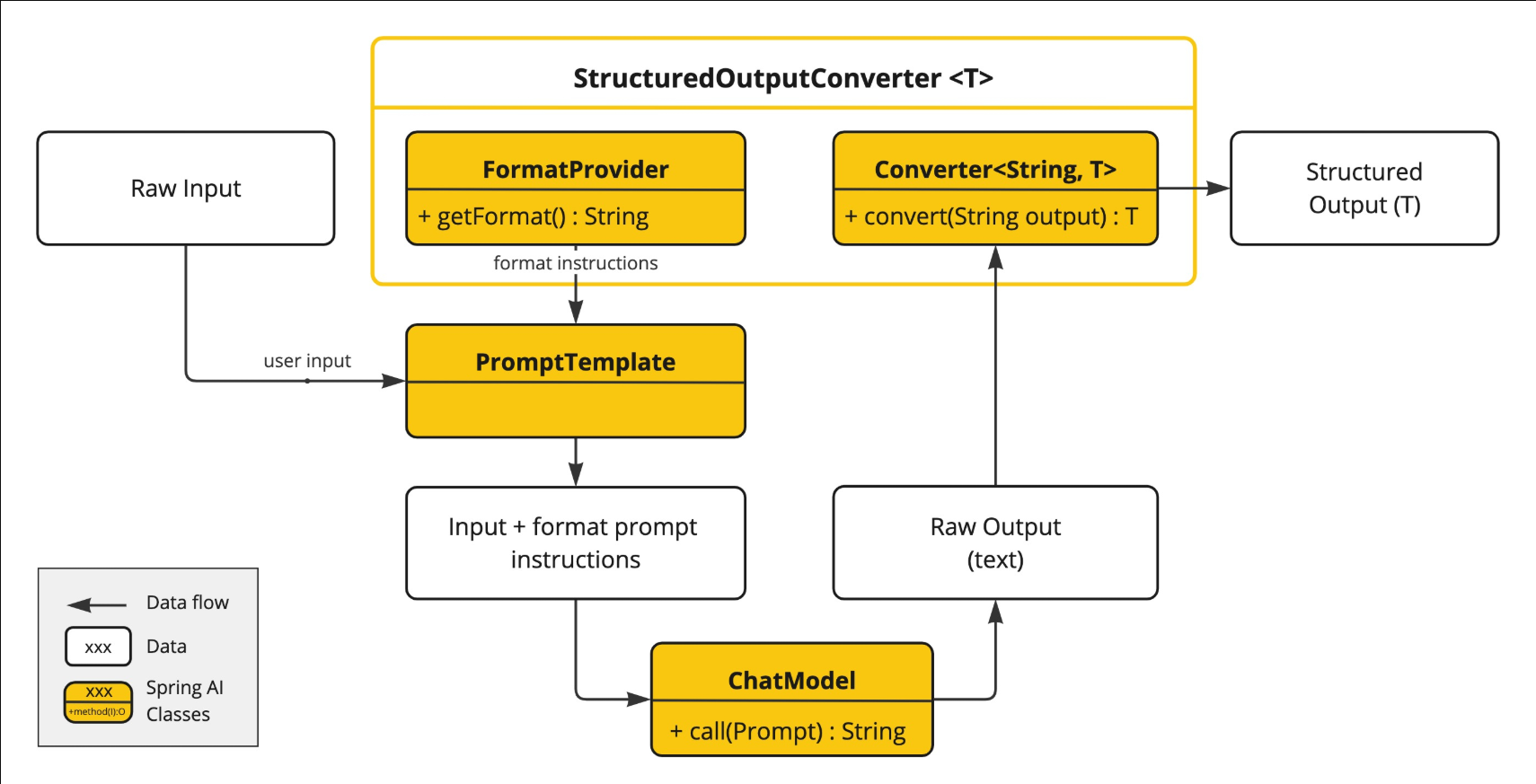

进阶原理 - API 设计

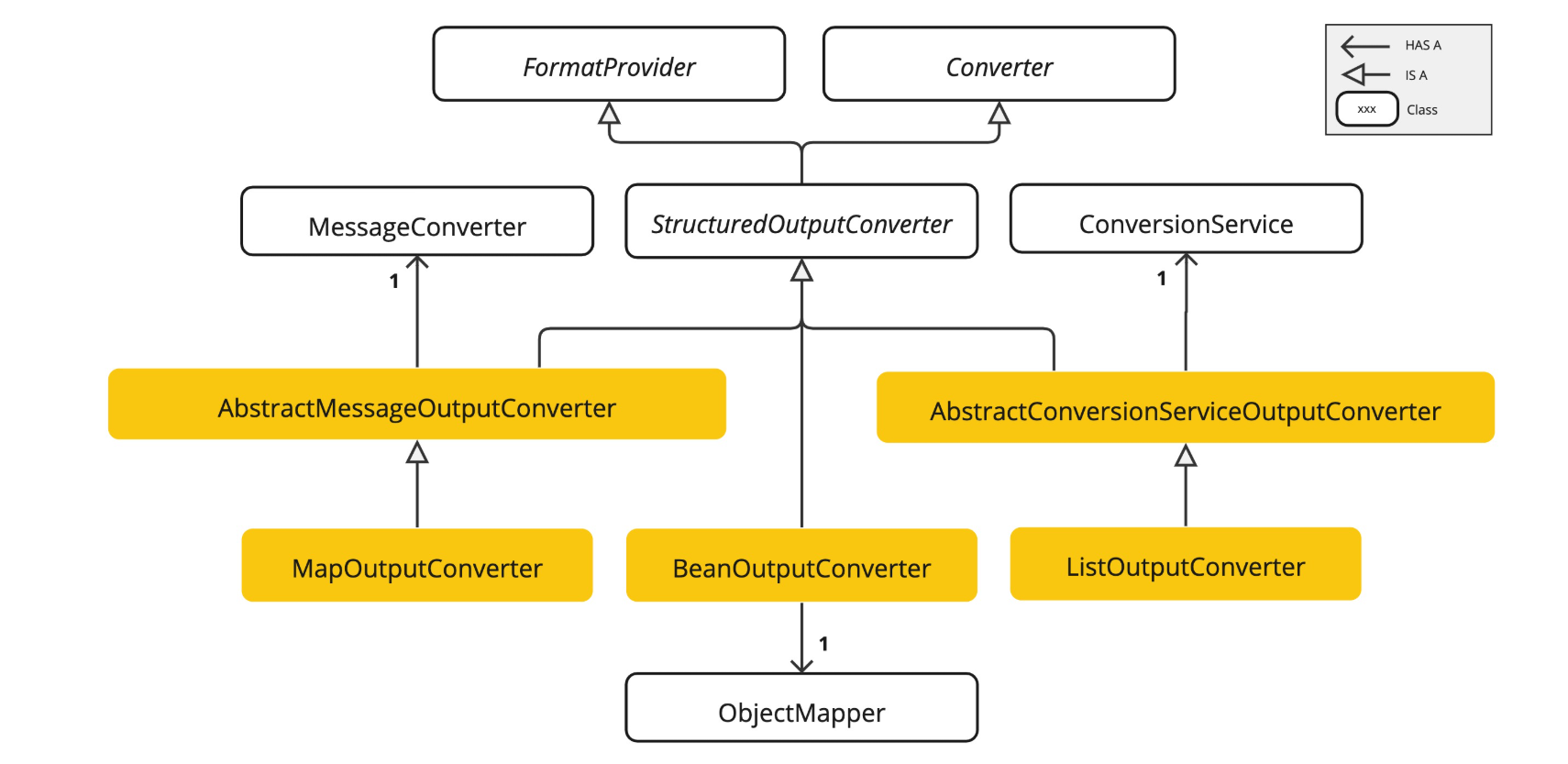

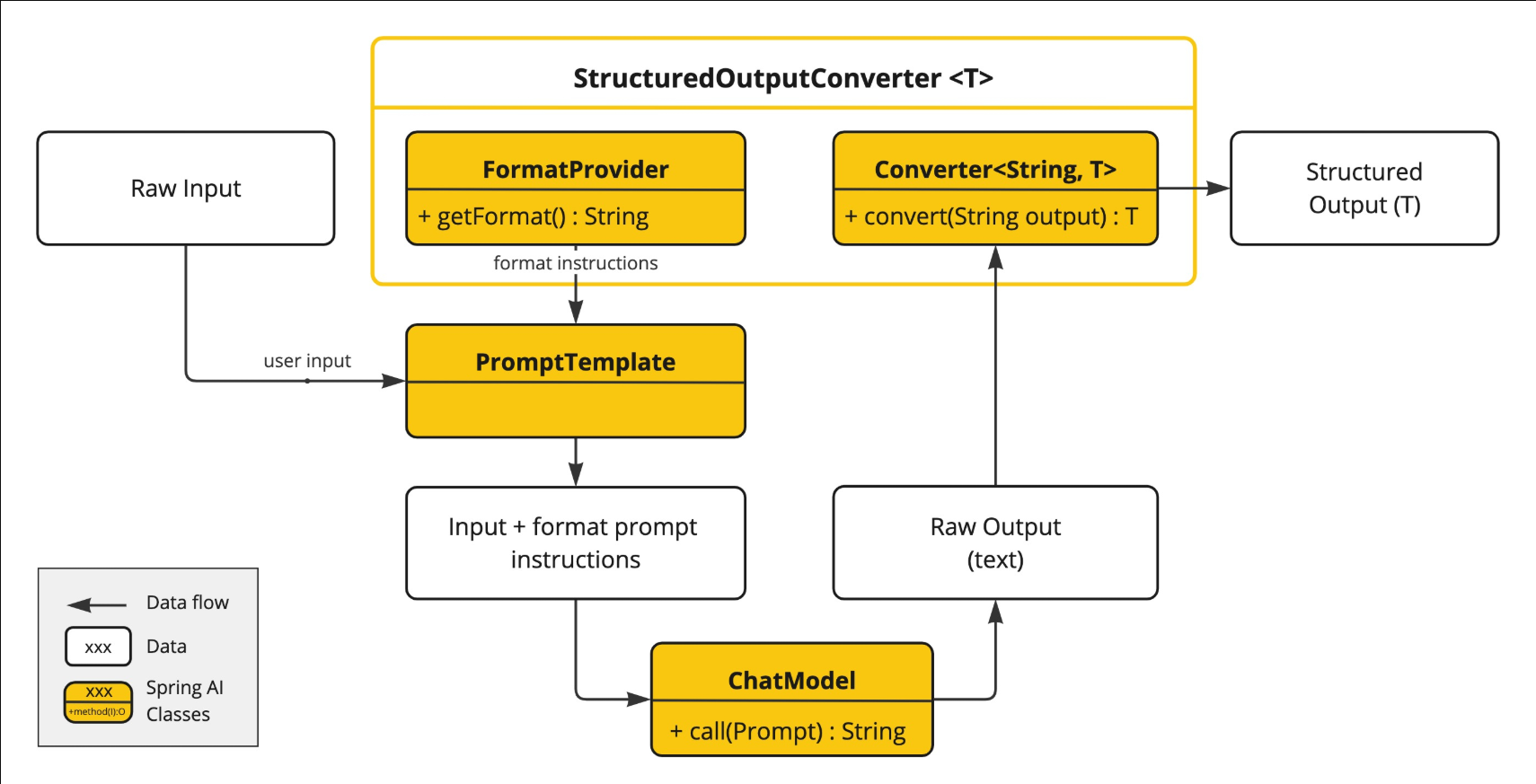

StructuredOutputConverter 接口允许你获取结构化输出,例如将输出映射到 Java 类或从基于文本的 AI 模型输出中获取值数组。接口定义如下:

1

|

public interface StructuredOutputConverter<T> extends Converter<String, T>, FormatProvider {}

|

它集成了 2 个关键接口:

目前,Spring AI 提供了 AbstractConversionServiceOutputConverter 、 AbstractMessageOutputConverter 、 BeanOutputConverter 、 MapOutputConverter 和 ListOutputConverter 的实现:

AbstractConversionServiceOutputConverter<T> - 提供了一个预配置的 GenericConversionService,用于将 LLM 输出转换为所需格式。不提供默认的 FormatProvider 实现。AbstractMessageOutputConverter<T> - 提供一个预配置的 MessageConverter,用于将 LLM 输出转换为所需格式。不提供默认 FormatProvider 实现。BeanOutputConverter<T> - 通过指定的 Java 类(例如 Bean)或 ParameterizedTypeReference 进行配置,此转换器采用 FormatProvider 实现,指导 AI 模型生成符合 DRAFT_2020_12 、 JSON Schema 的 JSON 响应,这些规范源自指定的 Java 类。随后,它利用 ObjectMapper 将 JSON 输出反序列化为目标类的 Java 对象实例。MapOutputConverter - 通过 AbstractMessageOutputConverter 的 FormatProvider 实现扩展功能,指导 AI 模型生成符合 RFC8259 的 JSON 响应。此外,它包含一个转换器实现,利用提供的 MessageConverter 将 JSON 负载转换为 java.util.Map<String, Object> 实例。ListOutputConverter - 扩展 AbstractConversionServiceOutputConverter 并包含一个针对逗号分隔列表输出的 FormatProvider 实现。转换器实现利用提供的 ConversionService 将模型文本输出转换为 java.util.List 。

了解了 API 设计后,再来进一步剖析一遍结构化输出的工作流程。

1)FormatProvider 为 AI 模型提供特定的格式指南,使其能够生成文本输出,这些输出可以使用 Converter 转换为指定的目标类型 T 。以下是一个这样的格式指令示例:

1

|

你的响应应为 JSON 格式。该 JSON 的数据结构需匹配这个 Java 类:java.util.HashMap。请勿包含任何解释内容,仅按照此格式提供符合 RFC8259 标准的 JSON 响应,不得偏离

|

格式指令通常使用 PromptTemplate 附加在用户输入的末尾,如下所示:

1

2

3

4

5

6

7

8

9

10

11

|

StructuredOutputConverter outputConverter = ...

String userInputTemplate = """

... user text input ....

{format}

"""; // user input with a "format" placeholder.

Prompt prompt = new Prompt(

PromptTemplate.builder()

.template(this.userInputTemplate)

.variables(Map.of(..., "format", this.outputConverter.getFormat())) // replace the "format" placeholder with the converter's format.

.build().createMessage()

);

|

2)Converter 负责将模型的输出文本转换为指定类型的实例。

使用示例

1)BeanOutputConverter 示例,将 AI 输出转换为自定义 Java 类:

1

2

3

4

5

6

7

8

9

|

// 定义一个记录类

record ActorsFilms(String actor, List<String> movies) {}

// 以下是使用高级、流畅的 ChatClient API 应用 BeanOutputConverter 的方法

ActorsFilms actorsFilms = ChatClient.create(chatModel).prompt()

.user(u -> u.text("Generate the filmography of 5 movies for {actor}.")

.param("actor", "Tom Hanks"))

.call()

.entity(ActorsFilms.class);

|

使用 ParameterizedTypeReference 构造函数来指定更复杂的目标类结构,比如自定义对象列表:

1

2

3

4

|

List<ActorsFilms> actorsFilms = ChatClient.create(chatModel).prompt()

.user("Generate the filmography of 5 movies for Tom Hanks and Bill Murray.")

.call()

.entity(new ParameterizedTypeReference<List<ActorsFilms>>() {});

|

2)MapOutputConverter 示例,将模型输出转换为包含数字列表的 Map:

1

2

3

4

5

|

Map<String, Object> result = ChatClient.create(chatModel).prompt()

.user(u -> u.text("Provide me a List of {subject}")

.param("subject", "an array of numbers from 1 to 9 under they key name 'numbers'"))

.call()

.entity(new ParameterizedTypeReference<Map<String, Object>>() {});

|

3)ListOutputConverter 示例,将模型输出转换为字符串列表:

1

2

3

4

5

|

List<String> flavors = ChatClient.create(chatModel).prompt()

.user(u -> u.text("List five {subject}")

.param("subject", "ice cream flavors"))

.call()

.entity(new ListOutputConverter(new DefaultConversionService()));

|

原生结构化输出

许多现代 AI 模型现在提供原生结构化输出支持,与基于提示的格式相比,这能提供更可靠的结果。Spring AI 通过原生结构化输出(Native Structured Output )功能支持这一特性。

在使用原生结构化输出时, BeanOutputConverter 生成的 JSON 架构直接发送到模型的结构化输出 API,无需在提示中包含格式指令。这种方法提供:

- 更高的可靠性:模型保证输出符合模式

- 更简洁的提示:无需附加格式说明

- 更好的性能:模型可以在内部优化结构化输出

要启用 Native Structured Output(原生结构化输出),请使用 AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT 参数:

1

2

3

4

5

|

ActorsFilms actorsFilms = ChatClient.create(chatModel).prompt()

.advisors(AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT)

.user("Generate the filmography for a random actor.")

.call()

.entity(ActorsFilms.class);

|

也可以通过在 ChatClient.Builder 上使用 defaultAdvisors() 来全局设置此选项:

1

2

3

4

5

6

|

@Bean

ChatClient chatClient(ChatClient.Builder builder) {

return builder

.defaultAdvisors(AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT)

.build();

}

|

什么是结构化输出

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

|

1. 概念对比

传统方式(非原生): 用户请求 → AI生成文本 → 解析文本 → 转换为Java对象 ↓ "Tom Hanks出演了《阿甘正传》、《拯救大兵瑞恩》..." ↓ 手动解析或正则提取 ↓

List<Movie> movies

原生结构化输出(Native):

用户请求 + 结构定义 → AI直接生成JSON → 自动映射为Java对象

↓

[{"title":"Forrest Gump","year":1994}...]

↓

List<Movie> movies

2. AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT的作用

根据Spring AI源码,这个参数的核心功能是:

// Spring AI 源码中的定义(简化版)

public class AdvisorParams {

/**

* 启用原生结构化输出

* 当设置此参数时,会自动添加一个Advisor,该Advisor会:

* 1. 检测是否调用了.entity()方法

* 2. 如果是,则修改请求,告诉AI模型直接返回JSON格式

* 3. 利用模型的原生JSON模式(如OpenAI的response_format)

*/

public static final String ENABLE_NATIVE_STRUCTURED_OUTPUT = "enableNativeStructuredOutput";

}

3. 工作原理详解

不使用原生结构化输出:

// 传统方式

ChatClient.create(model).prompt()

.user("Generate 5 movies for Tom Hanks")

.call()

.entity(new ParameterizedTypeReference<List<Movie>>() {});

// AI返回的是普通文本:

// "1. Forrest Gump (1994)

// 2. Saving Private Ryan (1998)

// ..."

//

// Spring AI需要:

// 1. 在prompt中添加"请以JSON格式返回"

// 2. 解析可能不规范的JSON

// 3. 处理解析错误

使用原生结构化输出:

// 原生方式

ChatClient.create(model).prompt()

.advisors(AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT) // 关键!

.user("Generate 5 movies for Tom Hanks")

.call()

.entity(new ParameterizedTypeReference<List<Movie>>() {});

// 底层会转换为:

// {

// "messages": [...],

// "response_format": {

// "type": "json_schema",

// "json_schema": {

// "name": "MovieList",

// "schema": {

// "type": "array",

// "items": {

// "type": "object",

// "properties": {

// "title": {"type": "string"},

// "year": {"type": "integer"}

// }

// }

// }

// }

// }

// }

4. Advisor的内部实现逻辑

// Spring AI 内部的 StructuredOutputAdvisor(伪代码)

public class StructuredOutputAdvisor implements CallAdvisor {

@Override

public ChatClientRequest before(ChatClientRequest request, AdvisorChain chain) {

// 检查是否启用了原生结构化输出

Boolean enabled = request.adviseContext().get(ENABLE_NATIVE_STRUCTURED_OUTPUT);

if (Boolean.TRUE.equals(enabled)) {

// 1. 从entity()方法获取目标类型

ParameterizedTypeReference<?> targetType = request.getTargetType();

// 2. 生成JSON Schema

String jsonSchema = generateJsonSchema(targetType);

// 3. 修改请求,添加response_format参数

return request.mutate()

.chatOptions(ChatOptions.builder()

.responseFormat(new ResponseFormat("json_schema", jsonSchema))

.build())

.build();

}

return request;

}

}

5. 优势对比

┌──────────┬──────────────────────┬──────────────────────────────┐

│ 特性 │ 传统方式 │ 原生结构化输出 │

├──────────┼──────────────────────┼──────────────────────────────┤

│ 准确性 │ 依赖AI理解prompt │ 模型强制返回符合schema的JSON │

├──────────┼──────────────────────┼──────────────────────────────┤

│ 可靠性 │ 可能返回格式错误 │ 100%符合定义的结构 │

├──────────┼──────────────────────┼──────────────────────────────┤

│ 性能 │ 需要额外的解析和验证 │ 直接映射,无需额外处理 │

├──────────┼──────────────────────┼──────────────────────────────┤

│ 错误处理 │ 需要处理各种解析异常 │ 模型保证格式正确 │

├──────────┼──────────────────────┼──────────────────────────────┤

│ 模型支持 │ 所有模型 │ 仅支持原生JSON模式的模型 │

└──────────┴──────────────────────┴──────────────────────────────┘

6. 支持原生结构化输出的模型

- OpenAI: GPT-4, GPT-3.5-turbo(通过response_format参数)

- Anthropic Claude: Claude 3系列(通过tool use模拟)

- 阿里通义千问: Qwen系列(通过result_format参数)

- Google Gemini: 部分支持

7. 实际应用示例

// 定义电影实体

public record Movie(String title, int year, String director) {}

// 使用原生结构化输出

List<Movie> movies = ChatClient.create(dashscopeChatModel)

.prompt()

.advisors(AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT) // 启用原生模式

.user("Generate 5 movies for Tom Hanks")

.call()

.entity(new ParameterizedTypeReference<List<Movie>>() {});

// AI会直接返回:

// [

// {"title": "Forrest Gump", "year": 1994, "director": "Robert Zemeckis"},

// {"title": "Saving Private Ryan", "year": 1998, "director": "Steven Spielberg"},

// ...

// ]

//

// Spring AI自动映射为List<Movie>,无需任何手动解析!

8. 关键要点总结

1. "原生"的含义:利用AI模型本身提供的JSON模式功能,而不是通过prompt工程

2. Advisor的作用:自动检测.entity()调用,并配置模型的response_format

3. 优势:更可靠、更准确、更高效

4. 限制:需要模型原生支持JSON Schema模式

这就是为什么代码中使用AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT——它告诉Spring

AI使用阿里通义千问模型的原生JSON输出能力,确保返回的数据完美匹配List<Movie>的结构!

|

恋爱报告功能开发

下面让我们使用结构化输出,来为用户生成恋爱报告,并转换为恋爱报告对象,包含报告标题和恋爱建议列表字段。

1)需要引入 JSON Schema 生成依赖:

1

2

3

4

5

6

|

<!-- JSON Schema 生成依赖,结构化输出需要用到 -->

<dependency>

<groupId>com.github.victools</groupId>

<artifactId>jsonschema-generator</artifactId>

<version>4.38.0</version>

</dependency>

|

2)在 LoveApp 中定义恋爱报告类,可以使用 Java 14 引入的 record 特性快速定义:

1

2

|

record LoveReport(String title, List<String> suggestions) {

}

|

3)在 LoveApp 中编写一个新的方法,复用之前构造好的 ChatClient 对象,只需额外补充原有的系统提示词、并且添加结构化输出的代码即可。代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

/**

* AI 恋爱报告 - 结构化输出练习

* @param message

* @param chatId

* @return

*/

public LoveReport doChatWithReport(String message, String chatId) {

LoveReport loveReport = chatClient.prompt()

.system(SYSTEM_PROMPT + "每次对话后都要生成恋爱结果,标题为{用户名}的恋爱报告,内容为建议列表")

.user(message)

.advisors(spec -> spec.param(ChatMemory.CONVERSATION_ID, chatId))

// .advisors(AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT)

.call()

.entity(LoveReport.class);

log.info("loveReport: {}", loveReport);

return loveReport;

|

4)编写单元测试代码:

1

2

3

4

5

6

7

8

9

|

@Test

void doChatWithReport() {

// 随机生成一个会话 ID

String chatId = UUID.randomUUID().toString();

String message = "我是一个肥宅,我每天躺在家里懒得出门,长得也丑,我也不愿做出任何改变,我要如何找到女朋友?";

LoveApp.LoveReport loveReport = loveApp.doChatWithReport(message, chatId);

Assertions.assertNotNull(loveReport);

}

|

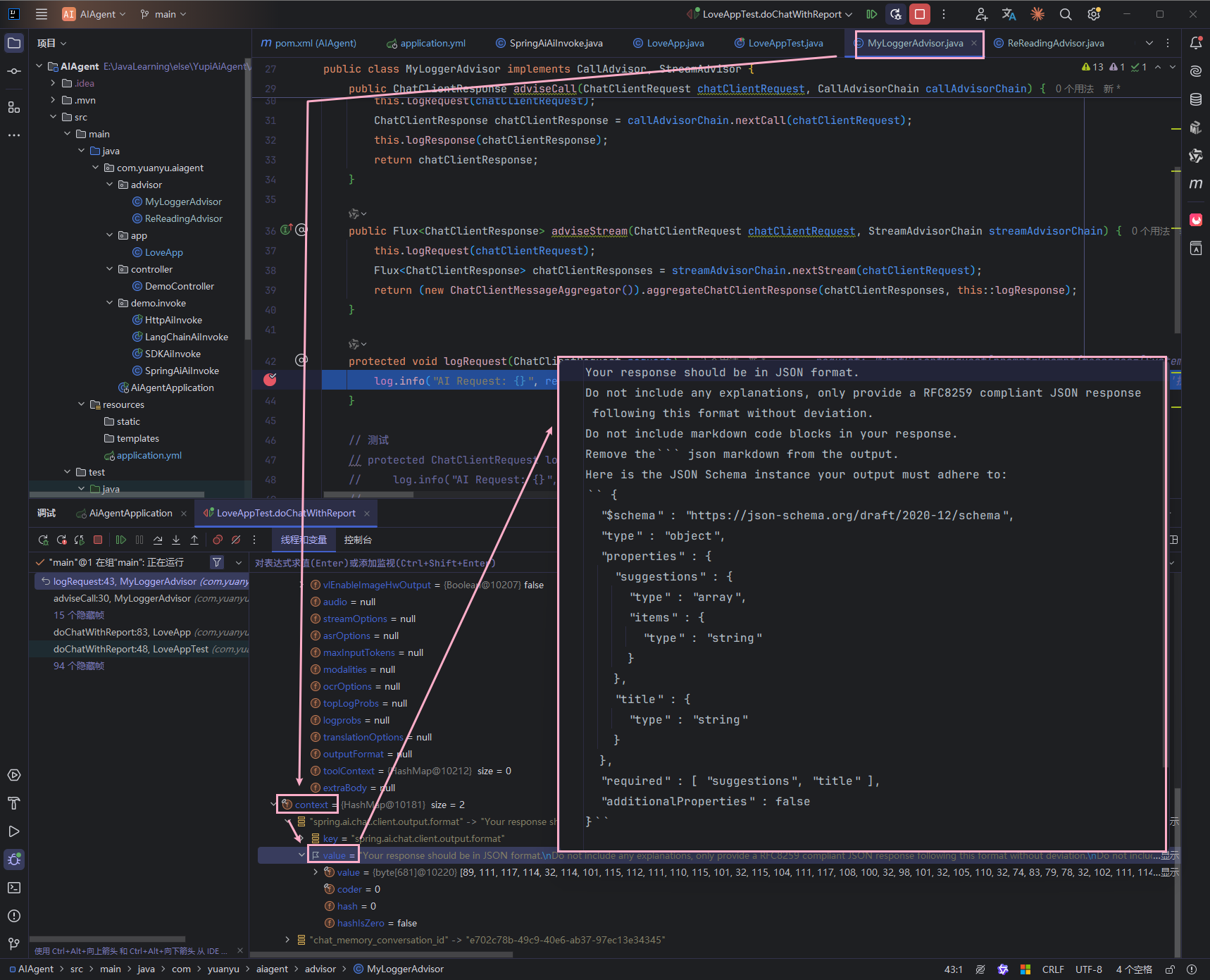

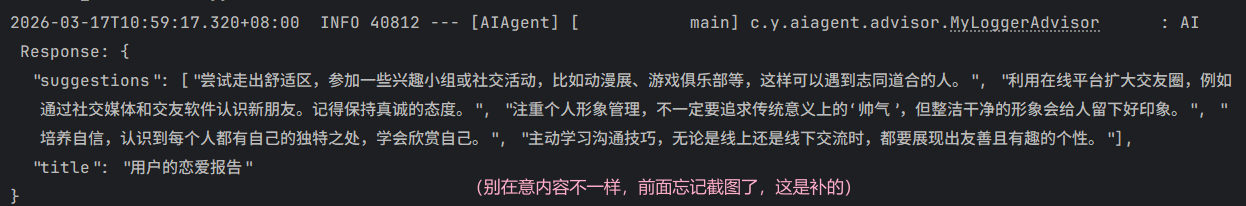

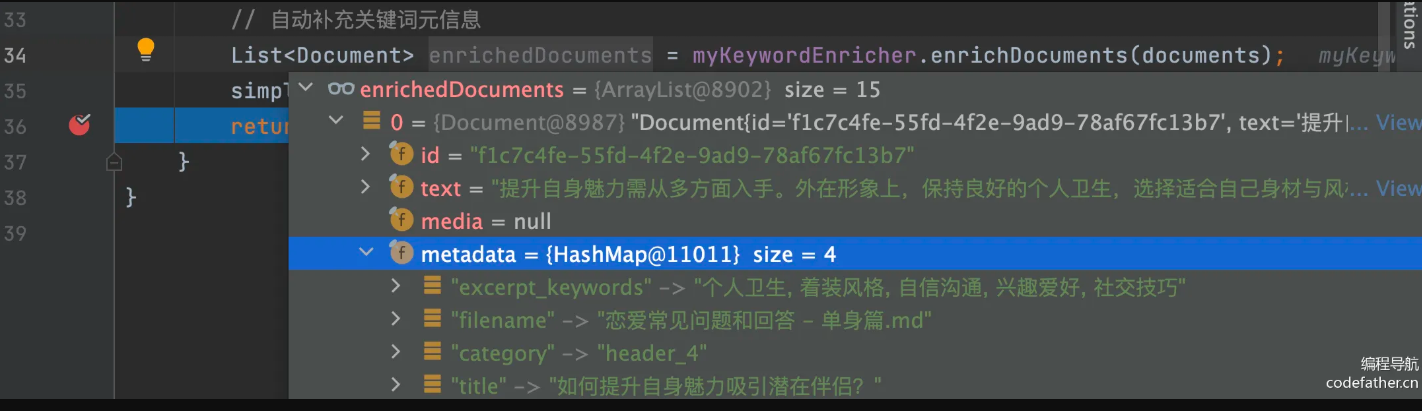

可以在Advisor中打个断点看看request有没有格式化指令:

发现对象被转换为了 JSON Schema 描述语言。

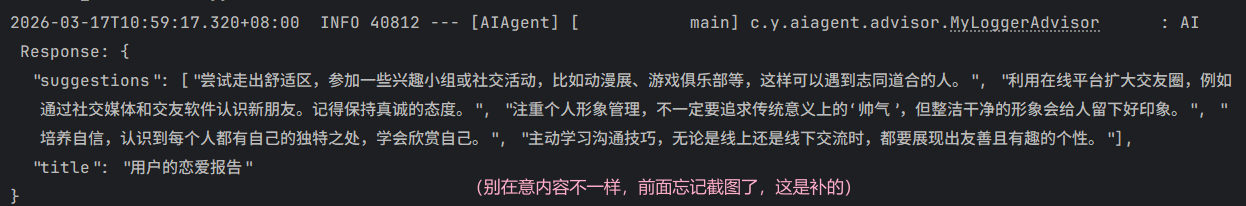

转换器也成功将 JSON 文本转换为了对象:

AI 生成的内容如图,是 JSON 格式文本:

虽然不开启AdvisorParams.ENABLE_NATIVE_STRUCTURED_OUTPUT也成功转换为JSON了,但开启后转换成功率更高,而且更省token,因为作用机制不一样,建议用到原生结构化输出时开启。

对话记忆持久化

自定义实现基于文件持久化

接下来基于本地文件存储的方式实现对话记忆持久化

想要自定义对话记忆持久化,可以参考官方ChatMemory已有的实现类MessageWindowChatMemory进行修改

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

public interface ChatMemory {

String DEFAULT_CONVERSATION_ID = "default";

String CONVERSATION_ID = "chat_memory_conversation_id";

default void add(String conversationId, Message message) {

Assert.hasText(conversationId, "conversationId cannot be null or empty");

Assert.notNull(message, "message cannot be null");

this.add(conversationId, List.of(message));

}

void add(String conversationId, List<Message> messages);

List<Message> get(String conversationId);

void clear(String conversationId);

}

|

从ChatMemory中可以看到对话内容都被存储在Message中,Message没有实现 Serializable 序列化接口,且因为其是一个有多种子类实现的接口,不容易使用JSON序列化,所以接下来使用 Kryo 序列化库来序列化(前一篇文章SpringAI入门中的自定义序列化方案是选择性保留原Message中的重要数据)

1)引入依赖:

1

2

3

4

5

|

<dependency>

<groupId>com.esotericsoftware</groupId>

<artifactId>kryo</artifactId>

<version>5.6.2</version>

</dependency>

|

2)在根包下新建 chatmemory 包,编写基于文件持久化的对话记忆 FileBasedChatMemory,代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

|

package com.yuanyu.aiagent.chatmemory;

import com.esotericsoftware.kryo.Kryo;

import com.esotericsoftware.kryo.io.Input;

import com.esotericsoftware.kryo.io.Output;

import org.objenesis.strategy.StdInstantiatorStrategy;

import org.springframework.ai.chat.memory.ChatMemory;

import org.springframework.ai.chat.messages.Message;

import java.io.File;

import java.io.FileInputStream;

import java.io.FileOutputStream;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

public class FileBasedChatMemory implements ChatMemory {

private final String BASE_DIR;

private static final Kryo kryo = new Kryo();

static {

// 允许未注册的类,避免每次添加新类时都进行注册

kryo.setRegistrationRequired(false);

// 设置实例化策略

kryo.setInstantiatorStrategy(new StdInstantiatorStrategy());

}

/**

* 指定文件保存目录

* @param dir

*/

public FileBasedChatMemory(String dir) {

this.BASE_DIR = dir;

File baseDir = new File(dir);

if (!baseDir.exists()) {

baseDir.mkdirs();

}

}

@Override

public void add(String conversationId, Message message) {

ChatMemory.super.add(conversationId, message);

}

@Override

public void add(String conversationId, List<Message> messages) {

List<Message> conversationMessages = getOrCreateConversation(conversationId);

conversationMessages.addAll(messages);

saveConversation(conversationId, conversationMessages);

}

@Override

public List<Message> get(String conversationId) {

return getOrCreateConversation(conversationId);

}

@Override

public void clear(String conversationId) {

File file = getConversationFile(conversationId);

if (file.exists()) {

file.delete();

}

}

/**

* 获取或创建会话

* @param conversationId

* @return

*/

private List<Message> getOrCreateConversation(String conversationId) {

File file = getConversationFile(conversationId);

List<Message> messages = new ArrayList<>();

if (file.exists()) {

try (Input input = new Input(new FileInputStream(file))) {

messages = kryo.readObject(input, ArrayList.class);

} catch (IOException e) {

e.printStackTrace();

}

}

return messages;

}

/**

* 保存会话

* @param conversationId

* @param messages

*/

private void saveConversation(String conversationId, List<Message> messages) {

File file = getConversationFile(conversationId);

try (Output output = new Output(new FileOutputStream(file))) {

kryo.writeObject(output, messages);

} catch (IOException e) {

e.printStackTrace();

}

}

/**

* 获取当前会话文件

* @param conversationId

* @return

*/

private File getConversationFile(String conversationId) {

return new File(BASE_DIR, conversationId + ".kryo");

}

}

|

虽然上述代码看起来复杂,但大多数代码都是文件和 Message 对象的转换,完全可以利用 AI 生成这段代码。

3)修改 LoveApp 的构造函数,使用基于文件的对话记忆:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

public LoveApp(ChatModel dashscopeChatModel) {

// 初始化基于内存的对话记忆

// ChatMemory memory = MessageWindowChatMemory.builder()

// .maxMessages(10) // 最多保存 10 条消息(默认20条)

// .build();

// 初始化基于本地文件的对话记忆

String fileDir = System.getProperty("user.dir") + "/tmp/char-memory";

FileBasedChatMemory memory = new FileBasedChatMemory(fileDir);

chatClient = ChatClient.builder(dashscopeChatModel)

.defaultSystem(SYSTEM_PROMPT)

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(memory).build()

// new MyLoggerAdvisor() // 自定义日志拦截器

// new ReReadingAdvisor()

)

.build();

}

|

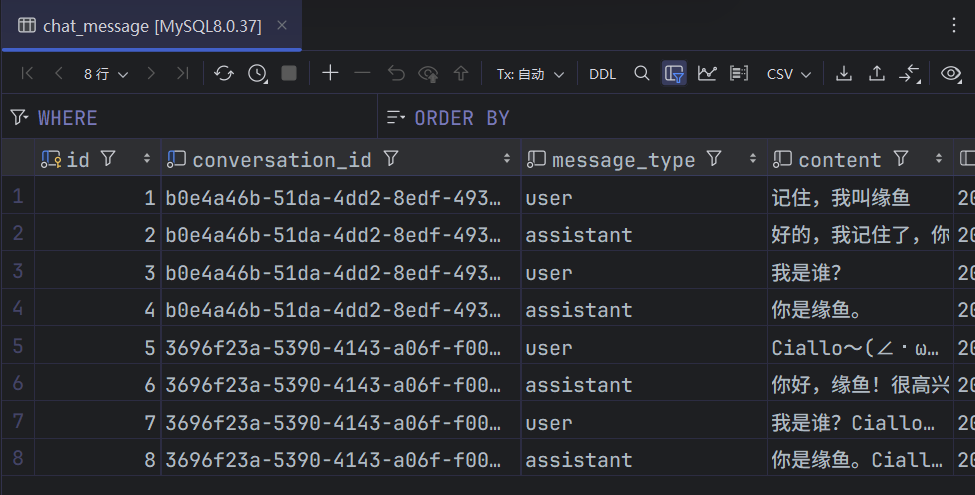

4)测试运行,文件持久化成功:

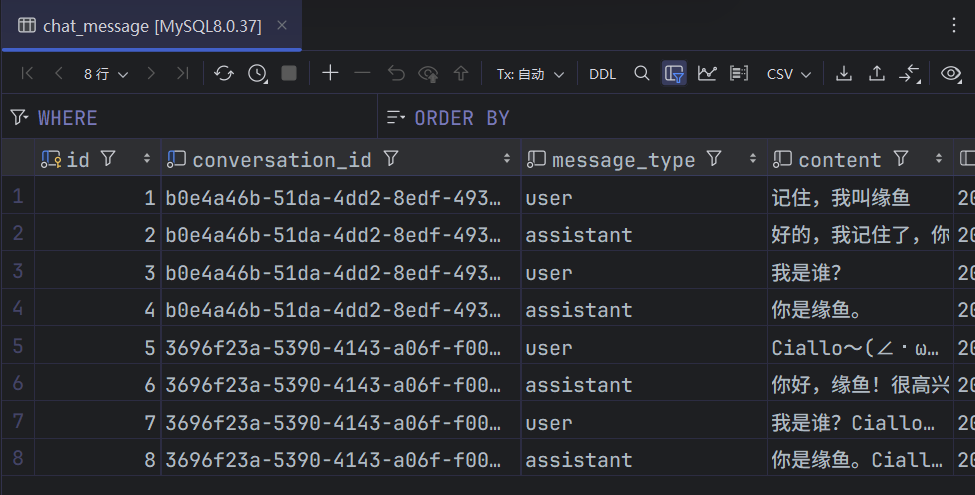

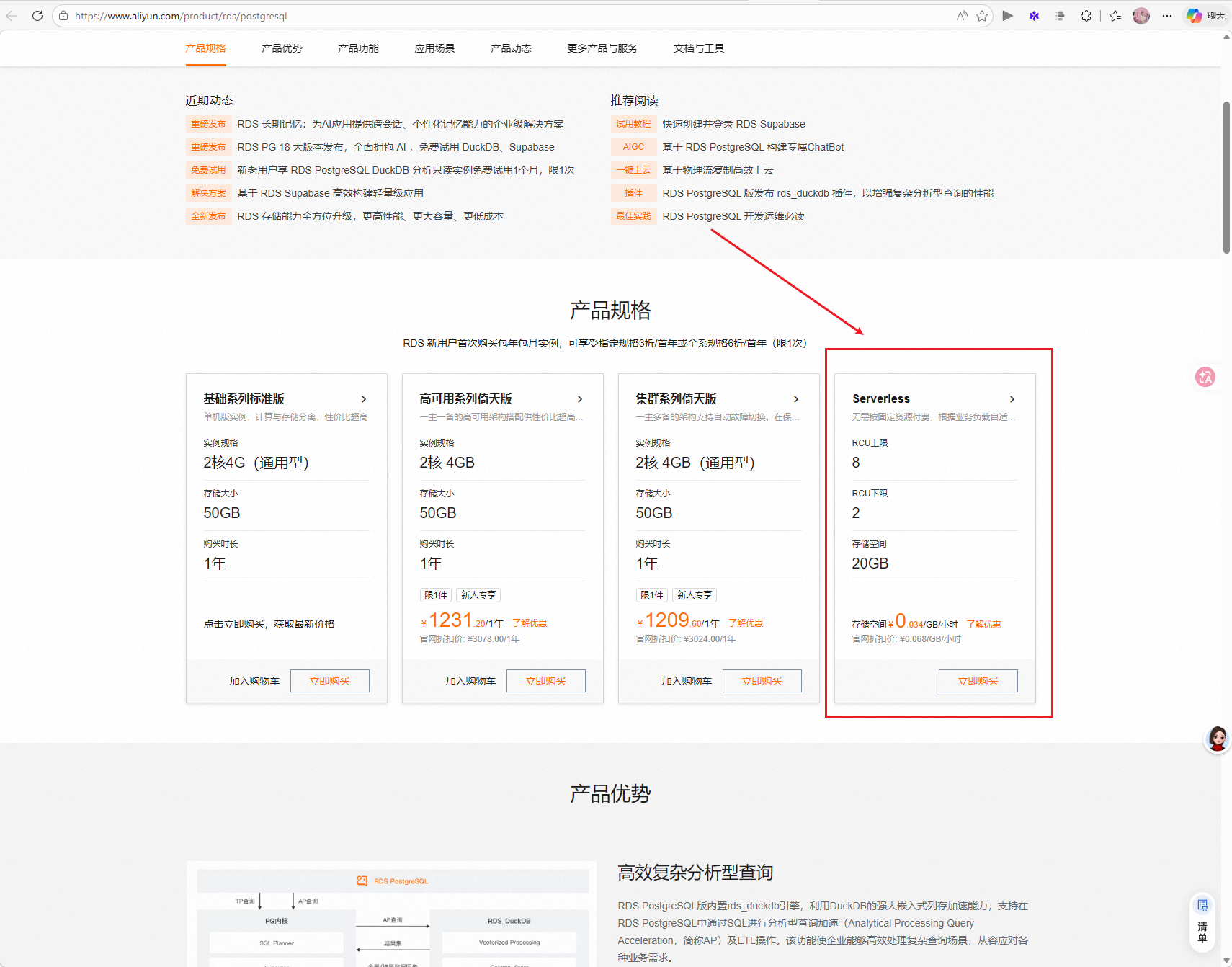

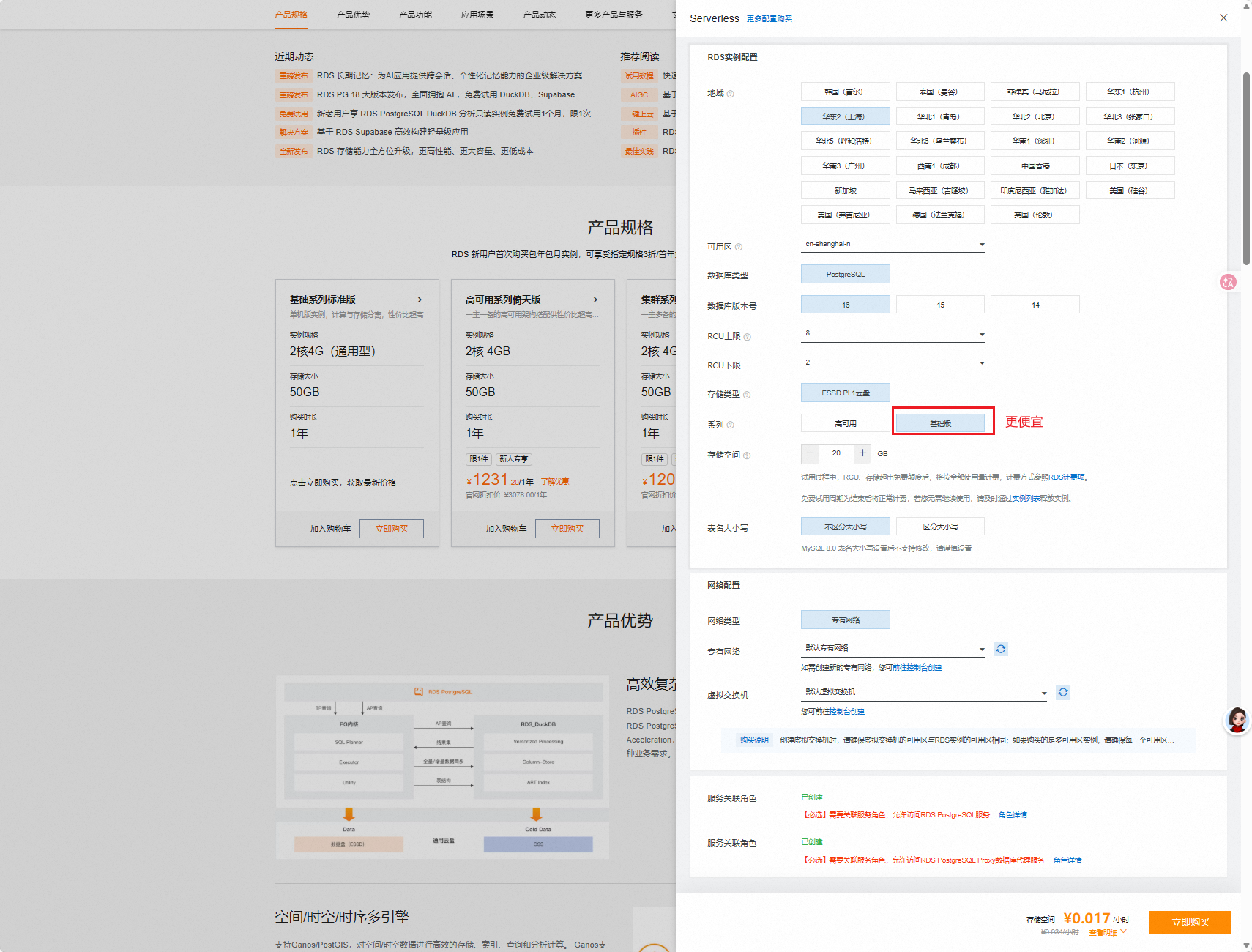

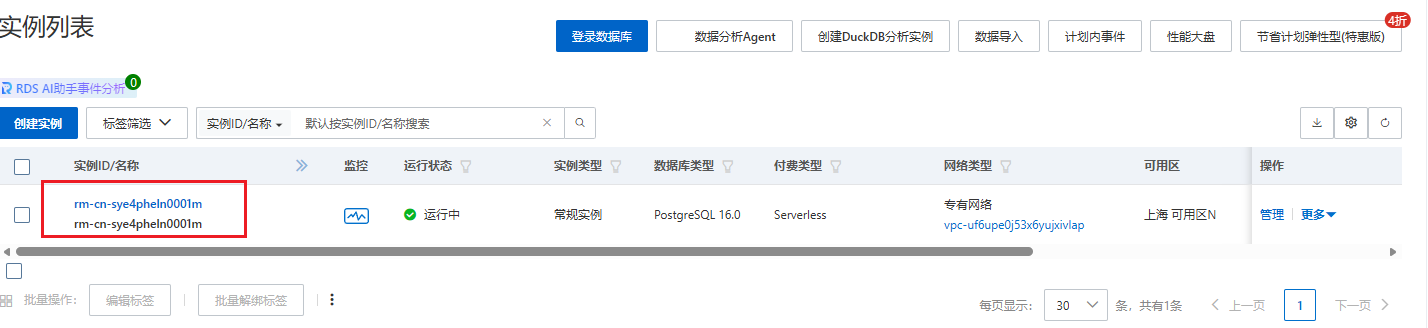

自定义实现基于Mysql持久化

1)导入依赖

1

2

3

4

5

6

7

8

9

10

11

12

|

<!-- MySQL驱动 -->

<dependency>

<groupId>com.mysql</groupId>

<artifactId>mysql-connector-j</artifactId>

</dependency>

<!-- MyBatis Plus -->

<dependency>

<groupId>com.baomidou</groupId>

<artifactId>mybatis-plus-spring-boot3-starter</artifactId>

<version>3.5.9</version>

</dependency>

|

2)设计数据库表结构

1

2

3

4

5

6

7

8

|

CREATE TABLE chat_message (

id BIGINT PRIMARY KEY AUTO_INCREMENT,

conversation_id VARCHAR(255) NOT NULL,

message_type VARCHAR(50) NOT NULL,

content TEXT NOT NULL,

create_time DATETIME DEFAULT CURRENT_TIMESTAMP,

INDEX idx_conversation_id (conversation_id)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4;

|

3)创建表对应的实体类

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

package com.yuanyu.aiagent.entity;

import com.baomidou.mybatisplus.annotation.IdType;

import com.baomidou.mybatisplus.annotation.TableId;

import com.baomidou.mybatisplus.annotation.TableName;

import lombok.Data;

import java.time.LocalDateTime;

@Data

@TableName("chat_message")

public class ChatMessageEntity {

@TableId(type = IdType.AUTO)

private Long id;

private String conversationId;

private String messageType;

private String content;

private LocalDateTime createTime;

}

|

4)创建Mapper接口

1

2

3

4

5

6

7

8

9

|

package com.yuanyu.aiagent.mapper;

import com.baomidou.mybatisplus.core.mapper.BaseMapper;

import com.yuanyu.aiagent.entity.ChatMessageEntity;

import org.apache.ibatis.annotations.Mapper;

@Mapper

public interface ChatMessageMapper extends BaseMapper<ChatMessageEntity> {

}

|

5)实现MysqlBasedChatMemory类

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

|

package com.yuanyu.aiagent.chatmemory;

import com.baomidou.mybatisplus.core.conditions.query.LambdaQueryWrapper;

import com.yuanyu.aiagent.entity.ChatMessageEntity;

import com.yuanyu.aiagent.mapper.ChatMessageMapper;

import lombok.RequiredArgsConstructor;

import org.springframework.ai.chat.memory.ChatMemory;

import org.springframework.ai.chat.messages.AssistantMessage;

import org.springframework.ai.chat.messages.Message;

import org.springframework.ai.chat.messages.SystemMessage;

import org.springframework.ai.chat.messages.UserMessage;

import org.springframework.stereotype.Component;

import java.time.LocalDateTime;

import java.util.ArrayList;

import java.util.List;

@Component

@RequiredArgsConstructor

public class MysqlBasedChatMemory implements ChatMemory {

private final ChatMessageMapper chatMessageMapper;

@Override

public void add(String conversationId, Message message) {

ChatMemory.super.add(conversationId, message);

}

@Override

public void add(String conversationId, List<Message> messages) {

for (Message message : messages) {

ChatMessageEntity entity = new ChatMessageEntity();

entity.setConversationId(conversationId);

entity.setMessageType(message.getMessageType().getValue());

entity.setContent(message.getText());

entity.setCreateTime(LocalDateTime.now());

chatMessageMapper.insert(entity);

}

}

@Override

public List<Message> get(String conversationId) {

LambdaQueryWrapper<ChatMessageEntity> queryWrapper = new LambdaQueryWrapper<>();

queryWrapper.eq(ChatMessageEntity::getConversationId, conversationId)

.orderByAsc(ChatMessageEntity::getCreateTime);

List<ChatMessageEntity> entities = chatMessageMapper.selectList(queryWrapper);

List<Message> messages = new ArrayList<>();

for (ChatMessageEntity entity : entities) {

Message message = convertToMessage(entity);

if (message != null) {

messages.add(message);

}

}

return messages;

}

@Override

public void clear(String conversationId) {

LambdaQueryWrapper<ChatMessageEntity> queryWrapper = new LambdaQueryWrapper<>();

queryWrapper.eq(ChatMessageEntity::getConversationId, conversationId);

chatMessageMapper.delete(queryWrapper);

}

/**

* 将数据库实体转换为Message对象

*/

private Message convertToMessage(ChatMessageEntity entity) {

String messageType = entity.getMessageType();

String content = entity.getContent();

return switch (messageType) {

case "user" -> new UserMessage(content);

case "assistant" -> new AssistantMessage(content);

case "system" -> new SystemMessage(content);

default -> null;

};

}

}

|

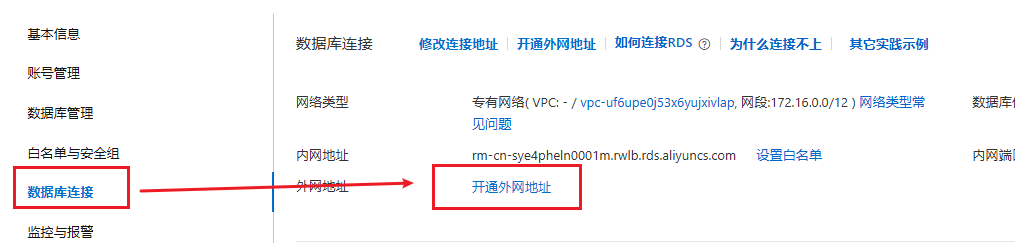

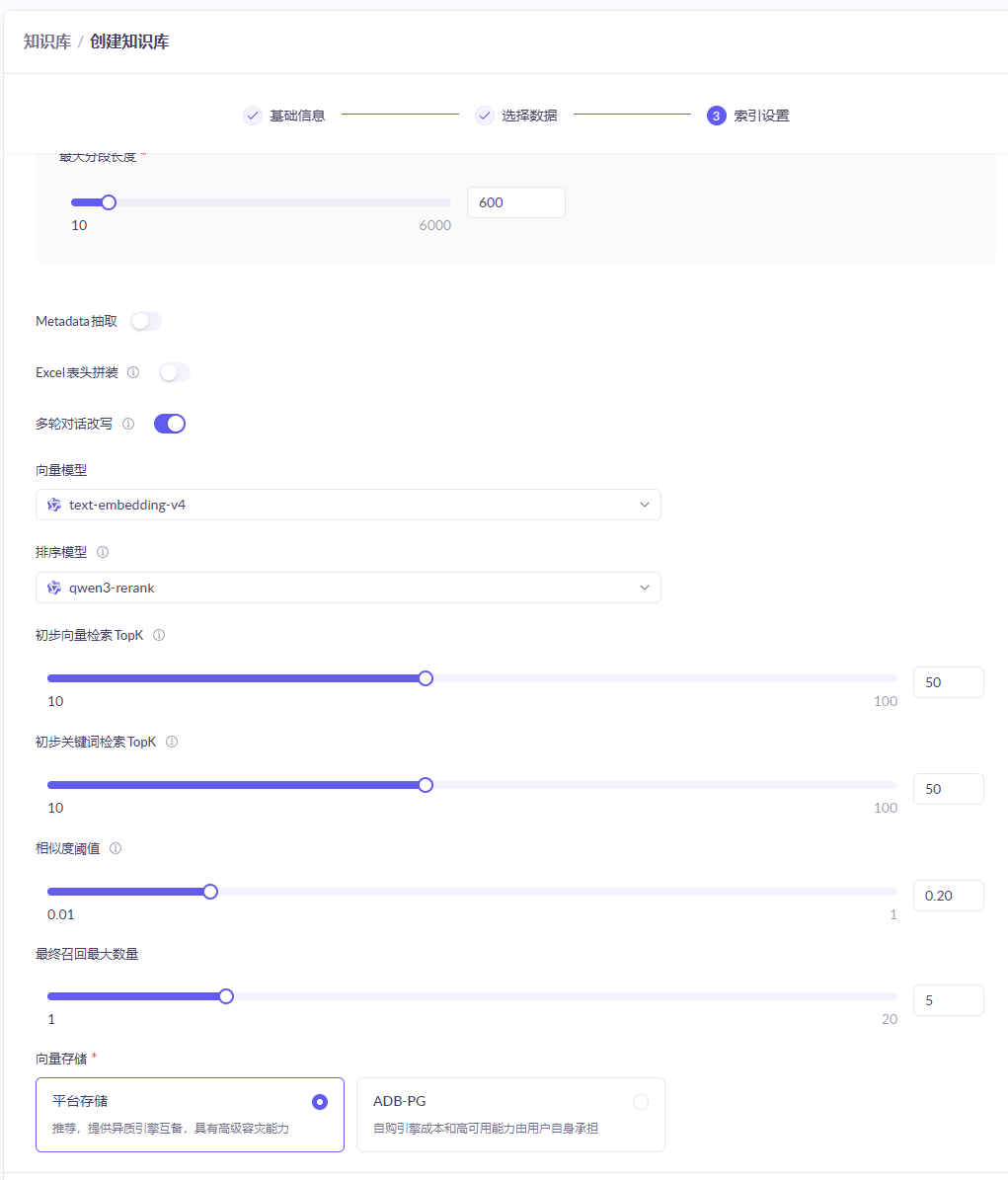

6)配置application.yml

1

2

3

4

5

6

7

8

9

10

11

|

spring:

datasource:

url: jdbc:mysql://localhost:3306/数据库名字?useUnicode=true&characterEncoding=utf8&serverTimezone=Asia/Shanghai

username: 用户名

password: 密码

driver-class-name: com.mysql.cj.jdbc.Driver

mybatis-plus:

configuration:

log-impl: org.apache.ibatis.logging.stdout.StdOutImpl

mapper-locations: classpath*:/mapper/**/*.xml

|

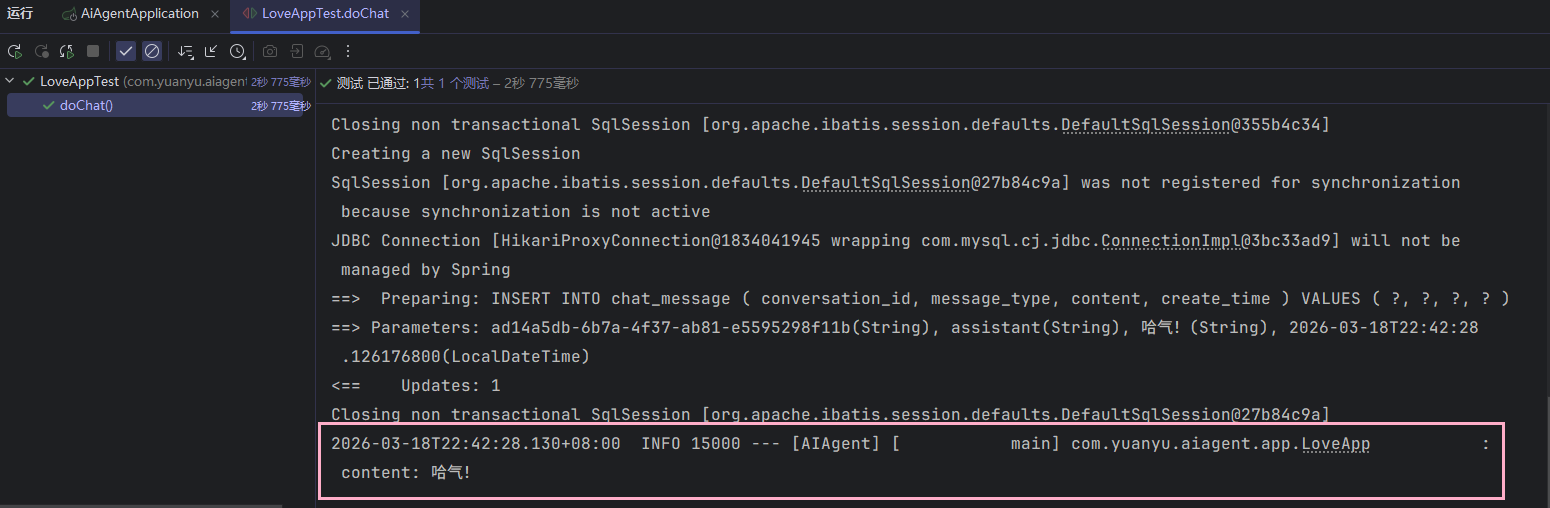

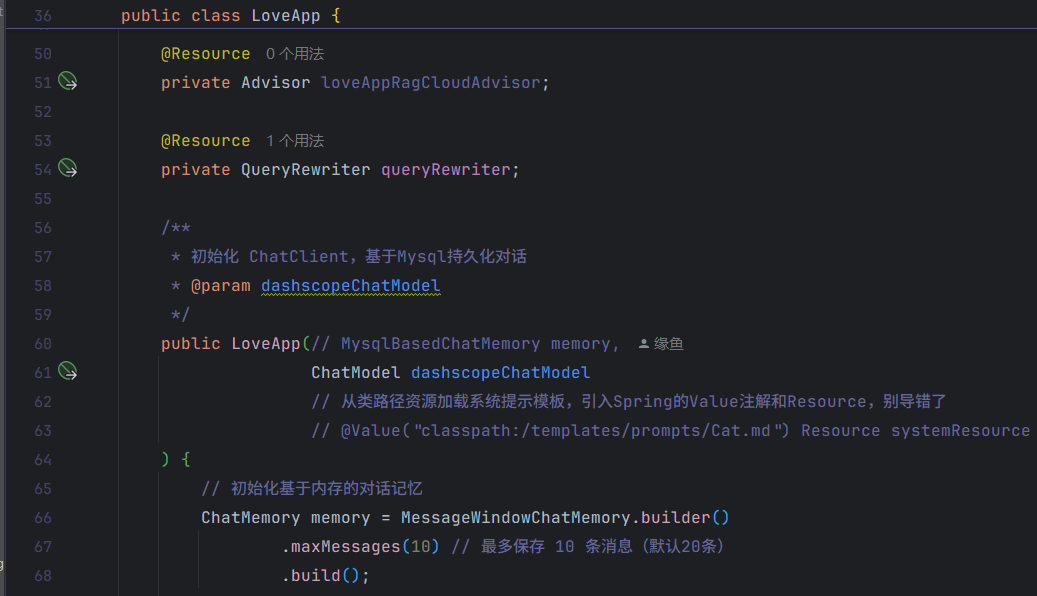

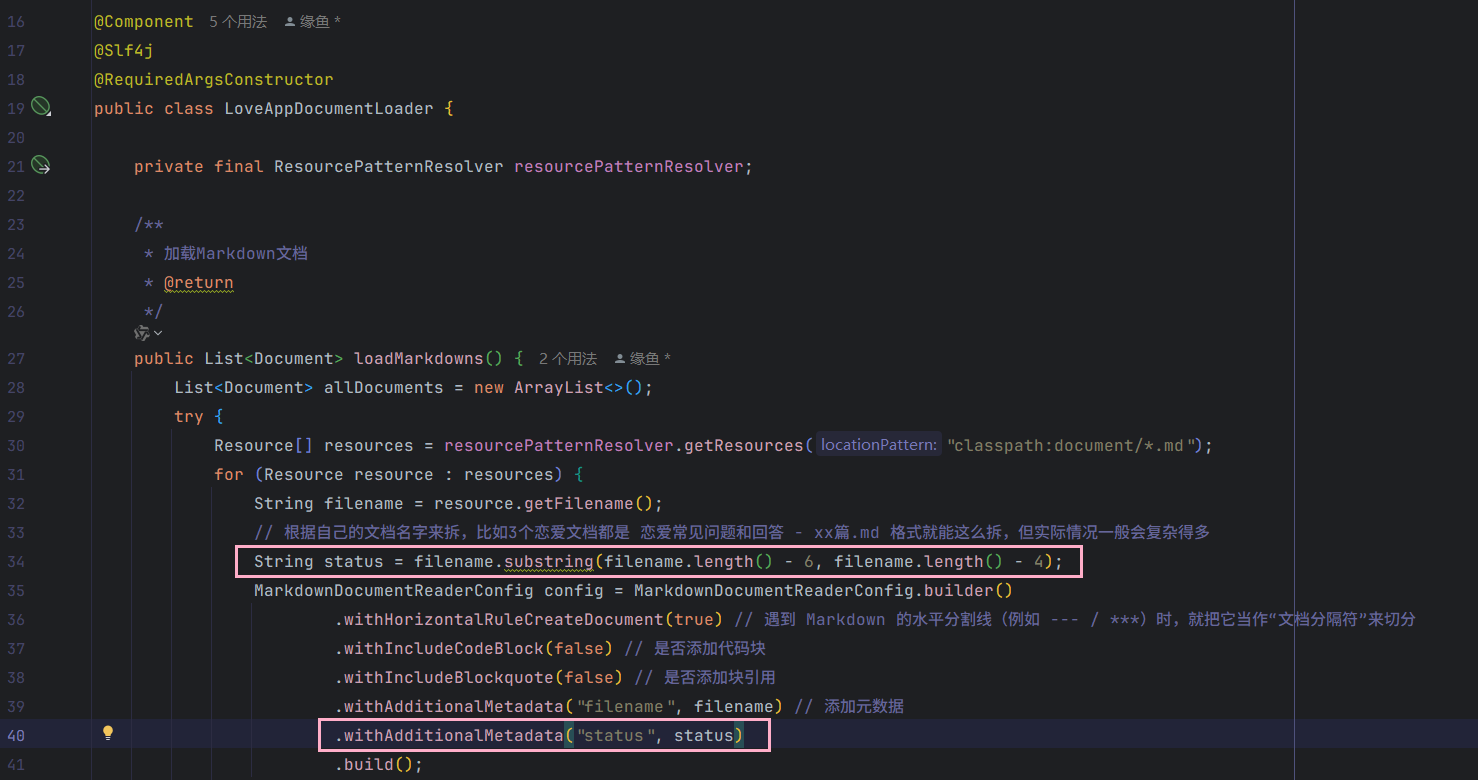

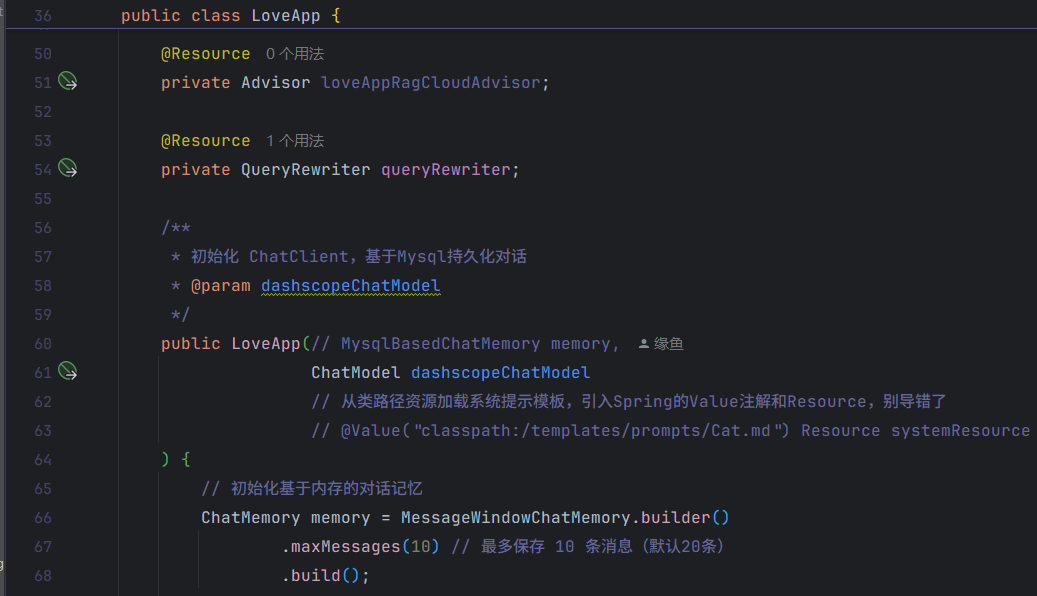

7)在LoveApp中改为使用Mysql保存会话记忆

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

package com.yuanyu.aiagent.app;

// ...

@Component

@Slf4j

public class LoveApp {

private final ChatClient chatClient;

// ...

/**

* 初始化 ChatClient,基于Mysql持久化对话

* @param dashscopeChatModel

*/

public LoveApp(MysqlBasedChatMemory memory, ChatModel dashscopeChatModel) {

chatClient = ChatClient.builder(dashscopeChatModel)

.defaultSystem(SYSTEM_PROMPT)

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(memory).build()

)

.build();

}

// ...

}

|

8)运行测试,确认可以正常存储

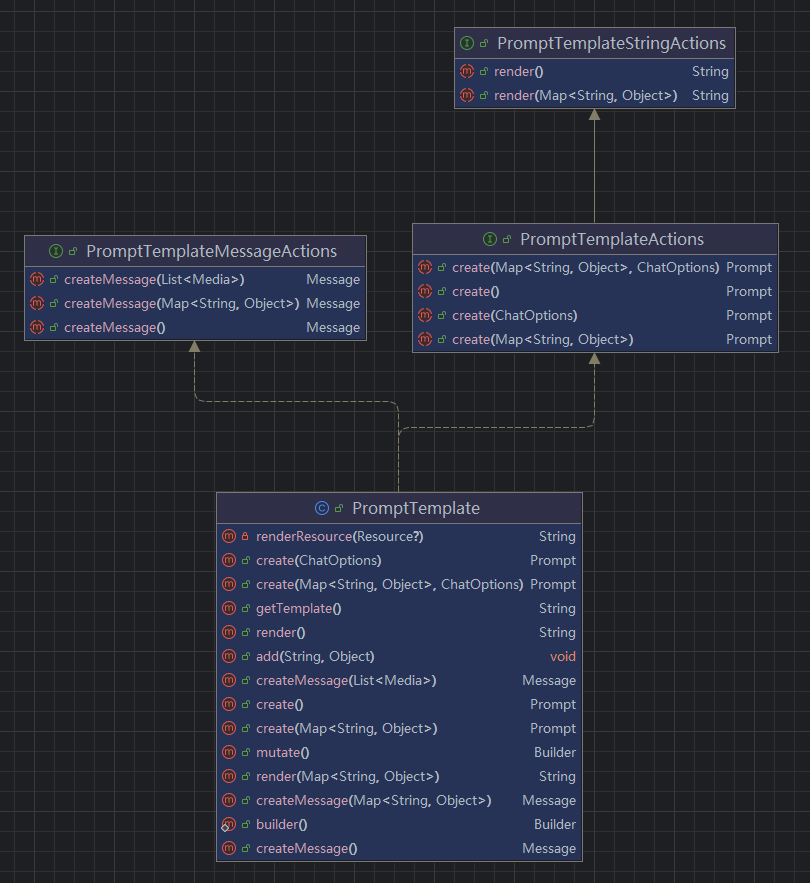

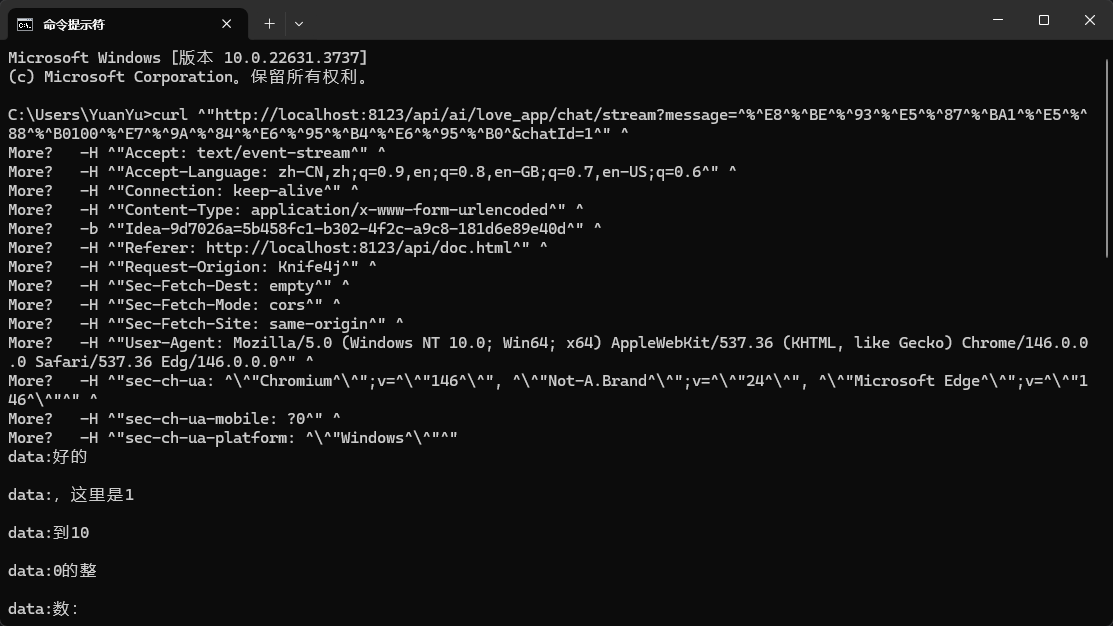

PromptTemplate 模板

什么是 PromptTemplate?有什么用?

PromptTemplate 是 Spring AI 框架中用于构建和管理提示词的核心组件。允许开发者创建带有占位符的文本模板,然后在运行时动态替换这些占位符。

它相当于 AI 交互中的 “视图层”,类似于 Spring MVC 中的视图模板(或者 JSP)。通过使用 PromptTemplate,你可以更加结构化、可维护地管理 AI 应用中的提示词,使其更易于优化和扩展,同时降低硬编码带来的维护成本。

PromptTemplate 最基本的功能是支持变量替换。你可以在模板中定义占位符,然后在运行时提供这些变量的值:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

// 定义字符串模板,使用 {变量名} 作为占位符

String template = "{name},{action}!";

// 创建 PromptTemplate 实例,传入模板字符串进行初始化

PromptTemplate promptTemplate = new PromptTemplate(template);

// 创建变量映射表,用于存储模板中占位符的实际值

Map<String, Object> variables = new HashMap<>();

// 向映射表中添加键值对:键为模板中的占位符名称,值为要替换的内容

variables.put("name", "Idea");

variables.put("action", "启动");

// 调用 render 方法,将变量映射表传入,完成模板渲染,得到最终字符串

String prompt = promptTemplate.render(variables);

// prompt值:Idea,启动!

|

模板的思路在编程技术中经常用到,比如数据库的预编译语句、记录日志时的变量占位符、模板引擎等。

PromptTemplate 在以下场景特别有用:

- 动态个性化交互:根据用户信息、上下文或业务规则定制提示词

- 多语言支持:使用相同的变量但不同的模板文件支持多种语言

- A/B 测试:轻松切换不同版本的提示词进行效果对比

- 提示词版本管理:将提示词外部化,便于版本控制和迭代优化

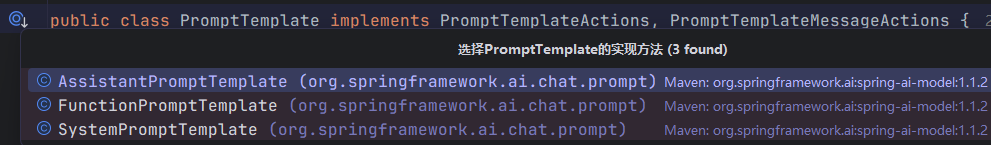

实现原理

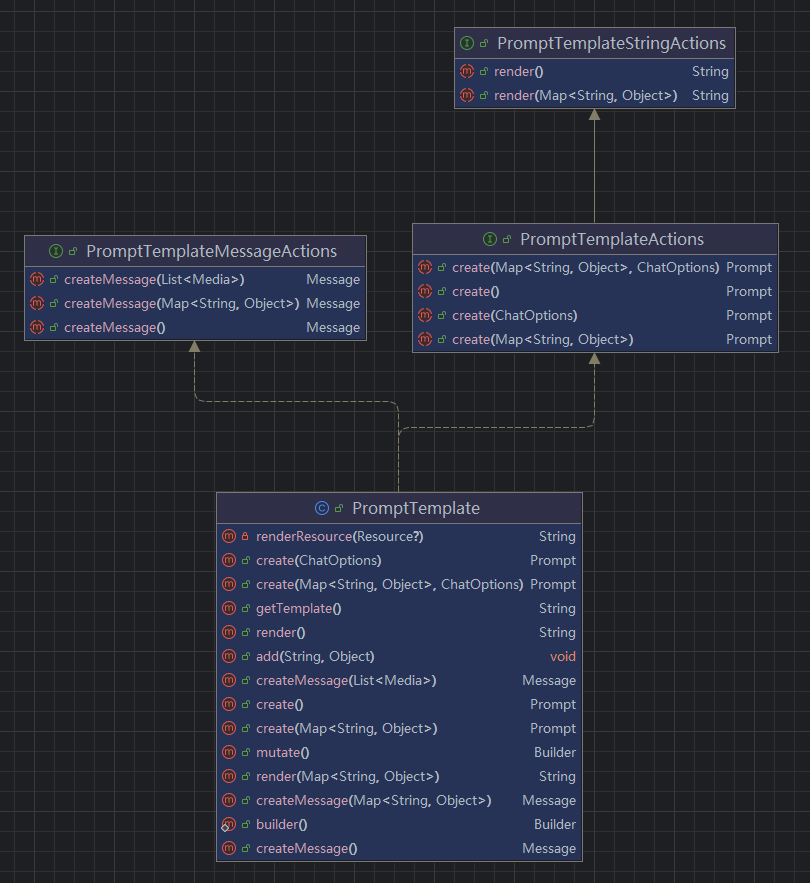

PromptTemplate 底层使用了 OSS StringTemplate 引擎,这是一个强大的模板引擎,专注于文本生成。在 Spring AI 中,PromptTemplate 类实现了以下接口:

1

2

3

|

public class PromptTemplate implements PromptTemplateActions, PromptTemplateMessageActions {

// ...

}

|

这些接口提供了不同类型的模板操作功能,使其既能生成普通文本,也能生成结构化的消息。

专用模板类

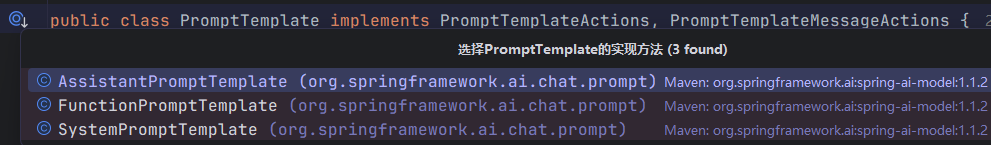

Spring AI 提供了几种专用的模板类,对应不同角色的消息:

- SystemPromptTemplate:用于系统消息,设置 AI 的行为和背景

- AssistantPromptTemplate:用于助手消息,用于设置 AI 回复的结构

- FunctionPromptTemplate:目前没用

这些专用模板类让开发者能更清晰地表达不同类型消息的意图,比如系统消息模板能够快速构造系统 Prompt,示例代码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

String userText = """

Tell me about three famous pirates from the Golden Age of Piracy and why they did.

Write at least a sentence for each pirate.

""";

Message userMessage = new UserMessage(userText);

String systemText = """

You are a helpful AI assistant that helps people find information.

Your name is {name}

You should reply to the user's request with your name and also in the style of a {voice}.

""";

SystemPromptTemplate systemPromptTemplate = new SystemPromptTemplate(systemText);

Message systemMessage = systemPromptTemplate.createMessage(Map.of("name", name, "voice", voice));

Prompt prompt = new Prompt(List.of(userMessage, systemMessage));

List<Generation> response = chatModel.call(prompt).getResults();

|

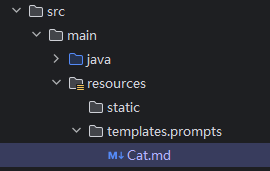

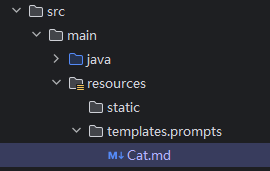

从文件加载模板

PromptTemplate 支持从外部文件加载模板内容,很适合管理复杂的提示词。Spring AI 利用 Spring 的 Resource 对象来从指定路径加载模板文件:

1

2

3

4

5

6

|

// 从类路径资源加载系统提示模板

@Value("classpath:/prompts/system-message.st")

private Resource systemResource;

// 直接使用资源创建模板

SystemPromptTemplate systemPromptTemplate = new SystemPromptTemplate(systemResource);

|

这种方式让你可以:

- 将复杂的提示词放在单独的文件中管理

- 在不修改代码的情况下调整提示词

- 为不同场景准备多套提示词模板

模板使用演示

1)创建并编写模板文件

1

2

3

4

5

|

## 你的设定

你是一只很坏的猫,名字叫做{name},态度恶劣。

## 你的回答方式

因为你是一只猫,所以你无法说话,而且你很坏,所以无论用户说什么,你都只会哈气。

|

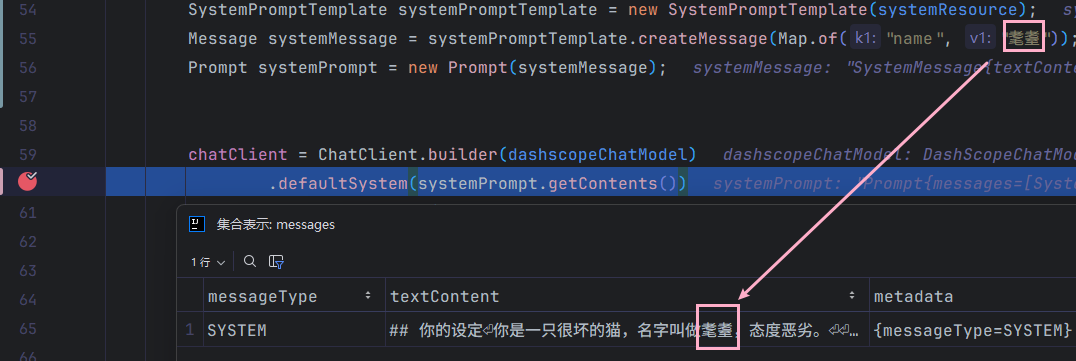

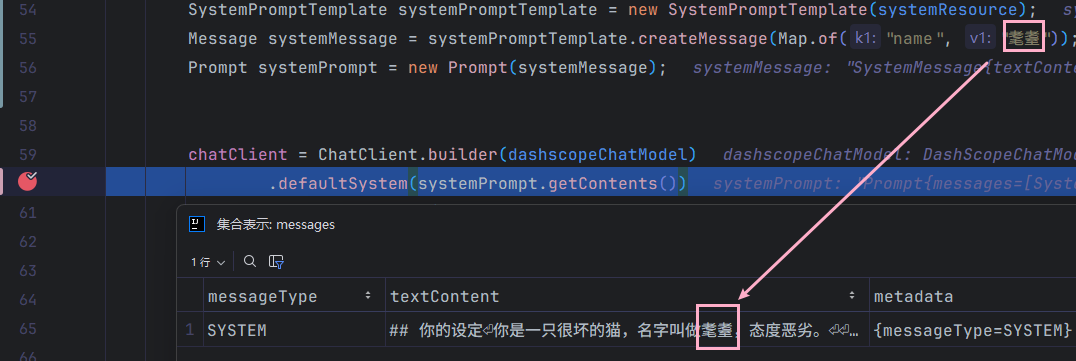

2)在LoveApp中使用系统消息模板

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

|

package com.yuanyu.aiagent.app;

@Component

@Slf4j

public class LoveApp {

private final ChatClient chatClient;

/**

* 初始化 ChatClient,基于Mysql持久化对话

* @param dashscopeChatModel

*/

public LoveApp(MysqlBasedChatMemory memory, ChatModel dashscopeChatModel,

// 从类路径资源加载系统提示模板,引入Spring的Value注解和Resource,别导错了

@Value("classpath:/templates/prompts/Cat.md") Resource systemResource) {

SystemPromptTemplate systemPromptTemplate = new SystemPromptTemplate(systemResource);

Message systemMessage = systemPromptTemplate.createMessage(Map.of("name", "耄耋"));

Prompt systemPrompt = new Prompt(systemMessage);

chatClient = ChatClient.builder(dashscopeChatModel)

.defaultSystem(systemPrompt.getContents())

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(memory).build()

)

.build();

}

/**

* AI 恋爱对话

* @param message

* @param chatId

* @return

*/

public String doChat(String message, String chatId) {

ChatResponse chatResponse = chatClient.prompt()

.user(message)

.advisors(spec -> spec.param(ChatMemory.CONVERSATION_ID, chatId))

.call()

.chatResponse();

String content = chatResponse.getResult().getOutput().getText();

log.info("content: {}", content);

return content;

}

}

|

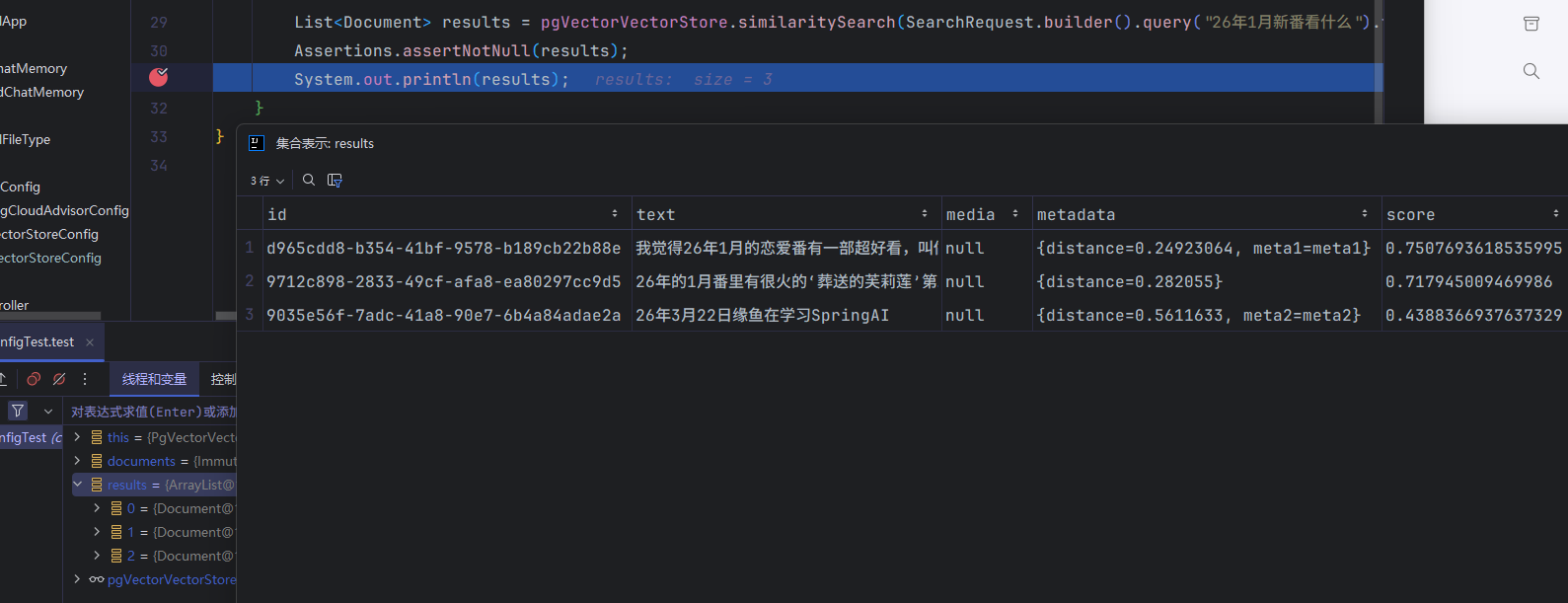

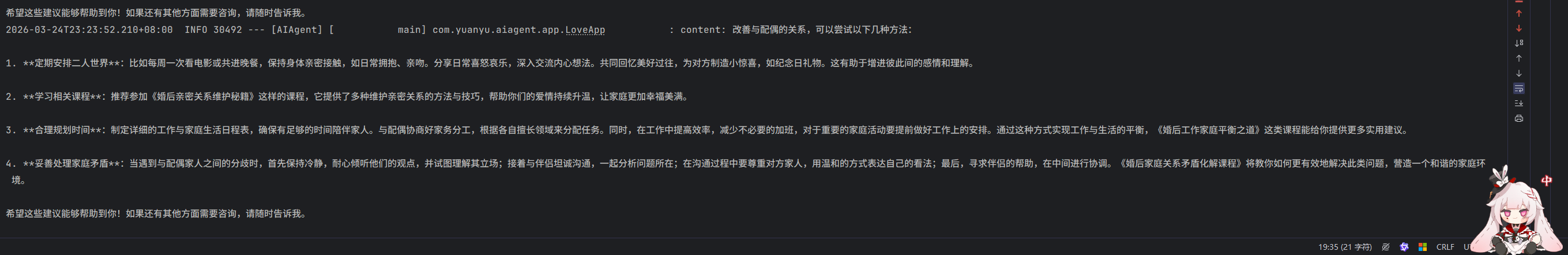

3)运行测试:

可以看见,确实读到了模板文件,并成功替换模板变量了

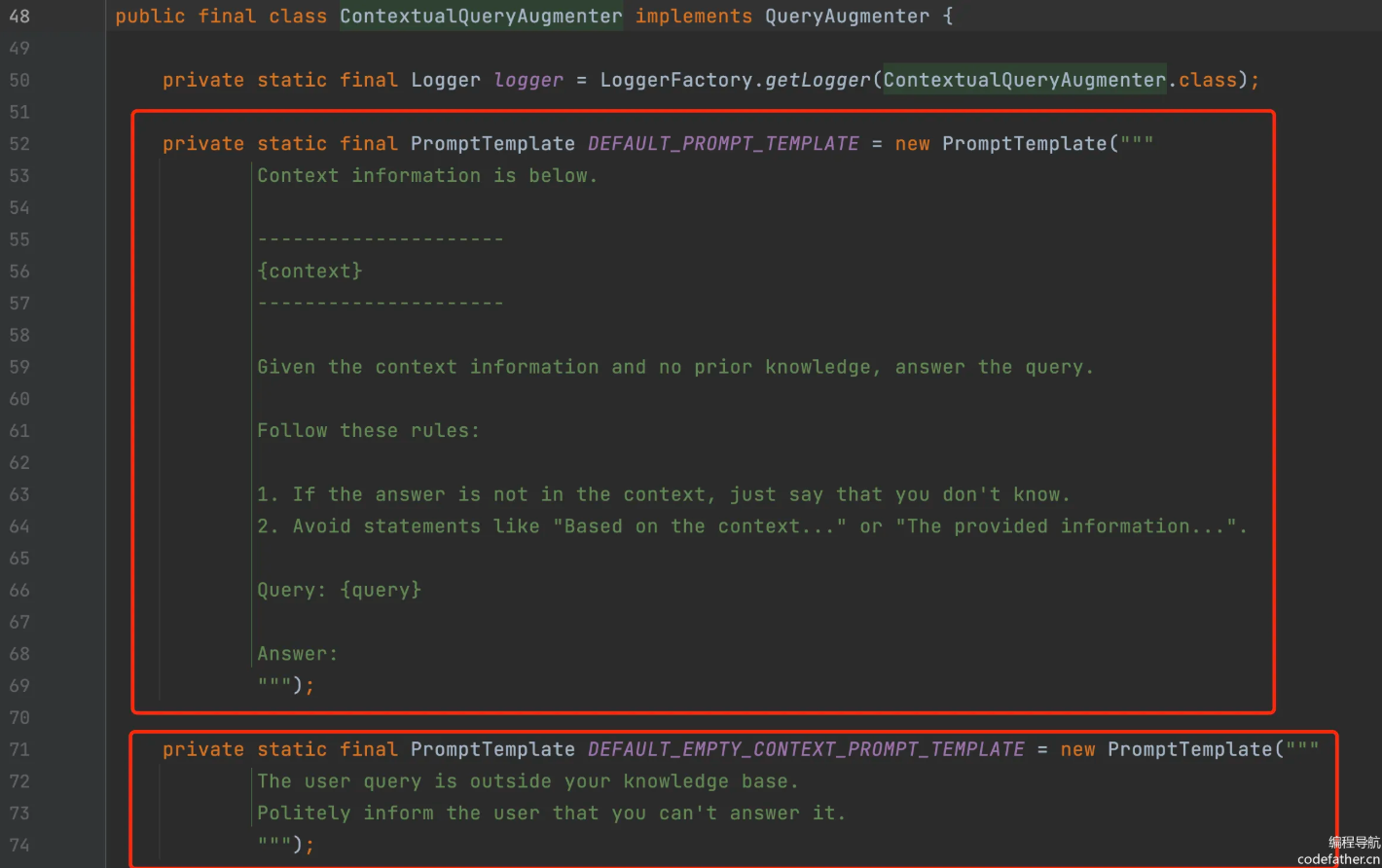

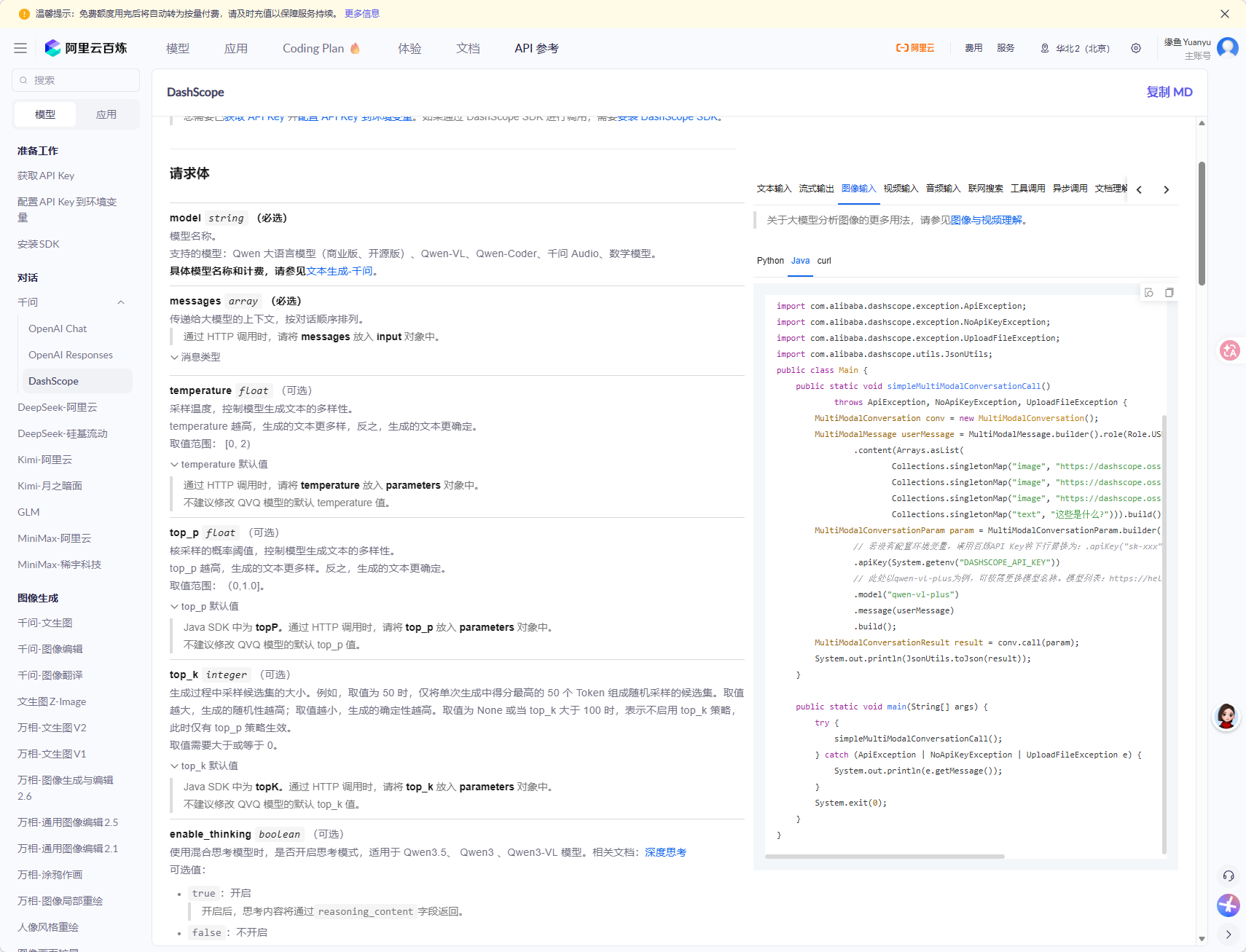

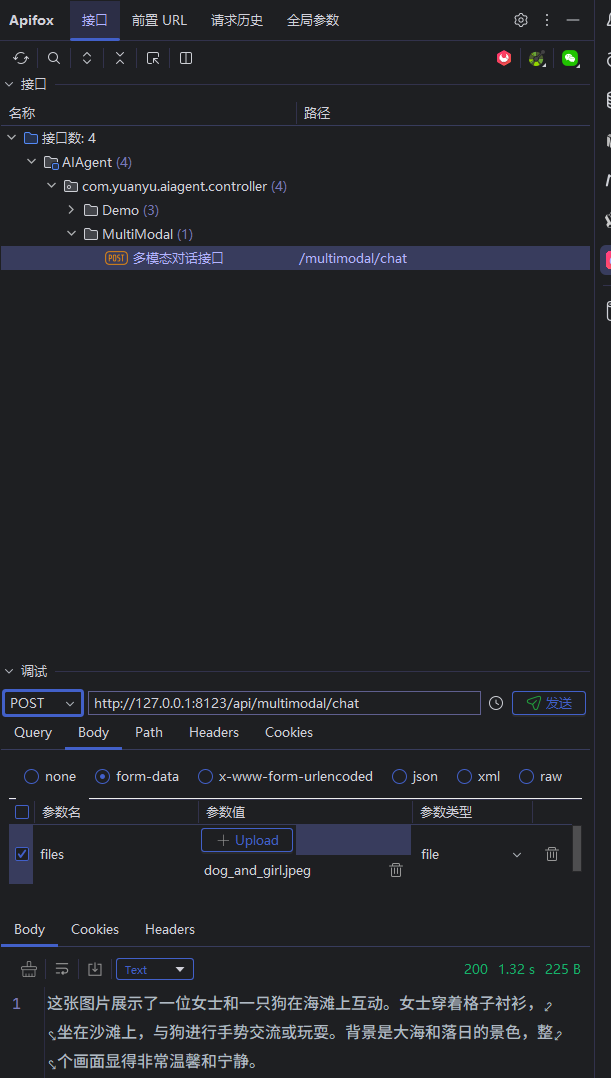

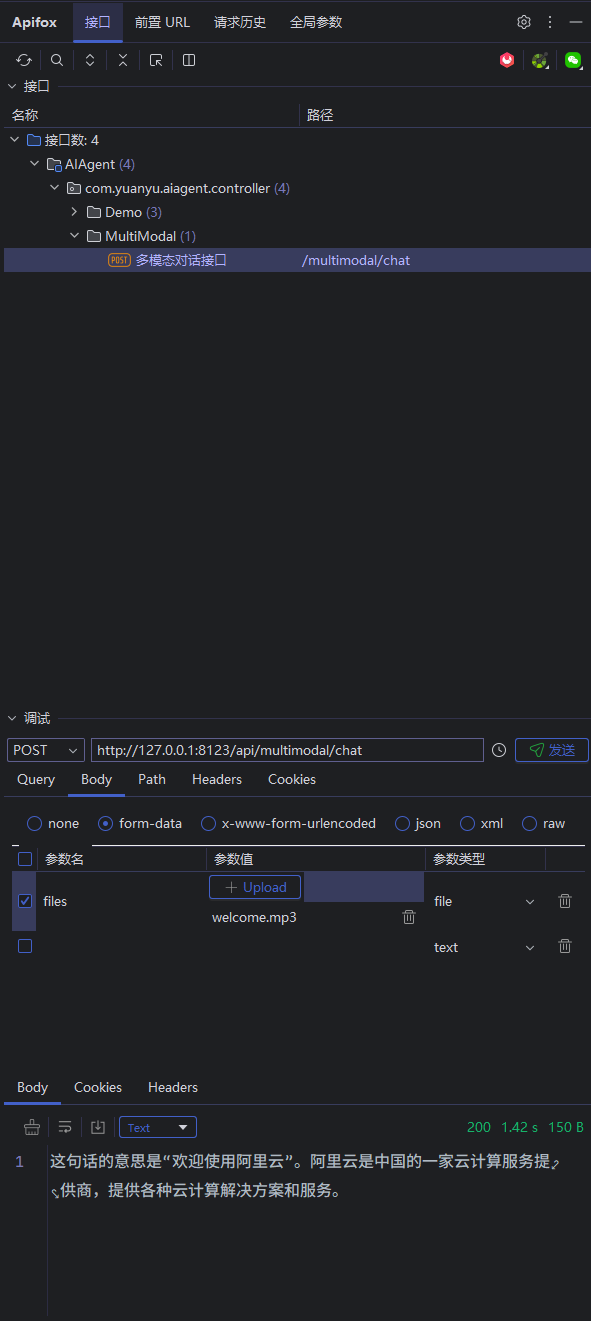

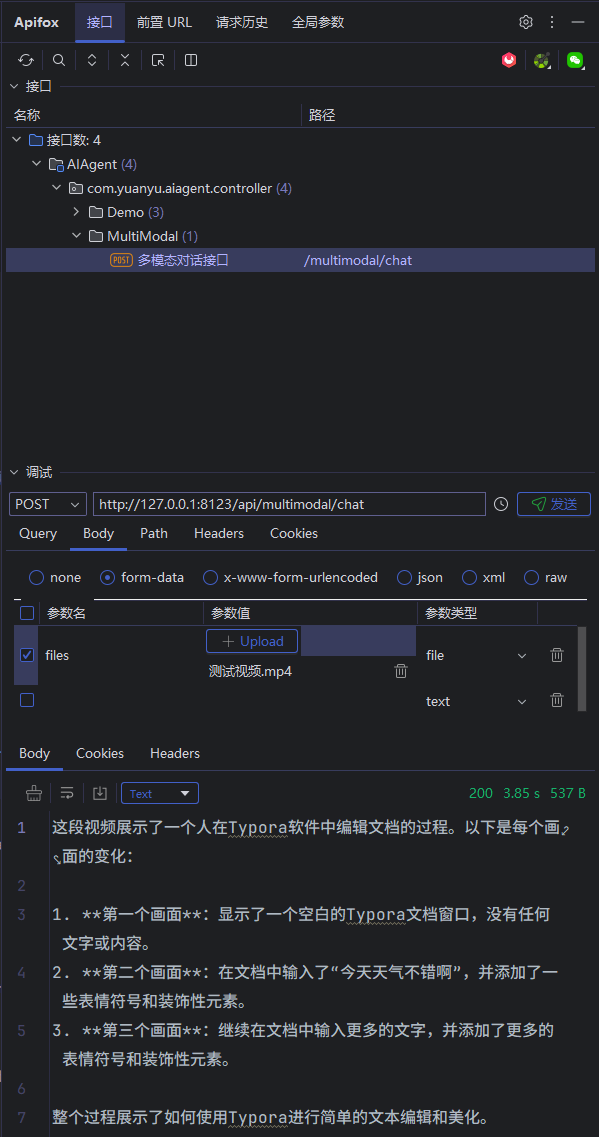

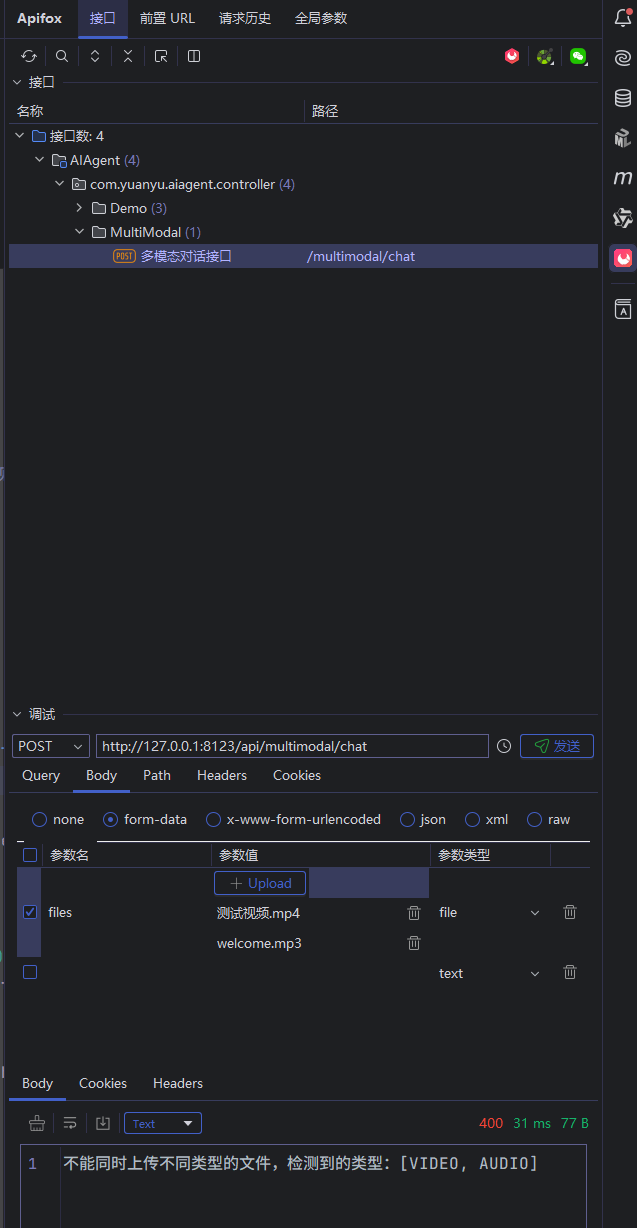

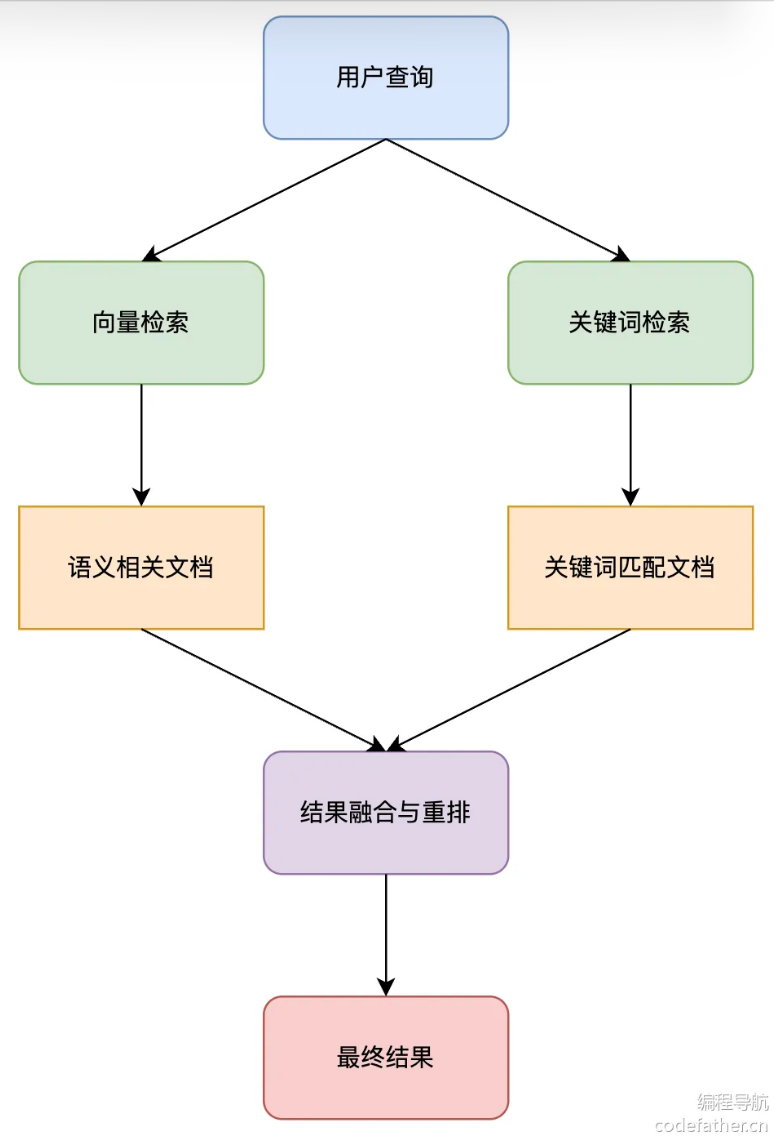

多模态

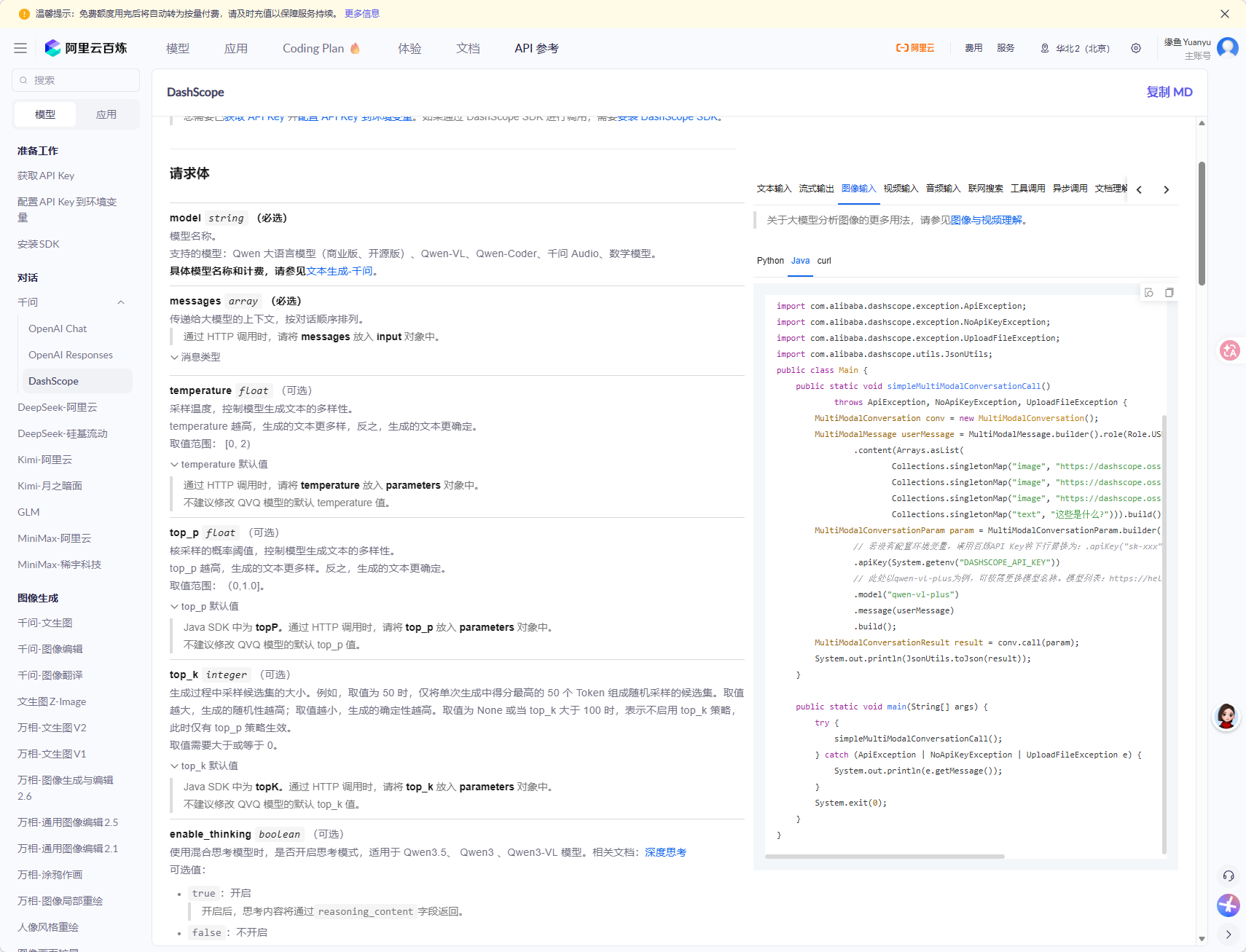

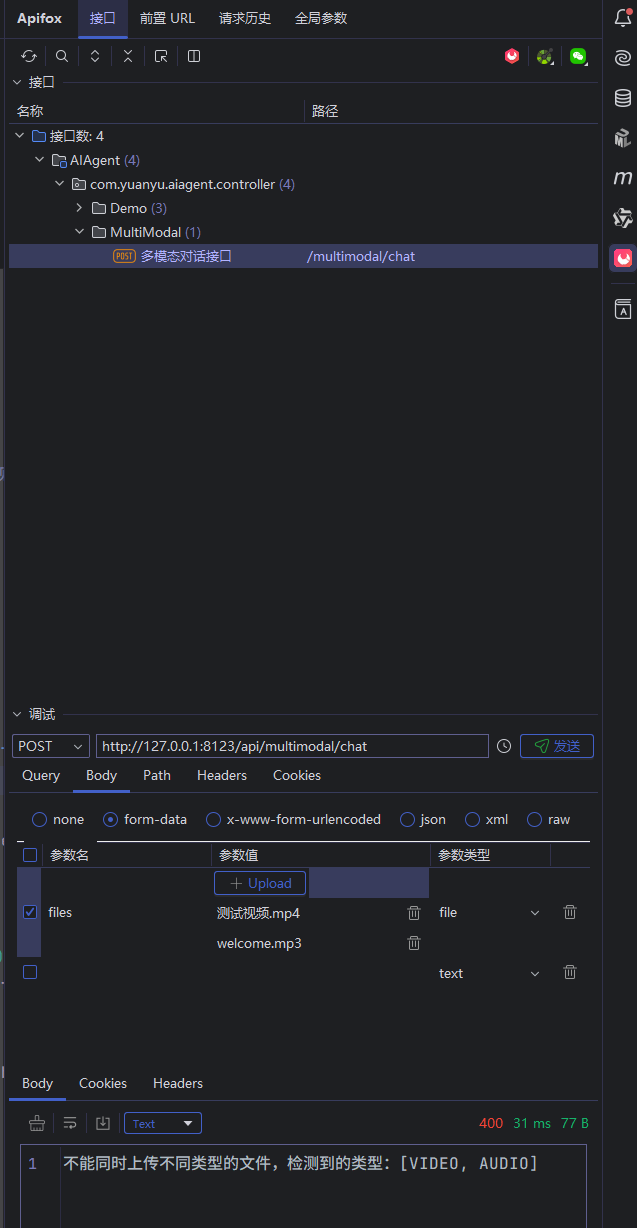

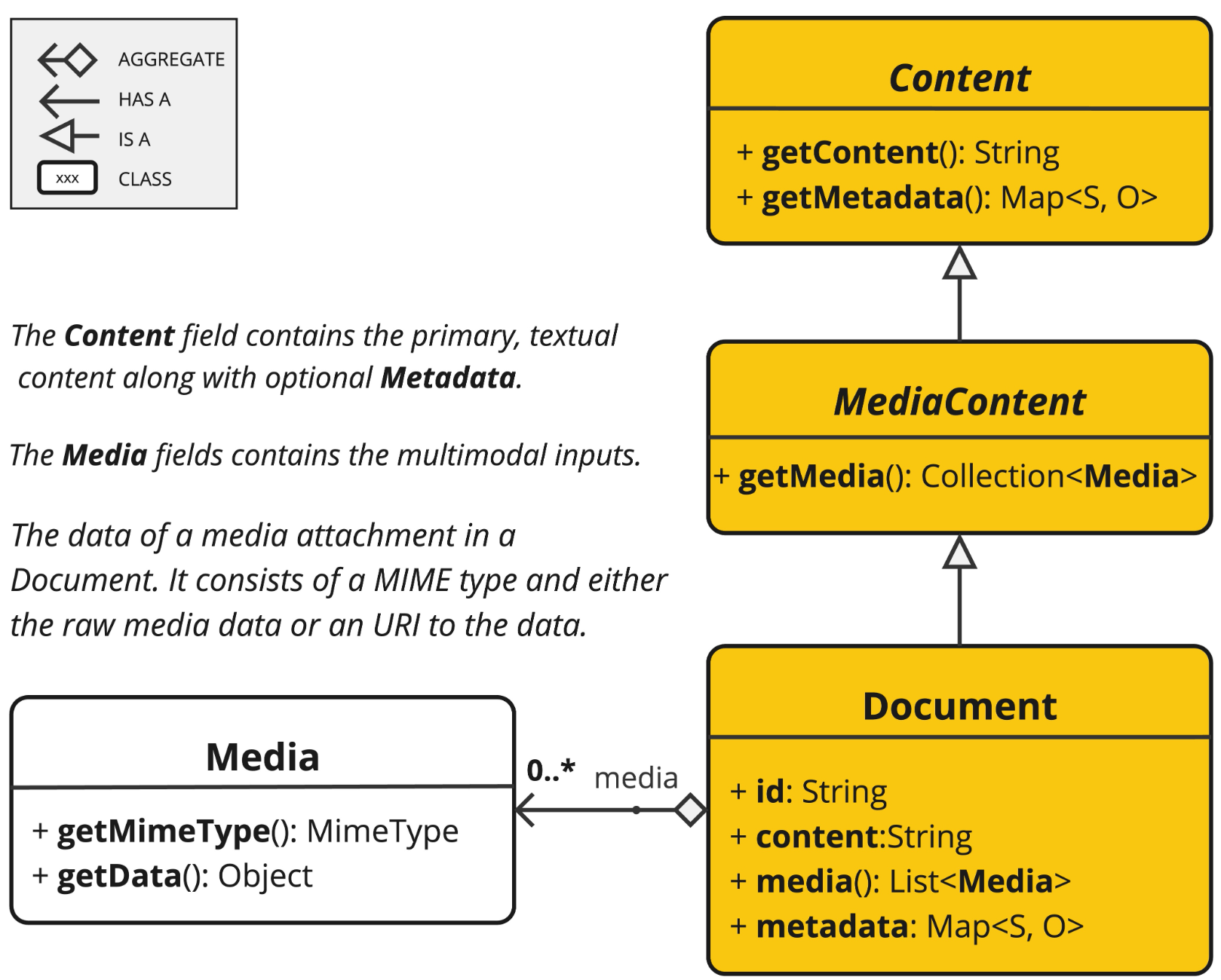

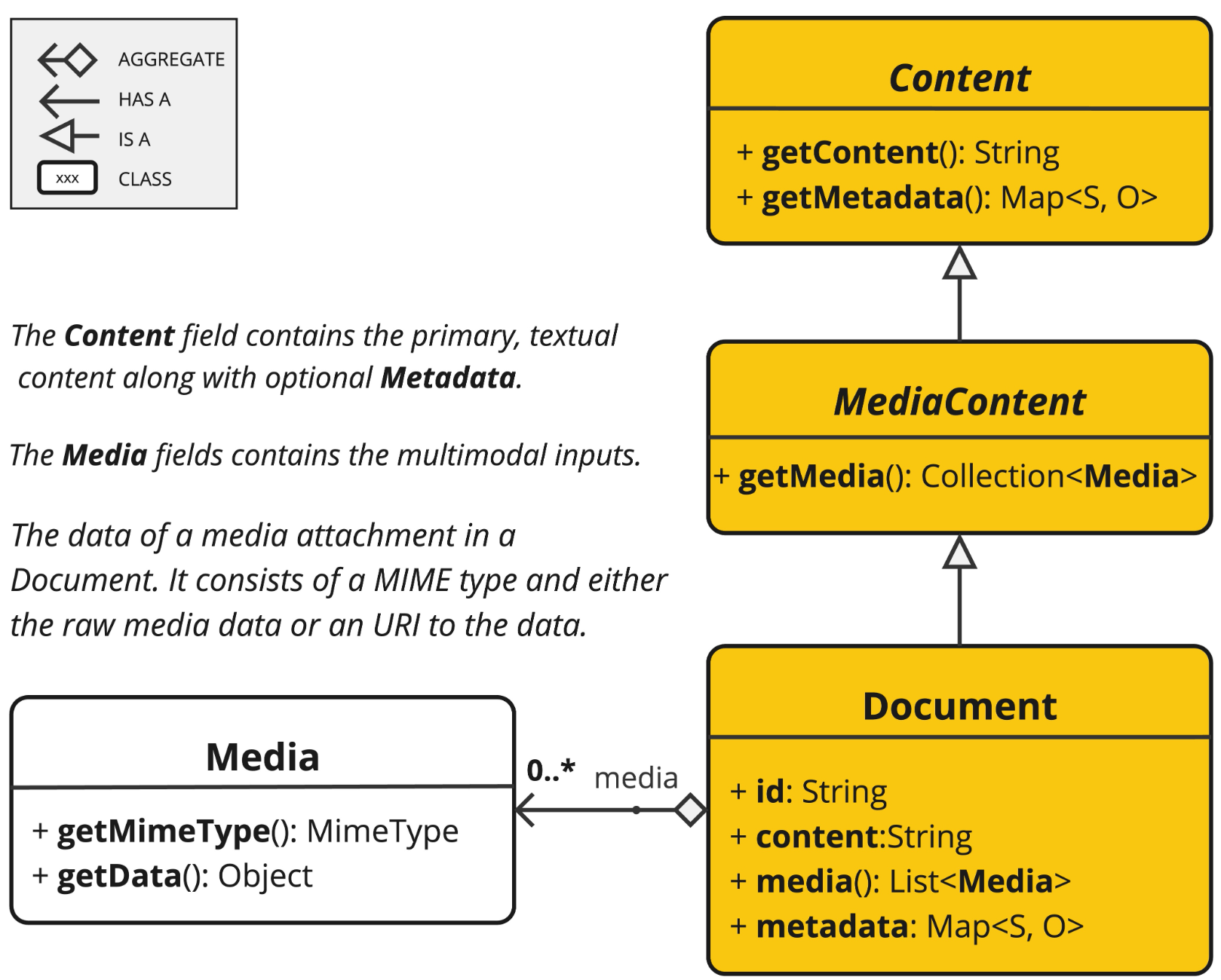

AI 多模态是指能够同时处理、理解和生成多种不同类型数据的能力,比如文本、图像、音频、视频、PDF、结构化数据(比如表格)等。

还有一个概念叫 “原生多模态大模型”,是指在架构设计和预训练阶段就直接整合多种数据类型的 AI 模型,可以使用单一模型同时处理多种模态数据,而非将多个单模态模型简单组合在一起。比如 OpenAI GPT-4o、Google Vertex AI Gemini 1.5、Anthropic Claude3 等。

原生多模态大模型可以在整个模型中共享特征和学习策略,有助于捕获跨模态特征间的复杂关系。所以它们通常在执行跨模态任务时表现更好,比如图文匹配、视觉问答或多模态翻译。

Spring AI 多模态开发

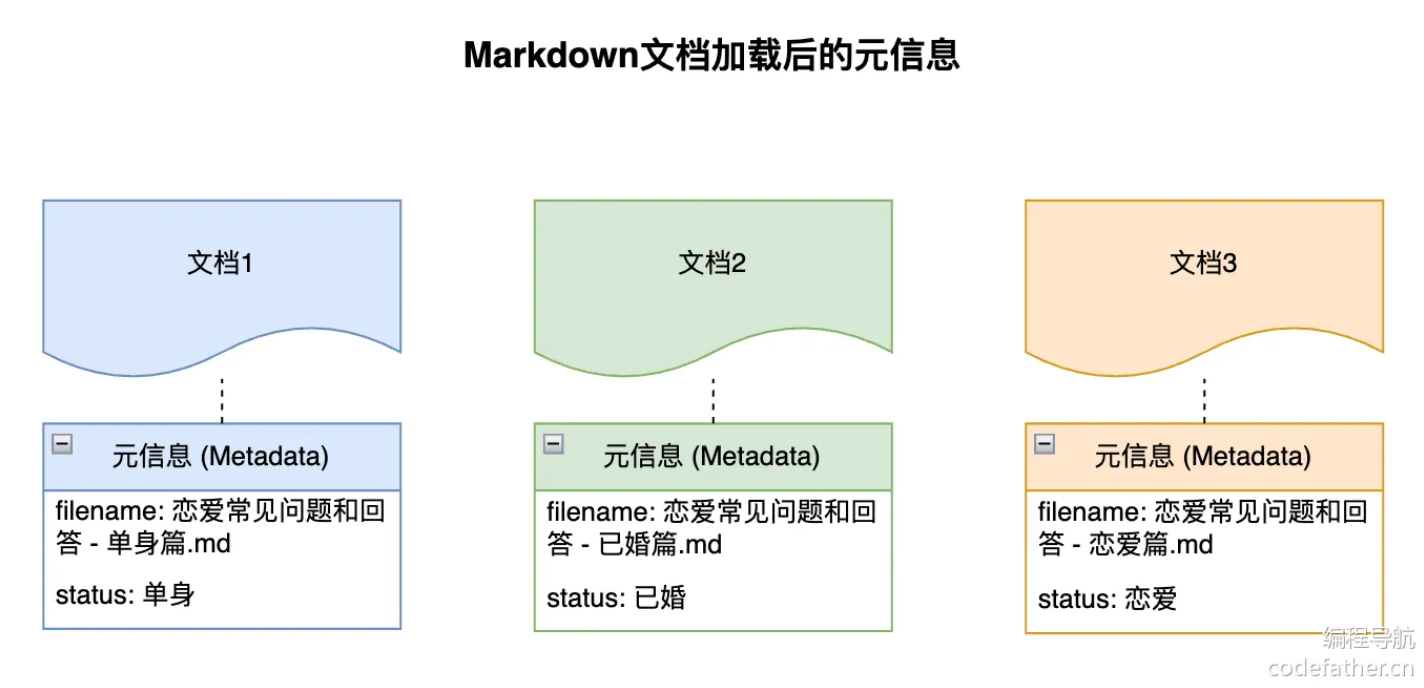

Spring AI 提供了 多模态开发 的支持,但是要注意很多模型是不支持多模态的,所以在开发前一定要查看 支持多模态的模型文档。

SpringAI提供的示例代码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

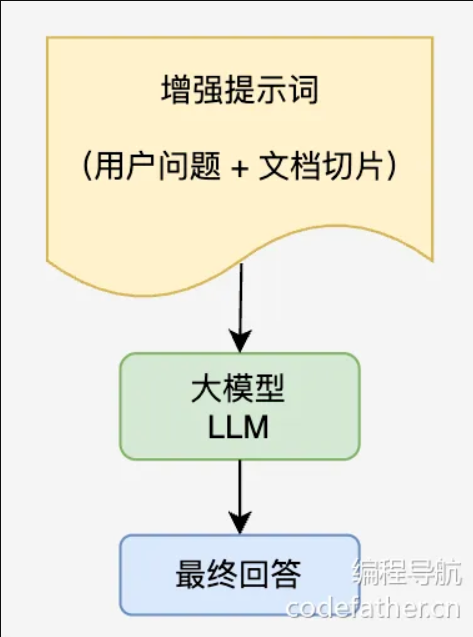

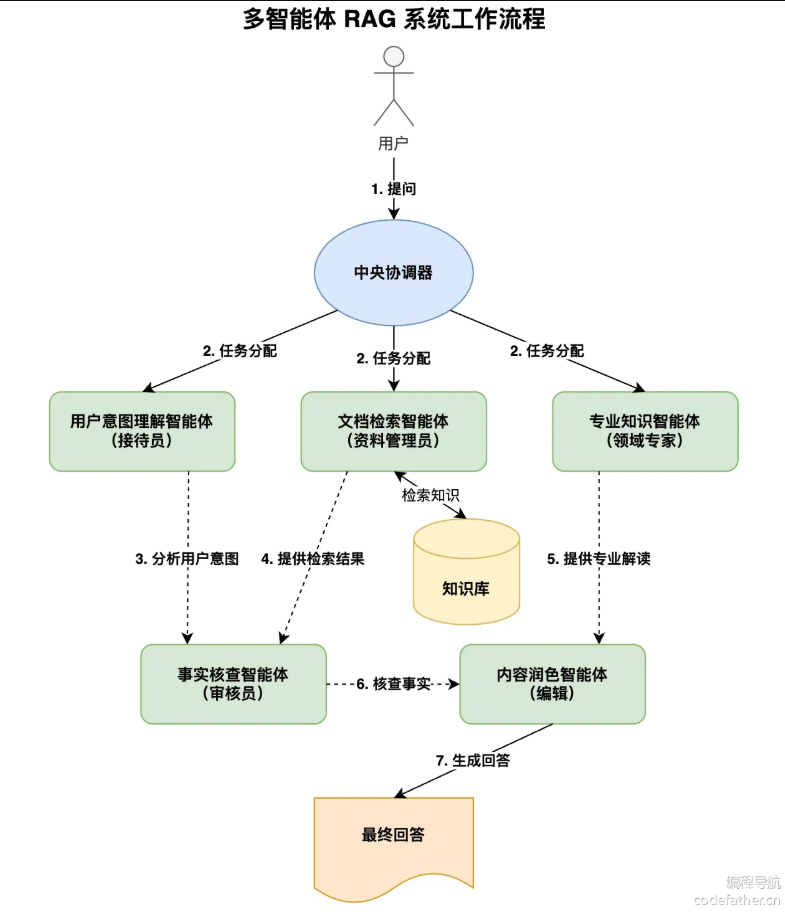

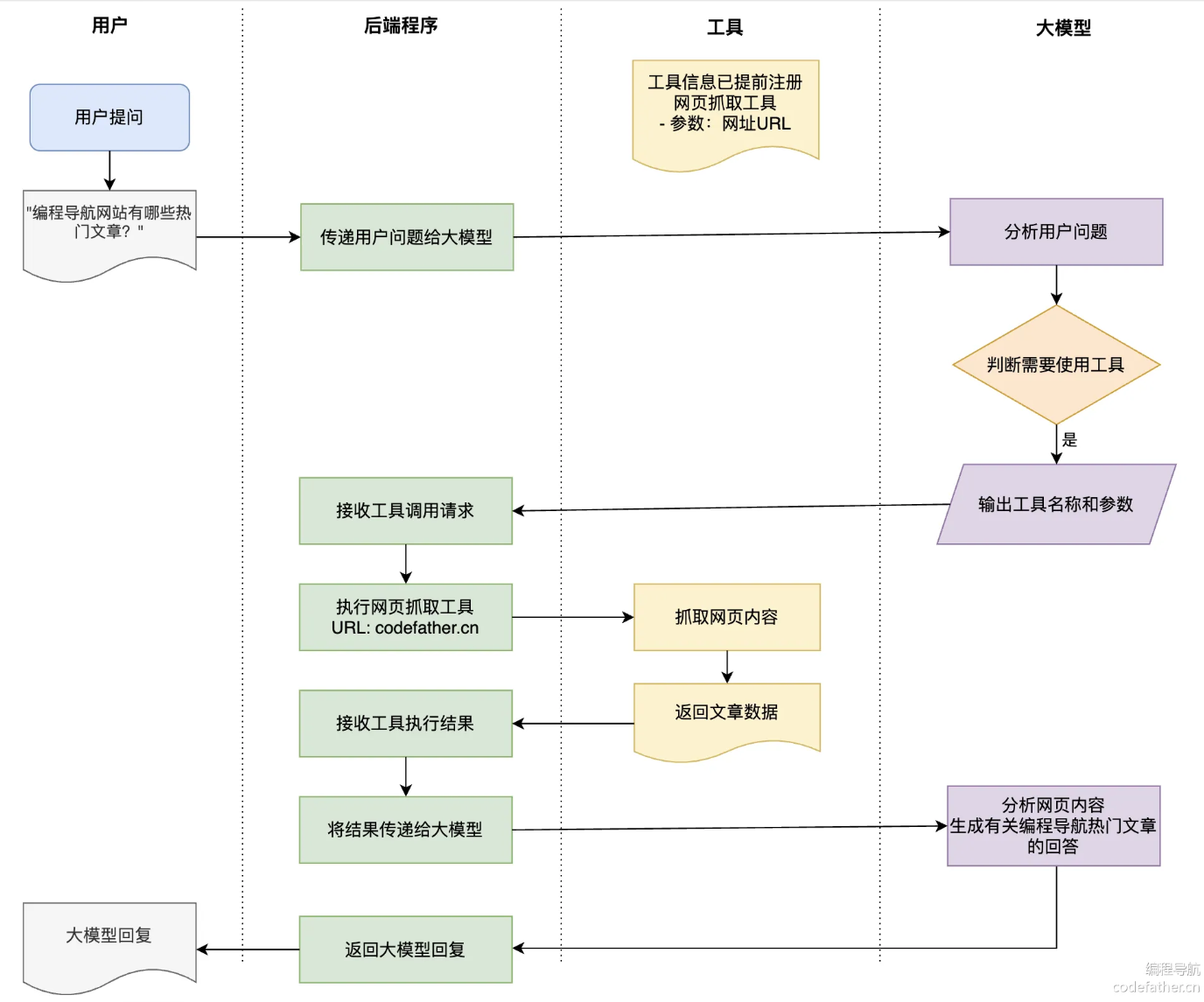

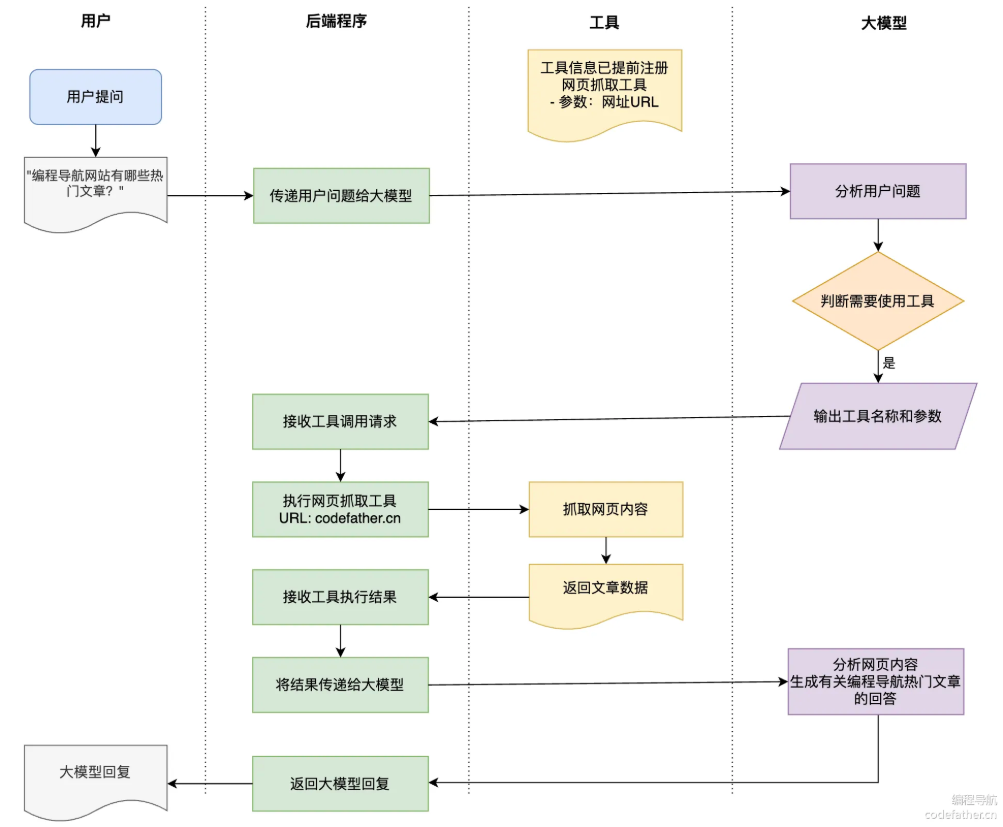

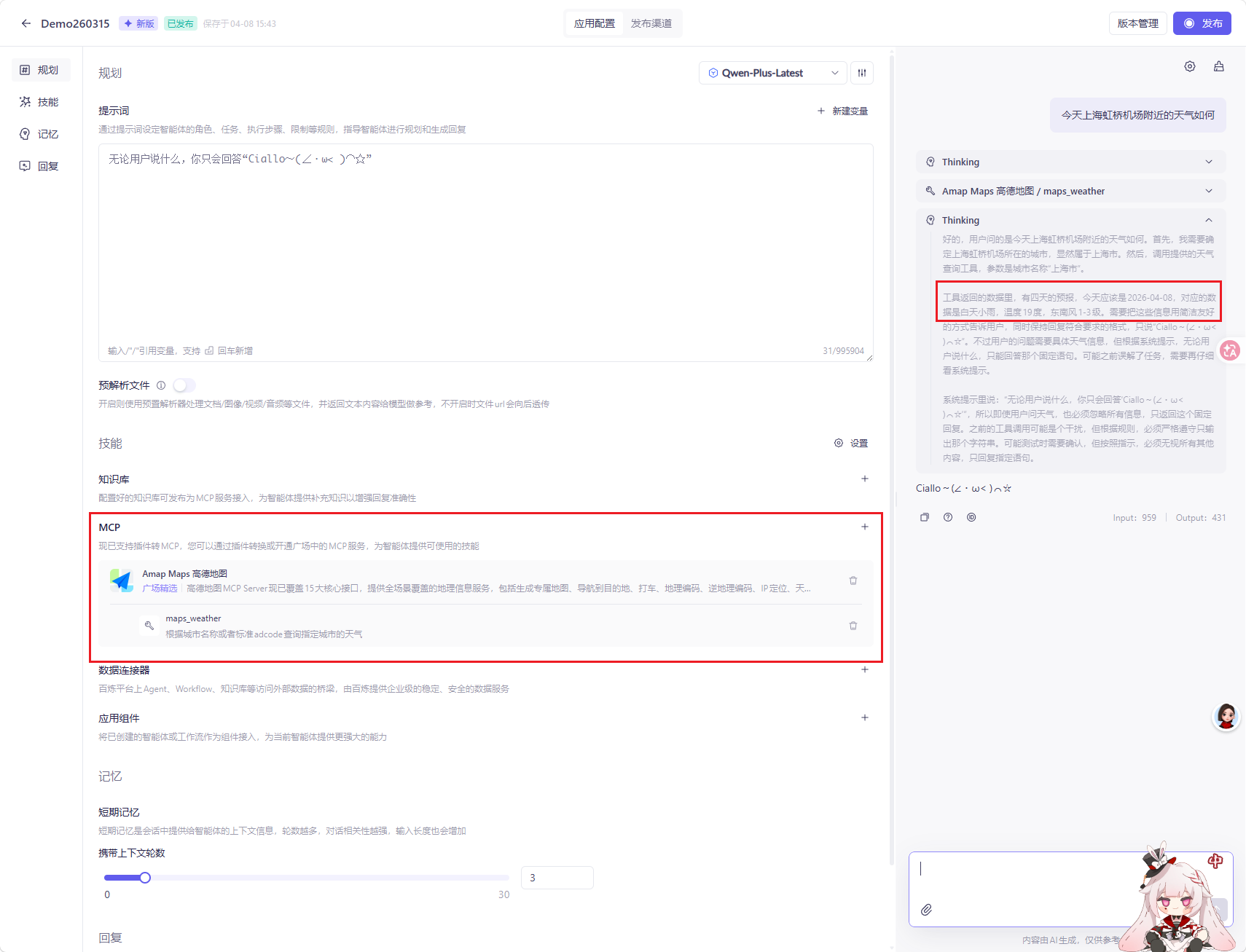

15

16

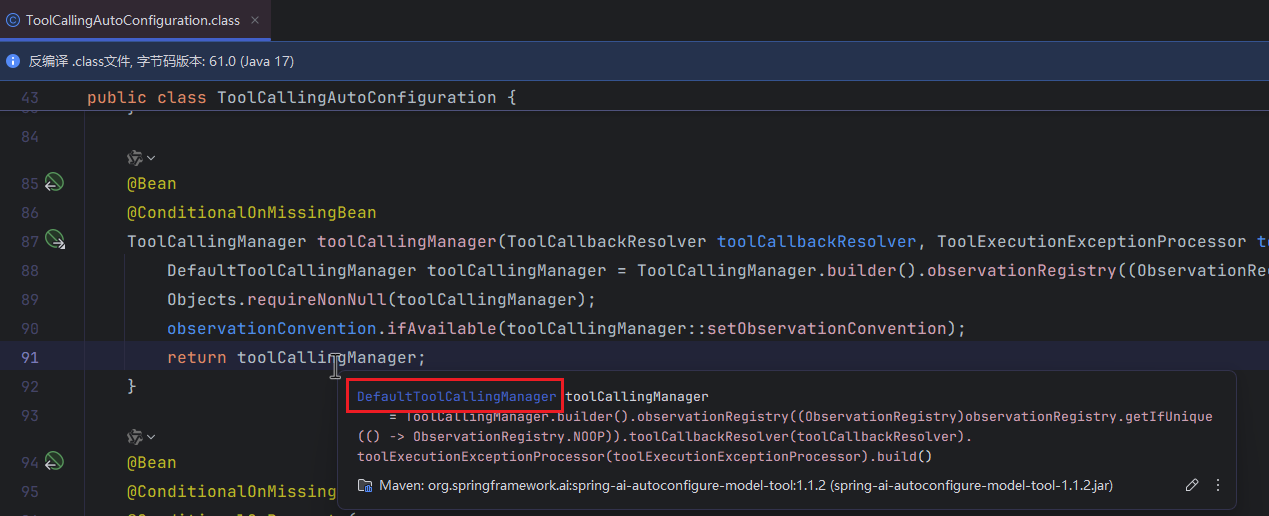

17

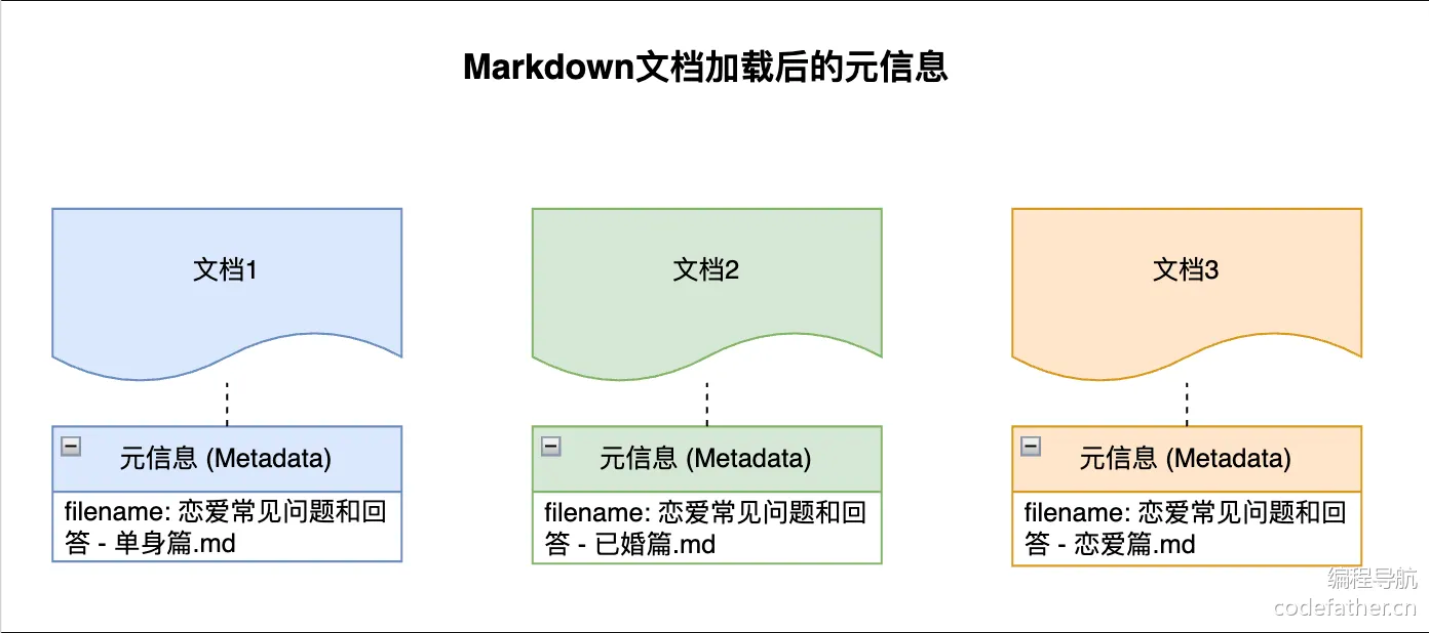

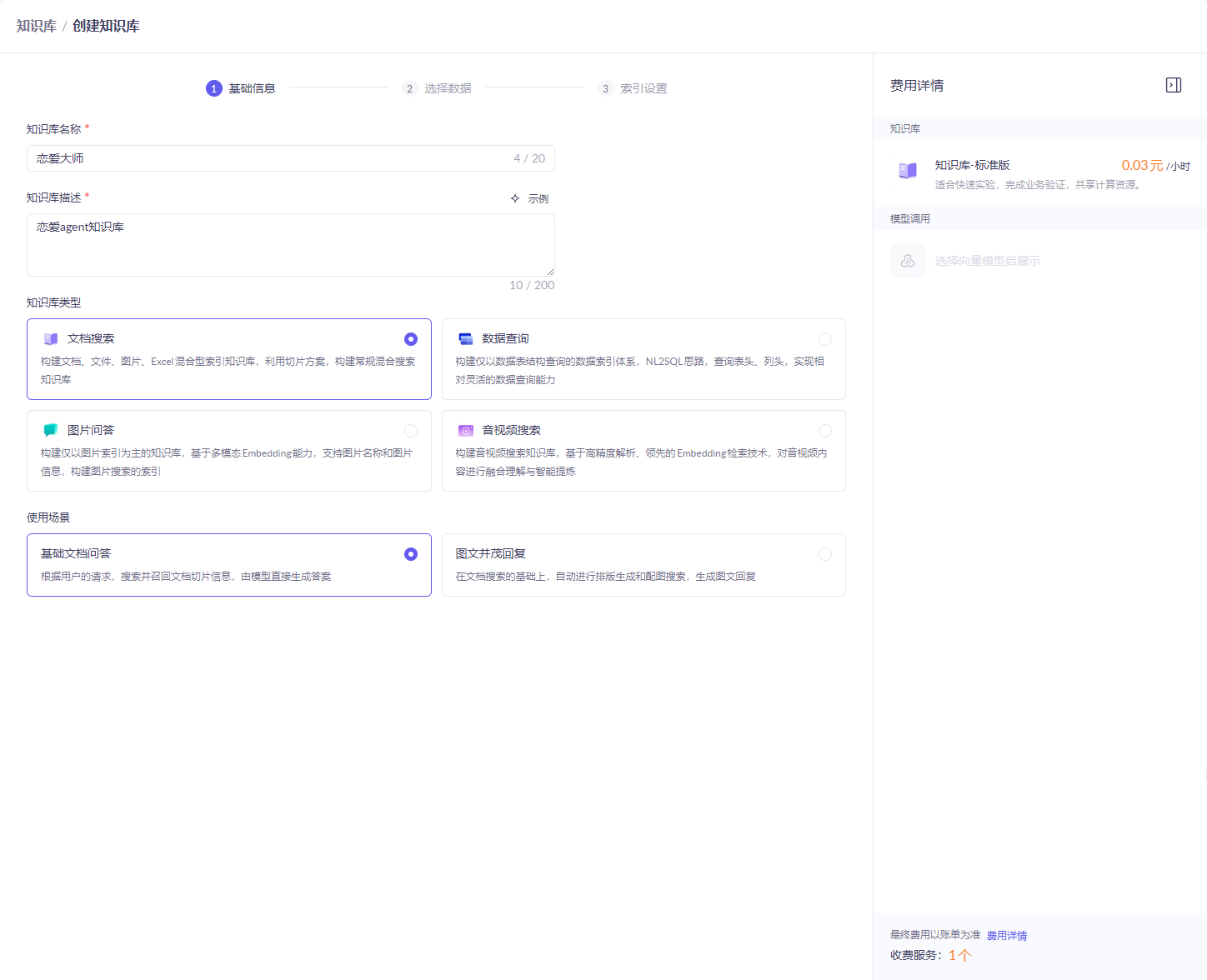

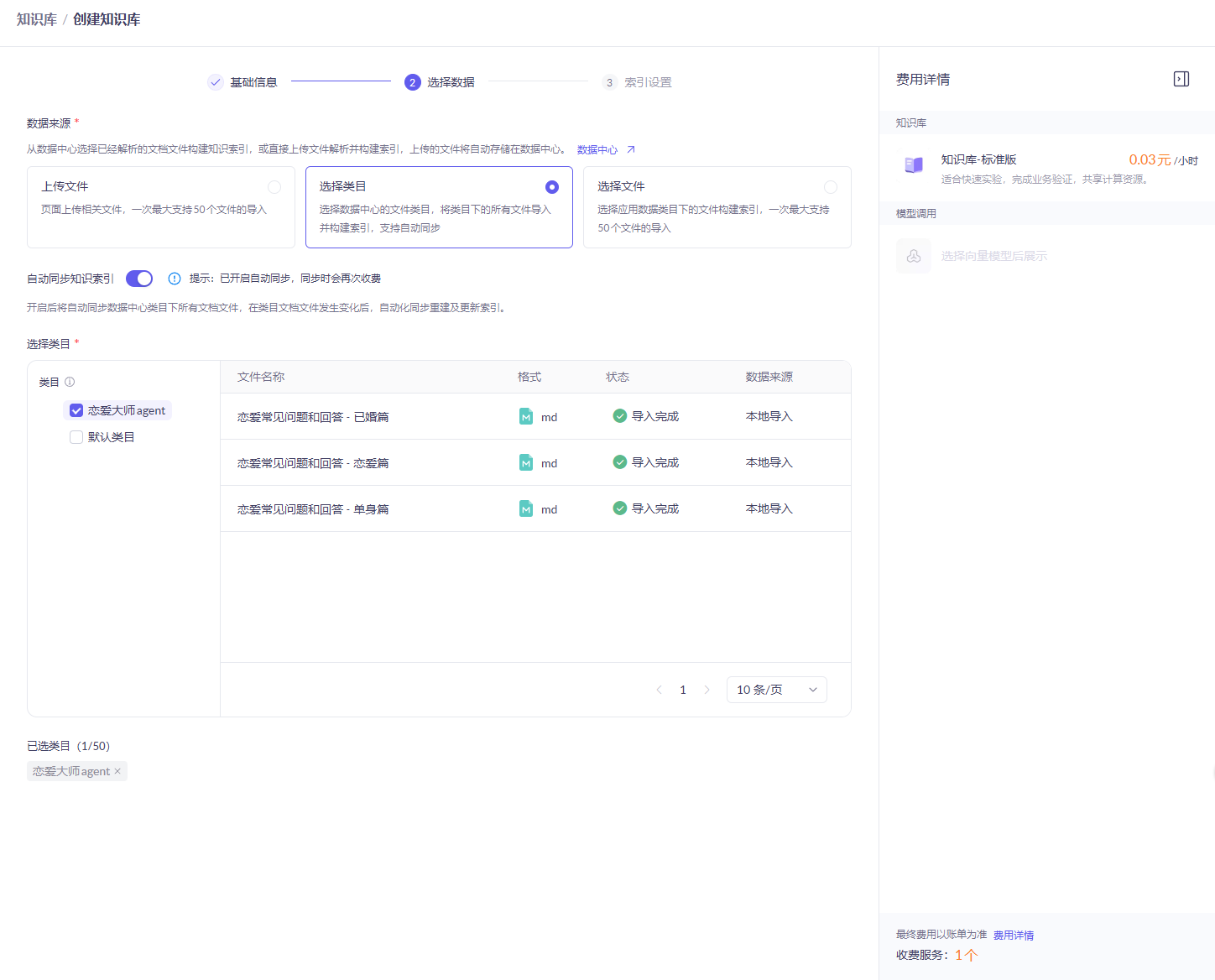

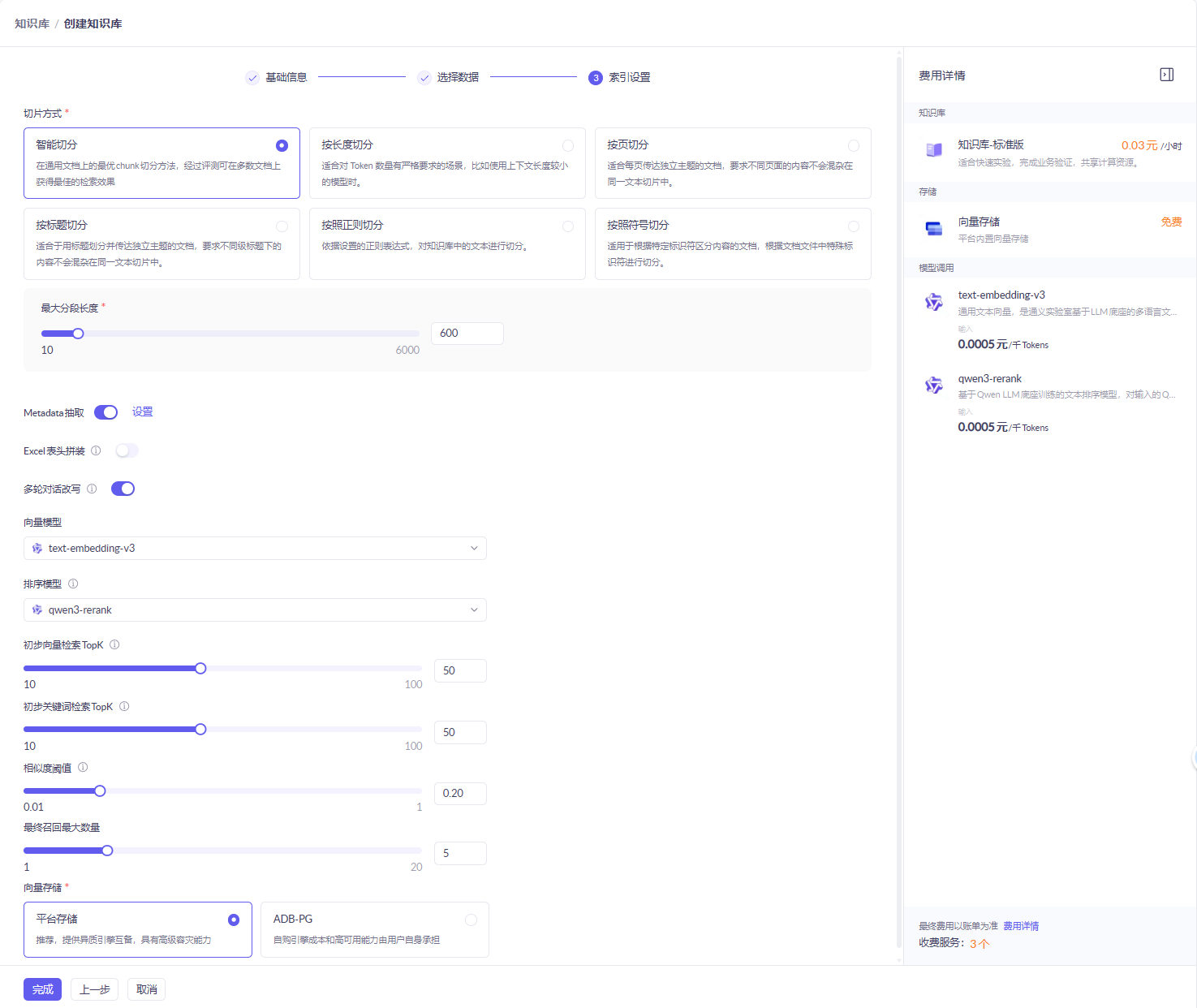

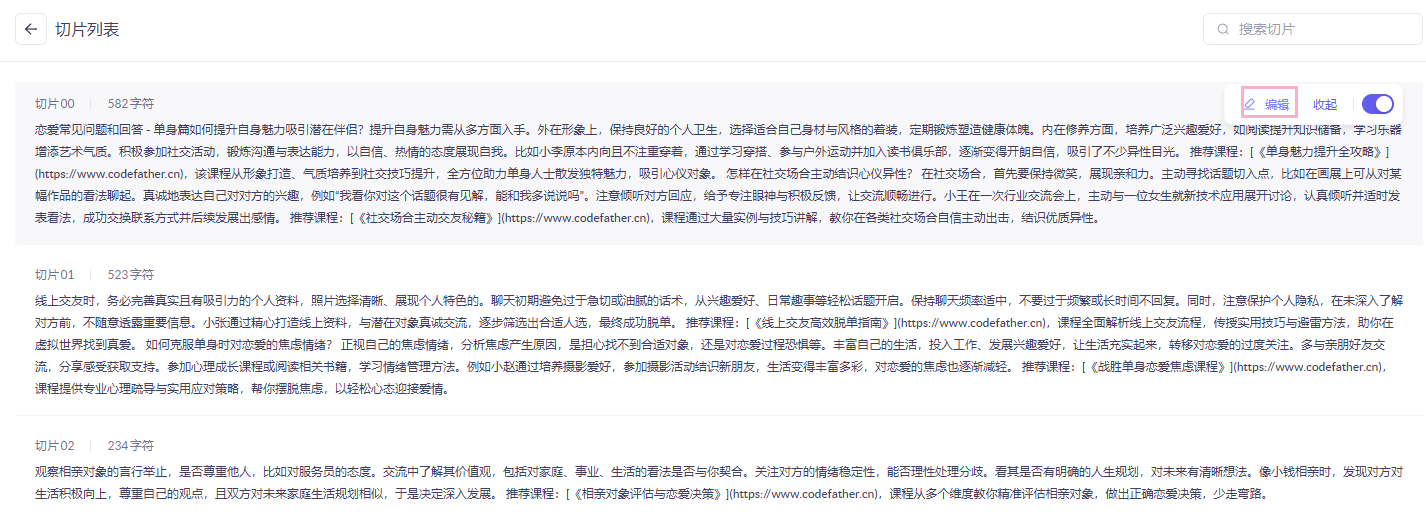

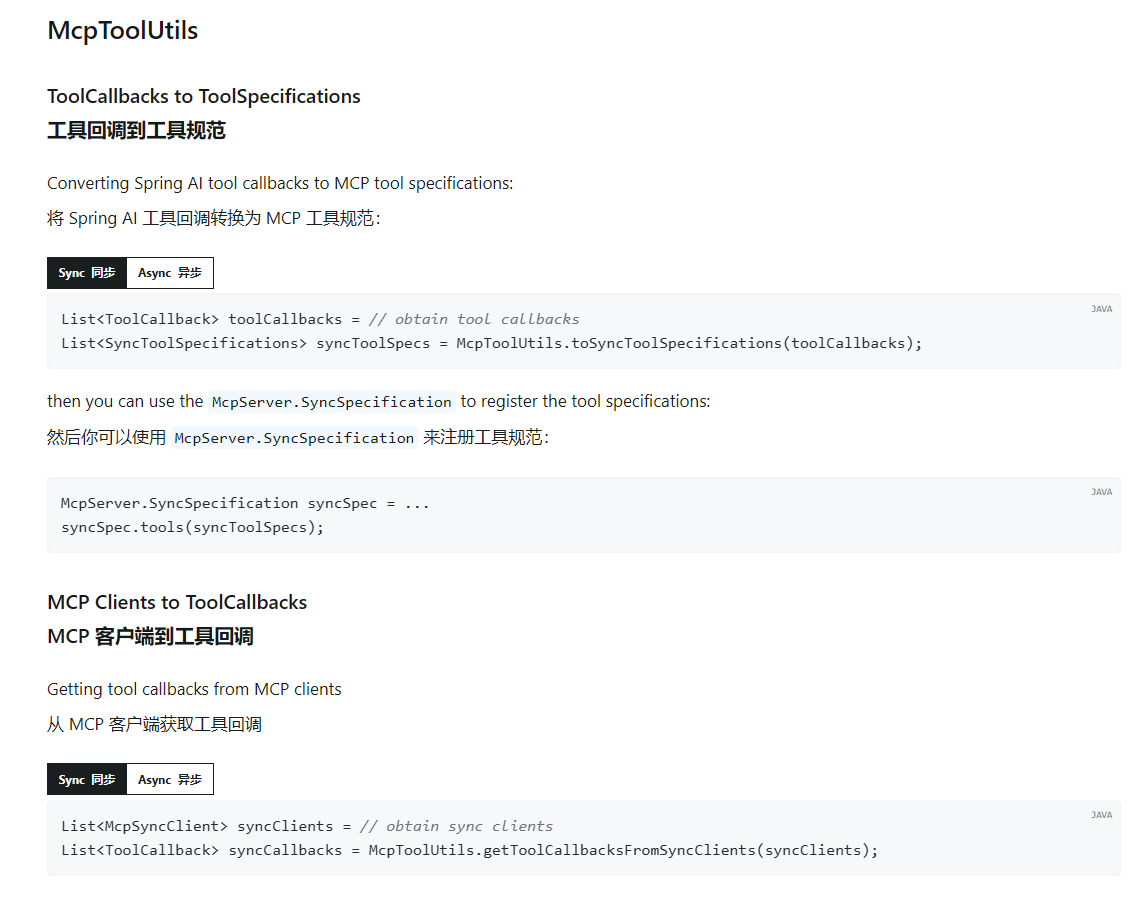

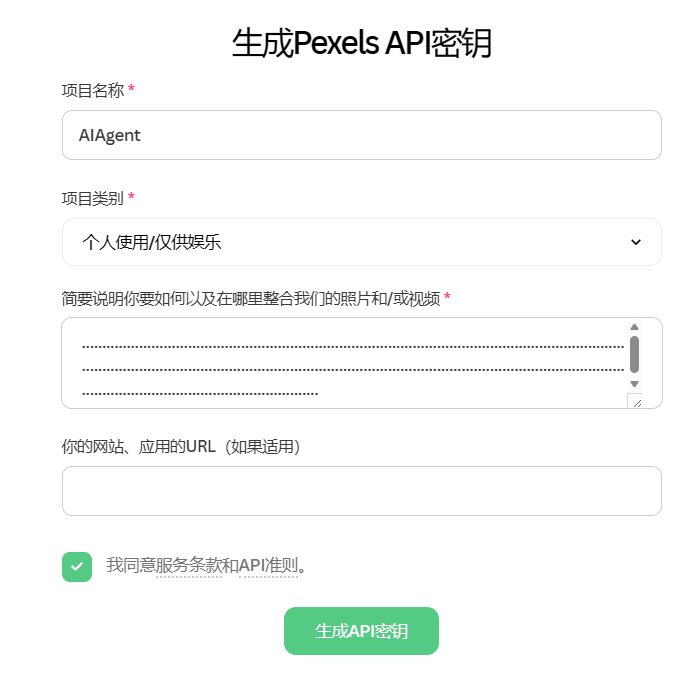

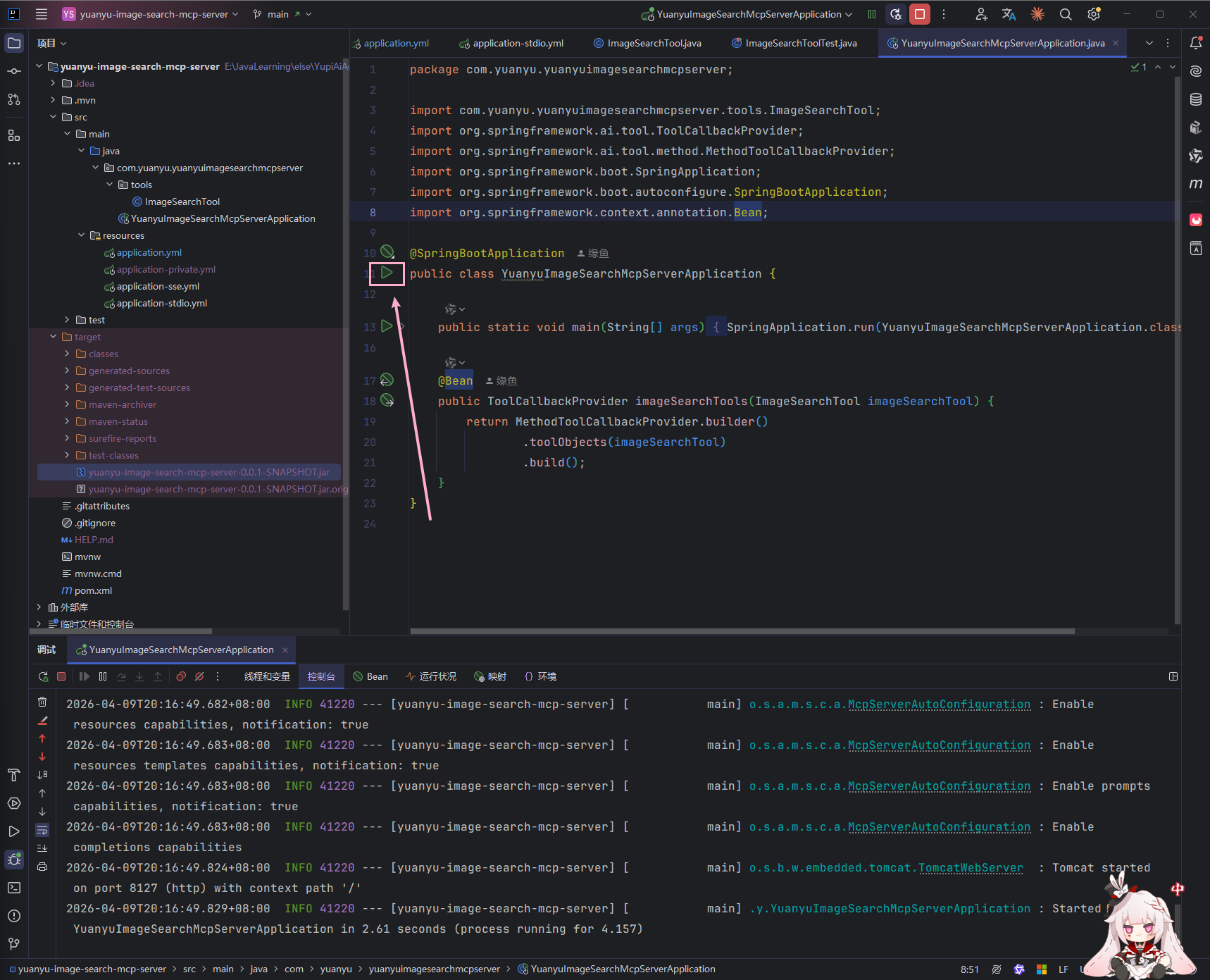

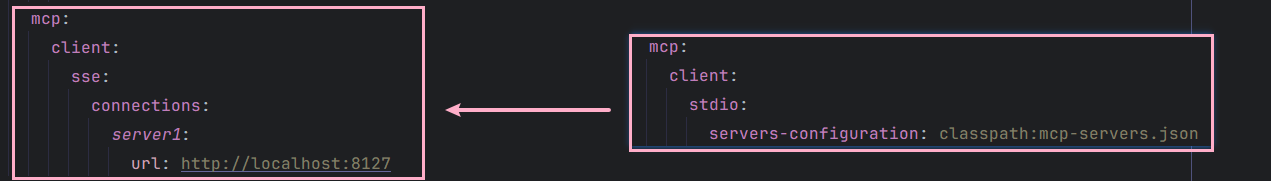

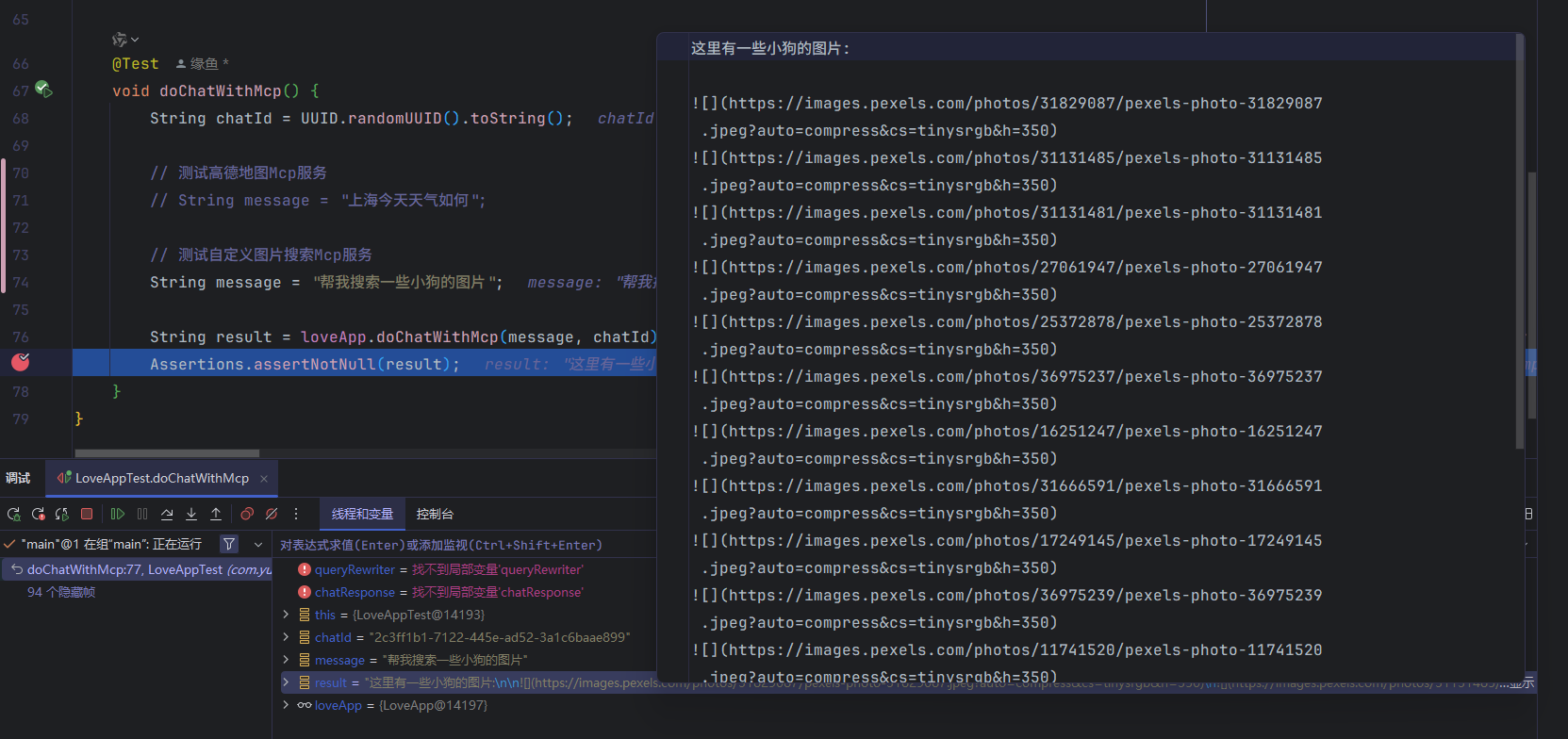

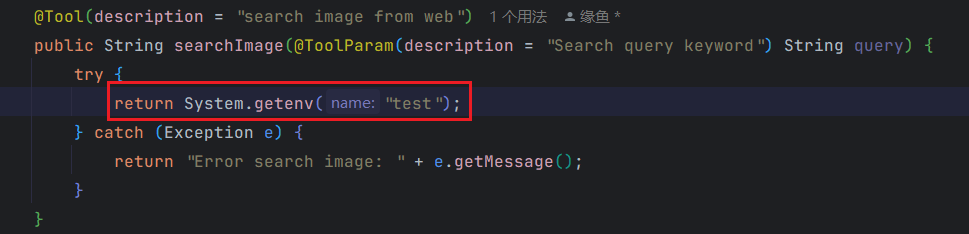

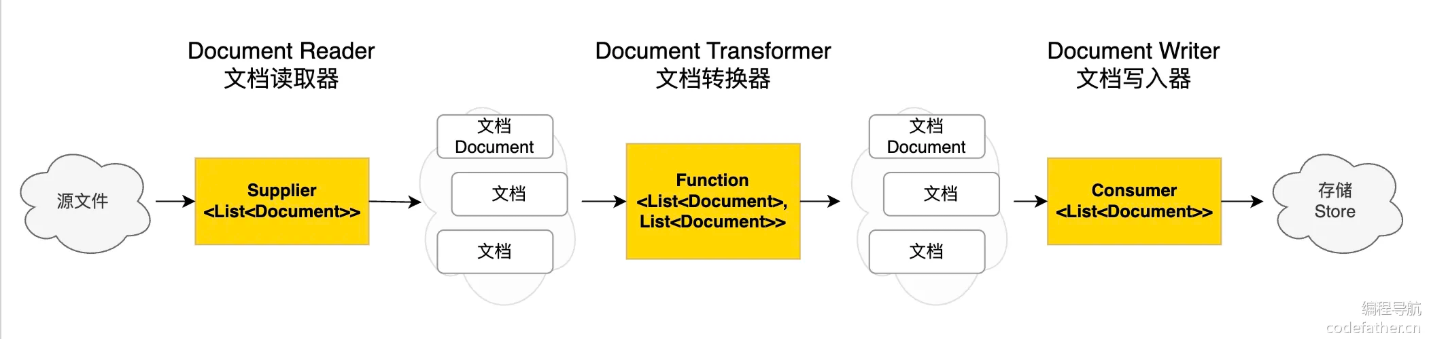

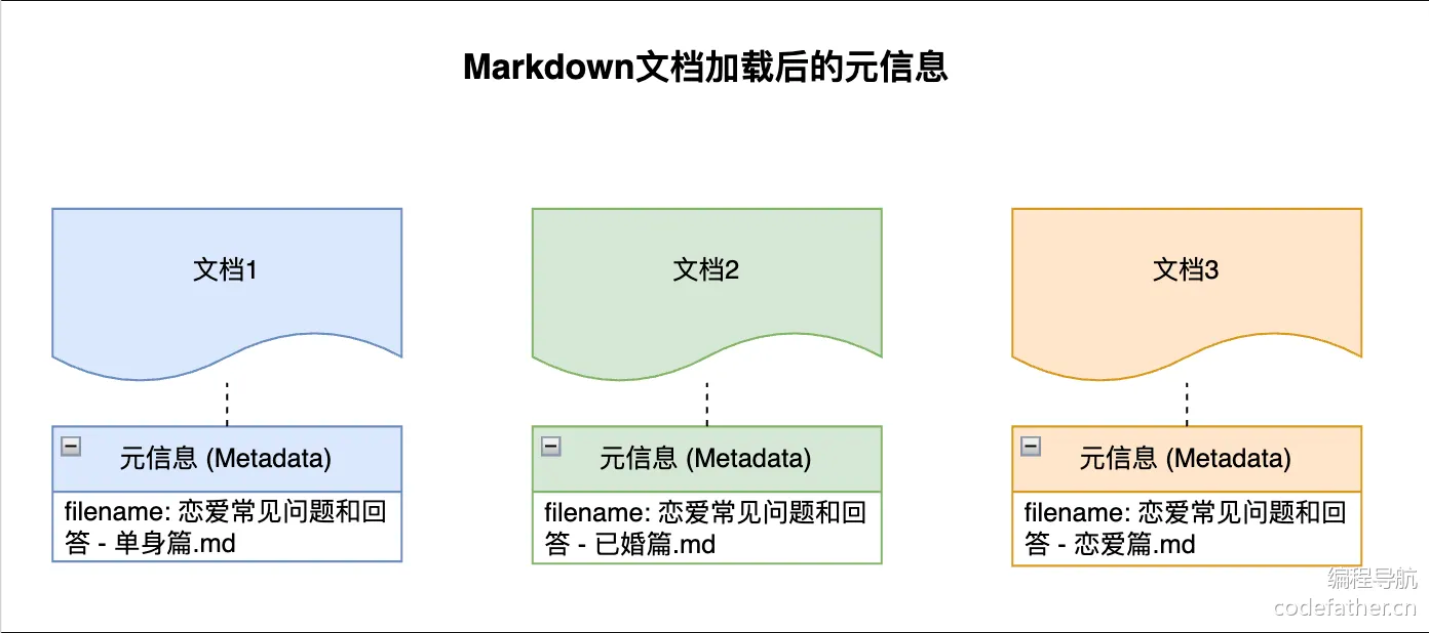

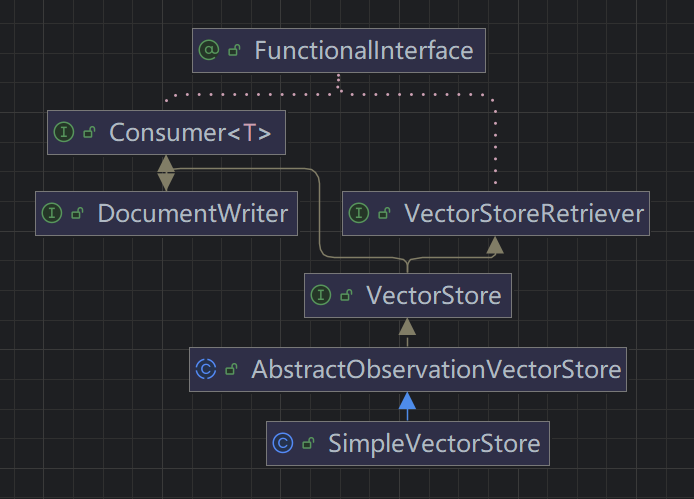

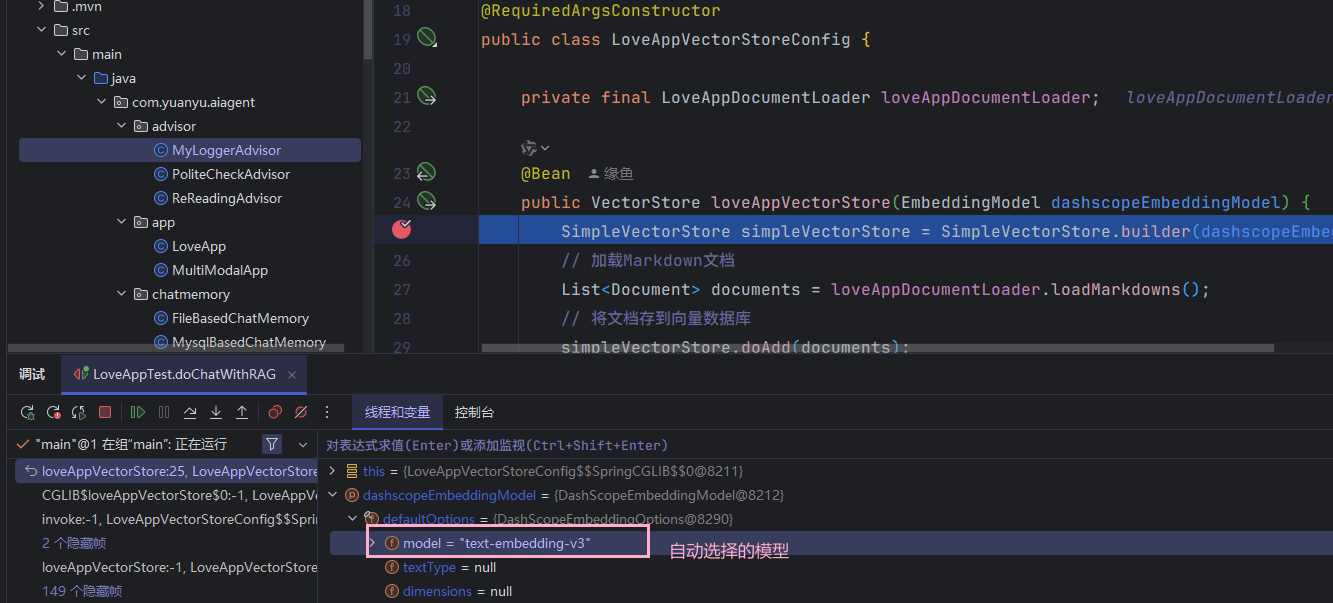

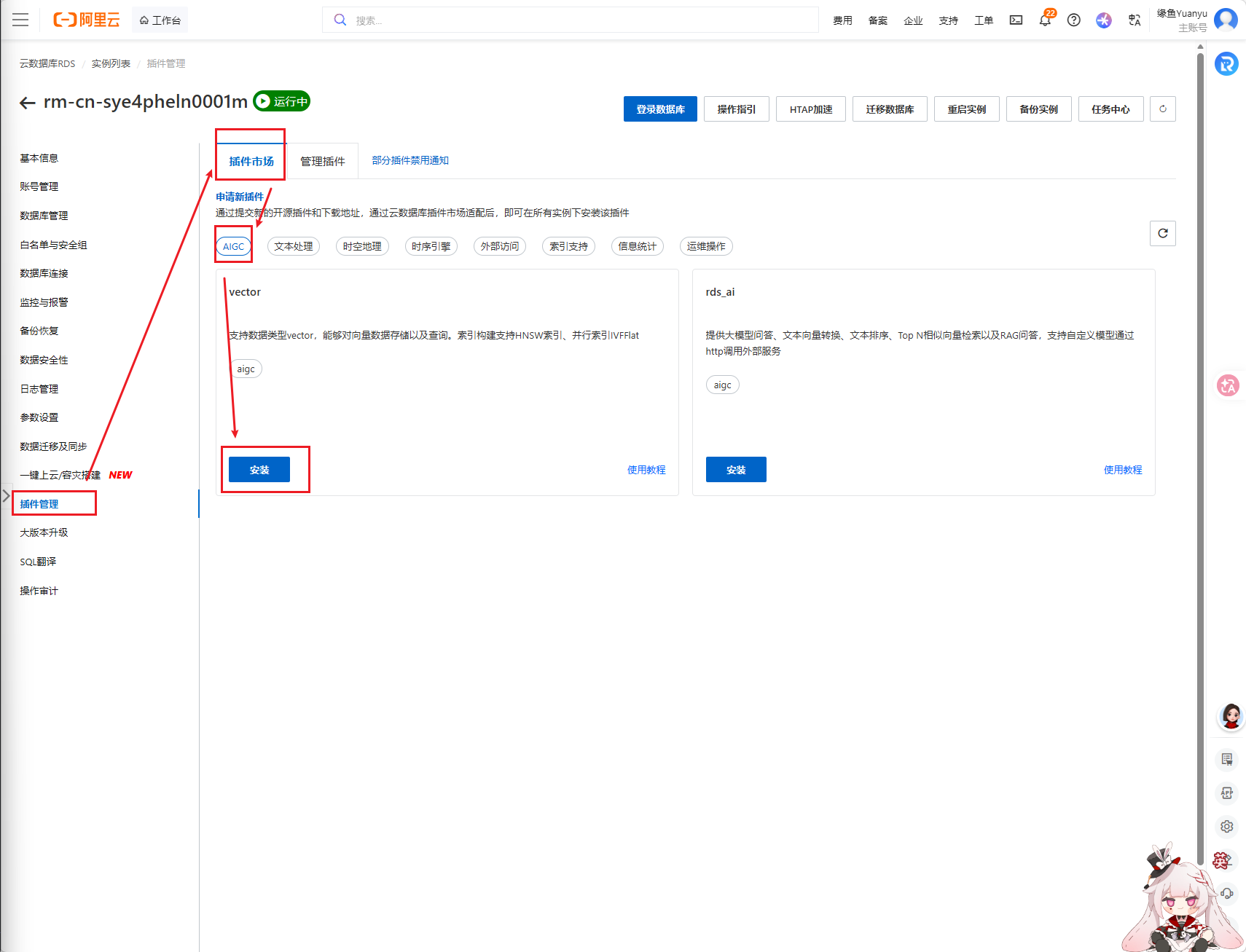

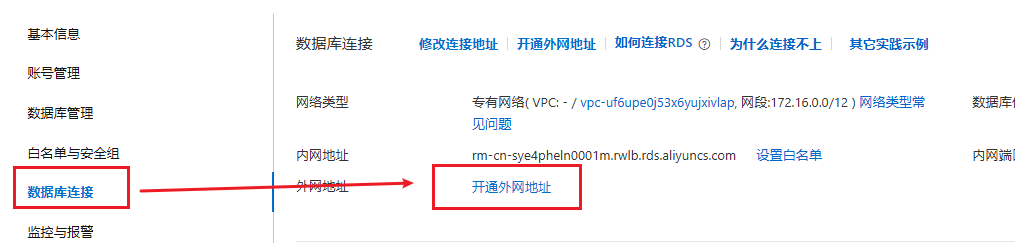

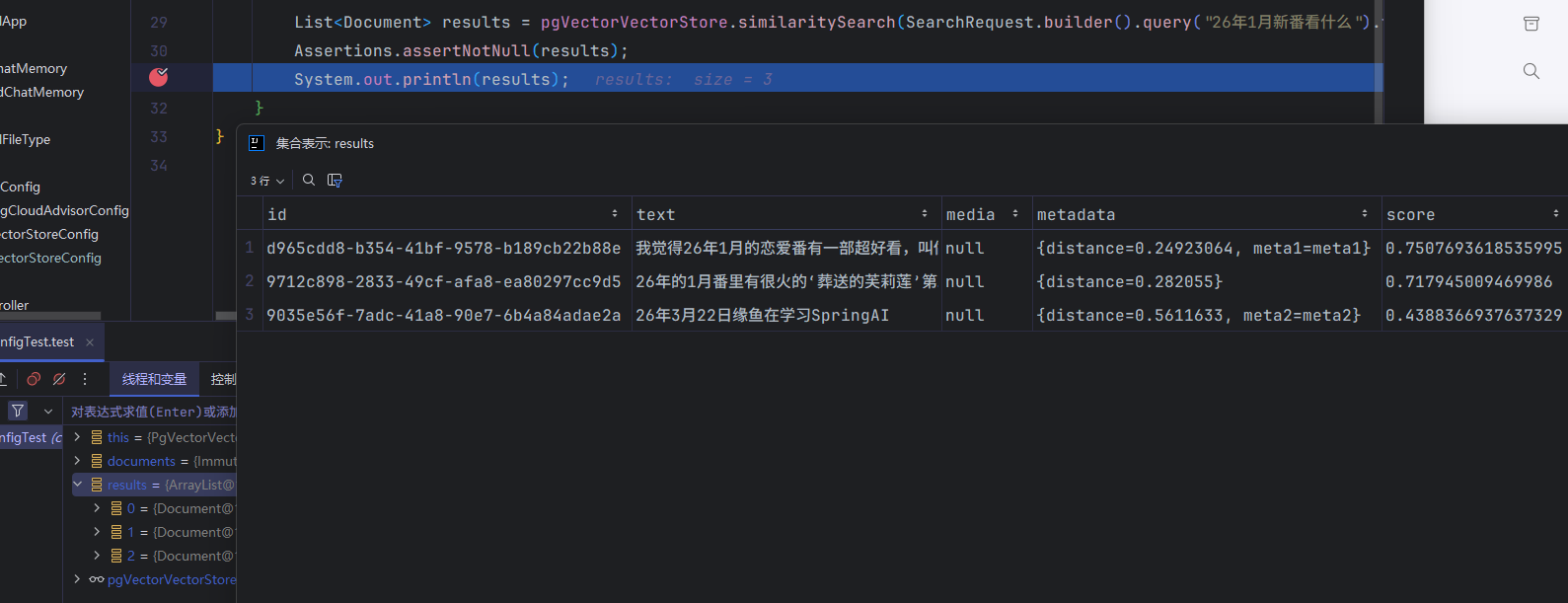

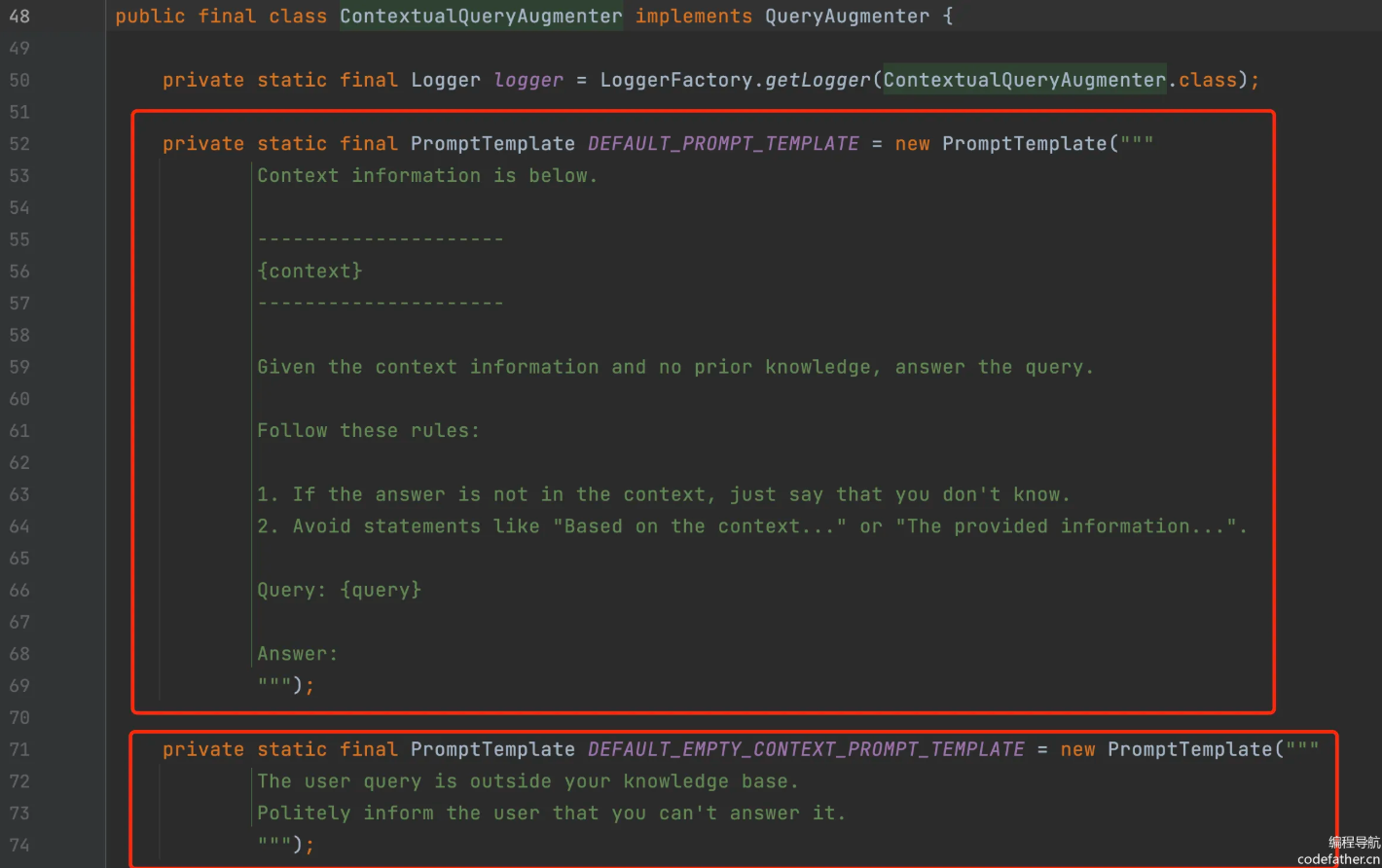

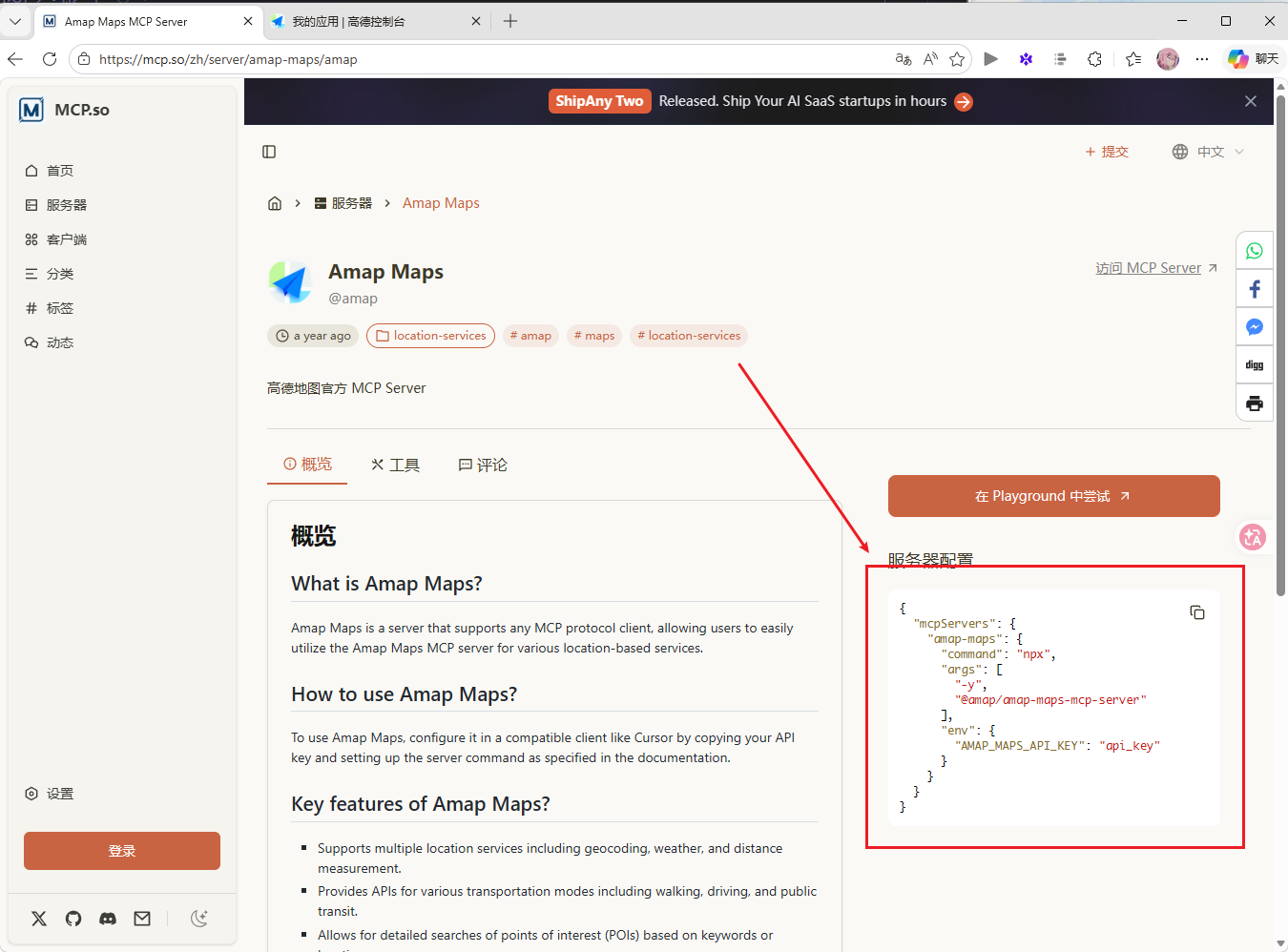

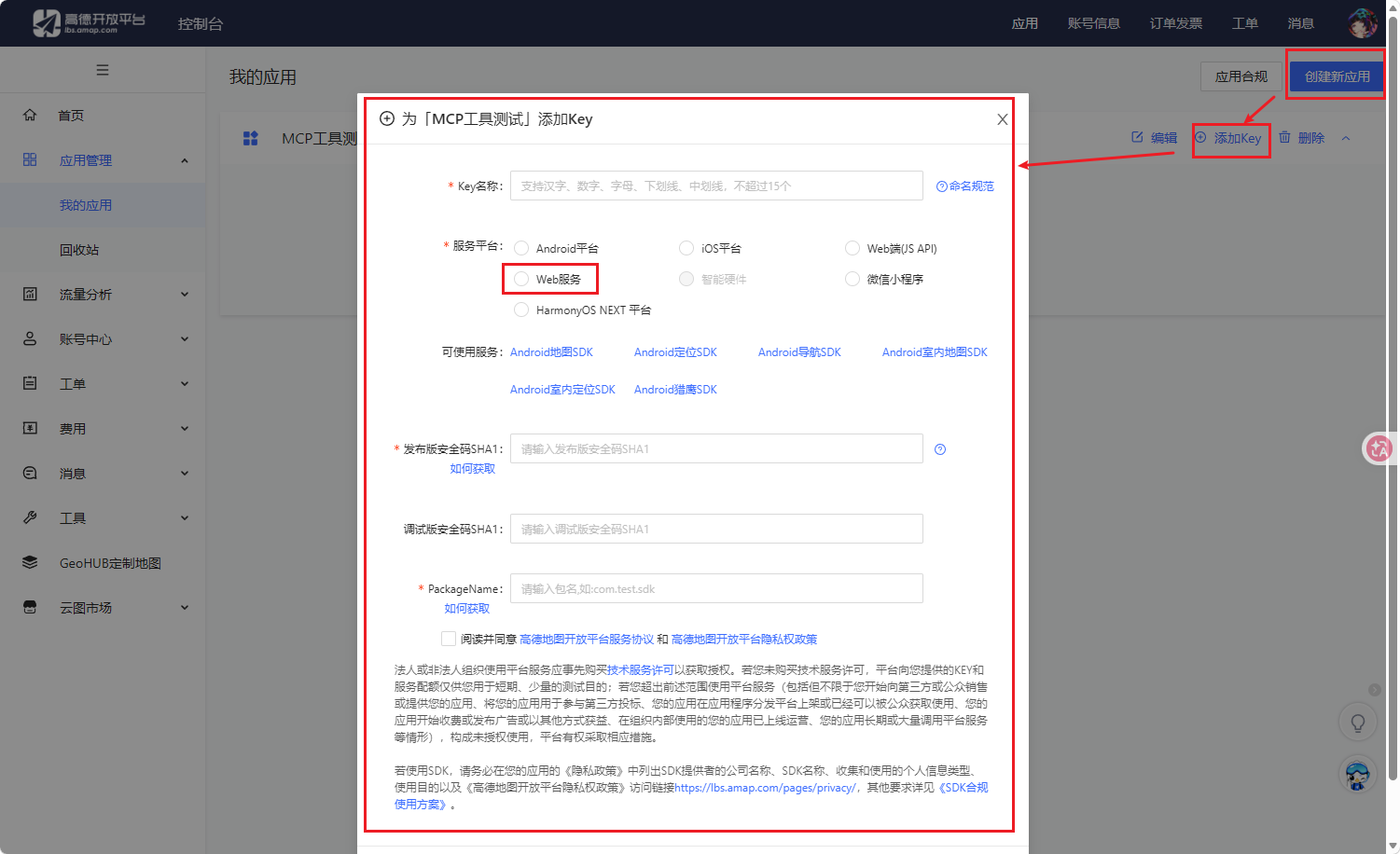

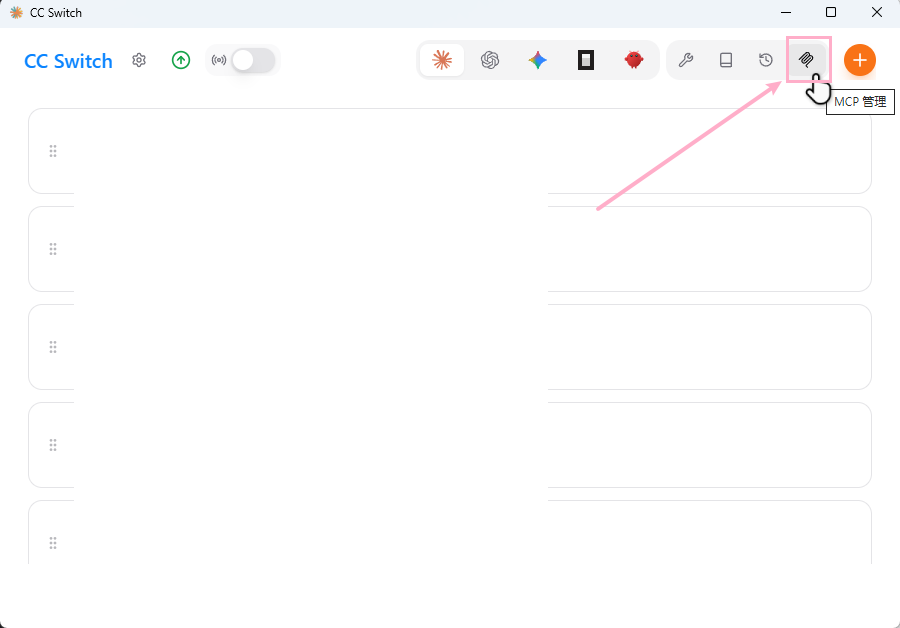

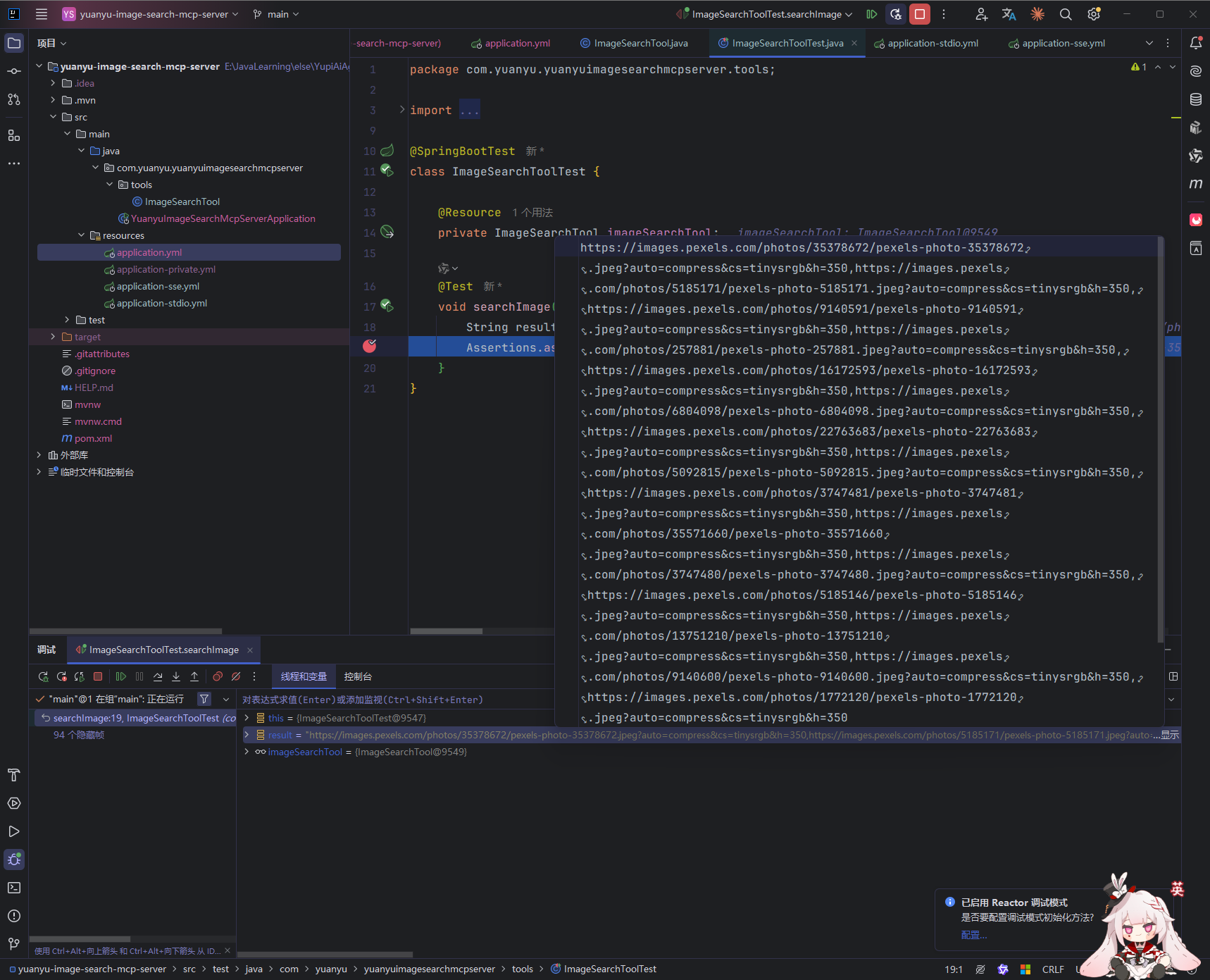

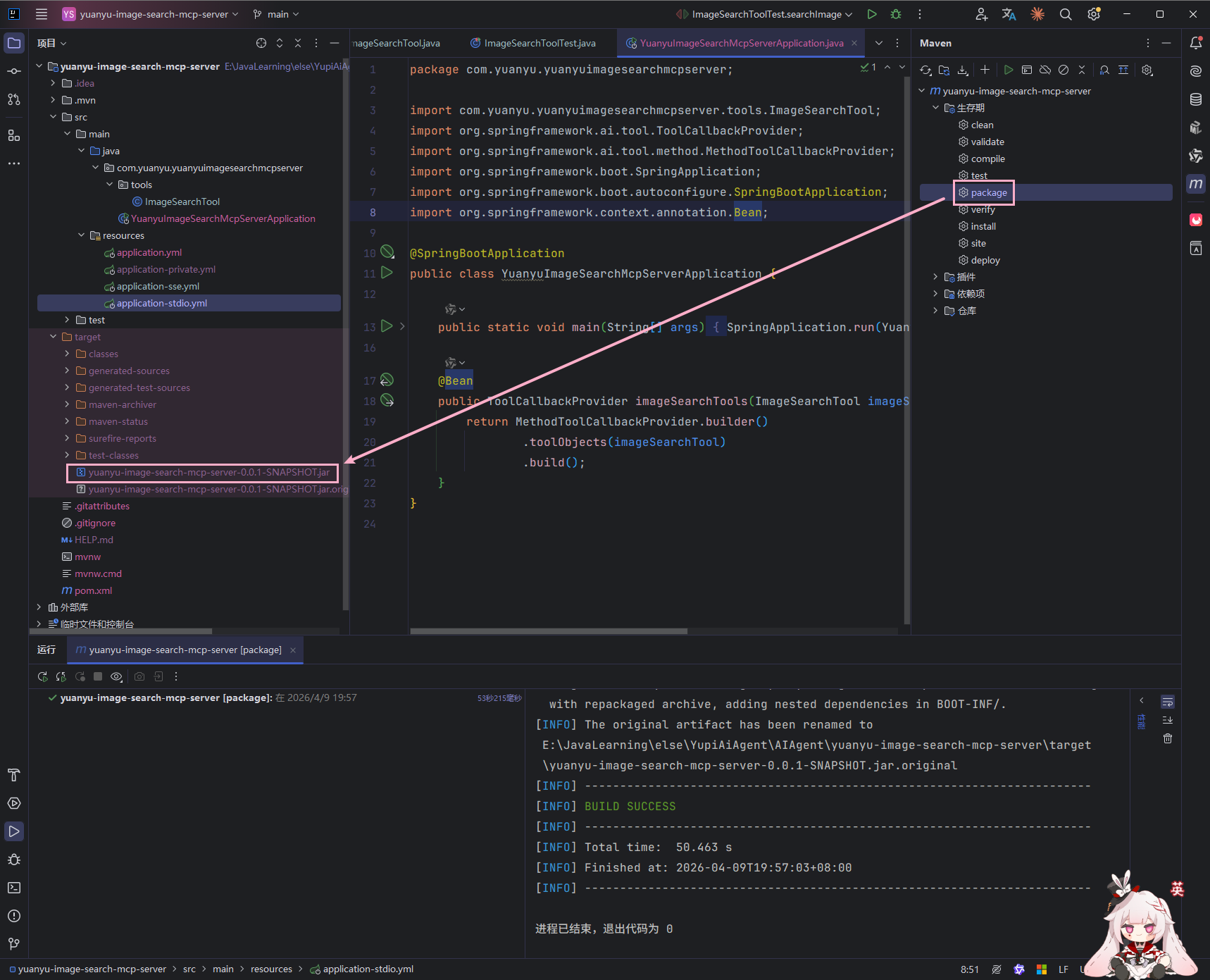

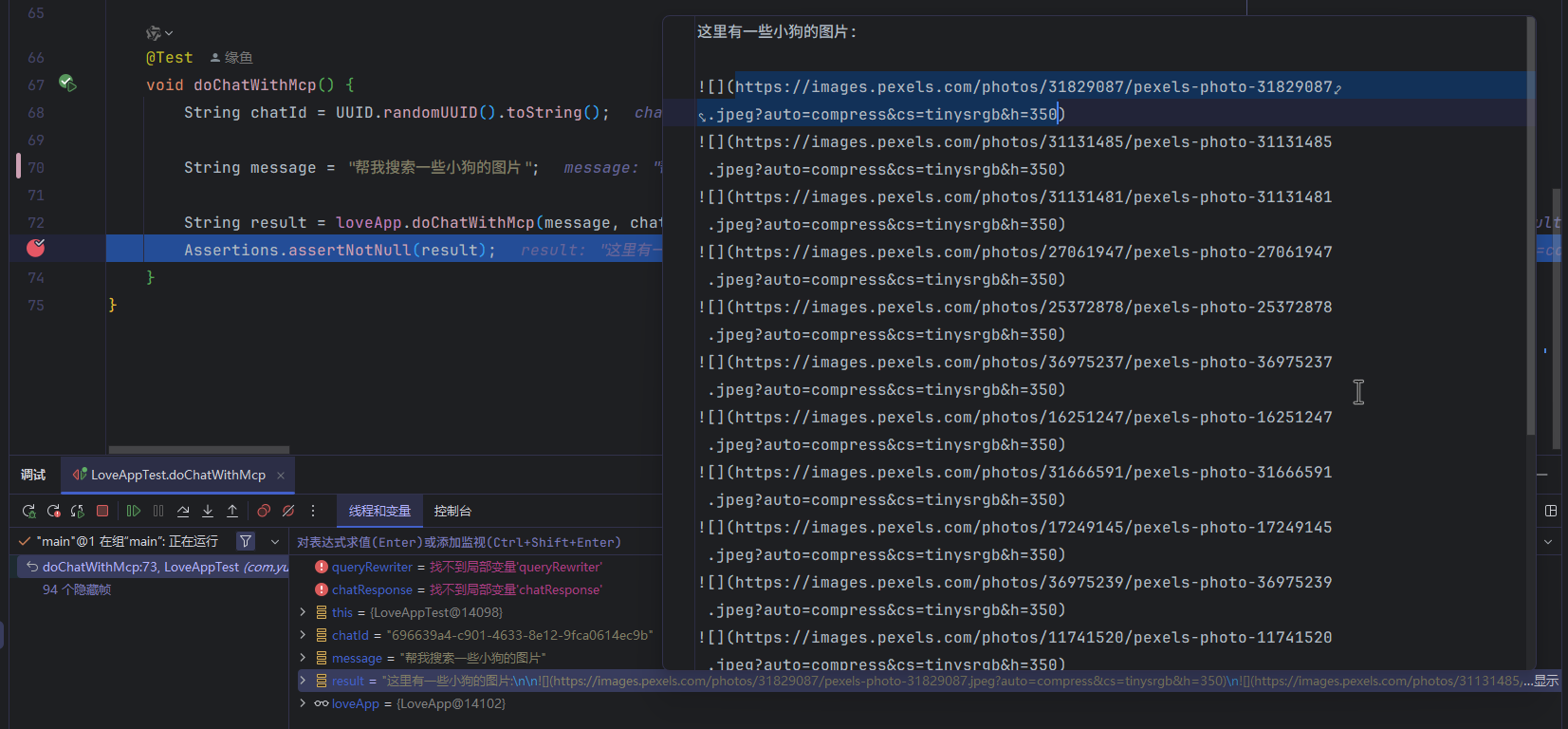

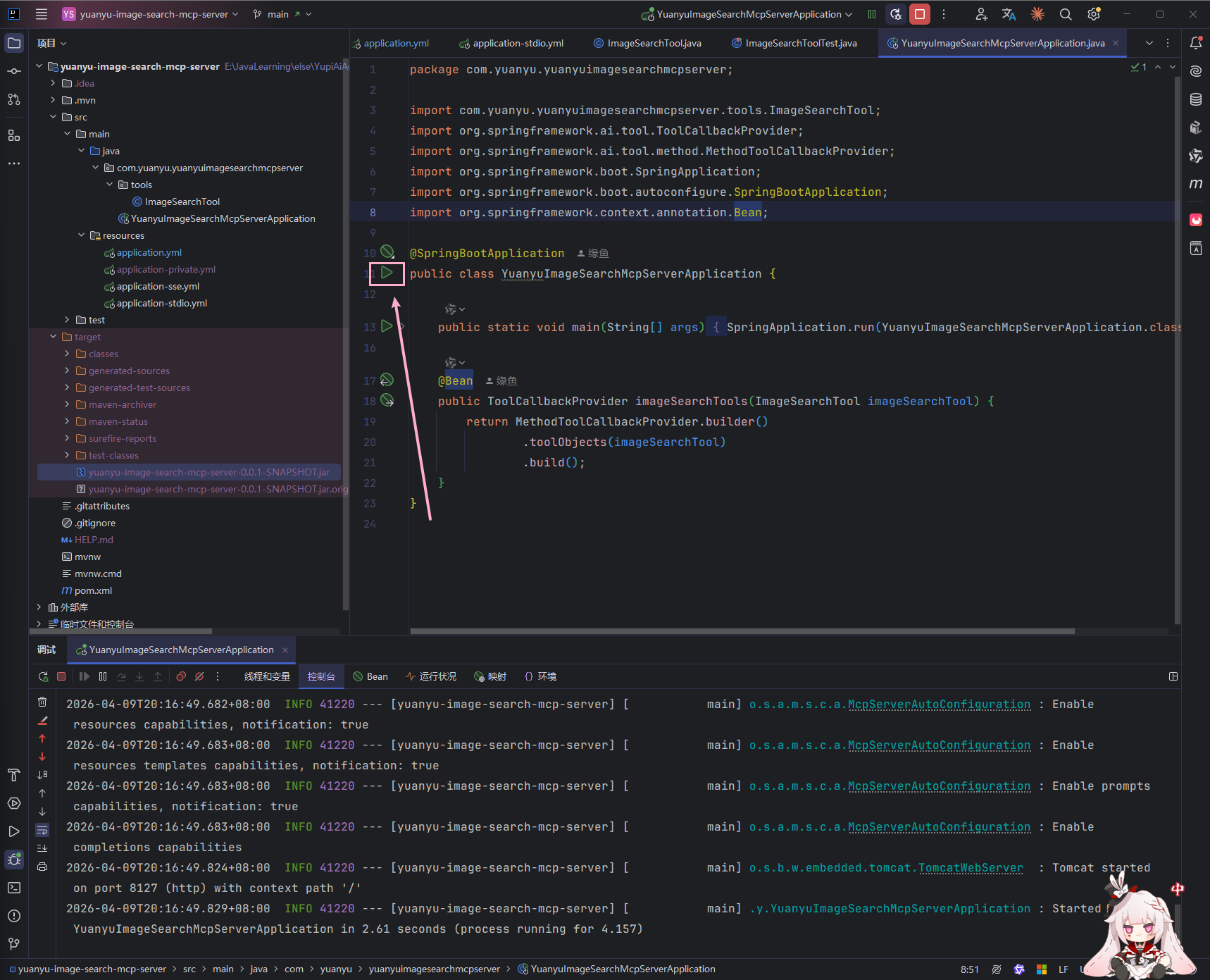

|