本文基于黑马课程,并且是衔接在我博客的另一篇文章“SpringCloud”之后的内容,其中涉及到的黑马商城项目也在其中

本文新涉及的资料:https://www.123865.com/s/SQzhTd-zAXld

微服务保护

保证服务运行的健壮性,避免级联失败导致的雪崩问题,就属于微服务保护。接下来将介绍微服务保护的常见方案以及对应的技术。

服务保护方案

微服务保护的方案有很多,比如:

- 请求限流

- 线程隔离

- 服务熔断

这些方案或多或少都会导致服务的体验上略有下降,比如请求限流,降低了并发上限;线程隔离,降低了可用资源数量;服务熔断,降低了服务的完整度,部分服务变的不可用或弱可用。因此这些方案都属于服务降级的方案。但通过这些方案,服务的健壮性得到了提升。接下来就逐一了解这些方案的原理。

请求限流

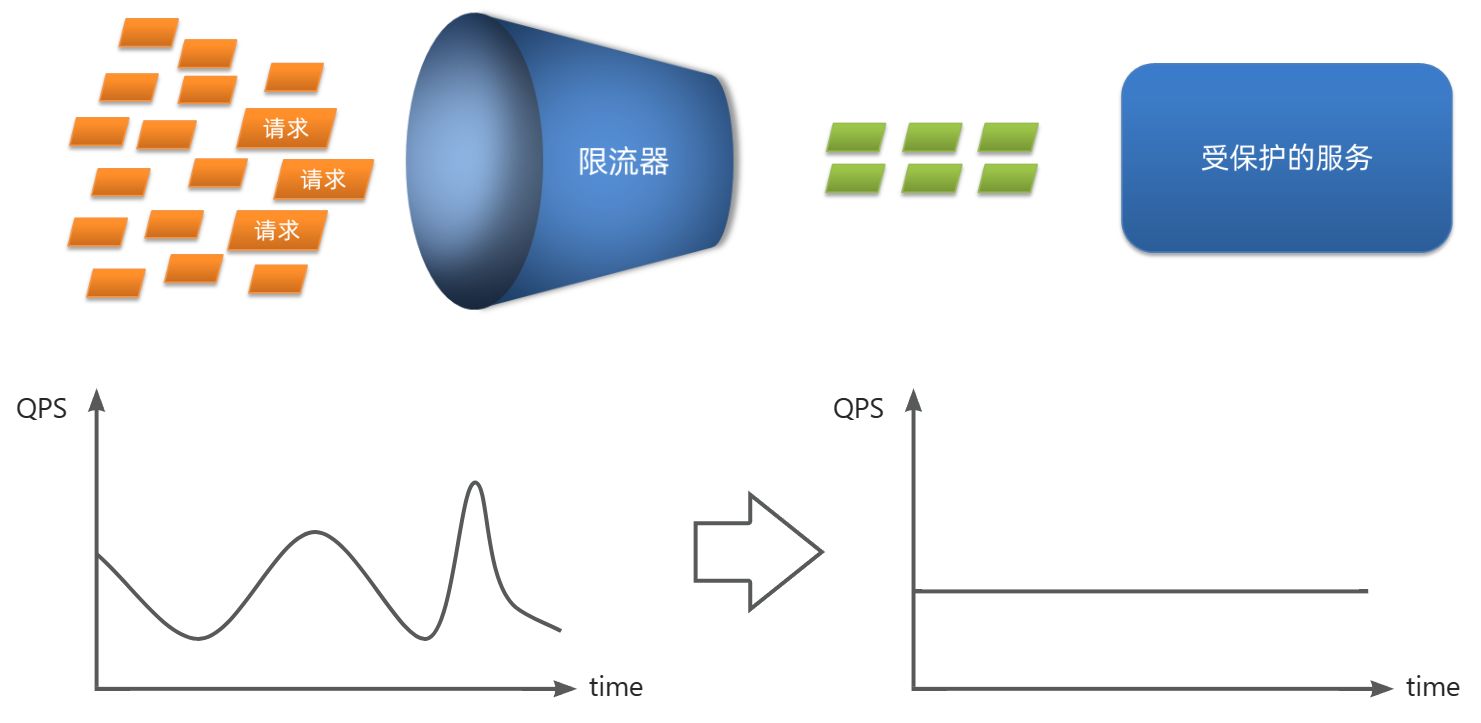

服务故障最重要原因,就是并发太高。解决了这个问题,就能避免大部分故障。当然,接口的并发不是一直很高,而是突发的。因此请求限流,就是限制或控制接口访问的并发流量,避免服务因流量激增而出现故障。

请求限流往往会有一个限流器,数量高低起伏的并发请求曲线,经过限流器就变的非常平稳。这就像是水电站的大坝,起到蓄水的作用,可以通过开关控制水流出的大小,让下游水流始终维持在一个平稳的量。

线程隔离

当一个业务接口响应时间长,而且并发高时,就可能耗尽服务器的线程资源,导致服务内的其它接口受到影响。所以必须把这种影响降低,或者缩减影响的范围。线程隔离正是解决这个问题的好办法。

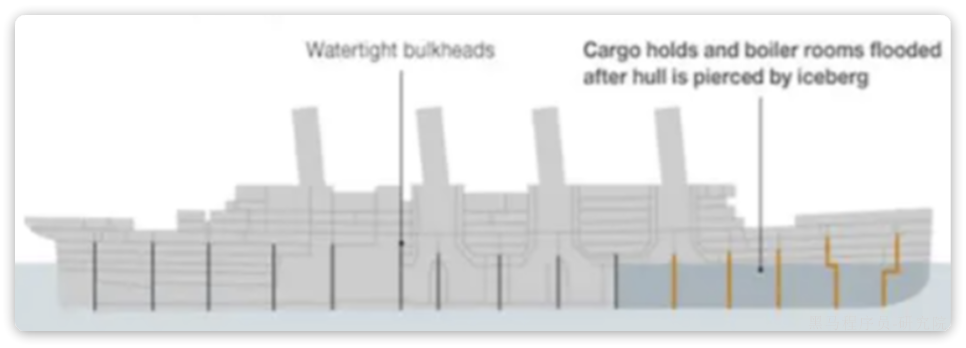

线程隔离的思想来自轮船的舱壁模式:

轮船的船舱会被隔板分割为N个相互隔离的密闭舱,假如轮船触礁进水,只有损坏的部分密闭舱会进水,而其他舱由于相互隔离,并不会进水。这样就把进水控制在部分船体,避免了整个船舱进水而沉没。

为了避免某个接口故障或压力过大导致整个服务不可用,可以限定每个接口可以使用的资源范围,也就是将其“隔离”起来。

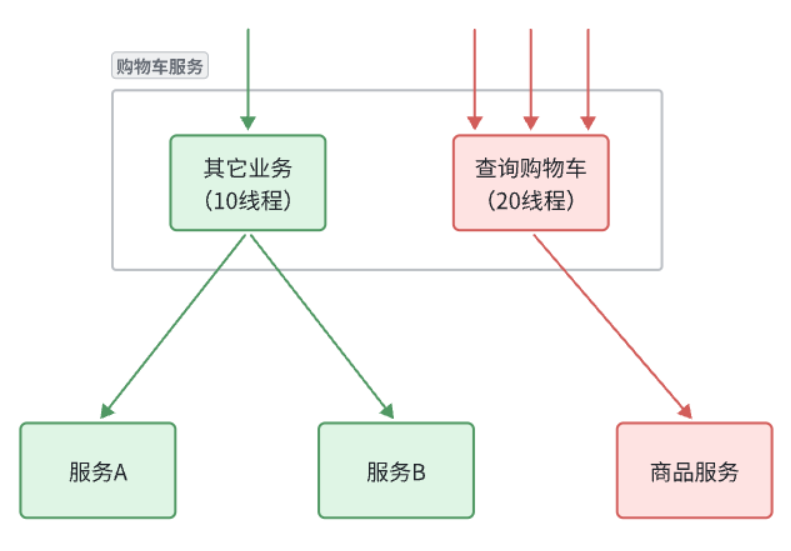

如图所示,给查询购物车业务限定可用线程数量上限为20,这样即便查询购物车的请求因为查询商品服务而出现故障,也不会导致服务器的线程资源被耗尽,不会影响到其它接口。

服务熔断

线程隔离虽然避免了雪崩问题,但故障服务(商品服务)依然会拖慢购物车服务(服务调用方)的接口响应速度。而且商品查询的故障依然会导致查询购物车功能出现故障,购物车业务也变的不可用了。

所以要做两件事情:

- 编写服务降级逻辑:就是服务调用失败后的处理逻辑,根据业务场景,可以抛出异常,也可以返回友好提示或默认数据。

- 异常统计和熔断:统计服务提供方的异常比例,当比例过高表明该接口会影响到其它服务,应该拒绝调用该接口,而是直接走降级逻辑。

Sentinel

微服务保护的技术有很多,但在目前国内使用较多的还是Sentinel,所以接下来学习Sentinel的使用。

介绍和安装

Sentinel是阿里巴巴开源的一款服务保护框架,目前已经加入SpringCloudAlibaba中。官方网站:https://sentinelguard.io/zh-cn/

Sentinel 的使用可以分为两个部分:

- 核心库(Jar包):不依赖任何框架/库,能够运行于 Java 8 及以上的版本的运行时环境,同时对 Dubbo / Spring Cloud 等框架也有较好的支持。在项目中引入依赖即可实现服务限流、隔离、熔断等功能。

- 控制台(Dashboard):Dashboard 主要负责管理推送规则、监控、管理机器信息等。

为了方便监控微服务,首先要把Sentinel的控制台搭建出来。

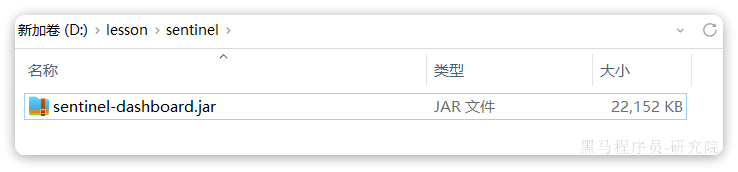

1)下载jar包

下载地址:https://github.com/alibaba/Sentinel/releases

2)运行

将jar包放在任意非中文、不包含特殊字符的目录下,重命名为sentinel-dashboard.jar:

然后运行如下命令启动控制台:

|

|

其它启动时可配置参数可参考官方文档:https://github.com/alibaba/Sentinel/wiki/%E5%90%AF%E5%8A%A8%E9%85%8D%E7%BD%AE%E9%A1%B9

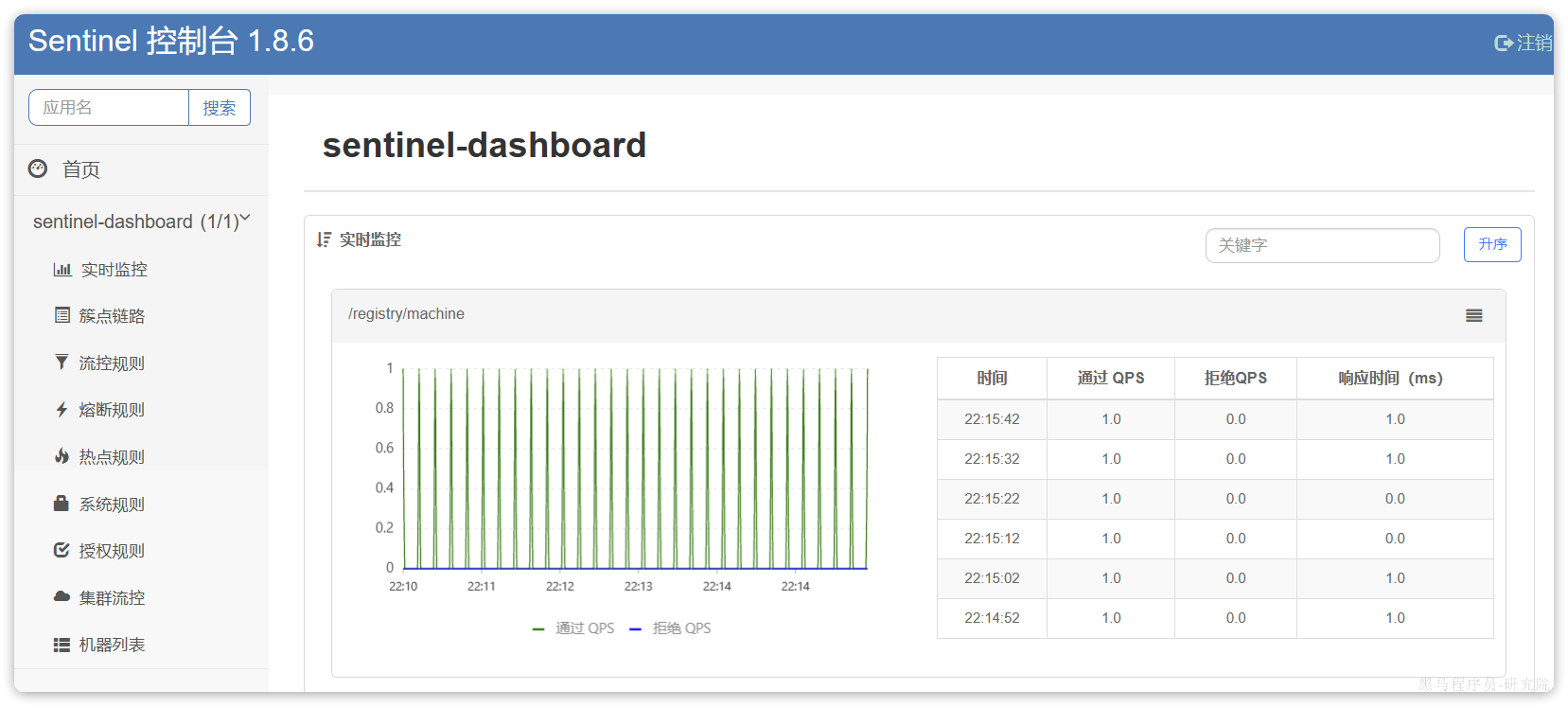

3)访问

访问http://localhost:8090页面,就可以看到sentinel的控制台了:

需要输入账号和密码,默认都是:sentinel

登录后,即可看到控制台,默认会监控sentinel-dashboard服务本身:

微服务整合

我们在cart-service模块中整合sentinel,连接sentinel-dashboard控制台,步骤如下:

1)引入sentinel依赖

|

|

2)配置控制台

修改application.yaml文件,添加下面内容:

|

|

3)访问cart-service的任意端点

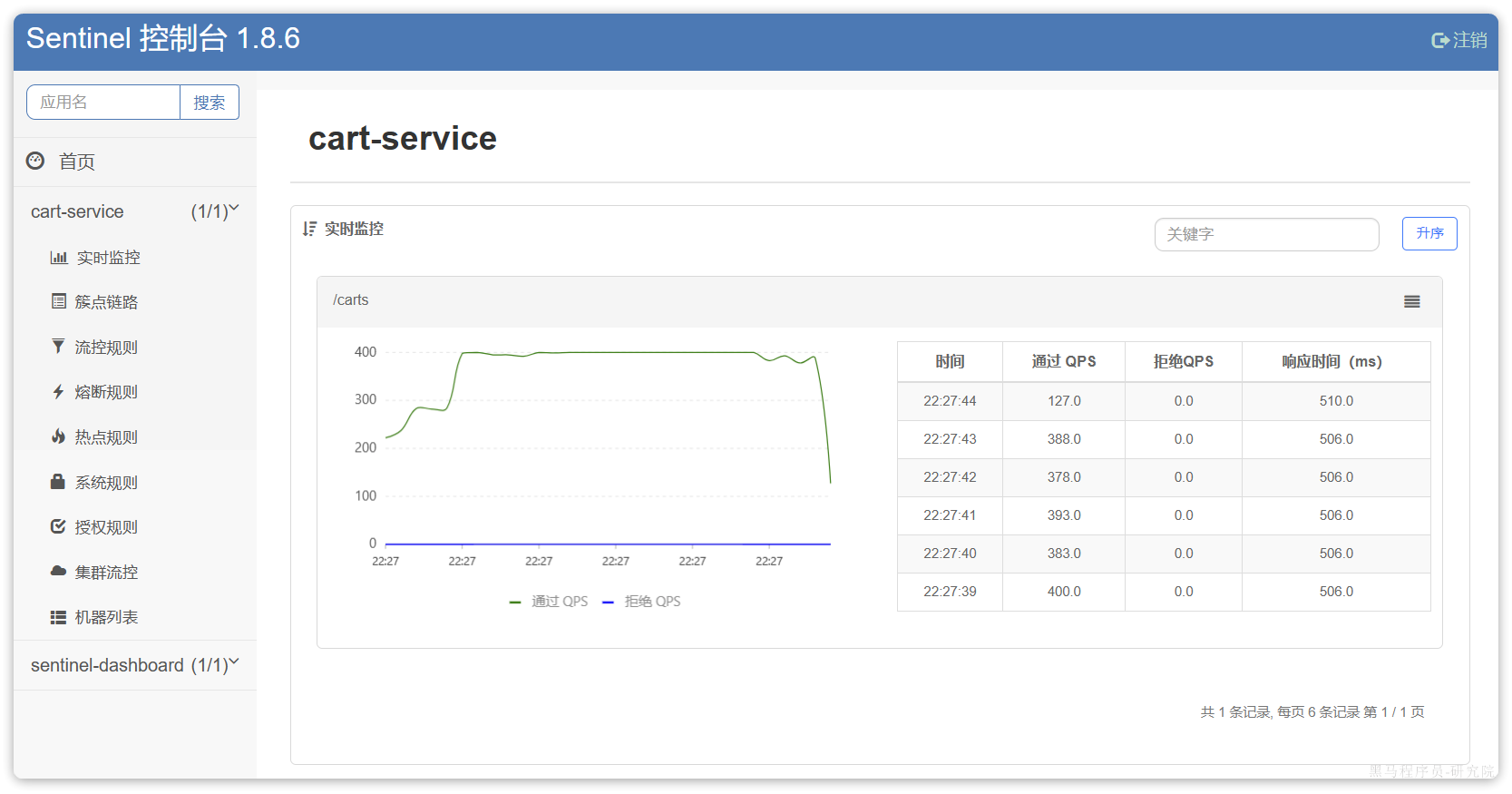

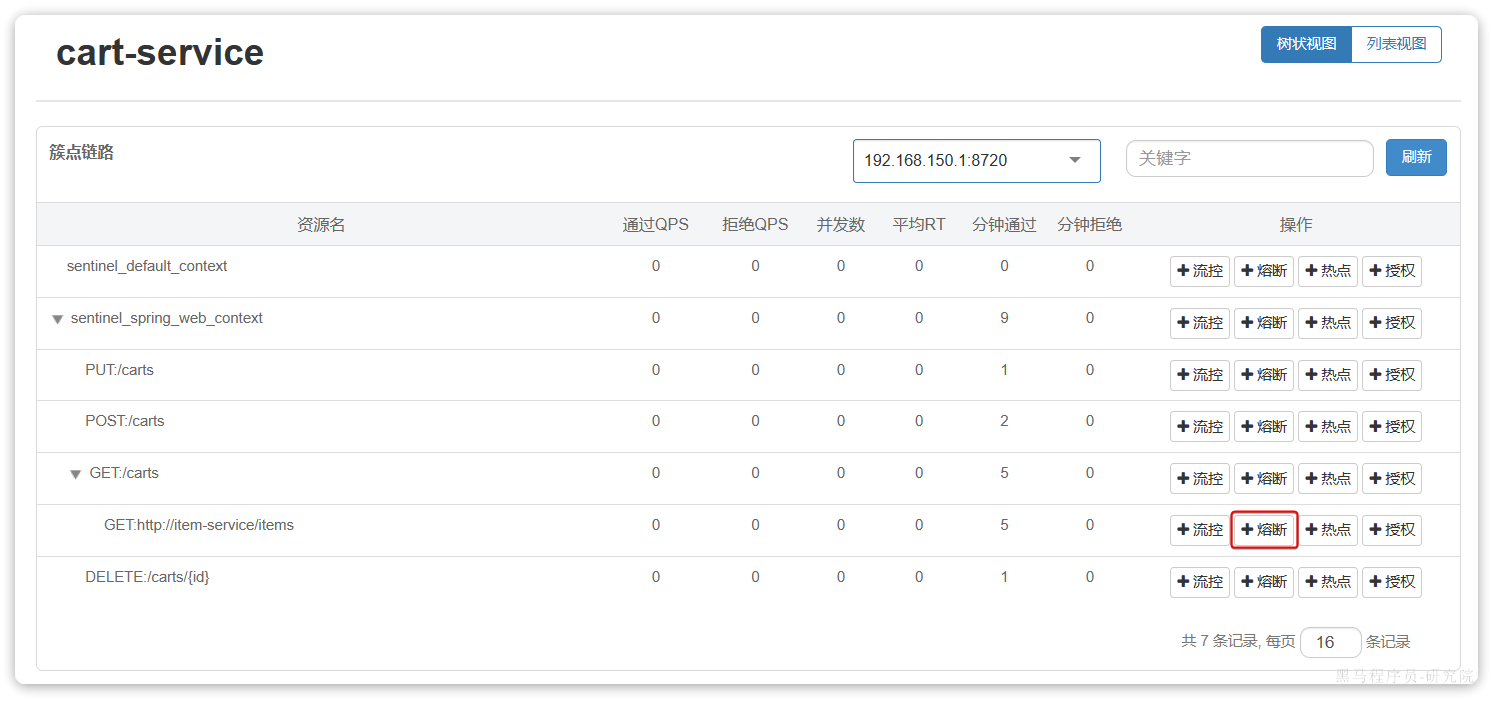

重启cart-service,然后访问查询购物车接口,sentinel的客户端就会将服务访问的信息提交到sentinel-dashboard控制台。并展示出统计信息:

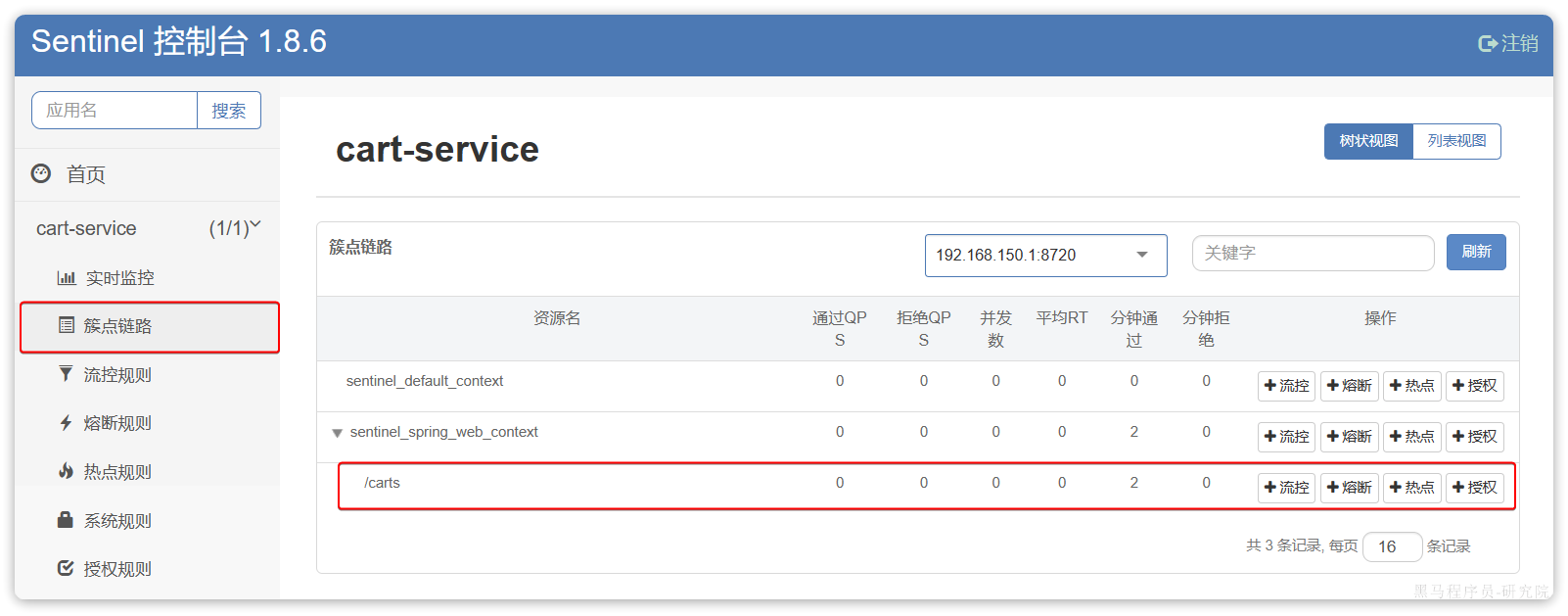

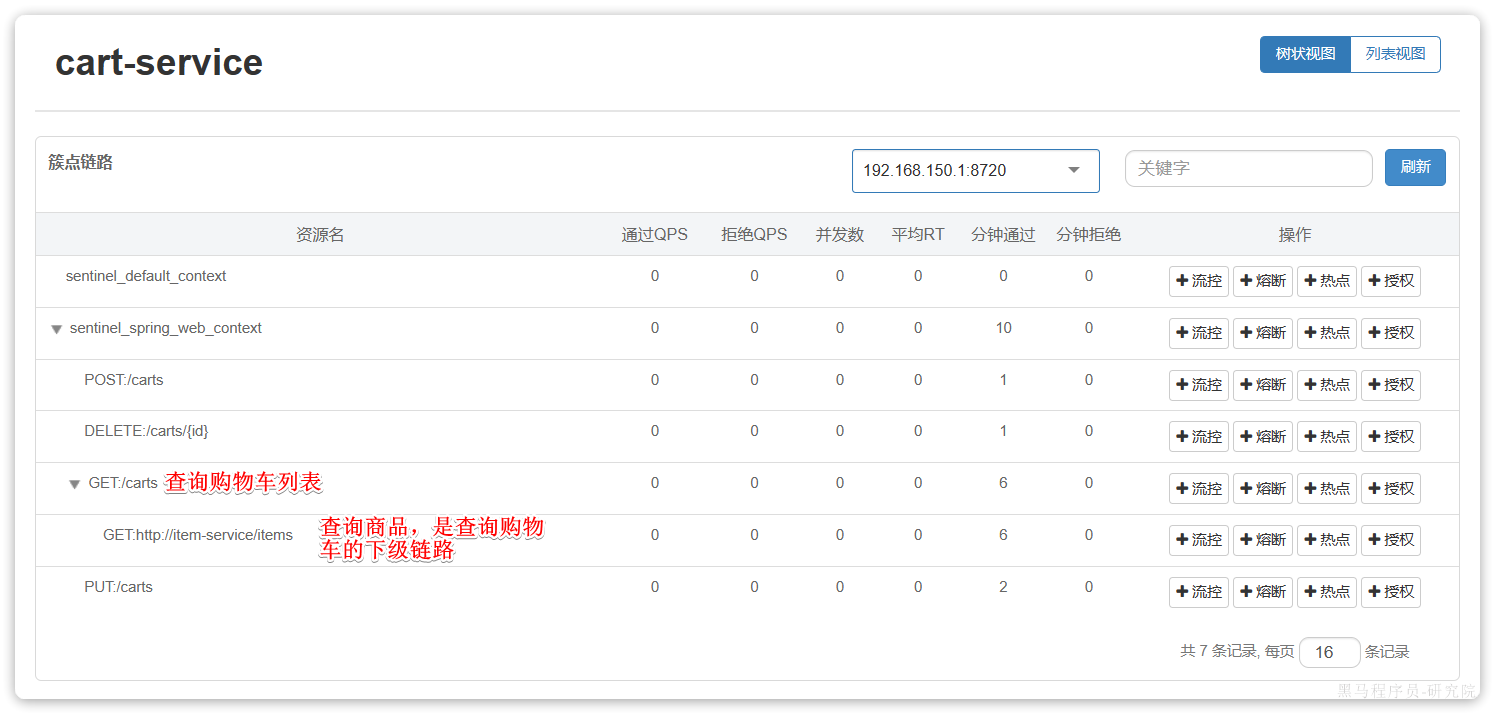

点击簇点链路菜单,会看到下面的页面:

所谓簇点链路,就是单机调用链路,是一次请求进入服务后经过的每一个被Sentinel监控的资源。默认情况下,Sentinel会监控SpringMVC的每一个Endpoint(接口)。

因此,/carts这个接口路径就是其中一个簇点,可以对其进行限流、熔断、隔离等保护措施。

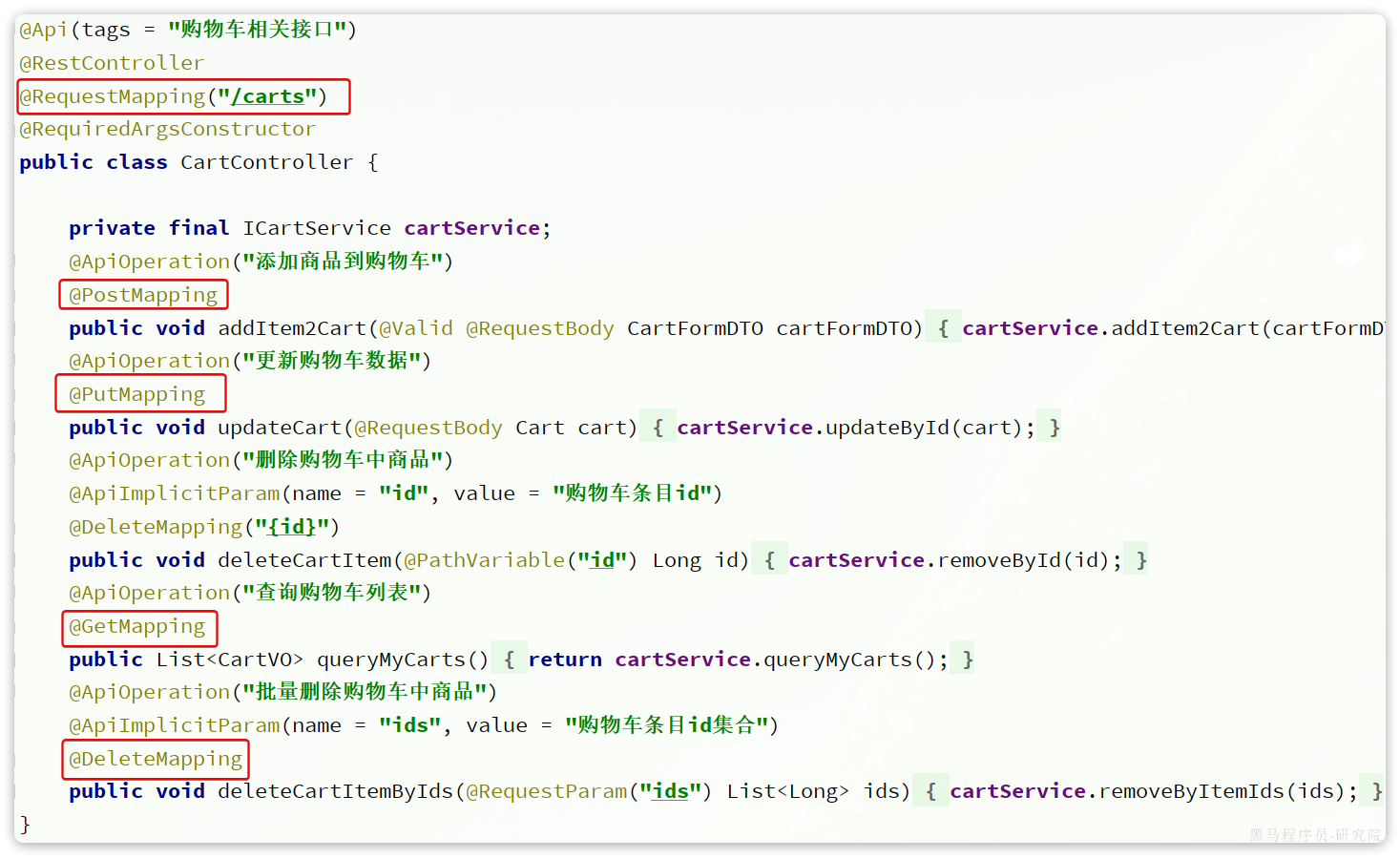

不过,需要注意的是,该项目的SpringMVC接口是按照Restful风格设计,因此购物车的查询、删除、修改等接口全部都是/carts路径:

默认情况下Sentinel会把路径作为簇点资源的名称,无法区分路径相同但请求方式不同的接口,查询、删除、修改等都被识别为一个簇点资源,这显然是不合适的。

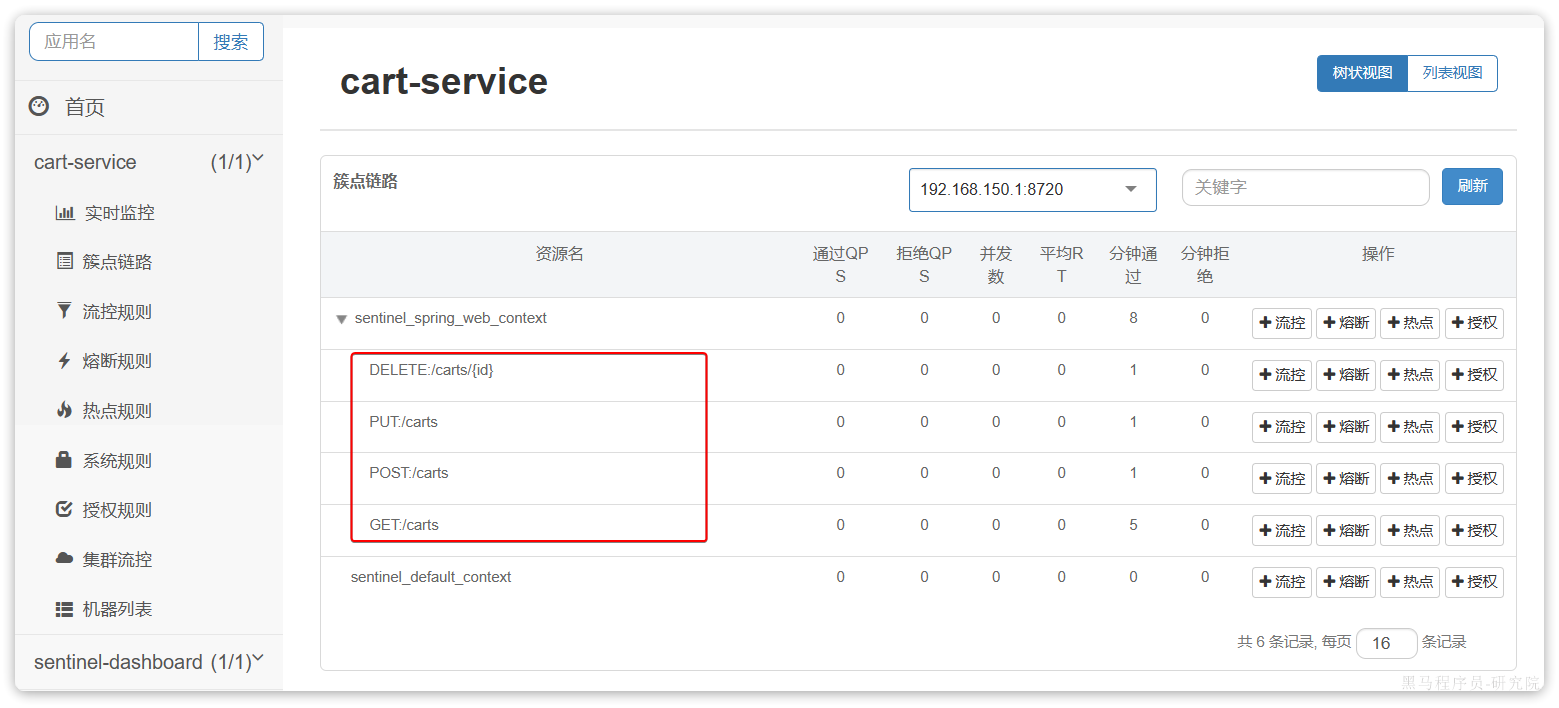

所以可以选择打开Sentinel的请求方式前缀,把请求方式 + 请求路径作为簇点资源名:

首先,在cart-service的application.yml中添加下面的配置:

|

|

然后,重启服务,通过页面访问购物车的相关接口,可以看到sentinel控制台的簇点链路发生了变化:

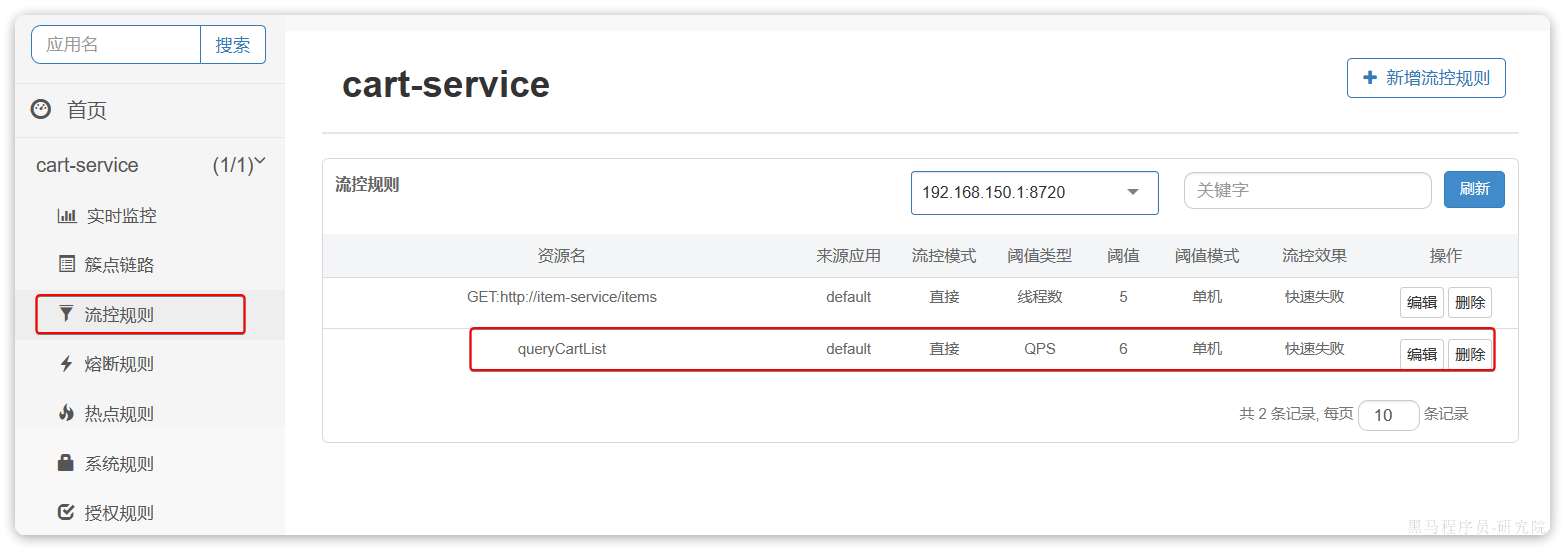

请求限流

在簇点链路后面点击流控按钮,即可对其做限流配置:

在弹出的菜单中这样填写:

这样就把查询购物车列表这个簇点资源的流量限制在了每秒6个,也就是最大QPS为6

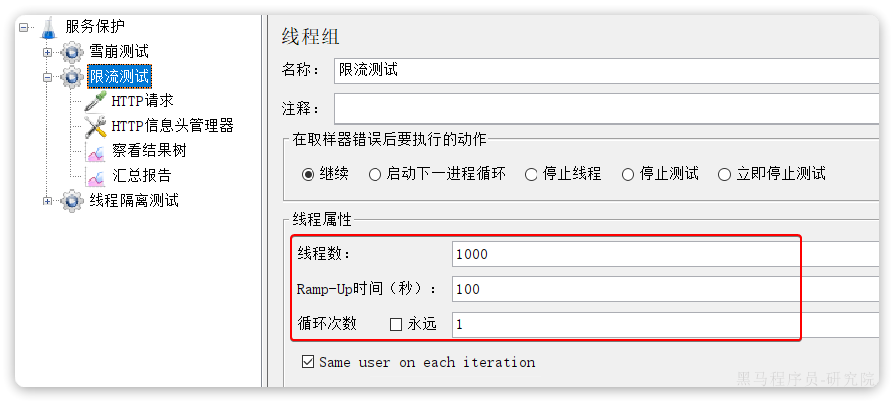

利用Jemeter做限流测试,我们每秒发出10个请求:(JMeter和测试文件都在资料中)

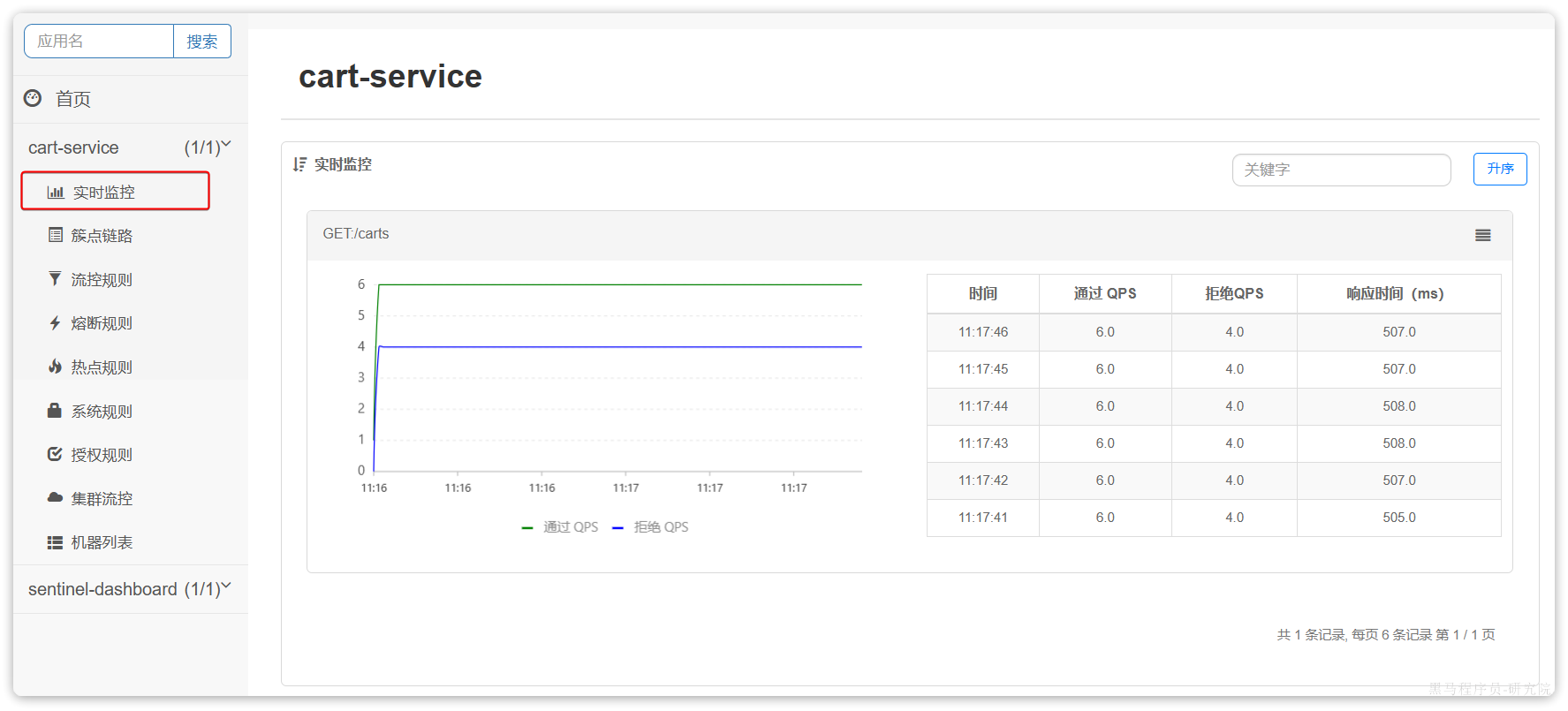

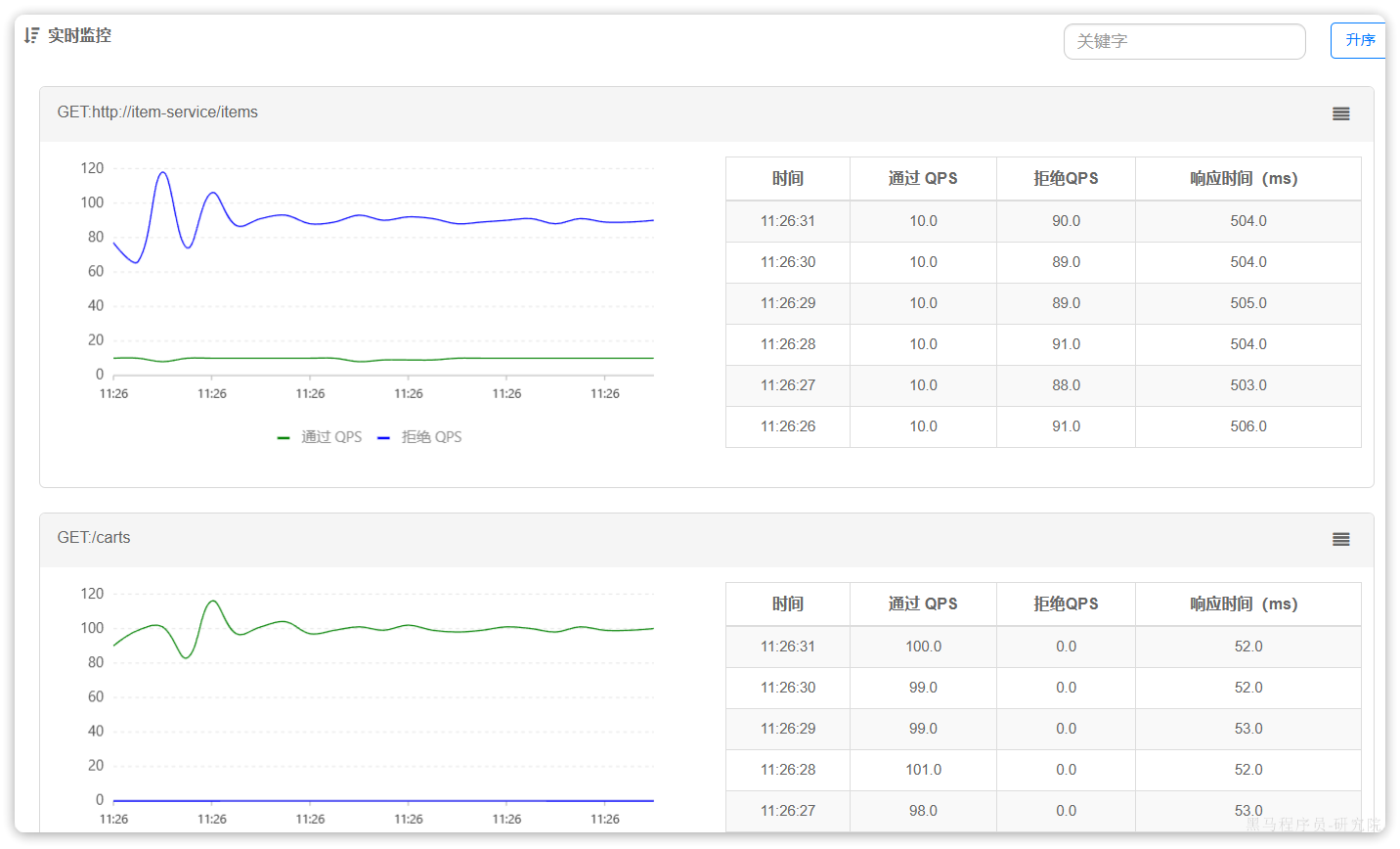

最终监控结果如下:

可以看出GET:/carts这个接口的通过QPS稳定在6附近,而拒绝的QPS在4附近,符合预期。

线程隔离

OpenFeign整合Sentinel

修改cart-service模块的application.yml文件,开启Feign的sentinel功能:

|

|

需要注意的是,默认情况下SpringBoot项目的tomcat最大线程数是200,允许的最大连接是8492,单机测试很难打满。

所以需要配置一下cart-service模块的application.yml文件,修改tomcat连接:(可以在Sentinel中改)

|

|

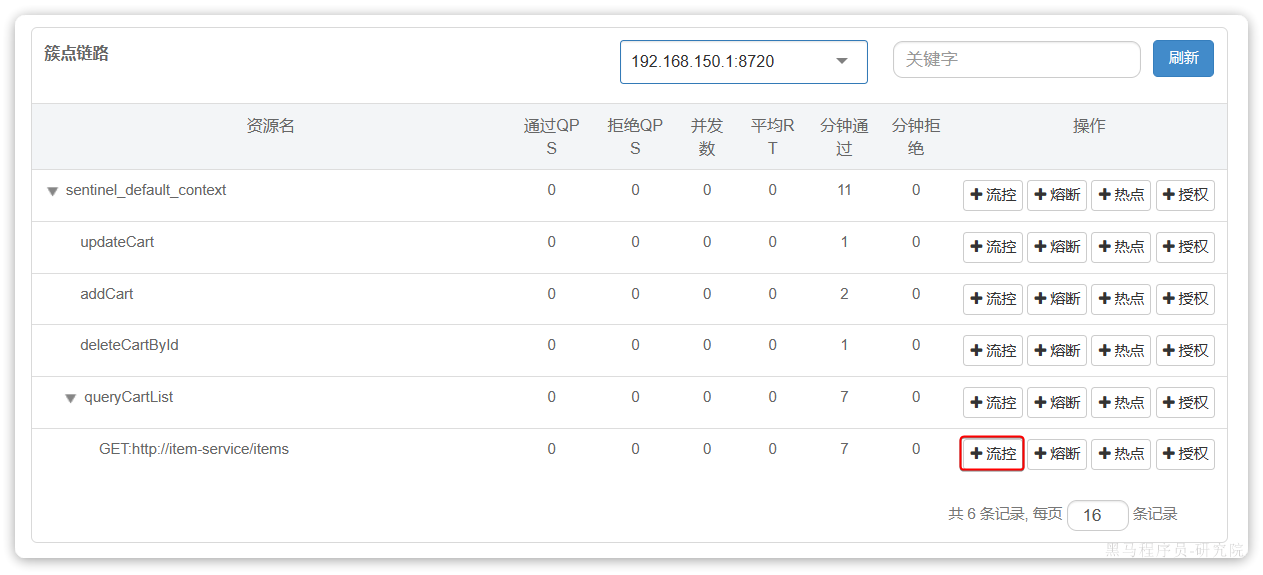

然后重启cart-service服务,可以看到查询商品的FeignClient自动变成了一个簇点资源:

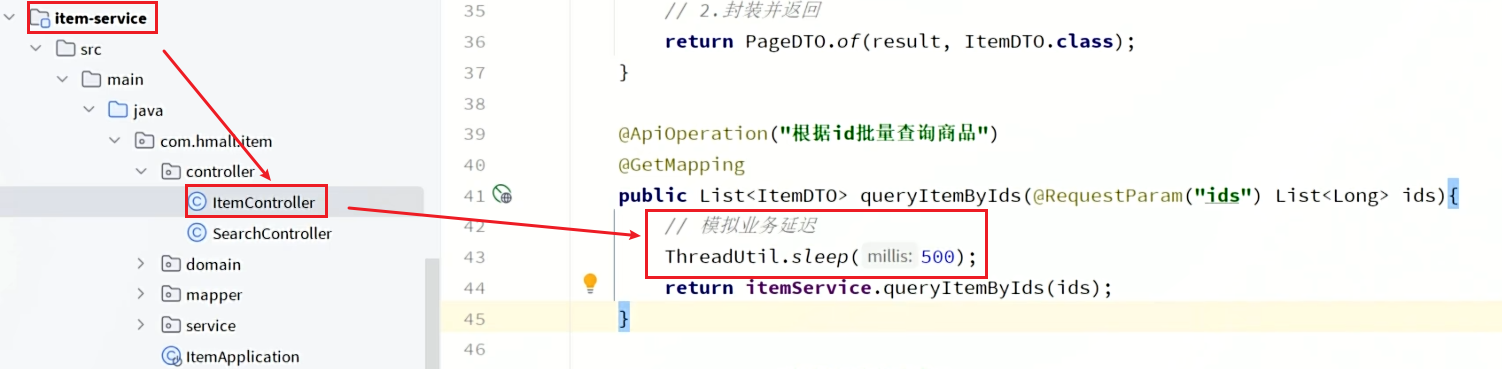

配置线程隔离

接下来,点击查询商品的FeignClient对应的簇点资源后面的流控按钮:

在弹出的表单中填写下面内容:

注意,这里勾选的是并发线程数限制,也就是说这个查询功能最多使用5个线程,而不是5QPS。如果查询商品的接口每秒处理2个请求,则5个线程的实际QPS在10左右,而超出的请求自然会被拒绝。

测试前可以在代码中模拟业务延迟:

利用Jemeter测试,每秒发送100个请求:

最终测试结果如下:

进入查询购物车的请求每秒大概在100,而在查询商品时却只剩下每秒10左右,符合预期

此时如果通过页面访问购物车的其它接口,例如添加购物车、修改购物车商品数量,发现不受影响:

响应时间非常短,这就证明线程隔离起到了作用,尽管查询购物车这个接口并发很高,但是它能使用的线程资源被限制了,因此不会影响到其它接口。

Fallback

前面利用线程隔离对查询购物车业务进行隔离,保护了购物车服务的其它接口。由于查询商品的功能耗时较高(模拟了500毫秒延时),再加上线程隔离限定了线程数为5,导致接口吞吐能力有限,最终QPS只有10左右。这就导致了几个问题:

第一,超出的QPS上限的请求就只能抛出异常,从而导致购物车的查询失败。但从业务角度来说,即便没有查询到最新的商品信息,购物车也应该展示给用户,用户体验更好。也就是给查询失败设置一个降级处理逻辑。

第二,由于查询商品的延迟较高(模拟的500ms),从而导致查询购物车的响应时间也变的很长。这样不仅拖慢了购物车服务,消耗了购物车服务的更多资源,而且用户体验也很差。对于商品服务这种不太健康的接口,应该直接停止调用,直接走降级逻辑,避免影响到当前服务。也就是将商品查询接口熔断。

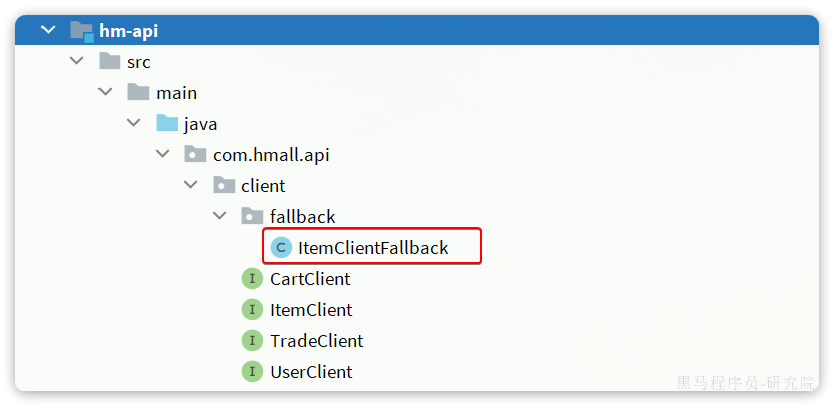

编写降级逻辑

触发限流或熔断后的请求不一定要直接报错,也可以返回一些默认数据或者友好提示,用户体验会更好。

给FeignClient编写失败后的降级逻辑有两种方式:

- 方式一:FallbackClass,无法对远程调用的异常做处理

- 方式二:FallbackFactory,可以对远程调用的异常做处理,一般选择这种方式。

这里演示方式二的失败降级处理。

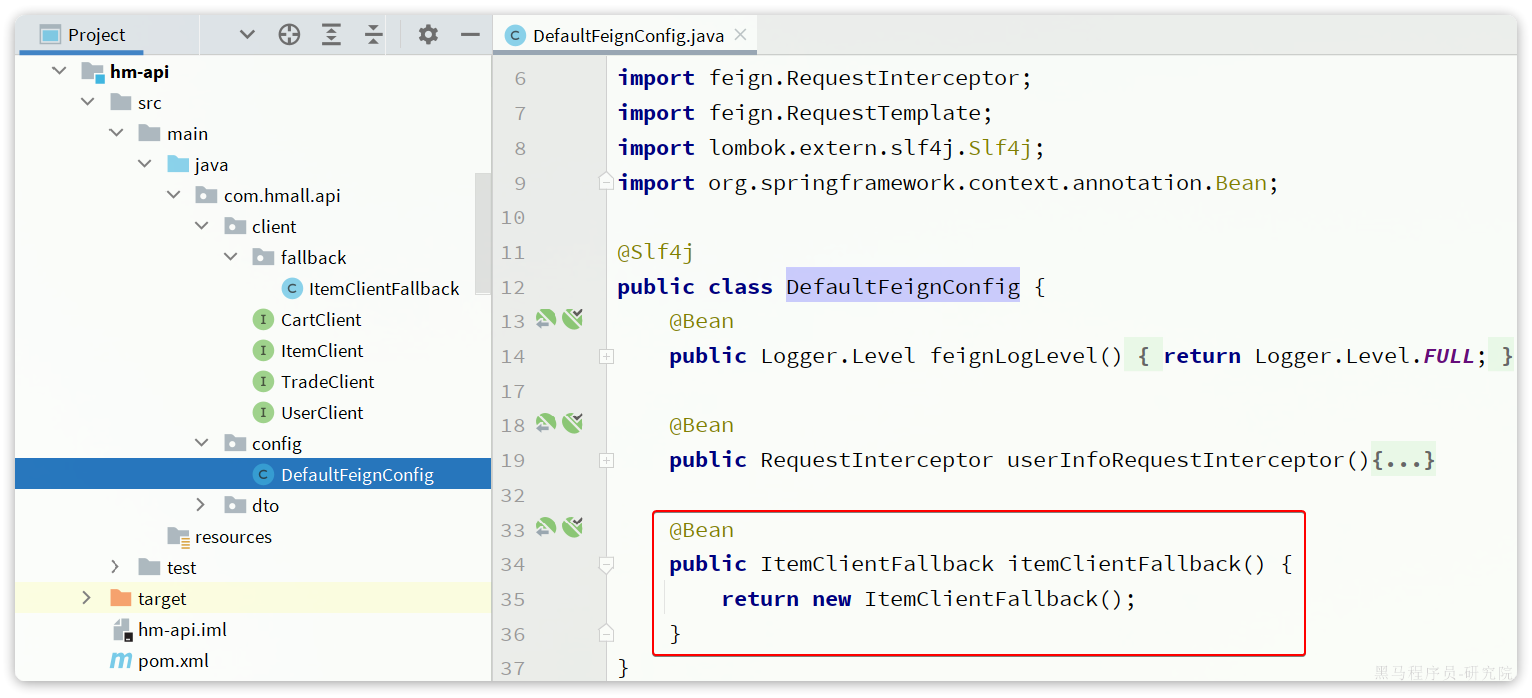

步骤一:在hm-api模块中给ItemClient定义降级处理类,实现FallbackFactory:

代码如下:

|

|

步骤二:在hm-api模块中的com.hmall.api.config.DefaultFeignConfig类中将ItemClientFallback注册为一个Bean:

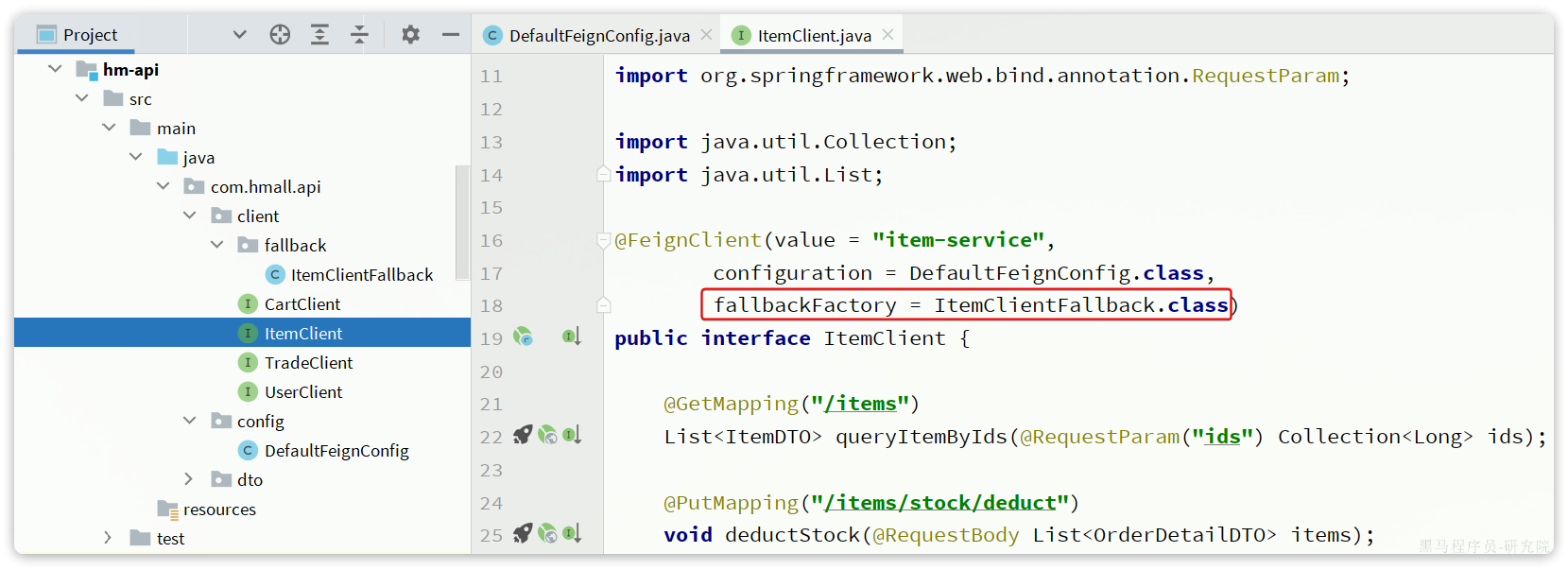

步骤三:在hm-api模块中的ItemClient接口中使用ItemClientFallbackFactory:

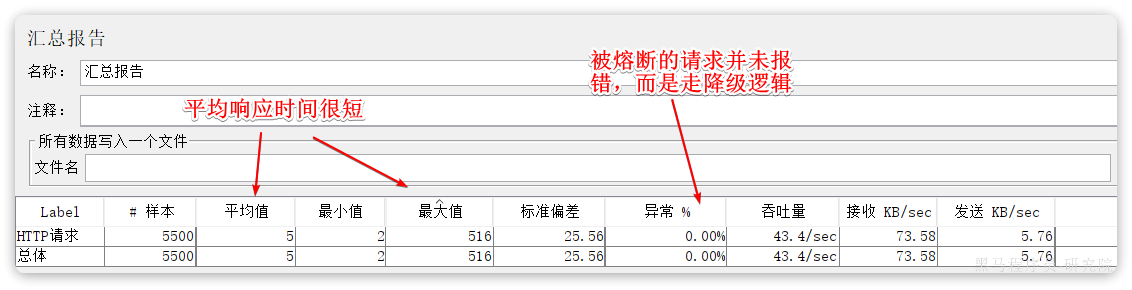

重启后,如果流控规则消失了就重新配置一下最大线程数为6,再次测试,发现被限流的请求不再报错,走了降级逻辑:

如果异常一开始是0,但访问达到一定数量后异常开始提高,失败的请求响应

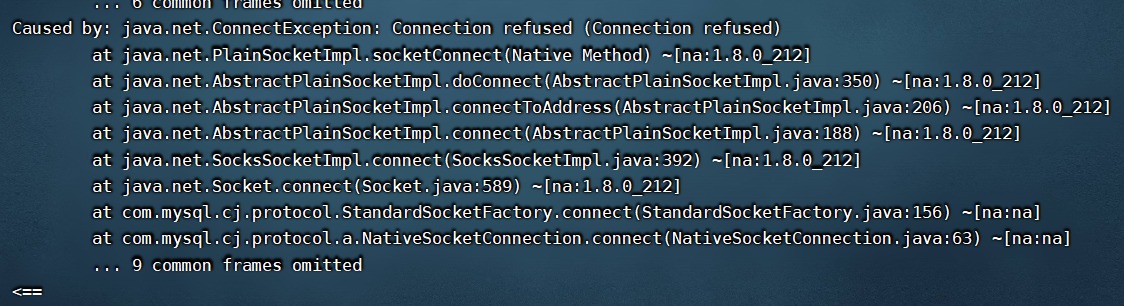

org.apache.http.conn.HttpHostConnectException: Connect to localhost:8082 [localhost/127.0.0.1, localhost/0:0:0:0:0:0:0:1] failed: Connection refused: connect的话,有可能是mysql崩溃了可以在虚拟机中使用

docker ps看看mysql被挂起的时间,如果挂起时间和刚刚测试到现在的时间差不多,大概率是mysql被访问崩溃了,和Fallback没关系

但是未被限流的请求延时依然很高:

导致最终的平局响应时间较长。

服务熔断

查询商品的RT(Response Time)较高(模拟的500ms),从而导致查询购物车的RT也变的很长。这样不仅拖慢了购物车服务,消耗了购物车服务的更多资源,而且用户体验也很差。

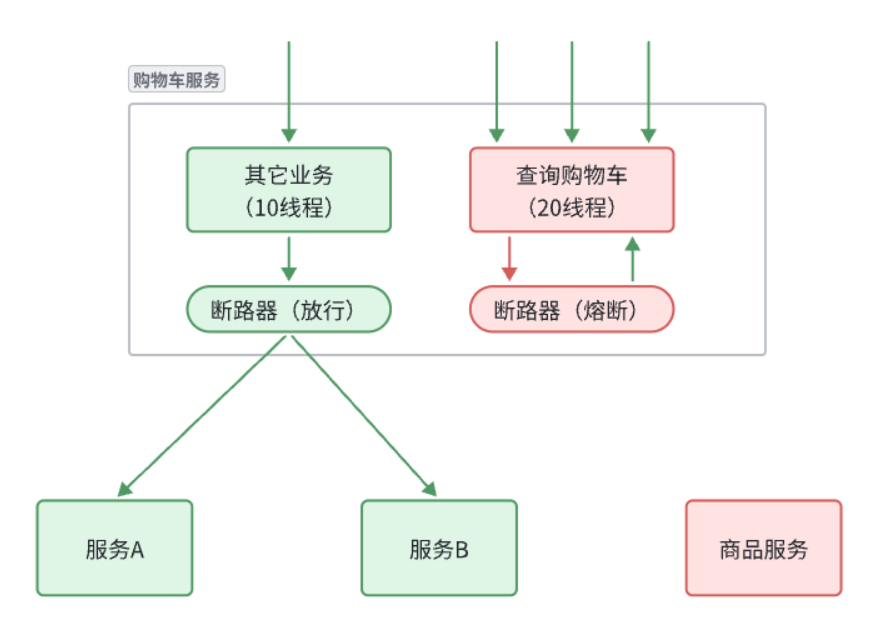

对于商品服务这种不太健康的接口,应该停止调用,直接走降级逻辑,避免影响到当前服务。也就是将商品查询接口熔断。当商品服务接口恢复正常后,再允许调用。这其实就是断路器的工作模式了。

Sentinel中的断路器不仅可以统计某个接口的慢请求比例,还可以统计异常请求比例。当这些比例超出阈值时,就会熔断该接口,即拦截访问该接口的一切请求,降级处理;当该接口恢复正常时,再放行对于该接口的请求。

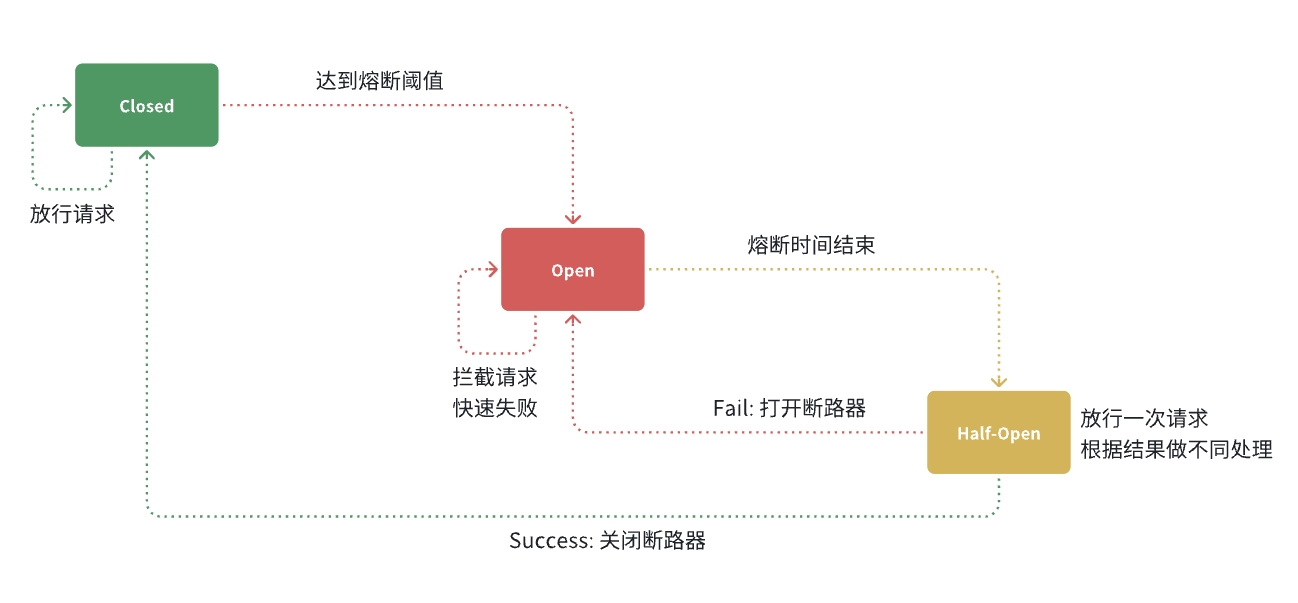

断路器的工作状态切换有一个状态机来控制:

状态机包括三个状态:

- closed:关闭状态,断路器放行所有请求,并开始统计异常比例、慢请求比例。超过阈值则切换到open状态

- open:打开状态,服务调用被熔断,访问被熔断服务的请求会被拒绝,快速失败,直接走降级逻辑。Open状态持续一段时间后会进入half-open状态

- half-open:半开状态,放行一次请求,根据执行结果来判断接下来的操作。

- 请求成功:则切换到closed状态

- 请求失败:则切换到open状态

可以在控制台通过点击簇点后的**熔断**按钮来配置熔断策略:

在弹出的表格中这样填写:

这种是按照慢调用比例来做熔断,上述配置的含义是:

- RT超过200毫秒的请求调用就是慢调用

- 统计最近1000ms内的最少5次请求,如果慢调用比例不低于0.5(50%),则触发熔断

- 熔断持续时长20s

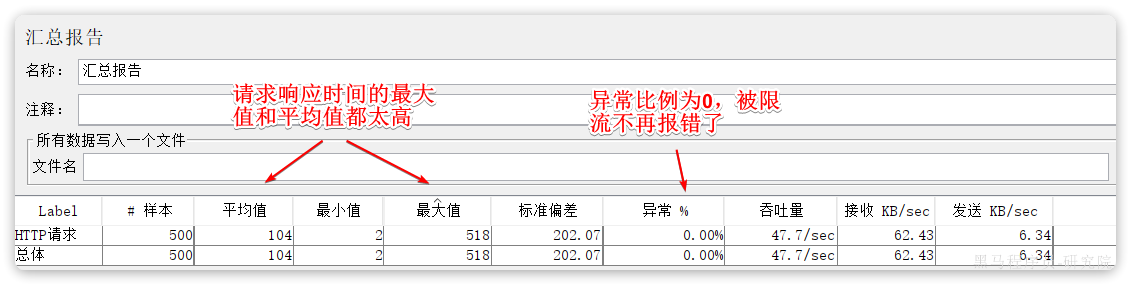

配置完成后,再次利用JMeter测试,可以发现:

在一开始一段时间是允许访问的,后来触发熔断后,查询商品服务的接口通过QPS直接为0,所有请求都被熔断了。而查询购物车的本身并没有受到影响。

此时整个购物车查询服务的平均RT影响不大:

分布式事务

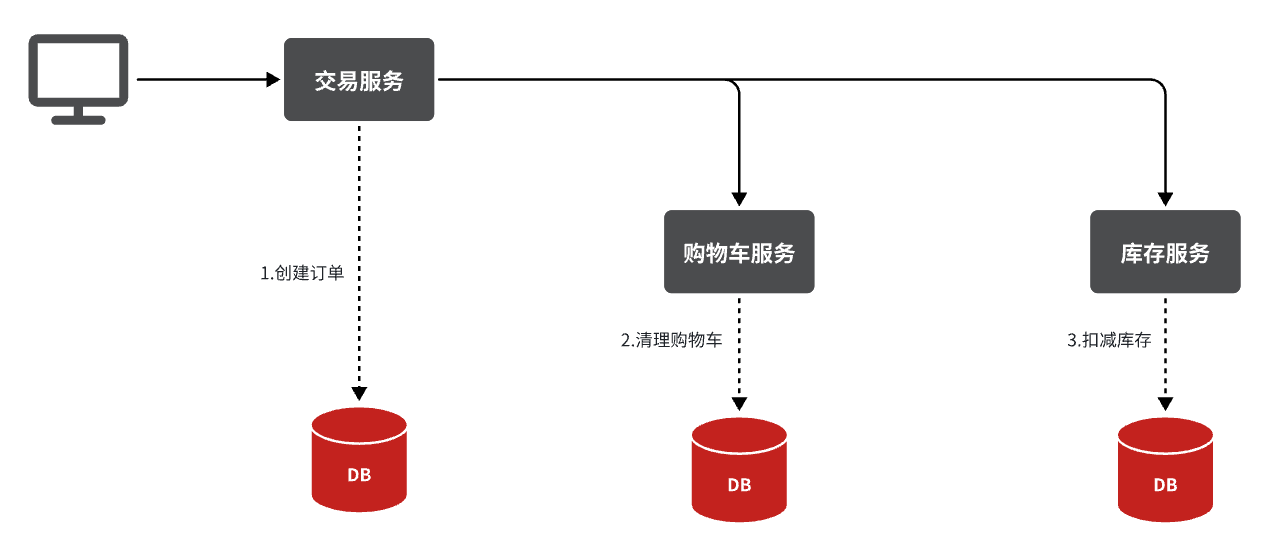

项目中的下单业务整体流程:

由于订单、购物车、商品分别在三个不同的微服务,而每个微服务都有自己独立的数据库,因此下单过程中就会跨多个数据库完成业务。而每个微服务都会执行自己的本地事务:

- 交易服务:下单事务

- 购物车服务:清理购物车事务

- 库存服务:扣减库存事务

整个业务中,各个本地事务是有关联的。因此每个微服务的本地事务,也可以称为分支事务。多个有关联的分支事务一起就组成了全局事务。我们必须保证整个全局事务同时成功或失败。

每一个分支事务就是传统的单体事务,都可以满足ACID特性(原子性,一致性,隔离性,持久性),但全局事务跨越多个服务、多个数据库,是否还能满足呢?

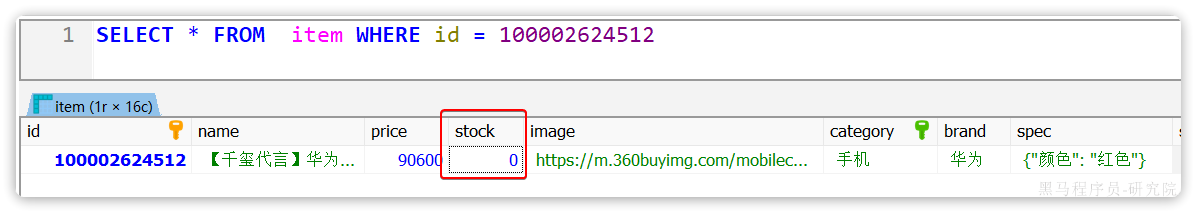

可以通过下单业务来测试:当库存不足时下单会发生什么?

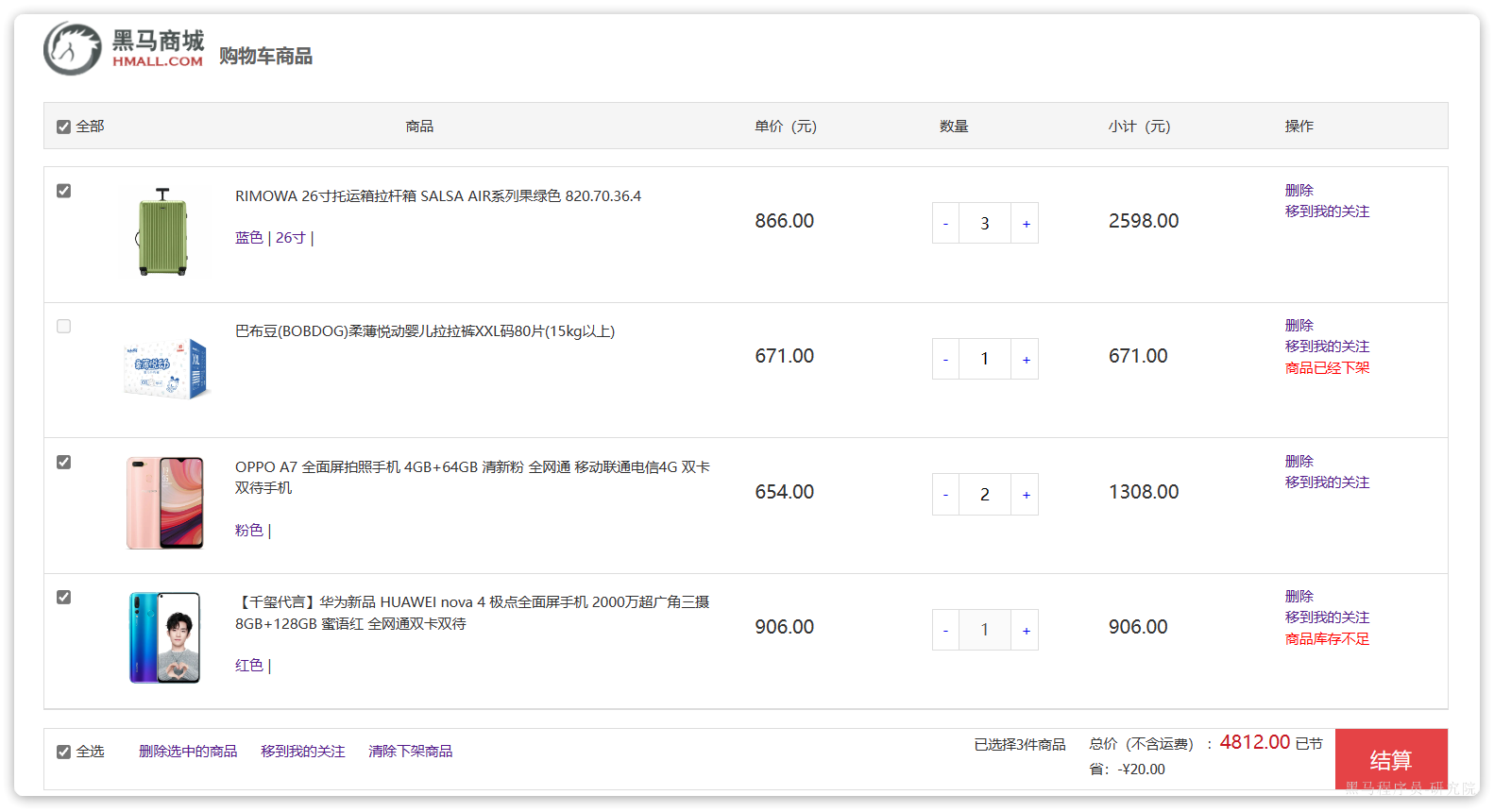

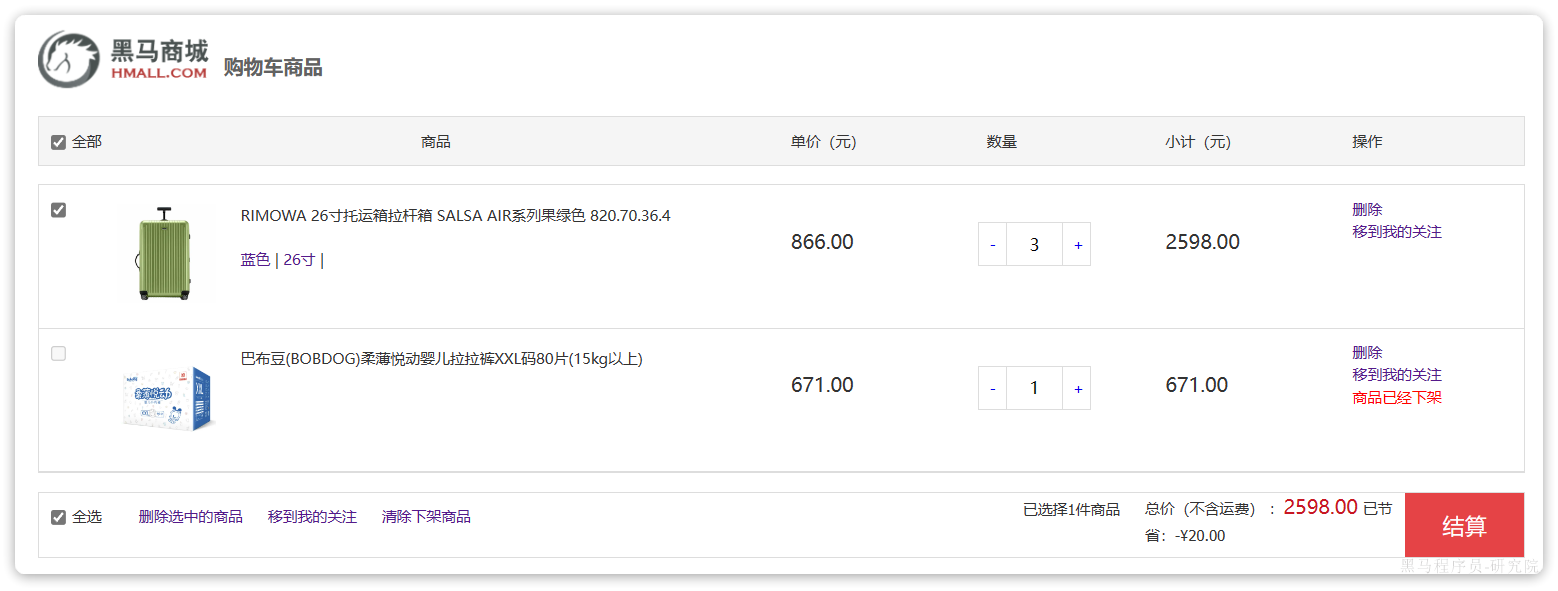

先进入购物车页面:

目前购物车有4种商品,选中其中两个结算下单,进入订单结算页面:

然后将购物车中某个商品的库存修改为0:

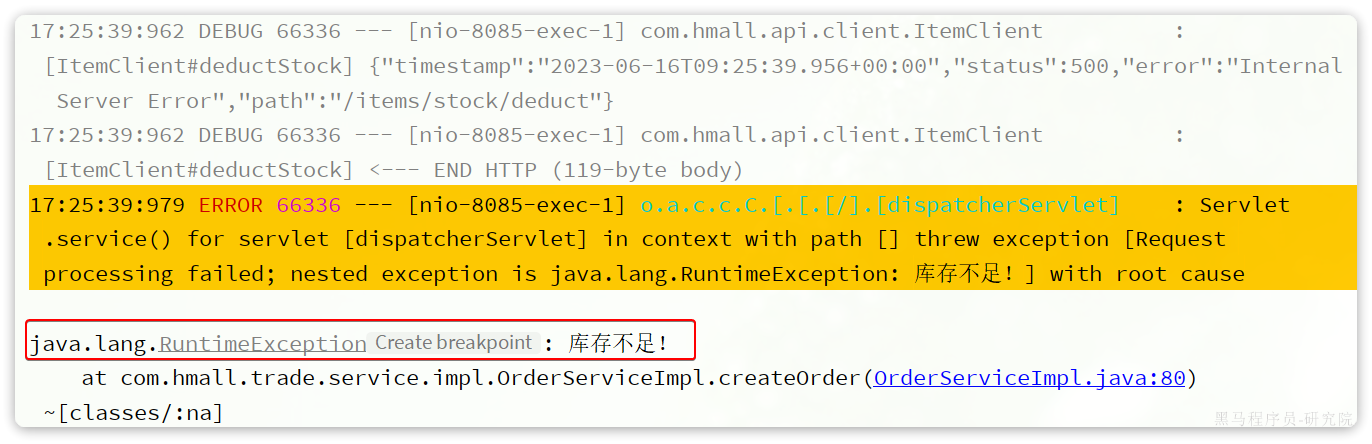

然后,提交订单,最终因库存不足导致下单失败:

然后查看购物车列表,发现购物车数据依然被清空了,并未回滚:

事务并未遵循ACID的原则,归其原因就是参与事务的多个子业务在不同的微服务,跨越了不同的数据库。虽然每个单独的业务都能在本地遵循ACID,但是它们互相之间没有感知,不知道有人失败了,无法保证最终结果的统一,也就无法遵循ACID的事务特性了。

这就是分布式事务问题,出现以下情况之一就可能产生分布式事务问题:

- 业务跨多个服务实现

- 业务跨多个数据源实现

认识Seata

解决分布式事务的方案有很多,但实现起来都比较复杂,因此我们一般会使用开源的框架来解决分布式事务问题。在众多的开源分布式事务框架中,功能最完善、使用最多的就是阿里巴巴在2019年开源的Seata了。

官网:https://seata.io/zh-cn/docs/overview/what-is-seata.html

其实分布式事务产生的一个重要原因,就是参与事务的多个分支事务互相无感知,不知道彼此的执行状态。因此解决分布式事务的思想非常简单:

就是找一个统一的事务协调者,与多个分支事务通信,检测每个分支事务的执行状态,保证全局事务下的每一个分支事务同时成功或失败即可。大多数的分布式事务框架都是基于这个理论来实现的。

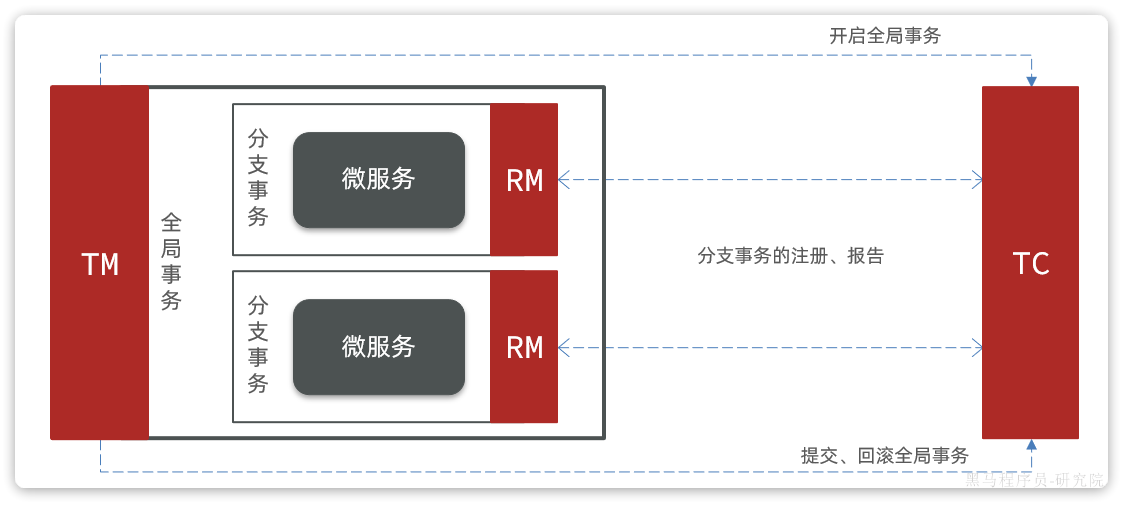

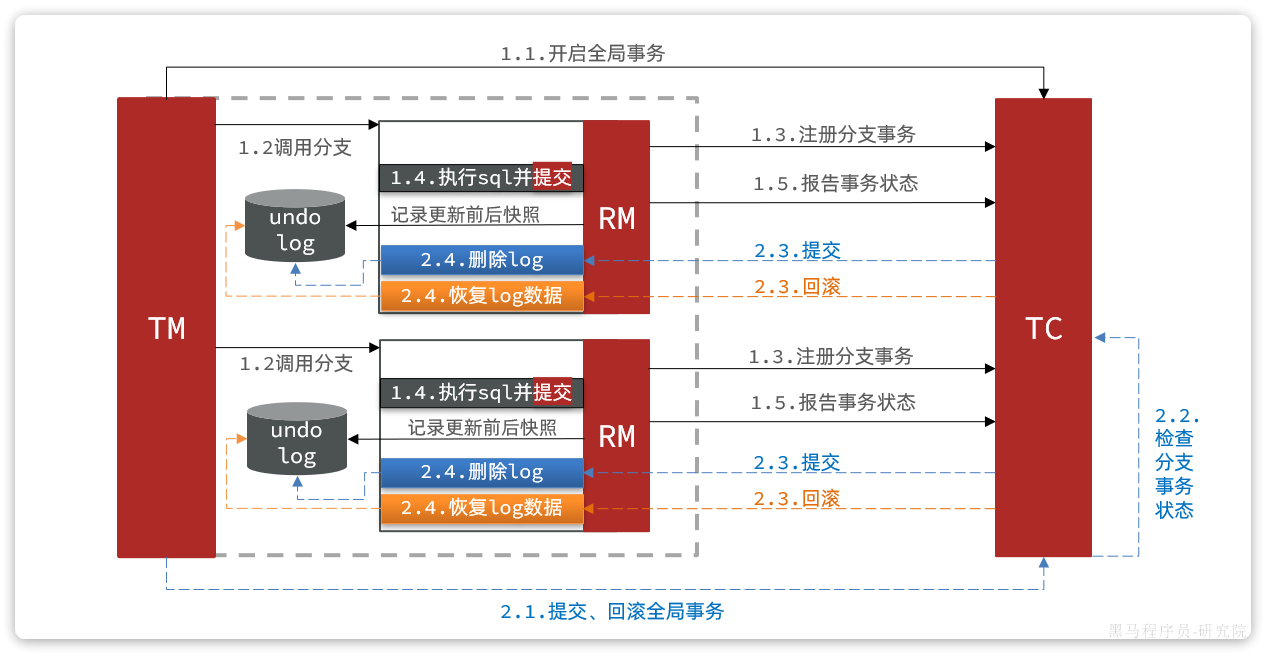

Seata也不例外,在Seata的事务管理中有三个重要的角色:

- TC (Transaction Coordinator) - **事务协调者:**维护全局和分支事务的状态,协调全局事务提交或回滚。

- TM (Transaction Manager) - **事务管理器:**定义全局事务的范围、开始全局事务、提交或回滚全局事务。

- RM (Resource Manager) - **资源管理器:**管理分支事务,与TC交谈以注册分支事务和报告分支事务的状态,并驱动分支事务提交或回滚。

Seata的工作架构如图所示:

其中,TM和RM可以理解为Seata的客户端部分,引入到参与事务的微服务依赖中即可。将来TM和RM就会协助微服务,实现本地分支事务与TC之间交互,实现事务的提交或回滚。

而TC服务则是事务协调中心,是一个独立的微服务,需要单独部署。

部署TC服务

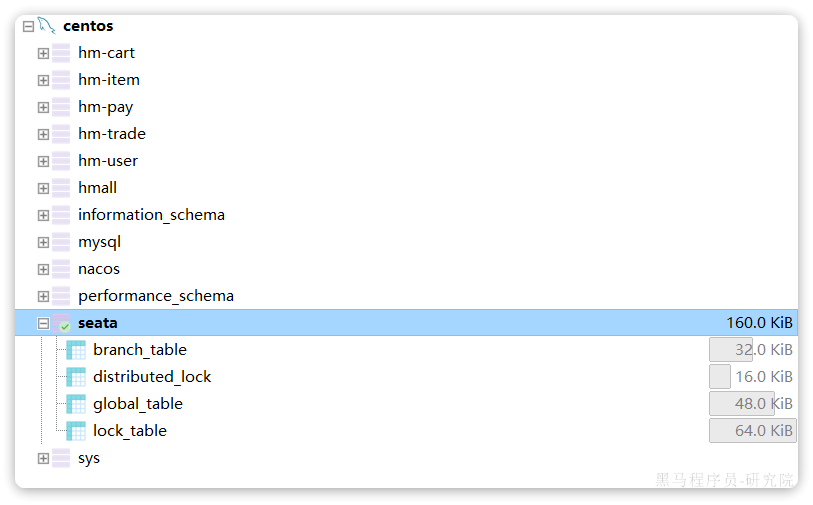

准备数据库表

Seata支持多种存储模式,但考虑到持久化的需要,一般选择基于数据库存储。执行资料中提供的seata-tc.sql,导入数据库表:

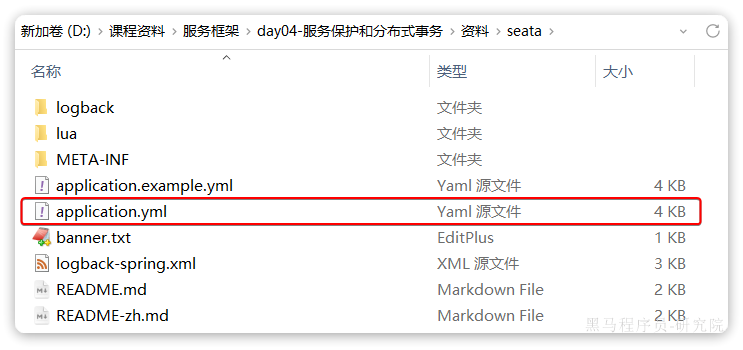

准备配置文件

资料准备了一个seata目录,其中包含了seata运行时所需要的配置文件:

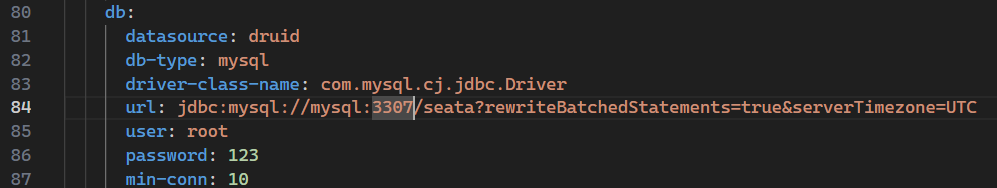

其中第80行左右配置的是数据库连接信息,默认端口是3306,可以根据自己的情况更改

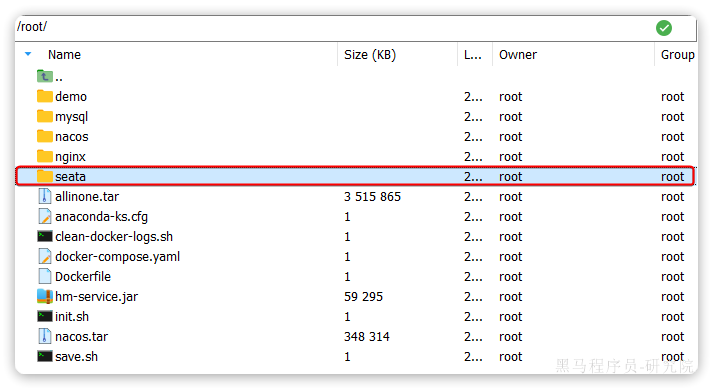

将整个seata文件夹拷贝到虚拟机的/root目录:

Docker部署

需要注意,要确保nacos、mysql都在hm-net网络中。如果某个容器不再hm-net网络,可以参考下面的命令将某容器加入指定网络:

|

|

在虚拟机的/root目录执行下面的命令:

|

|

记得把第四行的ip地址改成自己的虚拟机ip地址

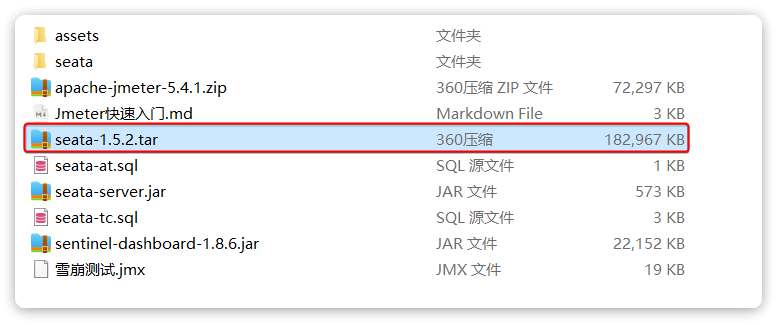

如果镜像下载困难,也可以把资料提供的镜像上传到虚拟机并加载(docker load -i seata-1.5.2.tar):

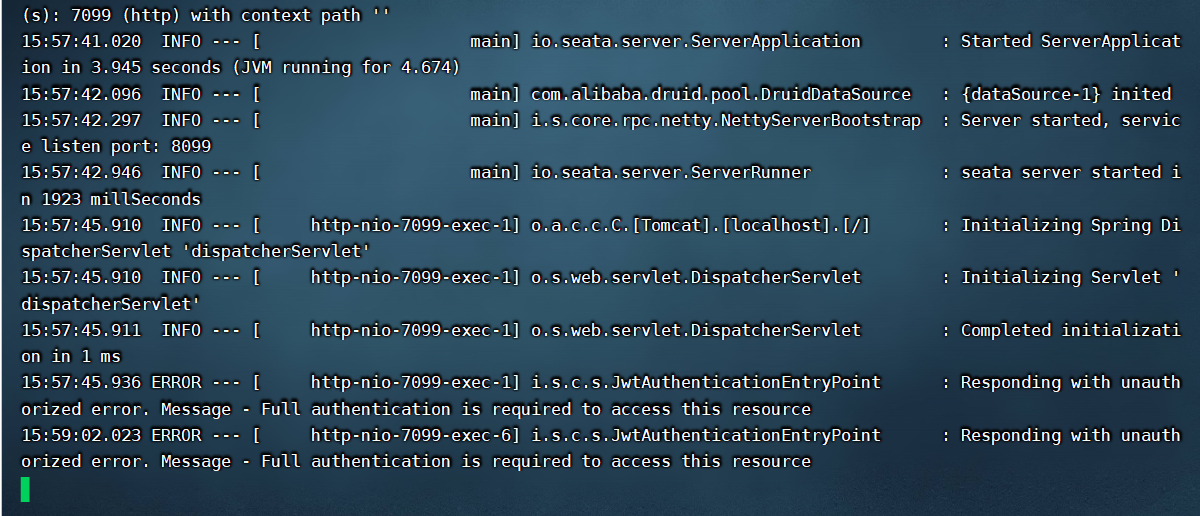

部署成功后可以使用docker ps查看是否创建成功,同时也可以通过docker logs -f seata指令来查看seata启动后的日志以确保正常启动,如果报错就根据报错情况修改配置

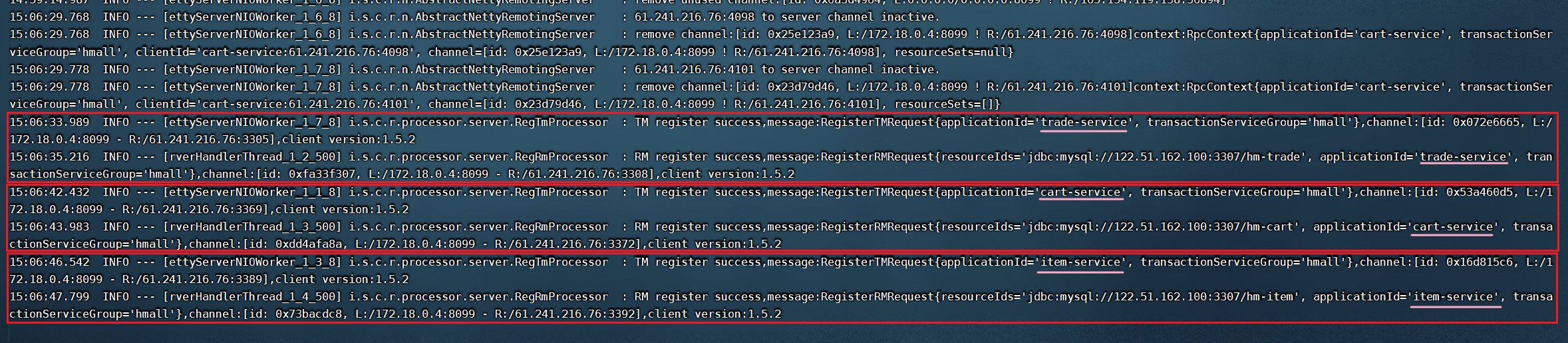

正常启动后的日志:

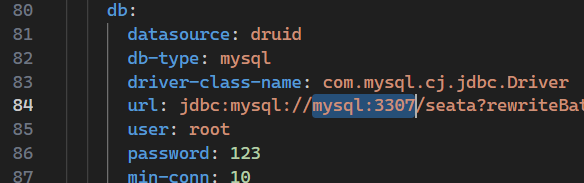

如果数据库连接报错,可以试着把

application.yml中第84行的mysql:端口号改成虚拟机ip:端口号

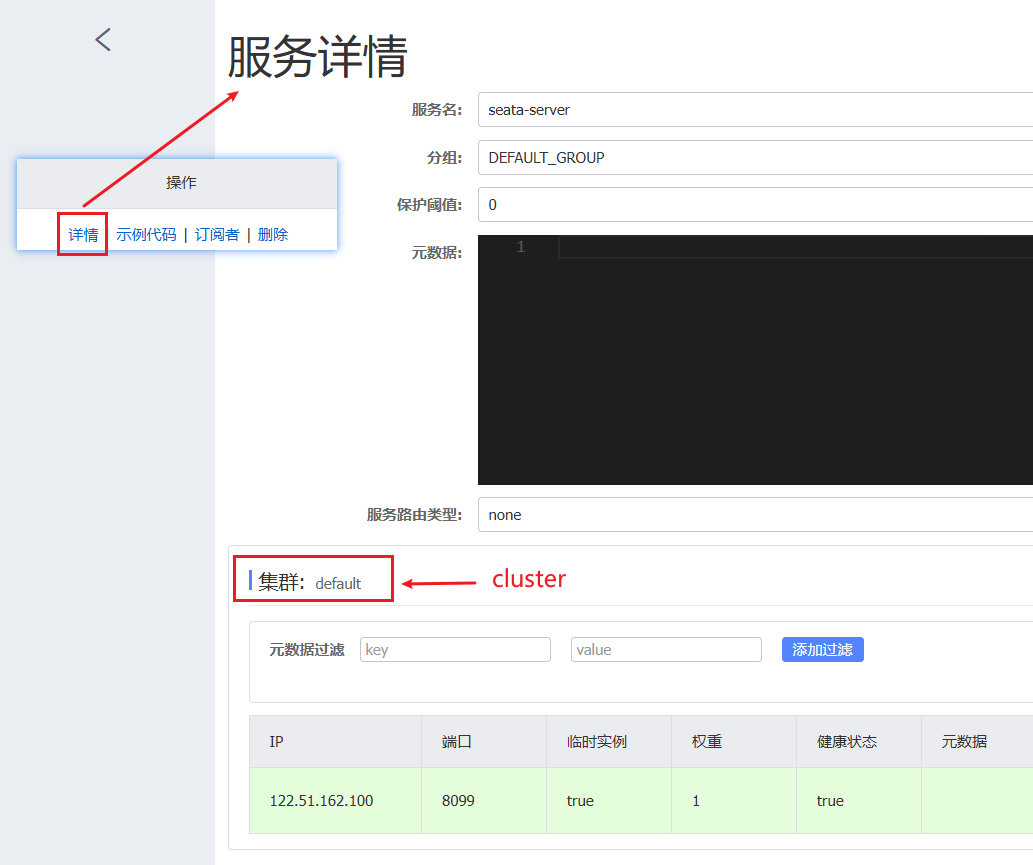

此时,就可以在nacos的控制台看见seata-server了,同时也可以在浏览器地址输入http://虚拟机ip:7099/来访问seata的控制台,默认的账号密码都是admin

微服务集成Seata

参与分布式事务的每一个微服务都需要集成Seata。下单流程涉及到了cart-service、item-service和trade-service,所以给这三个模块引入依赖

引入依赖

为了方便各个微服务集成seata,需要把seata配置共享到nacos,因此不仅要引入seata依赖,还要引入nacos依赖:(cart-service已有前两个依赖,只需引入第三个)

|

|

配置Nacos

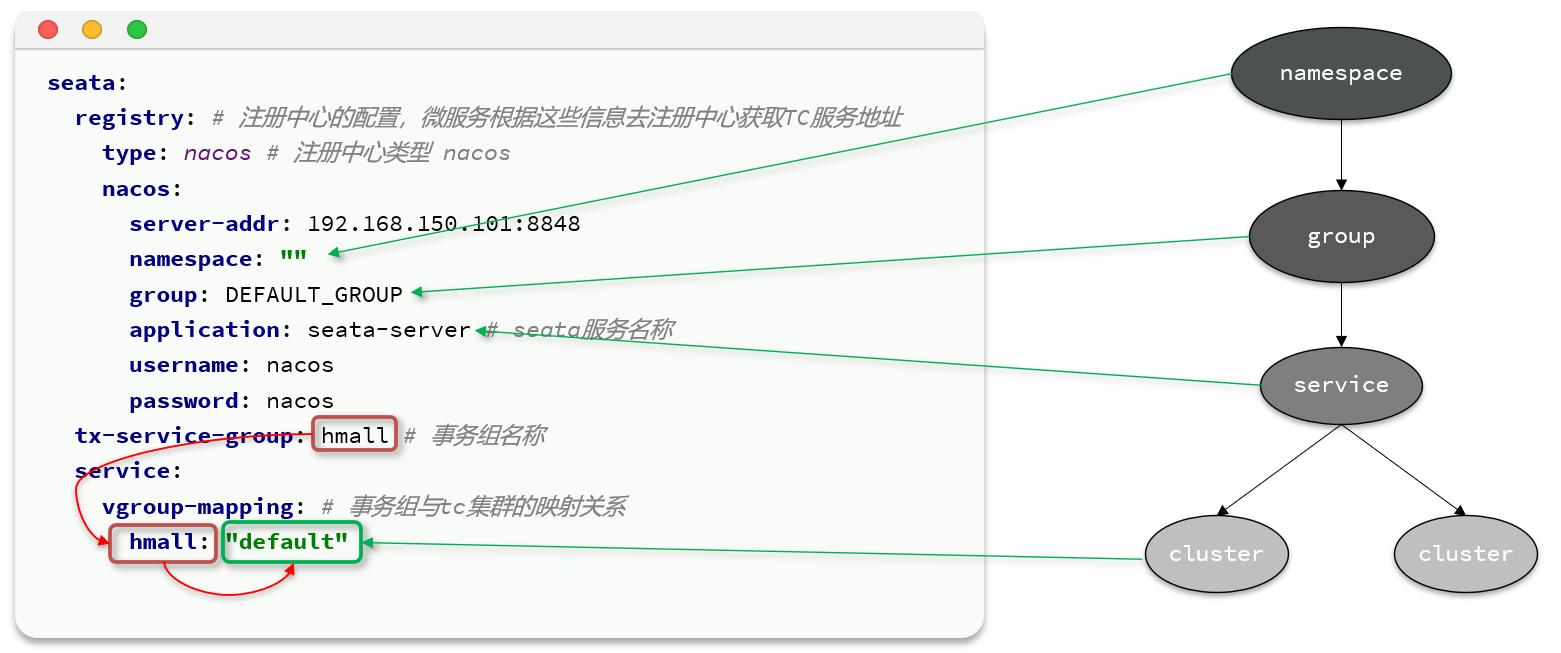

首先在nacos上添加一个共享的seata配置,命名为shared-seata.yaml:

配置内容如下:

|

|

Nacos配置说明

配置bootstrap.yaml

修改cart-service、item-service和trade-service模块中的src/main/resources/bootstrap.yaml文件,没有则新建一个,以cart-service为例,内容如下:

|

|

item-service和trade-service模块之前没有配置bootstrap,此时配置后可以参考cart-service模块优化application.yaml中的内容

item-service优化后的application.yaml参考:

|

|

trade-service优化后的application.yaml参考:

|

|

查看配置结果

重启这三个模块服务,然后打开终端,查看虚拟机中的Seata的日志(docker logs -f seata),结果如下说明是配置成功了

XA模式

Seata支持四种不同的分布式事务解决方案:

- XA

- TCC

- AT

- SAGA

这里以XA模式和AT模式来讲解其实现原理。

XA 规范 是 X/Open 组织定义的分布式事务处理(DTP,Distributed Transaction Processing)标准,XA 规范 描述了全局的TM与局部的RM之间的接口,几乎所有主流的数据库都对 XA 规范 提供了支持。

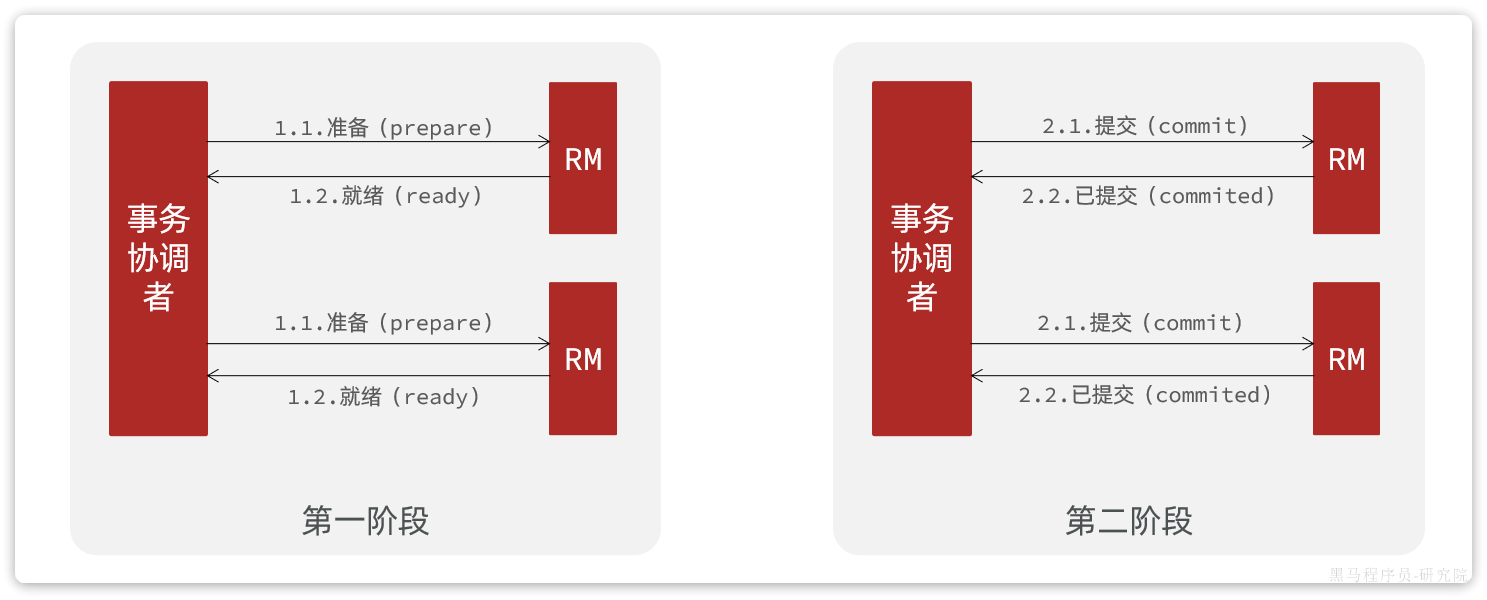

两阶段提交

A是规范,目前主流数据库都实现了这种规范,实现的原理都是基于两阶段提交。

正常情况:

异常情况:

一阶段:

- 事务协调者通知每个事务参与者执行本地事务

- 本地事务执行完成后报告事务执行状态给事务协调者,此时事务不提交,继续持有数据库锁

二阶段:

- 事务协调者基于一阶段的报告来判断下一步操作

- 如果一阶段都成功,则通知所有事务参与者,提交事务

- 如果一阶段任意一个参与者失败,则通知所有事务参与者回滚事务

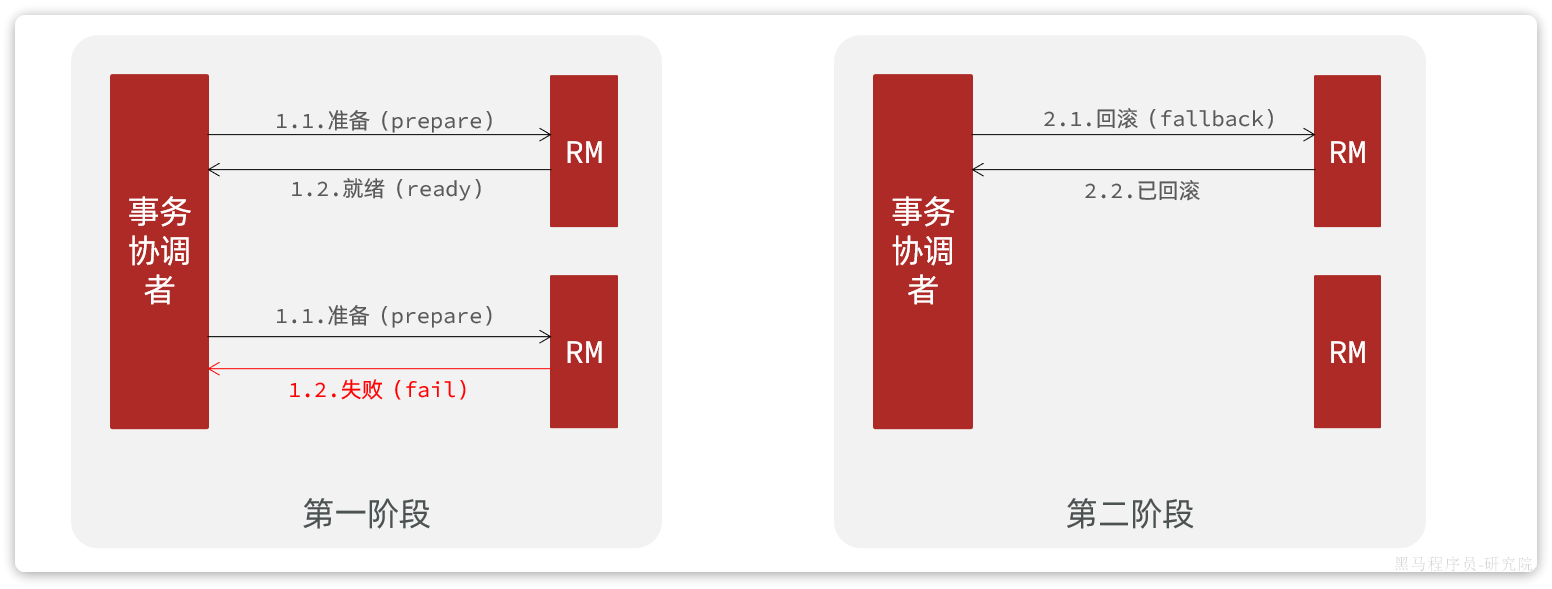

Seata的XA模型

Seata对原始的XA模式做了简单的封装和改造,以适应自己的事务模型,基本架构如图:

RM一阶段的工作:

- 注册分支事务到

TC - 执行分支业务sql但不提交

- 报告执行状态到

TC

TC二阶段的工作:

TC检测各分支事务执行状态- 如果都成功,通知所有RM提交事务

- 如果有失败,通知所有RM回滚事务

RM二阶段的工作:

- 接收

TC指令,提交或回滚事务

优缺点

XA模式的优点是什么?

- 事务的强一致性,满足ACID原则

- 常用数据库都支持,实现简单,并且没有代码侵入

XA模式的缺点是什么?

- 因为一阶段需要锁定数据库资源,等待二阶段结束才释放,性能较差

- 依赖关系型数据库实现事务

实现步骤

首先,在配置文件中指定要采用的分布式事务模式。可以在Nacos中的共享shared-seata.yaml配置文件中设置:

|

|

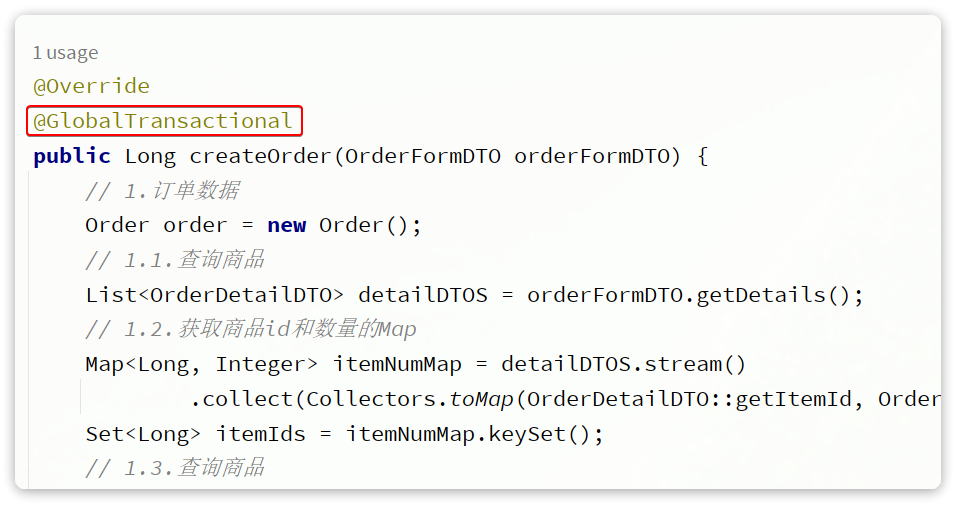

其次,利用@GlobalTransactional标记分布式事务的入口方法:

以上两步即可实现XA模式

AT模式

AT模式同样是分阶段提交的事务模型,不过缺弥补了XA模型中资源锁定周期过长的缺陷

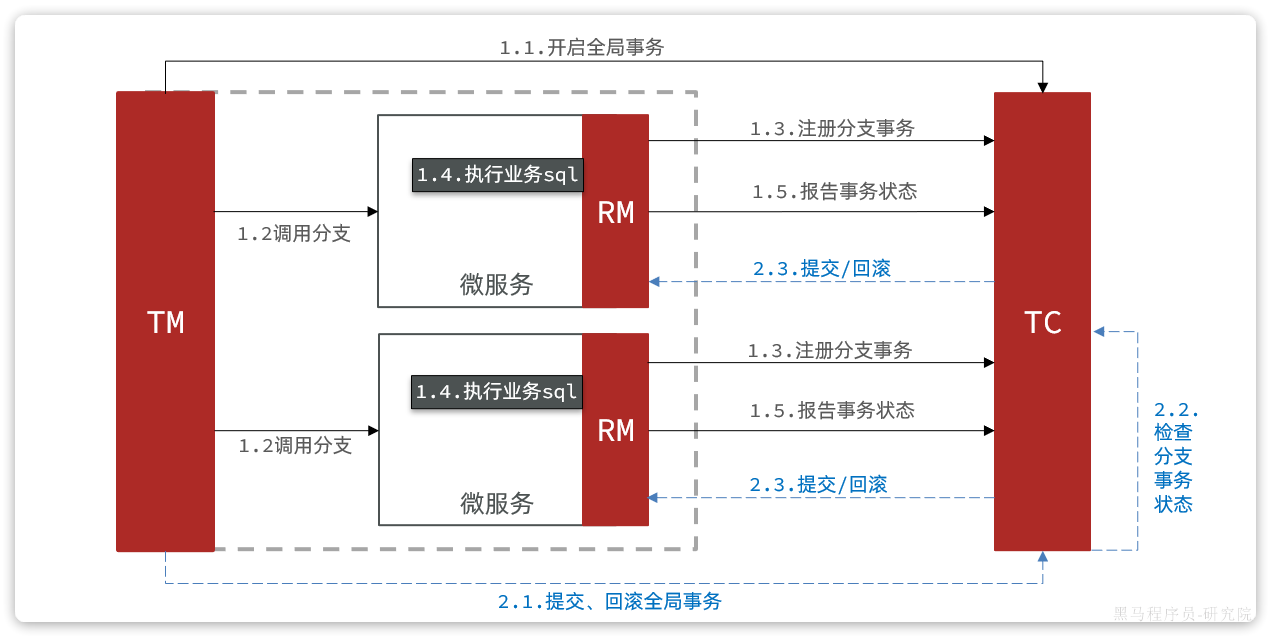

Seata的AT模型

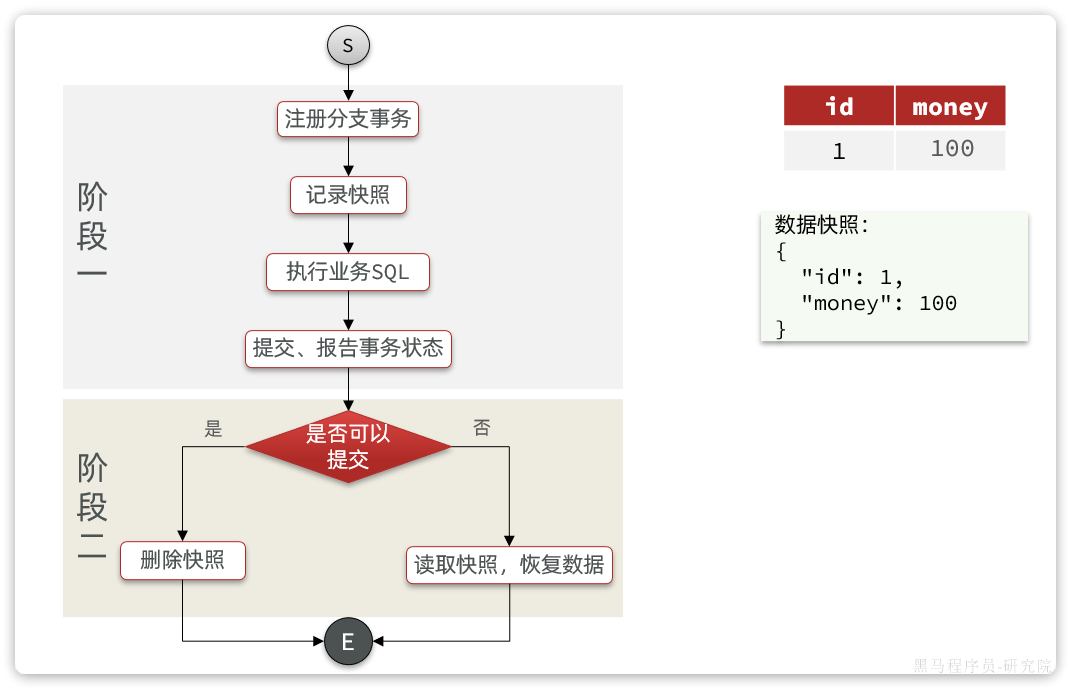

基本流程图:

阶段一RM的工作:

- 注册分支事务

- 记录undo-log(数据快照)

- 执行业务sql并提交

- 报告事务状态

阶段二提交时RM的工作:

- 删除undo-log即可

阶段二回滚时RM的工作:

- 根据undo-log恢复数据到更新前

流程梳理

用一个真实的业务来梳理下AT模式的原理。

比如,现在有一个数据库表,记录用户余额:

| id | money |

|---|---|

| 1 | 100 |

其中一个分支业务要执行的SQL为:

|

|

AT模式下,当前分支事务执行流程如下:

一阶段:

TM发起并注册全局事务到TCTM调用分支事务- 分支事务准备执行业务SQL

RM拦截业务SQL,根据where条件查询原始数据,形成快照。

|

|

RM执行业务SQL,提交本地事务,释放数据库锁。此时 money = 90RM报告本地事务状态给TC

二阶段:

TM通知TC事务结束TC检查分支事务状态- 如果都成功,则立即删除快照

- 如果有分支事务失败,需要回滚。读取快照数据({“id”: 1, “money”: 100}),将快照恢复到数据库。此时数据库再次恢复为100

流程图:

实现步骤

首先,添加资料中的seata-at.sql到微服务对应的数据库中(此处涉及到cart-service、item-service和trade-service三个模块,所以在这三个模块对应库中执行下方sql语句):

|

|

然后,修改application.yml文件,将事务模式修改为AT模式(不填时默认就是AT模式):

|

|

AT与XA的区别

AT模式与XA模式最大的区别是什么?

XA模式一阶段不提交事务,锁定资源;AT模式一阶段直接提交,不锁定资源。XA模式依赖数据库机制实现回滚;AT模式利用数据快照实现数据回滚。XA模式强一致;AT模式最终一致

可见,AT模式使用起来更加简单,无业务侵入,性能更好。因此企业90%的分布式事务都可以用AT模式来解决。